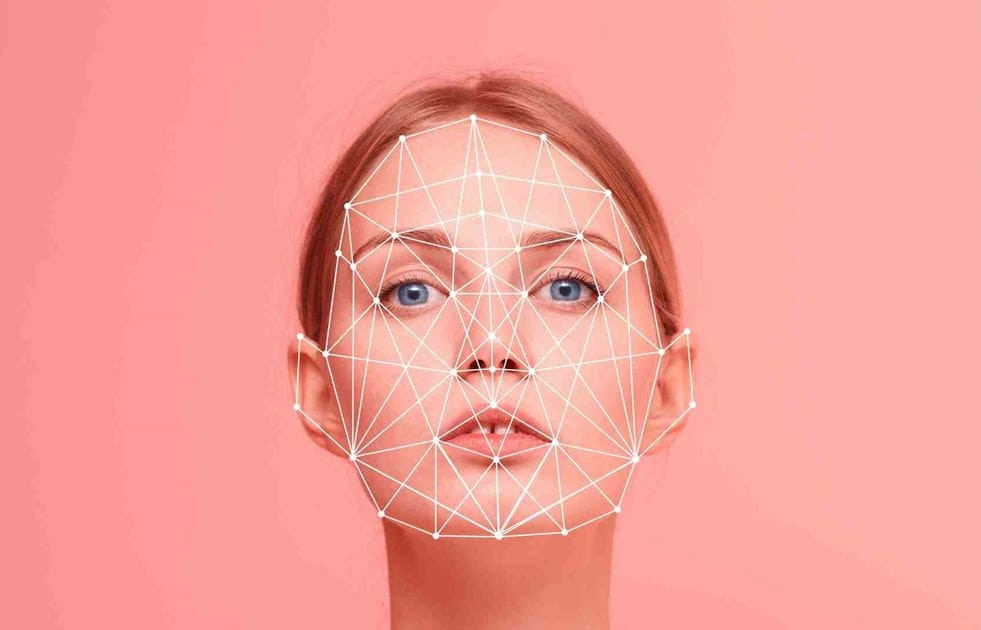

التزييف العميق (Deepfake) مصطلحٌ نشأ من دمج مصطلحي "التعلم العميق" و"التزييف". باختصار، هي تقنية محاكاة وإنشاء منتجات صوتية أو صورية أو حتى فيديوهات مزيفة.

منذ التطور الهائل للذكاء الاصطناعي ، ازدادت مشكلة التزييف العميق شيوعًا، مما أدى إلى انتشار موجات من المعلومات المضللة في الصحافة. لذلك، يُعدّ التحقق الاستباقي من مصدر الصور ومقاطع الفيديو مسألةً ملحةً لشركات الكاميرات الرائدة عالميًا .

من المتوقع أن تُطلق سوني وكانون ونيكون كاميرات رقمية تدعم التوقيعات الرقمية مباشرةً على كاميراتها عديمة المرآة (أو كاميرات DSLR الرقمية). يُعدّ تطبيق التوقيعات الرقمية على الكاميرات إجراءً بالغ الأهمية، إذ يُثبت منشأ الصور وسلامتها.

ستتضمن هذه التوقيعات الرقمية معلومات حول التاريخ والوقت والموقع والمصور، وهي غير قابلة للتزوير. وهذا مهم بشكل خاص للمصورين الصحفيين وغيرهم من المهنيين الذين يتطلب عملهم مصادقة.

اتفقت ثلاث شركات عملاقة في صناعة الكاميرات على معيار عالمي للتوقيعات الرقمية متوافق مع أداة التحقق الإلكترونية "فيرفاي". أطلقت هذه الأداة، التي تحالف من وكالات إخبارية عالمية وشركات تقنية ومصنّعي كاميرات، تحالفًا يتيح التحقق المجاني من صحة أي صورة. في حال إنشاء الصور أو تعديلها باستخدام الذكاء الاصطناعي، ستُعلّمها "فيرفاي" بأنها "غير قابلة للتحقق من المحتوى".

وتنبع أهمية تقنيات مكافحة التزييف العميق من الارتفاع السريع في استخدام التزييف العميق لشخصيات مشهورة مثل الرئيس الأمريكي السابق دونالد ترامب ورئيس الوزراء الياباني فوميو كيشيدا.

بالإضافة إلى ذلك، قام باحثون من جامعة تسينغهوا في الصين بتطوير نموذج ذكاء اصطناعي توليدي جديد قادر على توليد حوالي 700 ألف صورة يوميًا.

بالإضافة إلى شركات تصنيع الكاميرات، تنضم شركات تقنية أخرى إلى جهود مكافحة التزييف العميق. فقد أطلقت جوجل أداةً لإضافة علامة مائية رقمية على الصور المُولّدة بالذكاء الاصطناعي، بينما طورت إنتل تقنيةً تُحلل تغيرات لون البشرة في الصور للمساعدة في تحديد صحتها. كما تعمل هيتاشي على تطوير تقنية لمنع الاحتيال في الهوية عبر الإنترنت.

ومن المتوقع أن تصبح التكنولوجيا الجديدة متاحة في أوائل عام 2024. وتخطط سوني للترويج للتكنولوجيا في وسائل الإعلام وقد أجرت بالفعل تجارب ميدانية في أكتوبر 2023. وتتعاون كانون مع تومسون رويترز ومختبر ستارلينج لحفظ البيانات (معهد أبحاث أسسته جامعة ستانفورد وجامعة جنوب كاليفورنيا) لمزيد من تحسين التكنولوجيا.

ويأمل مصنعو الكاميرات أن تساعد التكنولوجيا الجديدة في استعادة ثقة الجمهور في الصور، وهو ما يؤثر بدوره على نظرتنا للعالم.

(وفقا لOL)

دفع 5000 دولار لشركة فيسبوك لنشر فيديو احتيال استثماري مزيف

برمجيات خبيثة جديدة تسيطر على الهواتف الذكية، ومقاطع الفيديو المزيفة أصبحت أكثر تطوراً

أصبحت مقاطع الفيديو المزيفة أكثر تطوراً وواقعية

ماذا تفعل لتجنب الوقوع في فخ مكالمات الفيديو Deepfake التي تخدع التحويلات المالية؟

يتم استغلال تقنية Deepfakes لوضع وجوه الضحايا في مقاطع الفيديو الإباحية

[إعلان 2]

مصدر

![[صورة] رئيس الجمعية الوطنية يحضر ندوة "بناء وتشغيل مركز مالي دولي وتوصيات لفيتنام"](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/7/28/76393436936e457db31ec84433289f72)

تعليق (0)