সাউথ চায়না মর্নিং পোস্টের আজ, ২ জানুয়ারী প্রকাশিত এক প্রতিবেদনে বলা হয়েছে, চীনা সামরিক বাহিনী সম্প্রতি সতর্ক করে দিয়েছে যে কৃত্রিম বুদ্ধিমত্তা (এআই) যুদ্ধক্ষেত্রে মানুষের সিদ্ধান্ত গ্রহণের স্থান নিতে পারবে না।

"মানুষকে প্রতিস্থাপনের পরিবর্তে বরং কমান্ড দক্ষতা বৃদ্ধির জন্য, AI কে সিদ্ধান্ত গ্রহণকারীদের সাথে একযোগে কাজ করতে হবে," ৩১ ডিসেম্বর, ২০২৪ তারিখে নববর্ষের প্রাক্কালে PLA ডেইলিতে প্রকাশিত একটি নিবন্ধে জোর দিয়ে বলেছে চীনা পিপলস লিবারেশন আর্মি (PLA)।

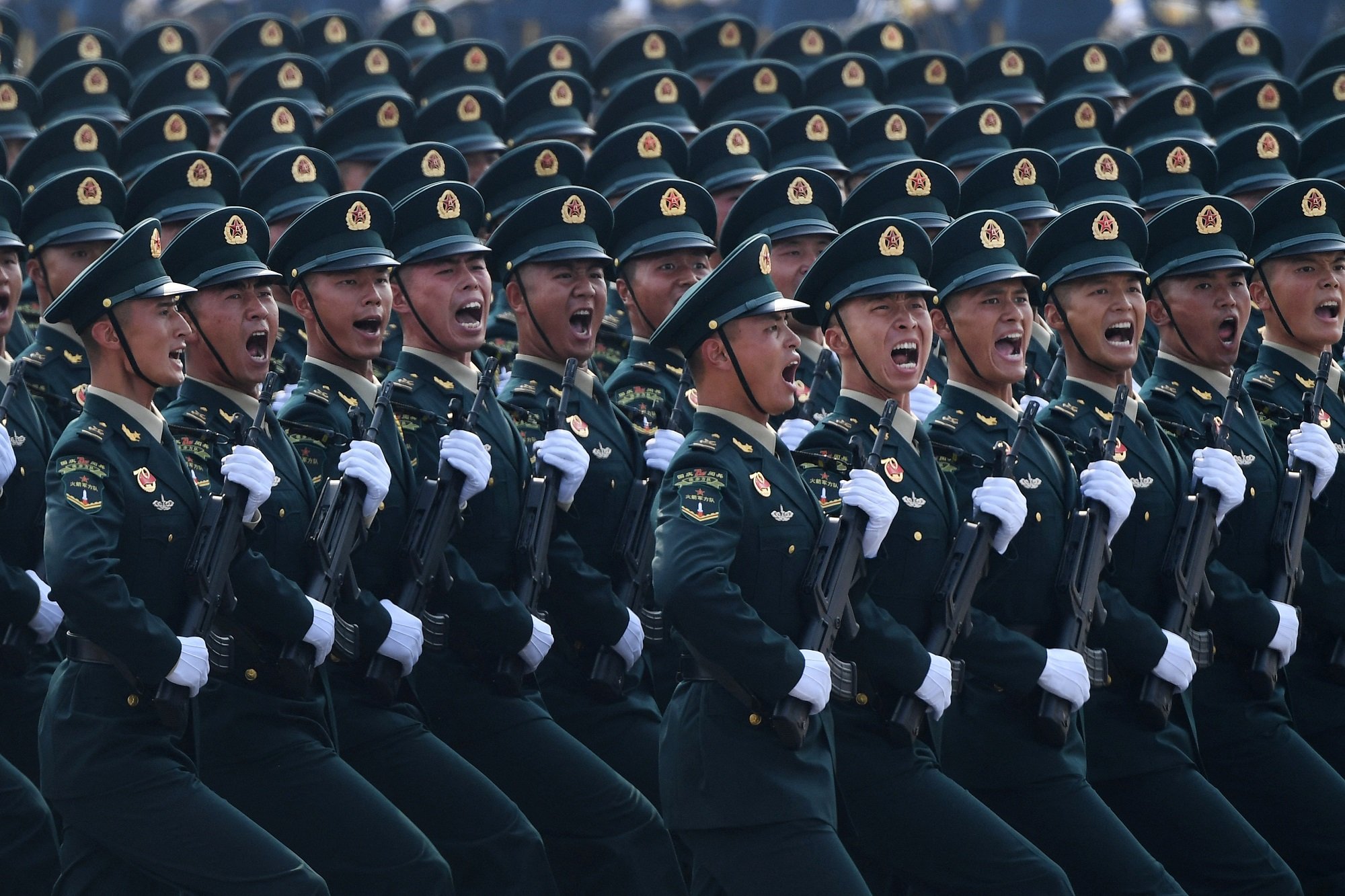

১ অক্টোবর, ২০১৯ তারিখে বেইজিংয়ের তিয়ানানমেন স্কয়ারে একটি সামরিক কুচকাওয়াজের সময় চীনা সৈন্যরা

তথ্য বিশ্লেষণ, সিমুলেশন বা পরিকল্পনার মাধ্যমে মানুষের ক্ষমতা বৃদ্ধির জন্য AI ব্যবহার করা যেতে পারে, কিন্তু এগুলি প্রতিস্থাপন করতে পারে না, নিবন্ধটিতে আরও বলা হয়েছে। "এটি বিকশিত হওয়ার সাথে সাথে, AI-কে মানুষের বিচার-বিবেচনা দ্বারা পরিচালিত একটি হাতিয়ার হিসেবে থাকতে হবে, যাতে সামরিক সিদ্ধান্ত গ্রহণের ক্ষেত্রে জবাবদিহিতা, সৃজনশীলতা এবং কৌশলগত অভিযোজনযোগ্যতা অগ্রভাগে থাকে তা নিশ্চিত করা যায়," নিবন্ধটিতে বলা হয়েছে।

প্রবন্ধে, পিএলএ জোর দিয়ে বলেছে যে যুদ্ধক্ষেত্রে মানুষের স্বায়ত্তশাসন এবং সৃজনশীলতা অপরিহার্য। পিএলএ যুক্তি দেয় যে মানব কমান্ডাররা পরিস্থিতির প্রতি গতিশীলভাবে প্রতিক্রিয়া জানাতে পারে এবং শত্রুর দুর্বলতাগুলিকে কাজে লাগাতে পারে, তবে এআই পূর্বনির্ধারিত অ্যালগরিদমিক সীমানার মধ্যে কাজ করে এবং এর প্রতিক্রিয়াগুলিতে প্রায়শই মৌলিকত্বের অভাব থাকে।

পিএলএ একটি "মানব পরিকল্পনা এবং এআই কার্যকর" মডেলের দিকে ঝুঁকেছে, যেখানে মানব তত্ত্বাবধানের উপাদান বজায় রেখে কমান্ডারদের দ্বারা বিকশিত কৌশল এবং কৌশল বাস্তবায়নের জন্য প্রযুক্তি ব্যবহার করা হয়।

চীনা নৌবাহিনীর বিশেষ বাহিনী বৈদ্যুতিক স্কেটবোর্ডে চড়ে, অনুশীলনে পাখির মতো দেখতে ইউএভি ছেড়েছে

পিএলএ এমন একটি কাঠামোরও পক্ষে যেখানে মেশিনগুলি তথ্য বিশ্লেষণ করে, অন্তর্দৃষ্টি প্রদান করে এবং সম্ভাব্য পদক্ষেপের সুপারিশ করে। তবে, পিএলএ অনুসারে, "চূড়ান্ত সিদ্ধান্ত মানব কমান্ডারদের উপর নির্ভর করে, যারা এআই-এর ব্ল্যাক-বক্স প্রকৃতি থেকে উদ্ভূত ত্রুটির প্রতিরোধ নিশ্চিত করে।"

[বিজ্ঞাপন_২]

সূত্র: https://thanhnien.vn/quan-doi-trung-quoc-ra-canh-bao-ve-ai-18525010214511349.htm

![[ছবি] প্রকল্পের বাধা দূর করার জন্য প্রধানমন্ত্রী ফাম মিন চিন সরকারি স্থায়ী কমিটির একটি বৈঠকে সভাপতিত্ব করছেন।](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/10/06/1759768638313_dsc-9023-jpg.webp)

![[ছবি] প্রধানমন্ত্রী ফাম মিন চিন মন্ত্রণালয়, শাখা এবং স্থানীয় এলাকার অধীনে জনসেবা ইউনিটের ব্যবস্থাপনা সংক্রান্ত স্টিয়ারিং কমিটির একটি বৈঠকে সভাপতিত্ব করেন।](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/10/06/1759767137532_dsc-8743-jpg.webp)

মন্তব্য (0)