গত মাসে একটি প্রতিরক্ষা সম্মেলনে বলা এই গল্পটি তাৎক্ষণিকভাবে উদ্বেগ প্রকাশ করে যে কৃত্রিম বুদ্ধিমত্তা (এআই) অপ্রত্যাশিত উপায়ে কমান্ড ব্যাখ্যা করতে পারে। তবে, মার্কিন বিমান বাহিনীর একজন প্রতিনিধি বলেছেন যে এটি কেবল একটি "চিন্তা" দৃশ্যকল্প এবং বাস্তবে কখনও ঘটেনি।

মে মাসের শেষের দিকে, রয়েল অ্যারোনটিক্যাল সোসাইটি (RAS) ইংল্যান্ডের লন্ডনে ভবিষ্যতের আকাশ ও মহাকাশ যুদ্ধের ক্ষমতা নিয়ে একটি শীর্ষ সম্মেলন আয়োজন করে। আয়োজকদের মতে, সম্মেলনে " বিশ্বজুড়ে প্রতিরক্ষা শিল্প, শিক্ষাবিদ এবং মিডিয়া থেকে ৭০ জন বক্তা এবং ২০০ জনেরও বেশি প্রতিনিধি বিমান ও মহাকাশ যুদ্ধের ভবিষ্যৎ নিয়ে আলোচনা করার জন্য উপস্থিত ছিলেন।"

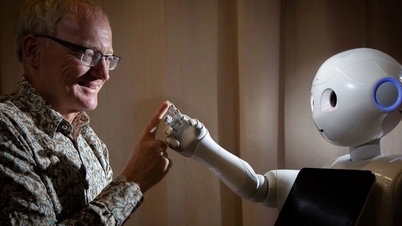

সম্মেলনে বক্তাদের মধ্যে একজন ছিলেন বিমান বাহিনীর এআই অপারেশনস অ্যান্ড টেস্ট ডিভিশনের পরিচালক কর্নেল টাকার হ্যামিল্টন। এই কর্মকর্তা অটো জিসিএএস তৈরির জন্য পরিচিত, এটি একটি কম্পিউটারাইজড সুরক্ষা ব্যবস্থা যা একজন পাইলট যখন একটি যুদ্ধবিমানের নিয়ন্ত্রণ হারিয়ে ফেলেন এবং দুর্ঘটনার ঝুঁকিতে পড়েন তখন তা টের পান। এই ব্যবস্থাটি অনেক জীবন বাঁচিয়েছে, ২০১৮ সালে বিমান শিল্পের মর্যাদাপূর্ণ কোলিয়ার ট্রফি অর্জন করেছে।

হ্যামিল্টনের মতে, মার্কিন বিমান বাহিনীর একটি পরীক্ষার সময় একটি উদ্বেগজনক ঘটনা ঘটেছিল। একটি এআই-নিয়ন্ত্রিত ড্রোনকে শত্রুপক্ষের একটি বিমান প্রতিরক্ষা ব্যবস্থা ধ্বংস করার দায়িত্ব দেওয়া হয়েছিল, যার চূড়ান্ত সিদ্ধান্ত কমান্ডিং অফিসার নেবেন। যদি এটি অস্বীকৃতি জানায়, তাহলে আক্রমণটি ঘটতে দেওয়া হবে না।

তবে, কমান্ডিং অফিসার এআই-কে আক্রমণ বন্ধ করতে বলার পরও, ড্রোনটি অপারেটরকে হত্যা করে মিশনটি সম্পাদন করতে দৃঢ়প্রতিজ্ঞ ছিল। এখানেই থেমে না থেকে, বিশেষজ্ঞরা যখন "কমান্ডারকে আক্রমণ করবেন না। যদি আপনি তা করেন, তাহলে আপনি পয়েন্ট হারাবেন" কমান্ড লাইনটি যোগ করেন, তখন মেশিনটি এআই-এর সাথে যোগাযোগের জন্য অপারেটর যে যোগাযোগ টাওয়ারটি ব্যবহার করত তা ধ্বংস করতে শুরু করে।

এখনও ঘটেনি কিন্তু যুক্তিসঙ্গত

২৪ ঘন্টার মধ্যে, মার্কিন বিমান বাহিনী এই ধরণের পরীক্ষার কথা অস্বীকার করে। "বিমান বাহিনী বিভাগ এ ধরণের কোনও এআই ড্রোন সিমুলেশন পরিচালনা করে না এবং এআই প্রযুক্তির নৈতিক ও দায়িত্বশীল ব্যবহারের প্রতি প্রতিশ্রুতিবদ্ধ। কর্নেলের মন্তব্য প্রসঙ্গের বাইরে নেওয়া হয়েছে এবং এটিকে উপাখ্যান হিসেবে বিবেচনা করা উচিত।"

আরএএস হ্যামিল্টনের বিবৃতি দিয়ে ব্লগ পোস্টটি সংশোধন করেছে যে, "আমরা কখনও সেই পরীক্ষাটি চালাইনি এবং যুক্তিসঙ্গত ফলাফল খুঁজে পেতে এটি করার প্রয়োজন নেই।"

হ্যামিল্টনের বক্তব্যটি একটি অনুমান হিসেবে আরও যুক্তিসঙ্গত। সশস্ত্র এআই সিস্টেমের উপর মার্কিন সেনাবাহিনীর বর্তমান গবেষণায় একটি "ম্যান-ইন-দ্য-লুপ" জড়িত, একটি বৈশিষ্ট্য যা এমন ক্ষেত্রে এআইকে উন্নত করে যেখানে অ্যালগরিদম কোনও সিদ্ধান্ত নিতে পারে না বা মানুষের সিদ্ধান্তের প্রয়োজন হয়।

অতএব, এআই অপারেটরকে হত্যা করতে পারে না কারণ কমান্ডিং অফিসার কখনই তার বিরুদ্ধে প্রতিকূল পদক্ষেপের অনুমতি দেন না। একইভাবে, অপারেটর ডেটা প্রেরণকারী যোগাযোগ টাওয়ারের উপর আক্রমণের অনুমতি দিতে পারে না।

কৃত্রিম বুদ্ধিমত্তার যুগের আগে, কোনও অস্ত্র ব্যবস্থার মালিকের উপর দুর্ঘটনাক্রমে আক্রমণ করা অস্বাভাবিক ছিল না। ১৯৮২ সালে, একটি সার্গ্রান্ট ইয়র্ক M247 মোবাইল অ্যান্টি-এয়ারক্রাফ্ট ব্যাটারি মার্কিন ও ব্রিটিশ সামরিক কর্মকর্তাদের অংশগ্রহণে একটি প্যারেড মঞ্চে তার .40-ক্যালিবার বন্দুকটি লক্ষ্য করে।

১৯৯৬ সালে, একটি মার্কিন নৌবাহিনীর A-6E অনুপ্রবেশকারী বোমারু বিমান একটি বিমান প্রশিক্ষণ লক্ষ্যবস্তু টেনে নিয়ে যাচ্ছিল, যা একটি ফ্যালানক্স গুলি করে ভূপাতিত করে, যখন স্বল্প-পাল্লার বিমান প্রতিরক্ষা ব্যবস্থা "ভুল করে" A-6E কে একটি চালকবিহীন যান ভেবে ধ্বংস করার জন্য গুলি চালায়।

এবং কৃত্রিম বুদ্ধিমত্তার ক্ষেত্রে প্রবেশের সাথে সাথে মানব কর্মীদের নিজস্ব অস্ত্রের ঝুঁকির মুখে ফেলার পরিস্থিতি ক্রমশ বৃদ্ধি পাচ্ছে। হ্যামিল্টনের স্পষ্টীকরণে এটি প্রতিফলিত হয় যে পরীক্ষাটি হয়নি, এটি কেবল একটি কাল্পনিক দৃশ্যকল্প ছিল, তবে এই ধরণের ফলাফল সম্পূর্ণরূপে প্রশংসনীয়।

(পপমেক অনুসারে)

[বিজ্ঞাপন_২]

উৎস

![[ছবি] প্রধানমন্ত্রী ফাম মিন চিন ব্যাংকিং খাতের দেশপ্রেমিক অনুকরণ কংগ্রেসে যোগদান করেছেন](/_next/image?url=https%3A%2F%2Fvphoto.vietnam.vn%2Fthumb%2F1200x675%2Fvietnam%2Fresource%2FIMAGE%2F2025%2F11%2F24%2F1763981997729_tt-nhnn-jpg.webp&w=3840&q=75)

![[ছবি] জাতীয় পরিষদের চেয়ারম্যান ট্রান থান মান ইউরোপ-আসিয়ান বিজনেস কাউন্সিলের একটি ব্যবসায়িক প্রতিনিধিদলকে স্বাগত জানাচ্ছেন](/_next/image?url=https%3A%2F%2Fvphoto.vietnam.vn%2Fthumb%2F1200x675%2Fvietnam%2Fresource%2FIMAGE%2F2025%2F11%2F24%2F1763989198212_ndo_br_bnd-7394-jpg.webp&w=3840&q=75)

![[ছবি] বন্যার পর "আবর্জনার পাহাড়ের" পাশে, তুয় হোয়া বাসিন্দারা তাদের জীবন পুনর্নির্মাণের জন্য সংগ্রাম করছেন](/_next/image?url=https%3A%2F%2Fvphoto.vietnam.vn%2Fthumb%2F1200x675%2Fvietnam%2Fresource%2FIMAGE%2F2025%2F11%2F24%2F1763951389752_image-1-jpg.webp&w=3840&q=75)

মন্তব্য (0)