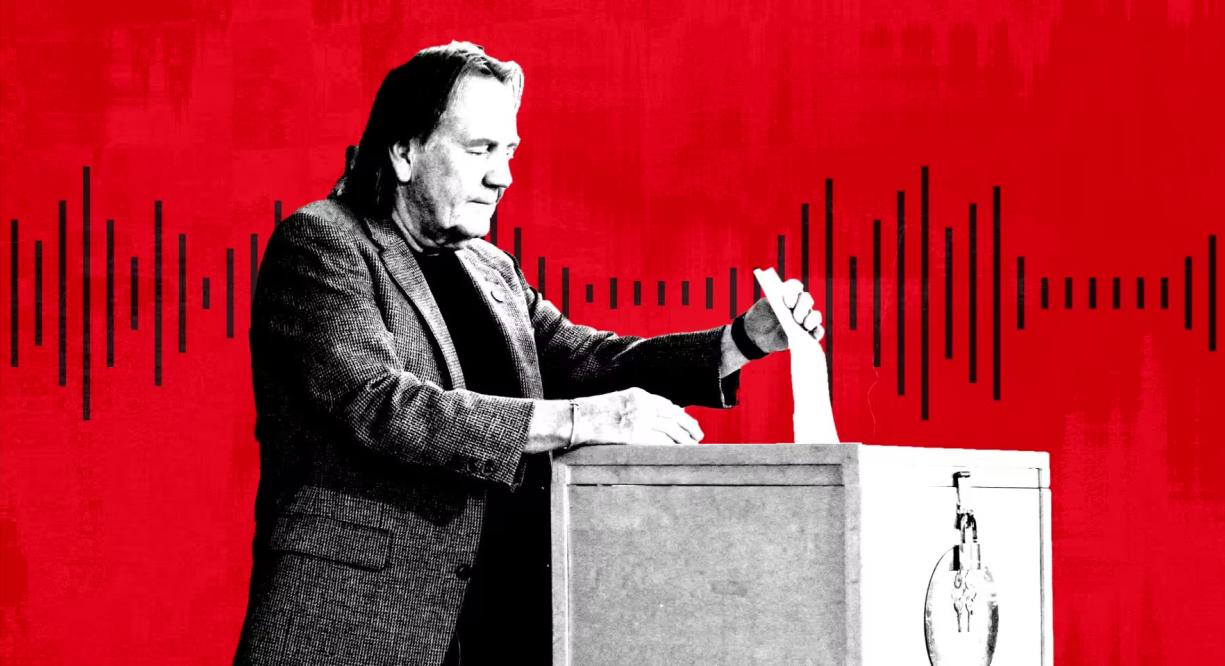

Úřad generálního prokurátora státu New Hampshire v pondělí oznámil, že vyšetřuje možnou manipulaci s voliči poté, co se objevily stížnosti na falešný hlas, který zněl přesně jako hlas amerického prezidenta Joea Bidena, jenž nabádal voliče, aby nehlasovali v primárkách státu.

Výzkumníci také varovali před používáním deepfake audia k napodobování politiků a vůdců, přičemž k významným případům došlo v roce 2023 ve Velké Británii, Indii, Nigérii, Súdánu, Etiopii a na Slovensku.

Osoba volí v primárních volbách v New Hampshire v USA. Foto: Getty

Podle odborníků se deepfake audio stalo populární formou dezinformací díky vzniku řady levných a efektivních nástrojů umělé inteligence od startupů. Společnost Microsoft také vyvinula nový model umělé inteligence, který dokáže kopírovat hlasy z pouhých tří sekund nahrávky.

„Pokud jde o vizuální manipulaci, každý zná Photoshop, nebo alespoň ví o jeho existenci,“ řekl Henry Ajder, expert na umělou inteligenci a deepfake a konzultant pro Adobe, Meta a EY. „Existuje jen velmi malé povědomí o tom, jak lze manipulovat se zvukem, takže podle mě nás to opravdu činí zranitelnými.“

V září NewsGuard, systém hodnotící kvalitu a důvěryhodnost zpravodajských webů, objevil síť účtů na TikToku, které se maskovaly jako legitimní zpravodajské weby a používaly obsah generovaný umělou inteligencí k šíření konspiračních teorií a politických dezinformací. Deepfake nahrávky, včetně hlasu bývalého amerického prezidenta Baracka Obamy, získaly stovky milionů zhlédnutí.

Zdá se, že falešné dabingové komentáře byly vygenerovány nástrojem poskytnutým společností ElevenLabs podporovanou Andreessenem Horowitzem, zatímco klipy si podle NewsGuardu získaly stovky milionů zhlédnutí.

„Více než 99 % uživatelů na naší platformě vytváří zajímavý, kreativní a užitečný obsah, ale uznáváme, že existují případy zneužití, a proto jsme neustále vyvíjeli a zaváděli ochranná opatření, která je omezují,“ uvedli v ElevenLabs.

Společnost ElevenLabs, založená před dvěma lety bývalými zaměstnanci společností Google a Palantir Piotrem Dabkowskim a Mati Staniszewskim, nabízí základní nástroje pro generování zvuku s využitím umělé inteligence zdarma na jedno kliknutí. Ceny předplatného se pohybují od 1 dolaru měsíčně do 330 dolarů měsíčně a pro ty, kteří hledají komplexnější služby, i více.

Americké zpravodajské agentury loni ve zprávě varovaly, že „personalizované podvody s využitím umělé inteligence se výrazně zvýšily díky vydání sofistikovaných a dobře vyškolených modelů klonování hlasu s využitím umělé inteligence“.

Kromě finančně motivovaných podvodů nyní političtí experti bijí na poplach i kvůli virálním deepfake audioklipům a také kvůli jejich používání pro robotické hovory nebo kampaně. „Můžete vybudovat silnou a rozsáhlou dezinformační kampaň zaměřenou na telefony,“ řekl AJ Nash, viceprezident a významný zpravodajský pracovník skupiny pro kybernetickou bezpečnost ZeroFox.

Některé z těchto společností aktivně hledají další způsoby, jak bojovat proti dezinformacím. Společnost Microsoft vydala etické prohlášení, v němž uživatele vyzývá k nahlášení jakéhokoli zneužití jejího nástroje pro zvuk s umělou inteligencí. Společnost ElevenLabs si vytvořila vlastní detekční nástroje pro identifikaci zvukových nahrávek vytvořených jejím systémem.

Během nigerijských voleb v roce 2023 se na sociálních sítích šířil klip upravený umělou inteligencí, který údajně naznačoval, že opoziční kandidát plánuje zmanipulovat hlasování, uvedla skupina pro lidská práva Freedom House.

Na Slovensku se jen několik dní před prezidentskými volbami v září šířil falešný zvukový záznam opozičního kandidáta Michala Šimečky, který zřejmě plánoval zmanipulovat volby.

„Deepfake z New Hampshire je připomínkou mnoha způsobů, jakými mohou deepfaky zmást a podvádět,“ řekl Robert Weissman, prezident neziskové skupiny na ochranu spotřebitelů Public Citizen. „Nastal čas politických deepfaků. Tvůrci politik musí jednat rychle a zavést ochranná opatření, jinak budeme čelit volebnímu chaosu.“

Mai Anh (podle FT)

Zdroj

![[Fotografie] Předseda Národního shromáždění Tran Thanh Man přijal prvního místopředsedu Rady federace Federálního shromáždění Ruské federace](/_next/image?url=https%3A%2F%2Fvphoto.vietnam.vn%2Fthumb%2F1200x675%2Fvietnam%2Fresource%2FIMAGE%2F2025%2F12%2F02%2F1764648408509_ndo_br_bnd-8452-jpg.webp&w=3840&q=75)

![[Fotografie] Generální tajemník To Lam a jeho manželka se zúčastnili 50. výročí laoského státního svátku](https://vphoto.vietnam.vn/thumb/402x226/vietnam/resource/IMAGE/2025/12/02/1764644139308_1.jpeg)

Komentář (0)