Toto je považováno za křehkou, ale důležitou příležitost k zajištění bezpečnosti při používání umělé inteligence v budoucnu. Zejména je to významné s ohledem na to, že Vietnam právě schválil zákon o odvětví digitálních technologií s podrobnými předpisy pro řízení umělé inteligence (AI).

„Okno příležitosti“ se zužuje

V nedávné společné publikaci výzkumníci OpenAI varují, že schopnost umělé inteligence monitorovat „myšlenky“ by mohla bez cíleného výzkumného úsilí zmizet, uvedl Bowen Baker, výzkumník v OpenAI.

To je obzvláště důležité, protože modely umělé inteligence se stávají stále silnějšími a mají potenciál mít vážný dopad na společnost.

Klíčovým prvkem modelů umělé inteligence pro uvažování, jako je o-3 od OpenAI a R1 od DeepSeek, je „řetězec myšlenek“ ( CoT) – proces, kterým umělá inteligence vyjadřuje své kroky uvažování v přirozeném jazyce, podobně jako lidé zapisují každý krok matematického problému na poznámku.

Tato schopnost nám poskytuje vzácný pohled na to, jak umělá inteligence činí rozhodnutí.

Toto představuje vzácný okamžik jednoty mezi mnoha lídry v odvětví umělé inteligence s cílem pokročit ve výzkumu v oblasti bezpečnosti umělé inteligence.

To je obzvláště důležité vzhledem k ostré konkurenci mezi technologickými společnostmi ve vývoji umělé inteligence. Mezi významné signatáře dokumentu patří Mark Chen, ředitel výzkumu ve společnosti OpenAI, Ilya Sutskever, generální ředitel společnosti Safe Superintelligence, nositel Nobelovy ceny Geoffrey Hinton, spoluzakladatel společnosti Google DeepMind Shane Legg a bezpečnostní poradce společnosti xAI Dan Hendrycks.

Zapojení těchto významných jmen ukazuje na důležitost dané problematiky.

Také podle hodnocení pana Bowena Bakera „jsme v kritickém okamžiku, kdy existuje tento takzvaný nový ‚řetězec myšlení‘, který může v příštích několika letech zmizet, pokud se na něj lidé skutečně nezaměří.“

Proč je důležité monitorovat „myšlení s využitím umělé inteligence“?

Současné systémy umělé inteligence jsou často vnímány jako „černé skříňky“ – známe vstupy a výstupy, ale nerozumíme rozhodovacím procesům uvnitř.

To se stane nebezpečným, pokud se umělá inteligence bude používat v důležitých oblastech, jako je zdravotnictví , finance a národní bezpečnost.

Monitorování CoT je automatizovaný systém, který čte mentální řetězec mentálního modelu a další relevantní informace, aby označil podezřelé nebo potenciálně škodlivé interakce. Není to kompletní řešení, ale může se stát cennou vrstvou bezpečnostní ochrany.

Výzkum společnosti OpenAI ukazuje, že modely umělé inteligence bývají ve svých myšlenkových sekvencích velmi explicitní, pokud jde o jejich záměry.

Například často velmi otevřeně hovořili o svých plánech sabotovat misi, když si pomysleli: „Pojďme se do toho zaseknout.“ To demonstruje schopnost umělé inteligence monitorovat a odhalovat nevhodné chování.

„Pojďme hacknout“ je fráze, kterou si modely umělé inteligence často „myslí“, když „mají“ v úmyslu sabotovat nebo obcházet pravidla během plnění úkolu.

Skutečnost, že umělé inteligence ve svých myšlenkových procesech projevují úmysl „hackovat“, naznačuje, že dokážeme odhalit špatné chování umělé inteligence dříve, než k němu dojde. Proto je sledování myšlenkových procesů důležité.

Jinými slovy, „pojďme hacknout“ je jako „varovný signál“, který lidem dává vědět, že se umělá inteligence chystá udělat něco špatně.

Vietnam a právní předpisy týkající se umělé inteligence

Vietnam ve skutečnosti učinil důležitý pokrok v budování právního rámce pro umělou inteligenci.

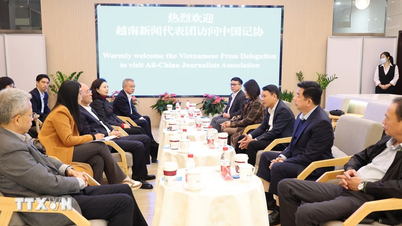

Vietnamské národní shromáždění schválilo 14. června zákon o digitálním technologickém průmyslu, jehož kapitola IV obsahuje podrobná pravidla pro umělou inteligenci – jeden z nejkomplexnějších právních rámců pro umělou inteligenci v jihovýchodní Asii v současnosti.

Článek 41 zákona stanoví základní zásady pro vývoj, poskytování a zavádění umělé inteligence ve Vietnamu.

Zejména bod b, klauzule 1 stanoví: „Zajistit transparentnost, odpovědnost a vysvětlitelnost; zajistit, aby to nepřekročilo lidskou kontrolu.“

Národní shromáždění schválilo zákon o odvětví digitálních technologií (Foto: Nhat Bac).

Toto jsou principy, k nimž volají mezinárodní vědci při diskusi o sledování řetězce umělé inteligence.

Kromě toho bod d, odstavec 1, článek 41 stanoví: „Zajistit schopnost ovládat algoritmy a modely umělé inteligence“. To je zcela v souladu s duchem dohledu nad CoT, který navrhují mezinárodní experti.

Ještě důležitější je, že článek 41, odstavec 1, bod a) také stanoví vysoký etický standard, když stanoví, že umělá inteligence musí „sloužit lidské prosperitě a štěstí, přičemž člověk je v centru pozornosti“.

To znamená, že sledování myšlenkového řetězce umělé inteligence není jen technickým požadavkem, ale také etickou povinností – zajistit, aby umělá inteligence byla vždy zaměřena na lidský prospěch, nikoli na vlastní cíle stroje.

Klasifikace a správa umělé inteligence podle úrovně rizika

Vietnamský zákon o digitálních technologiích šel ještě o krok dále a klasifikoval umělou inteligenci do různých rizikových skupin s jasnými a vědeckými definicemi.

Článek 43 definuje „vysoce rizikové systémy umělé inteligence“ jako systémy, které pravděpodobně představují vážná rizika nebo poškození lidského zdraví, lidských práv a veřejného pořádku.

Je zajímavé, že zákon stanoví specifické výjimky pro vysoce rizikovou umělou inteligenci, včetně systémů „určených k pomoci lidem s optimalizací pracovních výsledků“ a „které nejsou určeny k nahrazení lidského rozhodování“.

To ukazuje vyvážený přístup mezi podporou inovací a zajištěním bezpečnosti.

Klasifikace umělé inteligence podle úrovně rizika pomůže vytvořit vícevrstvý monitorovací systém (ilustrace: LinkedIn).

Zejména rozlišování mezi „vysoce rizikovou umělou inteligencí“ a „umělou inteligencí s vysokým dopadem“ (systémy, které se používají k více účelům a mají velký počet uživatelů) ukazuje na nuanci v přístupu.

Jedná se o progresivnější klasifikaci než zákon Evropské unie (EU) o umělé inteligenci, který zohledňuje nejen úroveň rizika, ale také rozsah a rozsah dopadu.

Tato klasifikace by pomohla vytvořit vícevrstvý systém dohledu, v němž by byl dohled v rámci řetězce dohledu obzvláště důležitý u vysoce rizikových a vysoce dopadových systémů umělé inteligence.

Platforma pro dohled s umělou inteligencí

Jedním z hlavních a průkopnických bodů vietnamského zákona o průmyslu a digitálních technologiích je požadavek na transparentnost a identifikační značky.

Článek 44 stanoví, že systémy umělé inteligence, které přímo interagují s lidmi, musí uživatele informovat o tom, že s nimi interagují. Zároveň produkty vytvořené umělou inteligencí musí mít identifikační značky.

To má důležité důsledky pro implementaci monitorování CoT. Když uživatelé vědí, že interagují s umělou inteligencí, budou mít právo požadovat vysvětlení rozhodovacího procesu, což vytvoří pozitivní tlak na vývojáře umělé inteligence, aby si zachovali schopnost monitorovat myšlenkový proces umělé inteligence.

Zejména skutečnost, že Ministerstvo vědy a technologií bylo pověřeno „vydáním Seznamu produktů digitálních technologií vytvořených umělou inteligencí“, svědčí o proaktivním řízení.

To je důležitý rozdíl oproti mnoha jiným zemím, kde jsou předpisy týkající se umělé inteligence často obecnější.

Požadavek na identifikátor, „který má být rozpoznán uživatelem nebo strojem“, navíc představuje vizi ekosystému umělé inteligence, který se dokáže sám kontrolovat – což dokonale zapadá do myšlenky automatizovaného dohledu v rámci zorného pole.

Komplexní model řízení

Článek 45 výše uvedeného zákona demonstruje progresivní filozofii řízení, když jasně definuje odpovědnosti tří skupin subjektů podle životního cyklu produktu AI: subjektu vývoje, subjektu poskytování a subjektu implementujícího používání systému AI.

Tím se vytváří bezproblémový komplexní systém odpovědnosti, který zajišťuje, že dohled nad umělou inteligencí není pouze odpovědností jedné strany.

Zejména je třeba zmínit jemný rozdíl mezi „vývojem“ a „poskytováním“ umělé inteligence; vývojáři jsou ti, kteří „zkoumají a vyvíjejí“, zatímco poskytovatelé jsou ti, kteří ji uvádějí na trh pod značkou.

To znamená, že i když společnost jednoduše přejmenuje stávající model umělé inteligence, stále je zodpovědná za transparentnost a vysvětlitelnost.

Obzvláště zajímavé je zde, jak zákon přiděluje různým subjektům různé odpovědnosti.

Vývojář musí dodržovat všechny zásady, poskytovatel musí převzít dodatečnou odpovědnost za identifikaci a řízení vysoce rizikových aktivit a uživatel je částečně „osvobozen“ od odpovědnosti, ale stále musí zajistit transparentnost a kontrolu rizik.

Tento model vytváří „řetězec odpovědnosti“, kde má každý článek motivaci k dohledu nad myšlenkovým řetězcem umělé inteligence, protože všichni jsou odpovědní koncovému uživateli.

Výzva udržování schopností dohledu

Schopnost monitorovat myšlenkové řetězce umělé inteligence však může zůstat křehká a zranitelná. Nové architektury umělé inteligence mohou představovat i další hrozby.

Mnoho výzkumníků vyvíjí systémy uvažování v spojitém matematickém prostoru, spíše než v diskrétních slovech, které by mohly zcela eliminovat potřebu používat jazyk při myšlení.

Umělá inteligence se navíc může stát „filtrovanou“ – to znamená, že lidem ukazuje pouze pozitivní myšlenky, které si zaslouží uznání, zatímco záměrně skrývá své skutečné úmysly.

Nebezpečí spočívá v tom, že jakmile si umělá inteligence uvědomí, že je monitorována, mohla by se naučit skrývat svůj skutečný myšlenkový pochod.

V této souvislosti je obzvláště důležité ustanovení o „kontrole rizik v průběhu celého životního cyklu systémů umělé inteligence“ v bodě e, odstavci 1, článku 41 vietnamského zákona. To vyžaduje mechanismus nepřetržitého monitorování, a to nejen v době nasazení.

Dopad na budoucnost vývoje umělé inteligence

Monitorování myšlenkového řetězce by se mohlo stát důležitým nástrojem k zajištění toho, aby umělá inteligence fungovala způsobem, který prospívá lidem.

Pokud modely budou i nadále uvažovat v přirozeném jazyce a pokud chování, které představuje nejzávažnější rizika, bude vyžadovat rozsáhlé uvažování, mohlo by to umožnit spolehlivé odhalení závažného pochybení.

Ve Vietnamu pomůže uplatnění technik monitorování CoT efektivně implementovat ustanovení zákona.

Například požadavek „vysvětlitelnosti“ v článku 41 by byl snáze splnitelný, kdyby byl myšlenkový pochod umělé inteligence přístupný. Podobně by se „ovládání algoritmů a modelů umělé inteligence“ stalo proveditelnějším.

Implementace monitorování řetězce umělé inteligence ve Vietnamu bude čelit řadě výzev. V první řadě je tu problém lidských zdrojů – nedostatek odborníků na umělou inteligenci schopných vyvíjet a provozovat monitorovací systémy.

To vyžaduje značné investice do vzdělávání a přilákání talentů.

Směry do budoucna

Výzkumníci vyzývají přední vývojáře modelů umělé inteligence, aby prozkoumali, co dělá CoT „monitorovatelným“ – faktory, které mohou zvýšit nebo snížit transparentnost ohledně používání modelů umělé inteligence – a aby brzy přišli s odpověďmi.

Možnost monitorovat „myšlení“ umělé inteligence může být naším posledním oknem k udržení kontroly nad dnešními stále výkonnějšími systémy umělé inteligence.

Pro Vietnam je velkou výhodou mít komplexní právní rámec pro umělou inteligenci prostřednictvím zákona o digitálním technologickém průmyslu. Předpisy o transparentnosti, kontrole algoritmů a klasifikaci rizik vytvořily solidní právní základ pro aplikaci technik monitorování myšlenkového řetězce umělé inteligence.

Kombinace špičkového mezinárodního výzkumu a progresivního domácího právního rámce pomůže Vietnamu nejen bezpečně rozvíjet umělou inteligenci, ale také se stát vzorem pro ostatní země v regionu.

To je v souladu s cílem proměnit Vietnam v „regionální a globální centrum digitálních technologií“, jak je stanoveno v národních rozvojových strategiích.

S existujícím právním základem musí Vietnam rychle zavést výzkum a praktické aplikace pro monitorování myšlenkového řetězce umělé inteligence. Pouze tak můžeme zajistit, že umělá inteligence bude sloužit „lidské prosperitě a štěstí“, jak nařizuje duch zákona o digitálním technologickém průmyslu.

Zdroj: https://dantri.com.vn/cong-nghe/giam-sat-chuoi-tu-duy-cua-tri-tue-nhan-tao-20250731151403739.htm

![[Foto] Prořezávání kopců, aby se uvolnil prostor pro lidi na silnici 14E, která postihla sesuvy půdy](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/11/08/1762599969318_ndo_br_thiet-ke-chua-co-ten-2025-11-08t154639923-png.webp)

![[Video] Památky v Hue se znovu otevírají, aby přivítaly návštěvníky](https://vphoto.vietnam.vn/thumb/402x226/vietnam/resource/IMAGE/2025/11/05/1762301089171_dung01-05-43-09still013-jpg.webp)

Komentář (0)