|

Künstliche Intelligenz ist noch nicht in der Lage, den Menschen im Bereich der Programmierung zu ersetzen. Foto: John McGuire . |

Führende KI-Modelle von OpenAI und Anthropic werden zunehmend für Programmieranwendungen eingesetzt. ChatGPT und Claude verfügen über mehr Speicher und Rechenleistung, um Hunderte von Codezeilen zu analysieren, während Gemini eine spezielle Canvas-Ergebnisanzeige für Programmierer integriert.

Im Oktober 2024 erklärte Sundar Pichai, CEO von Google, dass 25 % des neuen Codes im Unternehmen von KI generiert würden. Mark Zuckerberg, CEO von Meta, äußerte ebenfalls den Wunsch, KI-Codierungsmodelle flächendeckend im Konzern einzusetzen.

Eine neue Studie von Microsoft Research, der Forschungs- und Entwicklungsabteilung von Microsoft, zeigt jedoch, dass KI-Modelle, darunter Anthropics Claude 3.7 Sonnet und OpenAIs o3-mini, in einem Programmier-Benchmark namens SWE-bench Lite viele Fehler nicht bewältigen können.

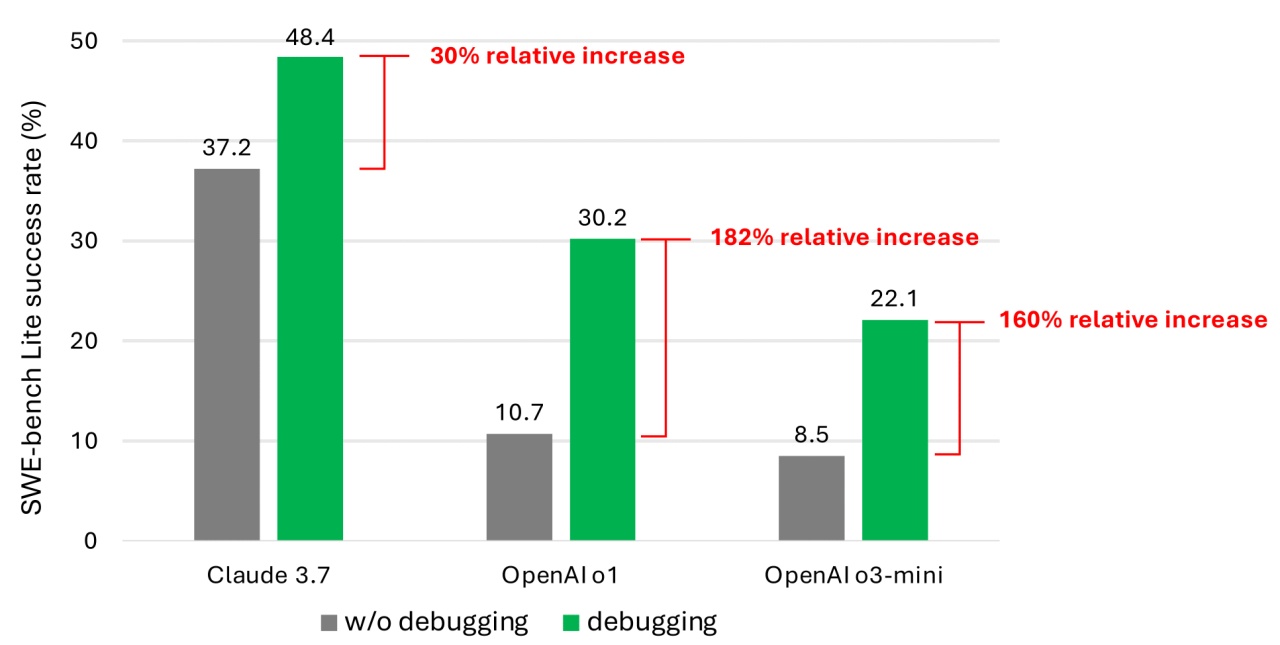

Die Autoren der Studie untersuchten neun verschiedene KI-Modelle, die diverse Debugging-Tools wie einen Python-Debugger integrierten und Probleme mit einer einzigen Anweisung lösen konnten. Die Modelle wurden beauftragt, 300 Softwarefehler aus dem SWE-bench Lite-Datensatz zu beheben.

|

Erfolgsquote bei der Lösung von Programmieraufgaben aus dem SWE-bench Lite-Datensatz. Bild: Microsoft. |

Selbst mit leistungsstärkeren und neueren Modellen zeigte sich, dass der KI-Agent selten mehr als die Hälfte der ihm zugewiesenen Debugging-Aufgaben erfolgreich bewältigte. Unter den getesteten Modellen erzielte Claude 3.7 Sonnet mit durchschnittlich 48,4 % die höchste Erfolgsquote, gefolgt von OpenAI o1 mit 30,2 % und o3-mini mit 22,1 %.

Zu den oben genannten Gründen für die geringe Leistungsfähigkeit gehört unter anderem, dass einige Modelle die bereitgestellten Debugging-Tools nicht anwenden können. Laut den Autoren liegt ein größeres Problem jedoch im Mangel an ausreichenden Daten.

Sie argumentieren, dass dem Trainingssystem für die Modelle noch immer Daten fehlen, die die Debugging-Schritte simulieren, die Menschen von Anfang bis Ende durchführen. Anders ausgedrückt: Die KI hat noch nicht genug darüber gelernt, wie Menschen Schritt für Schritt denken und handeln, wenn sie mit einem realen Softwarefehler zu tun haben.

Durch das Training und die Verfeinerung der Modelle werden sie im Debuggen von Software effizienter. „Dies erfordert jedoch spezielle Datensätze für den Trainingsprozess“, so die Autoren.

Zahlreiche Studien haben Sicherheitslücken und Fehler in KI-gestützter Codegenerierung aufgezeigt, die auf Schwächen wie ein begrenztes Verständnis von Programmlogik zurückzuführen sind. Eine aktuelle Überprüfung von Devin, einem KI-gestützten Programmierwerkzeug, ergab, dass es nur 3 von 20 Programmiertests erfolgreich absolvierte.

Die Programmierfähigkeiten von KI sind weiterhin Gegenstand vieler Debatten. Kevin Weil, Produktleiter von OpenAI, hatte zuvor die Vermutung geäußert, dass KI bis Ende dieses Jahres menschliche Programmierer übertreffen würde.

Bill Gates, Mitbegründer von Microsoft, ist hingegen überzeugt, dass Programmieren auch in Zukunft ein zukunftssicherer Beruf bleiben wird. Weitere Führungskräfte wie Amjad Masad (CEO von Replit), Todd McKinnon (CEO von Okta) und Arvind Krishna (CEO von IBM) unterstützen diese Ansicht ebenfalls.

Die Forschungsergebnisse von Microsoft sind zwar nicht neu, dienen aber als Mahnung an Programmierer, einschließlich Manager, sorgfältiger darüber nachzudenken, bevor sie die vollständige Codierungsbefugnis an KI abgeben.

Quelle: https://znews.vn/diem-yeu-chi-mang-cua-ai-post1545220.html

Kommentar (0)