Am 2. Februar erklärte Herr Nguyen Tien Dat, Generaldirektor des AntiMalware-Forschungszentrums bei Bkav, dass selbst wenn man einen Videoanruf tätigt und das Gesicht eines Verwandten oder Freundes sieht und seine Stimme hört, dies nicht unbedingt bedeutet, dass man mit dieser Person spricht.

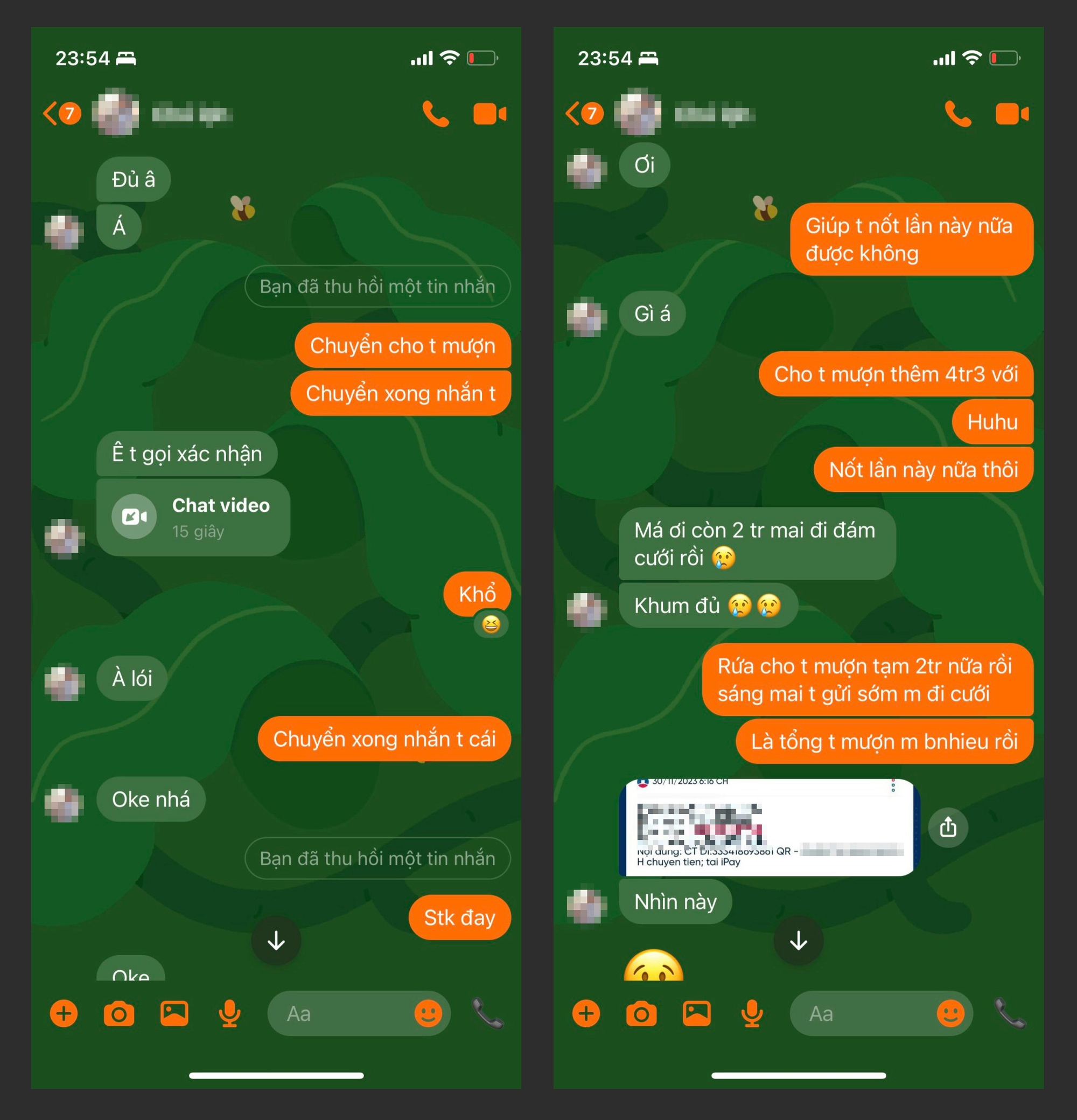

Nguyen Thanh Huong (Name geändert) ist Büroangestellte in Hanoi . Während eines Gesprächs mit einer Freundin über Facebook Messenger verabschiedete sich Huongs Freundin und beendete die Unterhaltung, meldete sich aber plötzlich zurück und bat um Geld, das auf ein Bankkonto überwiesen werden sollte.

Obwohl der Kontoname mit dem ihrer Freundin übereinstimmte, hegte Huong einen leichten Verdacht und bat um einen Videoanruf zur Überprüfung. Ihre Freundin willigte sofort ein, doch der Anruf dauerte aufgrund einer, wie sie erklärte, „instabilen Internetverbindung“ nur wenige Sekunden. Nachdem Huong das Gesicht ihrer Freundin im Videoanruf gesehen und die richtige Stimme gehört hatte, zweifelte sie nicht länger und überwies das Geld. Doch erst nach der erfolgreichen Überweisung wurde Huong klar, dass sie in eine Hackerfalle getappt war.

In letzter Zeit sind viele Menschen Opfer von Finanzbetrügereien geworden, bei denen Deepfake-Technologie und künstliche Intelligenz zum Einsatz kommen.

Huong war nicht das einzige Opfer; viele andere, darunter ihre Freunde und Verwandten, wurden ebenfalls auf ähnliche Weise betrogen. Die Betrüger erbeuteten durch diese Facebook-Konten Summen in zweistelliger Millionenhöhe (VND).

In der zweiten Jahreshälfte 2023 erhielt Bkav fortlaufend Meldungen und Hilferufe von Opfern ähnlicher Betrugsfälle. Laut Bkav-Experten erlangte der Täter im Fall von Huong zwar Zugriff auf ihr Facebook-Konto, übernahm aber nicht sofort die vollständige Kontrolle. Stattdessen überwachte er sie heimlich und wartete auf eine Gelegenheit, sich als das Opfer auszugeben und von ihren Freunden und Verwandten Kredite zu erbitten.

Sie nutzen KI, um ein gefälschtes Video zu erstellen, das Gesicht und Stimme des Facebook-Kontoinhabers imitiert (Deepfake). Wenn sie zu einem Videoanruf zur Verifizierung aufgefordert werden, stimmen sie dem Anruf zu, trennen die Verbindung aber schnell wieder, um nicht entdeckt zu werden.

Laut Nguyen Tien Dat vom AntiMalware-Forschungszentrum von Bkav ermöglicht die Erfassung und Analyse von Nutzerdaten mithilfe von KI die Entwicklung ausgefeilter Phishing-Strategien. Dies führt auch zu einer Zunahme der Komplexität von Phishing-Szenarien, die Deepfakes und GPT kombinieren, wodurch Phishing-Angriffe schwerer zu erkennen sind.

Bkav rät seinen Nutzern zu besonderer Vorsicht, keine persönlichen Informationen (Personalausweisnummer, Bankkontodaten, OTP-Codes usw.) preiszugeben und kein Geld an Fremde per Telefon, über soziale Medien oder über Webseiten mit betrügerischen Merkmalen zu überweisen.

Wenn Sie über soziale Medien Kredit- oder Geldtransferanfragen erhalten, ist es ratsam, alternative Verifizierungsmethoden wie Telefonanrufe oder andere Kommunikationskanäle zu nutzen, um die Angaben zu bestätigen.

Quelle: https://nld.com.vn/canh-bao-su-dung-ai-tao-hinh-anh-va-giong-noi-gia-mao-de-lua-tien-196240202191252818.htm

![[Foto] Premierminister Pham Minh Chinh nimmt an der Konferenz zur Umsetzung der Aufgaben des Industrie- und Handelssektors für das Jahr 2026 teil.](/_next/image?url=https%3A%2F%2Fvphoto.vietnam.vn%2Fthumb%2F1200x675%2Fvietnam%2Fresource%2FIMAGE%2F2025%2F12%2F19%2F1766159500458_ndo_br_shared31-jpg.webp&w=3840&q=75)

![[INFOGRAFIK] Legion Go Gen 2 setzt einen neuen Standard für Videospiele.](https://vphoto.vietnam.vn/thumb/402x226/vietnam/resource/IMAGE/2025/12/19/1766146888809_info-taycamgames-02-jpg.webp)

Kommentar (0)