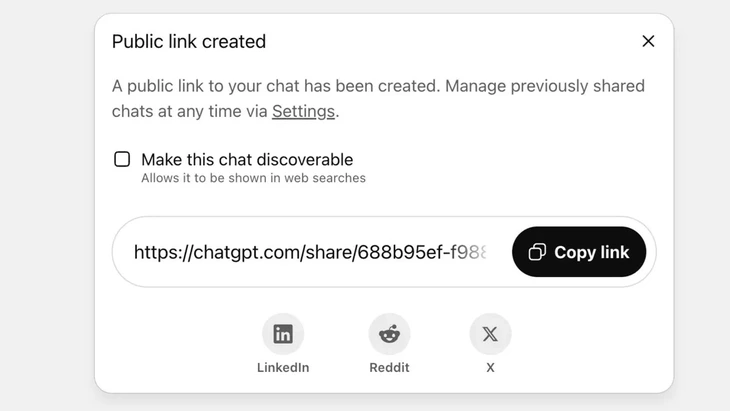

Δυνατότητα κοινοποίησης συνομιλιών μέσω δημόσιου συνδέσμου στο ChatGPT - Φωτογραφία: Techradar

Το ChatGPT πλέον λαμβάνει πάνω από 2,5 δισεκατομμύρια ερωτήματα από χρήστες παγκοσμίως κάθε μέρα, γεγονός που δείχνει την αυξανόμενη δημοτικότητα αυτού του chatbot.

Ωστόσο, αυτό το εργαλείο αντιμετωπίζει έντονες αντιδράσεις από τους χρήστες, καθώς η λειτουργία «κοινής χρήσης» έχει προκαλέσει διαρροή ευαίσθητων πληροφοριών από χιλιάδες συνομιλίες στην Google και σε ορισμένες μηχανές αναζήτησης στο Διαδίκτυο.

Υψηλός κίνδυνος ασφαλείας

Ο κ. Vu Ngoc Son - επικεφαλής του τμήματος τεχνολογίας της Εθνικής Ένωσης Κυβερνοασφάλειας (NCA) - εκτίμησε ότι το παραπάνω περιστατικό δείχνει υψηλό επίπεδο κινδύνου ασφαλείας για τους χρήστες του ChatGPT.

«Το παραπάνω περιστατικό δεν αποτελεί απαραίτητα τεχνικό ελάττωμα, καθώς υπάρχει μια συγκεκριμένη πρωτοβουλία του χρήστη κάνοντας κλικ στο κουμπί κοινής χρήσης. Ωστόσο, μπορεί να ειπωθεί ότι το πρόβλημα έγκειται στον σχεδιασμό του προϊόντος chatbot τεχνητής νοημοσύνης, όταν έχει μπερδέψει τους χρήστες και δεν υπάρχουν αρκετά ισχυρά μέτρα προειδοποίησης σχετικά με τον κίνδυνο διαρροής προσωπικών δεδομένων σε περίπτωση κοινής χρήσης από τους χρήστες», ανέλυσε ο κ. Vu Ngoc Son.

Στο ChatGPT, αυτή η λειτουργία εφαρμόζεται αφού ο χρήστης επιλέξει να μοιραστεί τη συνομιλία μέσω ενός δημόσιου συνδέσμου. Το περιεχόμενο θα αποθηκευτεί στον διακομιστή του OpenAI ως δημόσιος ιστότοπος (chatgpt.com/share/...), χωρίς να απαιτείται όνομα χρήστη ή κωδικός πρόσβασης για πρόσβαση.

Τα προγράμματα ανίχνευσης της Google σαρώνουν και καταχωρούν αυτόματα αυτές τις σελίδες, με αποτέλεσμα να εμφανίζονται στα αποτελέσματα αναζήτησης, συμπεριλαμβανομένου ευαίσθητου κειμένου, εικόνων ή δεδομένων συνομιλίας.

Πολλοί χρήστες δεν γνώριζαν τον κίνδυνο, νομίζοντας ότι κοινοποιούσαν τη συνομιλία σε φίλους ή επαφές. Αυτό οδήγησε στην αποκάλυψη χιλιάδων συνομιλιών, οι οποίες σε ορισμένες περιπτώσεις περιείχαν ευαίσθητα προσωπικά δεδομένα.

Παρόλο που η OpenAI αφαίρεσε γρήγορα αυτήν τη λειτουργία στα τέλη Ιουλίου 2025 μετά από αντιδράσεις της κοινότητας, χρειάστηκε χρόνος για να συντονιστεί με την Google για την αφαίρεση των παλιών ευρετηρίων. Ειδικά με το πολύπλοκο σύστημα αποθήκευσης, το οποίο περιλαμβάνει τους διακομιστές προσωρινής μνήμης της Google, αυτό δεν μπορεί να γίνει γρήγορα.

Μην αντιμετωπίζετε τα chatbots τεχνητής νοημοσύνης ως «μαύρο κουτί ασφαλείας»

Ο ειδικός σε θέματα ασφάλειας δεδομένων Vu Ngoc Son - επικεφαλής τεχνολογίας στην Εθνική Ένωση Κυβερνοασφάλειας (NCA) - Φωτογραφία: CHI HIEU

Η διαρροή χιλιάδων αρχείων καταγραφής συνομιλιών μπορεί να θέσει σε κίνδυνο τους χρήστες, όπως η αποκάλυψη προσωπικών και επιχειρηματικών μυστικών, η βλάβη στη φήμη, οι οικονομικοί κίνδυνοι ή ακόμη και οι κίνδυνοι για την ασφάλεια λόγω της αποκάλυψης οικιακών διευθύνσεων.

«Τα chatbot με δυνατότητα τεχνητής νοημοσύνης είναι χρήσιμα αλλά όχι «μαύρο κουτί», καθώς τα κοινόχρηστα δεδομένα μπορούν να υπάρχουν για πάντα στον ιστό αν δεν ελεγχθούν.»

Το παραπάνω περιστατικό αποτελεί σίγουρα ένα μάθημα τόσο για τους παρόχους όσο και για τους χρήστες. Άλλοι πάροχοι υπηρεσιών Τεχνητής Νοημοσύνης μπορούν να μάθουν από αυτήν την εμπειρία και να σχεδιάσουν χαρακτηριστικά με πιο σαφείς και διαφανείς προειδοποιήσεις.

Ταυτόχρονα, οι χρήστες πρέπει επίσης να περιορίσουν προληπτικά την ανεξέλεγκτη δημοσίευση στοιχείων ταυτοποίησης ή προσωπικών πληροφοριών σε πλατφόρμες τεχνητής νοημοσύνης», συνέστησε ο ειδικός σε θέματα ασφάλειας Vu Ngoc Son.

Σύμφωνα με τους ειδικούς στην ασφάλεια δεδομένων, το παραπάνω περιστατικό καταδεικνύει την ανάγκη για νομικούς διαδρόμους και πρότυπα κυβερνοασφάλειας για την Τεχνητή Νοημοσύνη. Οι προμηθευτές και οι προγραμματιστές Τεχνητής Νοημοσύνης πρέπει επίσης να σχεδιάσουν συστήματα που διασφαλίζουν την ασφάλεια, αποφεύγοντας τον κίνδυνο διαρροής δεδομένων, όπως: διαρροή μέσω κακών τρωτών σημείων, τρωτά σημεία λογισμικού που οδηγούν σε επιθέσεις σε βάσεις δεδομένων, κακός έλεγχος που οδηγεί σε δηλητηρίαση, κατάχρηση για την απάντηση ψευδών και διαστρεβλωμένων ερωτήσεων.

Οι χρήστες πρέπει επίσης να ελέγχουν την κοινοποίηση προσωπικών πληροφοριών με την Τεχνητή Νοημοσύνη και όχι την κοινοποίηση ευαίσθητων πληροφοριών. Σε περίπτωση πραγματικής ανάγκης, συνιστάται η χρήση της ανώνυμης λειτουργίας ή η ενεργή κρυπτογράφηση των πληροφοριών, ώστε να αποφεύγεται η άμεση σύνδεση των δεδομένων με συγκεκριμένα άτομα.

Πηγή: https://tuoitre.vn/hang-ngan-cuoc-tro-chuyen-voi-chatgpt-bi-lo-tren-google-nguoi-dung-luu-y-gi-20250805152646255.htm

![[Φωτογραφία] Ο Πρόεδρος της Εθνοσυνέλευσης, Τραν Ταν Μαν, δέχεται ξένους πρέσβεις που ήρθαν να τον αποχαιρετήσουν](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/10/30/1761820977744_ndo_br_1-jpg.webp)

![[Φωτογραφία] Ο Γενικός Γραμματέας Τό Λαμ συναντά τον πρώην Βρετανό πρωθυπουργό Τόνι Μπλερ](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/10/30/1761821573624_tbt-tl1-jpg.webp)

![[Φωτογραφία] Το Τρίτο Πατριωτικό Συνέδριο Μίμησης της Κεντρικής Επιτροπής Εσωτερικών Υποθέσεων](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/10/30/1761831176178_dh-thi-dua-yeu-nuoc-5076-2710-jpg.webp)

![[Φωτογραφία] Ο Γενικός Γραμματέας Το Λαμ παρευρίσκεται στη Διάσκεψη Υψηλού Επιπέδου για την Οικονομία Βιετνάμ-Ηνωμένο Βασίλειο](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/10/30/1761825773922_anh-1-3371-jpg.webp)

![[Φωτογραφία] Συγκινητική σκηνή χιλιάδων ανθρώπων που σώζουν το ανάχωμα από το ορμητικό νερό](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/10/30/1761825173837_ndo_br_ho-de-3-jpg.webp)

Σχόλιο (0)