|

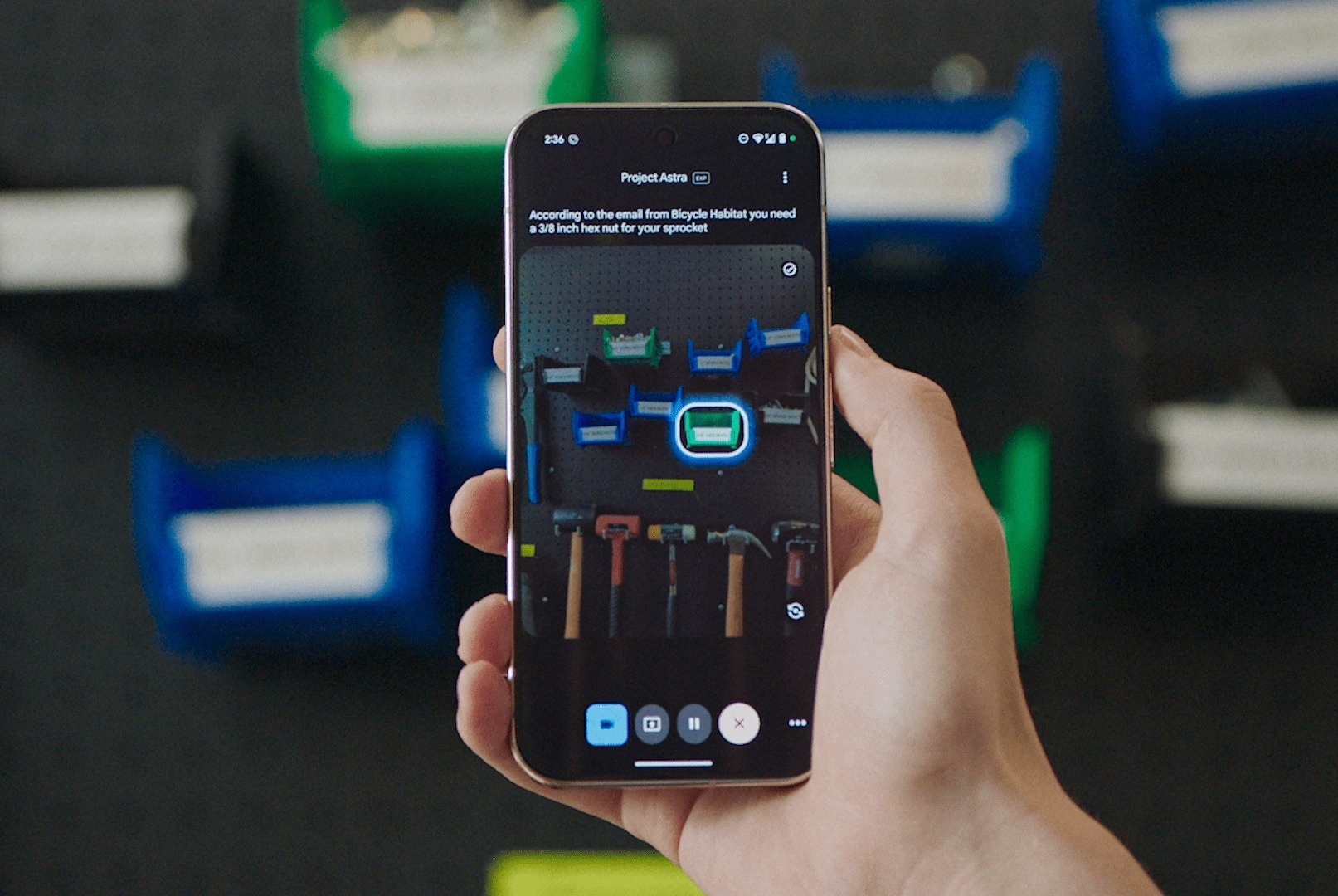

Interfaz interactiva del Proyecto Astra. Foto: Google . |

En el evento I/O 2025, celebrado la madrugada del 21 de mayo (hora de Vietnam), Google anunció varias novedades del Proyecto Astra. Lanzado por primera vez en 2024, el Proyecto Astra utiliza un modelo de IA multimodal para explotar y analizar imágenes e información visual en tiempo real. Esta es la gran ambición de Google: hacer que la IA sea más útil en la vida diaria.

Después de un período de prueba, algunas funciones del Proyecto Astra como la respuesta de voz, la memoria y los cálculos básicos aparecerán en las aplicaciones de Gemini y Google.

Durante el evento, Google mostró algunas de las maneras en que Astra puede ayudarte en la vida diaria. Además de responder preguntas y usar la cámara para recordar dónde te pusiste las gafas, Astra ahora puede completar tareas de forma proactiva sin que tengas que pedírselo.

«Astra puede elegir cuándo hablar según lo que ve. Observa constantemente y responde en consecuencia», afirmó Greg Wayne, investigador de DeepMind.

Según The Verge , esta función podría cambiar el funcionamiento de la IA. En lugar de esperar a que los usuarios apunten con sus cámaras y pidan ayuda, Astra puede monitorizar, escuchar y asistir automáticamente de forma continua si es necesario. Actualmente, Google se centra en el desarrollo de Astra para smartphones y gafas inteligentes.

Wayne da algunos ejemplos de cómo funciona Astra. Mientras se realizan las tareas, la herramienta puede supervisar y alertar inmediatamente a los usuarios cuando se detectan errores, en lugar de esperar a que el usuario termine y solicite una revisión.

Demis Hassabis, director ejecutivo de DeepMind, afirmó que entrenar a Astra para que ejecutara tareas por sí sola era una de las habilidades técnicas más complejas. Lo denominó "lectura de la situación", ya que la IA necesitaba determinar cuándo ayudar, cómo hacerlo y cuándo no. Estas acciones las realizamos bastante bien los humanos, pero son difíciles de cuantificar y estudiar.

La próxima actualización de Astra consiste en extraer información de los usuarios en la web y en los productos de Google. Según The Verge , la herramienta puede conocer el horario para notificar cuándo salir de casa, leer el contenido de los correos electrónicos para extraer números de teléfono al registrarse en hoteles…

|

Función de resaltado del Proyecto Astra, que ayuda a escanear objetos y comparar información extraída en otras aplicaciones. Foto: Google . |

La última pieza del rompecabezas de Astra es su capacidad para aprender a usar un teléfono Android. Durante la demostración en el evento, Bibo Xiu, representante de la división de productos de DeepMind, apuntó la cámara del teléfono a unos auriculares Sony y le pidió a Astra que identificara el modelo.

Después de que Astra respondiera que los auriculares podían ser Sony WH-1000XM4 o WH-1000XM3, Xiu siguió pidiendo a la herramienta que buscara el manual de usuario y luego explicó cómo conectarlos al teléfono. Tras las instrucciones de Astra, Xiu lo interrumpió y le pidió al chatbot que se conectara por él. Astra inmediatamente abrió la configuración y lo hizo él mismo.

El proceso no fue del todo fluido, ya que Xiu tuvo que permitir que Astra supervisara la pantalla del teléfono. En el futuro, Google aspira a que el chatbot pueda supervisar las pantallas automáticamente.

En otro video de Google, una persona le pide a Astra que busque el manual de una bicicleta Huffy y luego navegue a una página específica con instrucciones para reparar una pieza. Astra incluso puede encontrar un video de YouTube sobre cómo quitar un tornillo desgastado y luego contactar con la tienda más cercana para encontrar una pieza de repuesto. Todo sucede a la perfección en la demostración.

Aunque Astra no se ha lanzado ampliamente, Google dijo que la función de análisis de imágenes Gemini Live se lanzará para todos los usuarios de iOS (anteriormente solo era compatible con Android).

En el futuro, la inteligencia artificial de Google no solo actuará según órdenes, sino que Astra ayudará a "entender qué se puede y qué no se puede ver en este momento", dijo Xiu.

Fuente: https://znews.vn/ai-cua-google-ngay-cang-thong-minh-post1554615.html

![[Noticias Marítimas] Más del 80% de la capacidad mundial de transporte de contenedores está en manos de MSC y las principales alianzas navieras.](https://vphoto.vietnam.vn/thumb/402x226/vietnam/resource/IMAGE/2025/7/16/6b4d586c984b4cbf8c5680352b9eaeb0)

Kommentar (0)