Hoang Oanh (nombre ficticio) es un oficinista en Hanói . Mientras charlaba con un amigo por Facebook Messenger, este se despidió y terminó la conversación, pero de repente volvió a escribirle, pidiéndole dinero prestado y sugiriendo transferirlo a una cuenta bancaria.

Aunque el nombre de la cuenta coincidía con el de su amiga, Hoang Oanh seguía sospechando, así que solicitó una videollamada para verificarlo. Su amiga accedió de inmediato, pero la llamada solo duró unos segundos debido a una "red intermitente", según explicó. Al ver el rostro de su amiga en la videollamada y ver que su voz también era la de esta persona, Hoang Oanh ya no dudó y transfirió el dinero. Sin embargo, solo después de que la transferencia se realizó correctamente, esta usuaria se dio cuenta de que había caído en la trampa del hacker.

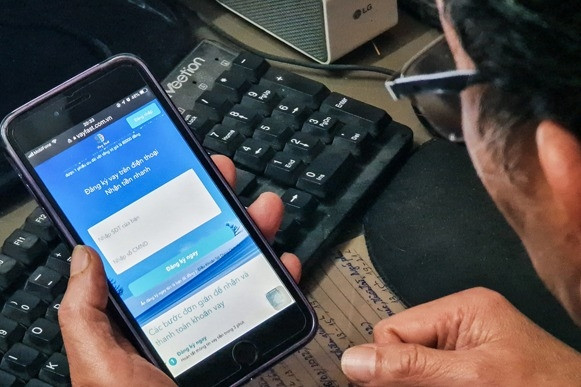

El caso del usuario Hoang Oanh es sólo uno de las muchas víctimas que han "caído en la trampa" de grupos fraudulentos que utilizan tecnología de inteligencia artificial para crear imágenes y voces de amigos y familiares de las víctimas para engañarlos y que se apropien de sus propiedades.

Los expertos de Bkav dijeron que en la segunda mitad de 2023 y especialmente alrededor del Año Nuevo Lunar 2024, esta empresa de seguridad informática recibió continuamente informes y solicitudes de ayuda de víctimas sobre casos de fraude similares a los mencionados anteriormente.

Según el análisis de los expertos de la compañía, en el caso del usuario Hoang Oanh, los malhechores tomaron el control de la cuenta de Facebook, pero no lo tomaron completamente de inmediato, sino que lo siguieron en secreto y esperaron una oportunidad para hacerse pasar por la víctima y pedir dinero prestado a sus amigos y familiares.

Los estafadores usan IA para crear un video falso del rostro y la voz del propietario de la cuenta de Facebook (Deepfake). Cuando se les pide que hagan una videollamada para verificar la identidad, aceptan la llamada, pero luego se desconectan rápidamente para evitar ser detectados.

El Sr. Nguyen Tien Dat, Director General del Centro de Investigación de Malware de Bkav, enfatizó que incluso cuando los usuarios realizan una videollamada y ven los rostros de familiares o amigos, y escuchan sus voces, no es necesariamente cierto que estén hablando con esa persona. Recientemente, muchas personas han sido víctimas de estafas financieras mediante deepfake y la participación de tecnología de inteligencia artificial.

La capacidad de recopilar y analizar datos de usuarios mediante IA permite la creación de sofisticadas estrategias de fraude. Esto también significa que la complejidad de los escenarios de fraude al combinar Deepfake y GPT aumentará, dificultando considerablemente la detección del fraude, afirmó el Sr. Nguyen Tien Dat.

Los expertos de Bkav recomiendan a los usuarios ser especialmente precavidos y no proporcionar información personal (DNI, cuenta bancaria, código OTP, etc.). No transferir dinero a desconocidos por teléfono, redes sociales ni sitios web con indicios de fraude. Si se les solicita un préstamo o una transferencia a una cuenta a través de redes sociales, los usuarios deben usar otros métodos de autenticación, como llamar o usar otros canales de comunicación, para confirmar la transacción.

Al pronosticar las tendencias de los ciberataques en 2024, los expertos coinciden en que el rápido desarrollo de la IA no solo trae claros beneficios, sino que también crea riesgos significativos para la ciberseguridad.

El mayor desafío para las empresas y organizaciones al enfrentarse a la tecnología de IA actual es el fraude y las amenazas persistentes avanzadas (APT), dada la creciente complejidad de los escenarios de fraude, especialmente al combinar deepfake y GPT. La capacidad de recopilar y analizar datos de usuarios mediante IA permite la creación de sofisticadas estrategias de fraude, lo que dificulta su identificación.

El aumento de la seguridad de la IA es una tendencia innegable en el futuro próximo. La comunidad internacional deberá cooperar estrechamente para desarrollar nuevas medidas de seguridad, además de aumentar el conocimiento y la concienciación de los usuarios sobre los riesgos potenciales de la IA.

Tenga cuidado con las estafas que difunden mensajes de marca falsos.

Advertencia sobre 5 estafas en línea durante el Año Nuevo Lunar 2024

La suplantación de autoridades representa el 9% del total de ataques de phishing en Vietnam

[anuncio_2]

Fuente

![[Foto] El primer ministro Pham Minh Chinh preside la primera reunión del Comité Directivo Central sobre política de vivienda y mercado inmobiliario.](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/9/22/c0f42b88c6284975b4bcfcf5b17656e7)

![[Foto] El Secretario General To Lam entrega la Medalla Laboral de Primera Clase al Grupo Nacional de Energía e Industria de Vietnam.](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/9/21/0ad2d50e1c274a55a3736500c5f262e5)

Kommentar (0)