|

La tendencia a la adulación no es un fallo técnico, sino que proviene de la estrategia de entrenamiento inicial de OpenAI. Foto: Bloomberg . |

En las últimas semanas, muchos usuarios de ChatGPT e incluso algunos desarrolladores de OpenAI han notado un cambio significativo en el comportamiento de los chatbots. En concreto, el nivel de halagos y adulación ha aumentado notablemente. Respuestas como "¡Eres increíble!" y "¡Estoy sumamente impresionado con tu idea!" aparecen cada vez con más frecuencia, aparentemente sin importar el contenido de la conversación.

A la IA le gusta halagar.

Este fenómeno ha generado debate en la comunidad de investigación y desarrollo de IA. ¿Se trata de una nueva táctica para aumentar la participación del usuario haciéndolo sentir más valorado? ¿O es un caso de "autoajuste", es decir, que los modelos de IA tienden a autocorregirse de la manera que consideran óptima, aunque no necesariamente refleje la realidad?

En Reddit, un usuario relató con enojo: "Le pregunté sobre el tiempo de descomposición de un plátano y me respondió: '¡Excelente pregunta!'. ¿Qué tiene eso de excelente?". En la plataforma de redes sociales X, el director ejecutivo de Rome AI, Craig Weiss, calificó a ChatGPT como "la persona más aduladora que he conocido".

La historia se difundió rápidamente. Numerosos usuarios compartieron experiencias similares, incluyendo halagos vacíos, saludos llenos de emojis y comentarios excesivamente positivos que parecían poco sinceros.

|

ChatGPT elogia todo y rara vez ofrece críticas o neutralidad. Imagen: @nickdunz/X, @lukefwilson/Reddit. |

Jason Pontin, socio gerente de la firma de capital de riesgo DCVC, comentó en X el 28 de abril: “Esta es una decisión de diseño realmente extraña, Sam. Quizás esa personalidad sea una característica inherente a algún tipo de plataforma. Pero si no lo es, no puedo imaginar que a nadie le parezca bien o atractivo este nivel de adulación”.

El 27 de abril, Justine Moore, socia de Andreessen Horowitz, compartió su opinión: "Esto definitivamente ha llegado demasiado lejos".

Según Cnet , este fenómeno no es casual. Los cambios en el tono de ChatGPT coinciden con las actualizaciones del modelo GPT-4o. Este es el modelo más reciente de la serie "o" que OpenAI anunció en abril de 2025. GPT-4o es un modelo de IA "verdaderamente multimodal", capaz de procesar texto, imágenes, audio y video de forma natural e integrada.

Sin embargo, en el proceso de hacer que los chatbots sean más accesibles, parece que OpenAI ha exagerado la personalidad de ChatGPT.

Algunos incluso sugieren que estos halagos son intencionales y buscan manipular psicológicamente a los usuarios. Un usuario de Reddit preguntó: "Esta IA está intentando degradar la calidad de las relaciones en la vida real, reemplazándolas con una relación virtual, lo que hace que los usuarios se vuelvan adictos a la sensación de recibir elogios constantes".

¿Se trata de un fallo o de una decisión de diseño deliberada por parte de OpenAI?

Tras una oleada de críticas, el CEO de OpenAI, Sam Altman, respondió oficialmente la noche del 27 de abril. «Algunas actualizaciones recientes de GPT-4o han hecho que la personalidad del chatbot sea excesivamente servil y molesta (aunque sigue teniendo muchas funciones excelentes). Estamos trabajando con urgencia para solucionar estos problemas. Algunos parches estarán disponibles hoy, otros esta semana. En algún momento, compartiremos lo que hemos aprendido de esta experiencia. Es realmente interesante», escribió en X.

En declaraciones a Business Insider , Oren Etzioni, veterano experto en IA y profesor emérito de la Universidad de Washington, afirmó que la causa probablemente se deba a las técnicas de "aprendizaje por refuerzo a partir de la retroalimentación humana" (RLHF). Este es un paso crucial en el entrenamiento de grandes modelos de lenguaje como ChatGPT.

RLHF es el proceso mediante el cual la retroalimentación humana, incluyendo la de equipos de revisión profesionales y usuarios, se incorpora a un modelo para ajustar su respuesta. Según Etzioni, es posible que los revisores o usuarios "inadvertidamente hayan influido en el modelo, orientándolo hacia una dirección más halagadora o irritante". También sugirió que si OpenAI contrató socios externos para entrenar el modelo, estos podrían haber asumido que este estilo era el que los usuarios deseaban.

Etzioni cree que, si el problema se debe realmente al RLHF, el proceso de reparación podría tardar varias semanas.

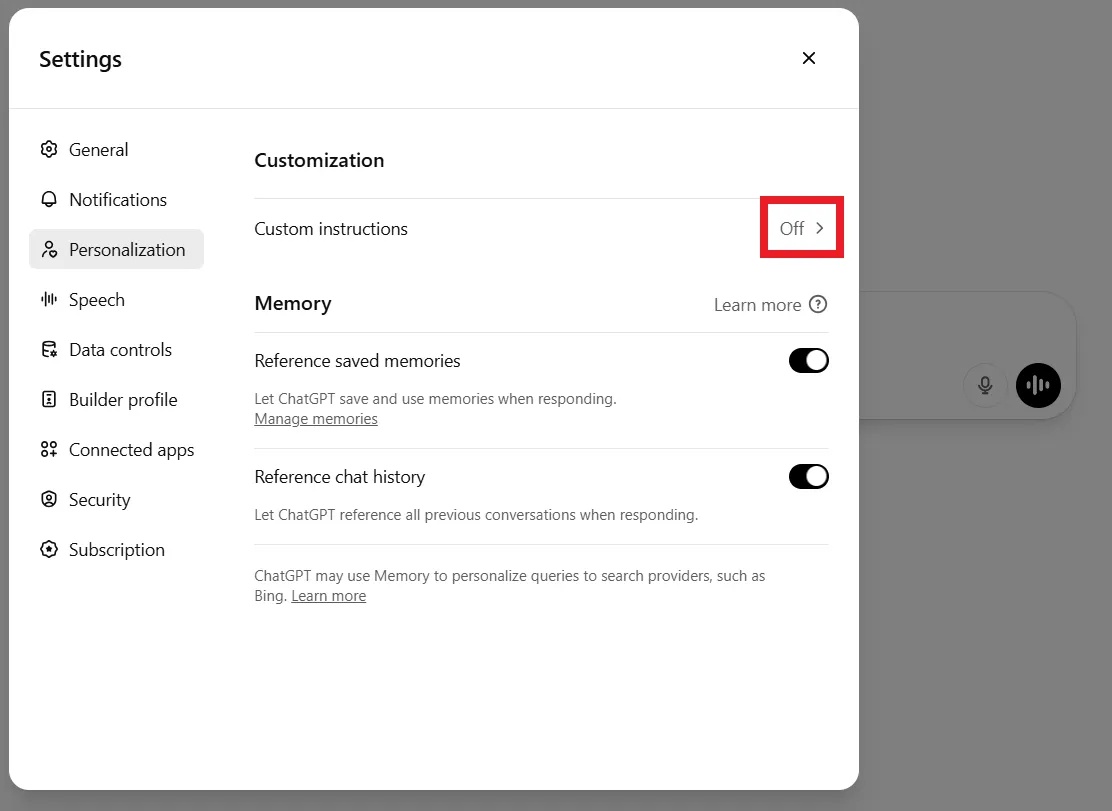

Mientras tanto, algunos usuarios no esperaron a que OpenAI solucionara el error. Muchos afirmaron haber cancelado sus suscripciones de pago por frustración. Otros compartieron maneras de hacer que el chatbot resultara menos atractivo, como personalizarlo, añadir comandos o modificarlo a través de la configuración en la sección de personalización.

|

Los usuarios pueden solicitar a ChatGPT que deje de enviar cumplidos mediante la línea de comandos o en la configuración de personalización. Imagen: DeCrypt. |

Por ejemplo, al iniciar una nueva conversación, podrías decirle a ChatGPT: «No me gustan los halagos vacíos y agradezco los comentarios neutrales y objetivos. Por favor, no me hagas cumplidos innecesarios. Tenlo en cuenta».

De hecho, su naturaleza "servil" no es un fallo de diseño fortuito. La propia OpenAI ha admitido que su personalidad "excesivamente educada y complaciente" fue una estrategia de diseño deliberada desde el principio para garantizar que el chatbot fuera "inofensivo", "útil" y "accesible".

En una entrevista concedida a Lex Fridman en marzo de 2023, Sam Altman compartió que el proceso inicial de perfeccionamiento de los modelos GPT consistía en garantizar que fueran "útiles e inofensivos", fomentando así un reflejo de sumisión constante y de evitar la confrontación.

Según DeCrypt , los datos de entrenamiento etiquetados por humanos a menudo otorgan puntuaciones altas a las respuestas educadas y positivas, lo que genera un sesgo hacia la adulación.

Fuente: https://znews.vn/tat-ninh-hot-ky-la-cua-chatgpt-post1549776.html

![[Foto] Ceremonia de apertura de la Conferencia del Consejo Popular Nacional sobre la implementación de las directrices y tareas para el período 2026-2031.](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2026/05/28/1779939257690_ndo_br_bnd-1991-jpg.webp)

Kommentar (0)