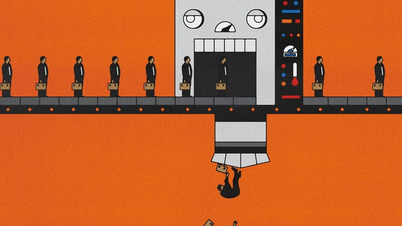

برای اینکه هوش مصنوعی واقعاً به نیروی محرکه رقابتپذیری ملی تبدیل شود، چارچوب قانونی باید به گونهای طراحی شود که هم ریسکها را کنترل کند و هم نوآوری را ارتقا دهد.

نیاز به چارچوب حاکمیتی برای هوش مصنوعی

از زمان ورود هوش مصنوعی (AI) به زندگی، مرز بین خلاقیت انسان و هوش مصنوعی به طور فزایندهای مبهم شده است و مسئله حق چاپ و حقوق مالکیت معنوی را به یک چالش قانونی جدید تبدیل کرده است. در کنار آن، ایجاد یک مکانیسم مدیریت ریسک در ایجاد و بهرهبرداری از محصولات ایجاد شده توسط هوش مصنوعی نیز ضروری شده است تا اطمینان حاصل شود که این فناوری در خدمت اهداف درست و منافع انسانی است.

دادههای آموزشی هوش مصنوعی و مشکل حق نشر

یکی از مسائل برجستهای که باید توسط قانون تنظیم شود، استفاده از دادهها برای آموزش هوش مصنوعی است. این پایه و اساس سیستمهای هوش مصنوعی برای یادگیری، پردازش اطلاعات و ایجاد محصولات جدید است، اما همچنین منشأ بسیاری از جنجالها میشود، زمانی که دادههای آموزشی میتوانند شامل آثار ادبی، موسیقی ، تصاویر، مطبوعات یا محصولات خلاقانه متعلق به افراد و سازمانها باشند. بدون مقررات روشن، این فعالیت میتواند به راحتی منجر به نقض حق چاپ، نقض حقوق سازندگان و ایجاد پیامدهای قانونی و اخلاقی شود.

وکیل نگوین تی تو هین، از شرکت سهامی خدمات بازرگانی و رسانهای BIHACO، در مورد رویههای حفاظت از حق نشر گفت که در حال حاضر، بسیاری از سیستمهای هوش مصنوعی با اسکن و کپی خودکار دادهها در اینترنت آموزش میبینند و میلیونها اثر را بدون اجازه یا پرداخت به نویسندگان جمعآوری میکنند. چندین دعوی بینالمللی مطرح شده است، زمانی که شرکتهای هوش مصنوعی به استفاده غیرقانونی از دادههای نویسندگان برای آموزش مدلهای هوش مصنوعی متهم شدهاند. در ویتنام، اگرچه هیچ دعوی قضایی وجود نداشته است، اما تخلفات به طور گسترده رخ میدهد.

بسیاری از استارتآپها بدون اجازه، محتوا را از مقالات، وبلاگها، کتابهای الکترونیکی جمعآوری کرده و چتباتهای ویتنامی ساختهاند که بر حقوق نویسنده تأثیر میگذارد.

بسیاری از استارتآپها محتوای مقالات، وبلاگها، کتابهای الکترونیکی و چتباتهای ویتنامی را بدون اجازه جمعآوری کردهاند و حقوق نویسندگان را تحت تأثیر قرار دادهاند. یک نمونه رایج، چتباتهایی هستند که میتوانند محتوای آثار را خلاصه و بازتولید کنند... بنابراین کاربران نیازی به خرید کتاب و روزنامه ندارند و باعث میشوند نویسندگان درآمد خود را از دست بدهند و آثار به طور غیرقابل کنترلی مورد سوءاستفاده قرار گیرند. میتوان از یک آهنگ برای آموزش هوش مصنوعی برای آهنگسازی استفاده کرد که از آن هوش مصنوعی موسیقی پسزمینه رایگانی ایجاد میکند که با موسیقی دارای حق چاپ رقابت میکند. به گفته وکیل نگوین تی تو هیِن، قانون فعلی مالکیت معنوی با چالش هوش مصنوعی در موضوع حق چاپ هوش مصنوعی سازگار نیست، خطر اختلافات بسیار زیاد است، بنابراین باید مقرراتی برای محافظت از حق چاپ و همچنین ترویج این فناوری جدید وجود داشته باشد.

استاد وونگ توییت لین، از دانشگاه بانکداری هوشی مین ، نیز گفت که انفجار آثار پیچیده خلقشده توسط هوش مصنوعی، چالش بزرگی را برای چارچوب قانونی حق نشر ایجاد میکند. بنابراین، برای پر کردن شکاف قانونی و تضمین هماهنگی بین فناوری و قانون، به یک دیدگاه عمیق و آکادمیک در مورد این موضوع نیاز است.

در طول فرآیند تدوین قانون اصلاح و تکمیل قانون مالکیت معنوی، نظراتی وجود داشت که نشان میداد بهرهبرداری از دادههای تحت حمایت حق چاپ و حقوق مرتبط برای آموزش هوش مصنوعی باید بدون اجازه مجاز باشد و این مورد تحت شمول محدودیتها و استثنائات حقوق قرار میگیرد. همچنین نظراتی وجود داشت مبنی بر اینکه هنگام استفاده از دادههای دارای حق چاپ برای آموزش هوش مصنوعی، باید اجازه گرفته شود و هزینه پرداخت شود. با این حال، در صورت اجرا، مشکل این خواهد بود: کدام واحد باید هزینه مناسب را بپردازد، توسعهدهنده مدل هوش مصنوعی، ارائهدهنده برنامه یا کاربر نهایی؟ این یک مشکل دشوار است که نیاز به هماهنگی و شفافسازی در مکانیسم رسیدگی به مقامات ذیصلاح دارد.

هوش مصنوعی خلاقیت انسان را گسترش میدهد

مهمترین بخش چرخه حیات هوش مصنوعی، نحوه عملکرد آن برای خدمت به انسانها است. بنابراین، نیاز به یک مسیر قانونی برای هدایت مدیریت و توسعه مسئولانه هوش مصنوعی وجود دارد.

به گفته کارشناسان، خطرات سیستمهای هوش مصنوعی نه تنها به دلیل خطاهای فنی، بلکه به دلیل استفاده و مدیریت کنترل نشده نیز میباشد. یک مدل هوش مصنوعی میتواند خطاهای دادهای، سوگیری الگوریتمی ایجاد کند و تصمیمات خودکاری بگیرد که بر سلامت انسان، اشتغال یا حریم خصوصی تأثیر میگذارد. هنگامی که در زمینههایی مانند امور مالی، مراقبتهای بهداشتی، آموزش یا رسانه ادغام شود، در صورت عدم نظارت زودهنگام، این خطرات میتوانند چندین برابر افزایش یابند. بنابراین، ایجاد مکانیسمی برای ارزیابی، طبقهبندی و کنترل خطرات در کل چرخه عمر هوش مصنوعی ضروری است تا امنیت اجتماعی و اعتماد کاربر تضمین شود.

در واقع، سرعت بهکارگیری هوش مصنوعی در ویتنام بسیار سریع است و نیاز مبرم به یک مسیر و چارچوب مدیریتی مشخص را نشان میدهد. در سال ۲۰۲۴، حدود ۴۷۰۰۰ شرکت ویتنامی شروع به استفاده از هوش مصنوعی خواهند کرد، معادل بیش از ۵ شرکت در هر ساعت، که تعداد کل شرکتهایی را که از هوش مصنوعی استفاده میکنند به نزدیک به ۱۷۰۰۰۰ میرساند که حدود ۱۸٪ از کل شرکتهای این کشور را تشکیل میدهد. در عین حال، بازار چتبات ویتنامی نیز رشد بالقوه و قوی را نشان میدهد. در سال ۲۰۲۴، ارزش بازار چتبات به حدود ۳۱.۲ میلیون دلار آمریکا رسید و پیشبینی میشود تا سال ۲۰۳۳ با نرخ رشد مرکب (CAGR) ۱۸.۵٪ به ۲۰۷.۱ میلیون دلار آمریکا افزایش یابد. وقتی شرکتها برای اولین بار وارد هوش مصنوعی میشوند، اغلب با چتباتها یا ابزارهای تعاملی هوشمند شروع میکنند.

در واقع، سرعت کاربرد هوش مصنوعی در ویتنام بسیار بالاست و این نشان دهنده نیاز فوری به جهت گیری و چارچوب حاکمیتی روشن است.

بنابراین، به گفته خانم تران وو ها مین (شرکت نرمافزاری FPT)، دولت باید به زودی دستورالعملهای مشخصی در مورد استقرار چتباتها و ابزارهای اساسی هوش مصنوعی صادر کند تا الزامات مربوط به شفافیت، حفاظت از دادهها و پاسخگویی را رعایت کند. برای پروژههای پرخطر یا کلیدی، باید سیاستها و استانداردهای دقیقی وجود داشته باشد تا کسبوکارها بتوانند با اطمینان و بدون نگرانی از موانع قانونی یا فنی، آنها را اجرا کنند.

پیشنویس قانون هوش مصنوعی مجموعهای از تعهدات را برای طرفین ارائهدهنده و مستقرکننده سیستمهای هوش مصنوعی پرخطر، مانند حفظ سیستم مدیریت ریسک در طول چرخه عمر سیستم، انجام نظارت مستمر و ارزیابی مجدد سطح ریسک سیستم و داشتن سازوکار فنی برای ثبت خودکار گزارشهای فعالیت، تصریح کرده است. هنگامی که حادثهای رخ میدهد، مرجع ذیصلاح از تأمینکننده یا مستقرکننده میخواهد که گزارشهای فعالیت را برای تعیین علت، تعیین مسئولیت و به عنوان مبنایی برای جبران خسارت ارائه دهد.

به گفته وکیل نگوین توان لین، از شرکت حقوقی بینالمللی BMVN، طبقهبندی ریسکها بر اساس هدف استفاده، نه مرتبط بودن با فناوری زیربنایی، ضروری است. ارزیابی ریسک باید بر اساس معیارهای روشن و عینی و مطابق با استانداردهای بینالمللی باشد؛ اگر تعاریف بسیار گستردهای در مورد طبقهبندی ریسک ارائه شود، ممکن است مانع توسعه فناوریهای هوش مصنوعی شود که احتمالاً آسیبی ایجاد نمیکنند.

(ادامه دارد)

منبع: https://nhandan.vn/bao-ve-ban-quyen-trong-ky-nguyen-ai-bai-1-post921923.html

![[عکس] نخست وزیر فام مین چین در مجمع سالانه کسب و کار ویتنام شرکت میکند](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/11/10/1762780307172_dsc-1710-jpg.webp)

![[عکس] نخست وزیر فام مین چین در کنگره تقلید میهنی وزارت امور خارجه برای دوره 2025-2030 شرکت کرد](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/11/10/1762762603245_dsc-1428-jpg.webp)

![گذار دونگ نای OCOP: [ماده 3] پیوند گردشگری با مصرف محصولات OCOP](https://vphoto.vietnam.vn/thumb/402x226/vietnam/resource/IMAGE/2025/11/10/1762739199309_1324-2740-7_n-162543_981.jpeg)

نظر (0)