در زیر نظرات دو متخصص از دانشگاه RMIT در مورد اثرات مضر دیپفیک و راهحلهای پیشنهادی برای این مشکل آمده است:

|

| دکتر جاناتان کرلین (چپ) و دکتر نگوین ون تانگ لانگ (راست). (منبع: دانشگاه RMIT) |

مجرمان سایبری از فناوریهای جدید به روشهای پیشبینی نشده سوءاستفاده میکنند

دکتر جاناتان کرلین، رئیس امنیت اطلاعات، دانشکده علوم ، مهندسی و فناوری، دانشگاه RMIT :

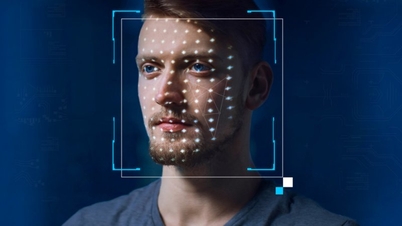

دیپفیک (Deepfake) یک تصویر تولید شده توسط ماشین است که میتواند تصاویر یا ویدیوها را از منابع مختلف با هم ترکیب کند و یک تصویر، ویدیو یا حتی صدای بسیار واقعگرایانه ایجاد کند.

دیپفیک به تکنیکی در هوش مصنوعی به نام یادگیری ماشینی متکی است که میتواند عناصری مانند چهره یک فرد را در تصویر یا ویدیوی دیگری جایگزین و ادغام کند.

یکی از نمونههای استفاده از دیپفیک، ترکیب محتوای مستهجن با عکسهای تیلور سویفت برای ایجاد تصاویر جعلی است.

برای انجام این کار، مغز متفکر به تعدادی تصویر نیاز داشت تا نرم افزار بتواند از حالات چهره خواننده زن مطلع شود، سپس با ترکیب آنها با محتوای پورنوگرافی، عکس های مستهجن بسازد و باعث شود وجهه خواننده زن خدشه دار شود.

در واقع، شایعه شده است که این عکسها توسط یک گروه تلگرامی منتشر شده و با استفاده از ابزار Microsoft Designer با پشتیبانی یکپارچه از هوش مصنوعی ایجاد شدهاند.

هر کسی میتواند قربانی شود، زیرا افراد شرور فقط به یک عکس، ویدیو یا ضبط صدا از شخصی که هویتش جعل شده نیاز دارند.

اخبار جعلی در اشکال مختلف، پتانسیل استفاده برای ایجاد اخبار نادرست را دارند و میتوان با اطمینان گفت که انتخابات ریاست جمهوری آینده ایالات متحده مملو از چنین اخبار جعلی خواهد بود.

در حال حاضر، قانونگذاران در سراسر جهان به دنبال تصویب قوانینی علیه این نوع تصاویر هستند.

در ایالات متحده، رویکردهای مختلفی در زمینه قانونگذاری در حال اتخاذ هستند، مانند تکیه بر دعاوی مدنی یا قوانینی برای رسیدگی به «انتشار تصاویر صریح جنسی از یک فرد که توسط هوش مصنوعی و بدون رضایت آن شخص تولید شده است».

چین همچنین مقررات جدیدی وضع کرده است که به موجب آن، افرادی که تصاویر تولید شده توسط هوش مصنوعی را منتشر میکنند، تحت پیگرد قانونی قرار میگیرند.

بریتانیا طبق قانون ایمنی آنلاین خود، اشتراکگذاری محتوای دیپفیک را غیرقانونی اعلام کرده است.

چگونه میتوان این را تشخیص داد یا از آن جلوگیری کرد؟

اولین قدم این است که تعداد عکسها، ویدیوها یا فایلهای صوتی آنلاین خود را کاهش دهید. مطمئن شوید که آنها را فقط با افرادی که میشناسید به اشتراک میگذارید، نه اینکه آنها را به طور گسترده در اینترنت منتشر کنید. وقتی چیزی در اینترنت قرار میگیرد، حذف آن تقریباً غیرممکن است.

راه دوم این است که با خانوادهتان روی یک کلمه مخفی برای تأیید تماس توافق کنید و خطر افتادن در دام تماس جعلی را کاهش دهید.

تصاویر، به خصوص ویدیوها، میتوانند خطاهای عجیب (ظاهری صحنهای) داشته باشند، اگر این خطاها را مشاهده کردید، احتمال زیادی وجود دارد که تصویر یا صدا جعلی باشد.

تکنیک دیگری که میتوان استفاده کرد، جستجوی «تصویر معکوس» در گوگل یا سایر موتورهای جستجو برای تعیین منبع تصویر اصلی است.

درس آخر این است که کورکورانه آنچه را که میبینید باور نکنید، دوربین (یا هوش مصنوعی) میتواند دروغ بگوید!

دیپ فیک تهدید بزرگی برای سلبریتیها و سیاستمداران است

دکتر نگوین ون تانگ لانگ، مدرس ارشد، دانشکده ارتباطات و طراحی، دانشگاه RMIT :

با گسترش اخبار جعلی ناشی از دیپفیک، تیمهای رسانهای افراد مشهور و سیاستمداران باید منابعی در دسترس داشته باشند تا اخبار جعلی را رصد و به سرعت به آنها پاسخ دهند یا به طور مداوم اخبار نادرست را اصلاح کنند.

اگر دیپفیکها به طور سیستماتیک با اشکال سازمانیافتهای از «روابط عمومی کثیف» ترکیب شوند، این کار به دلیل تکثیر اطلاعات متناقض، دشوارتر هم میشود و اخبار جعلی و منفی همیشه بیشتر از اخبار مثبت به اشتراک گذاشته میشوند.

معمولاً افراد هنگام مشاهده اخبار به اشتراک گذاشته شده در شبکههای اجتماعی، عادت دارند اطلاعات را از طریق کانالهای رسمی رسانهای تأیید کنند.

با هجوم محتوای جعلی عمیق به رسانههای اجتماعی، تأیید صحت اخبار جریان اصلی به طور فزایندهای دشوار و زمانبر است و نیاز به تحقیقات عمیق و تکنیکهای تأیید دارد.

هر چه بیشتر در تأیید اخبار و منابع تأخیر کنیم، به دلیل سرعت بالای اشتراکگذاری و اظهار نظر در رسانههای اجتماعی، احتمال انتشار اطلاعات نادرست، ساختگی یا گمراهکننده بیشتر میشود.

این امر مشکل اساسی را تشدید میکند و میتواند منجر به ناآرامیهای اجتماعی شود، به خصوص اگر محتوا مربوط به گفتار سیاسی، مذهب، جنسیت، استراتژیهای تجاری یا مسائل کلان اقتصادی باشد.

در زمینهی تکثیر دیپفیک، مؤثرترین استراتژی مدیریت ریسک، حفظ کانالهای ارتباطی مداوم، از طریق پلتفرمهای رسانههای اجتماعی محبوب، وبسایتها یا جلسات حضوری، بین کسبوکارها، افراد مشهور، سیاستمداران و ذینفعان کلیدی مانند طرفداران، مطبوعات، جوامع و کارمندان است.

|

استفاده روزافزون از هوش مصنوعی هم مزایا و هم مشکلات جدید غیرمنتظرهای را به همراه دارد. عکس تصویری. (منبع: Freepik) |

با حفظ این کانالهای ارتباطی، دریافت اطلاعات مربوط به دیپفیک سریعتر میشود و امکان اصلاح به موقع و مؤثر شایعات را فراهم میکند و اطلاعات نادرست را در همان ابتدا آشکار میسازد.

با این حال، شرکتها، افراد مشهور و سیاستمداران باید یک طرح مدیریت بحران مخصوص دیپفیک تدوین کنند. برای مثال، چه کسی گزارش میدهد، از طریق کدام کانالهای رسانهای، معیارهای تأیید اطلاعات از طریق شواهد و منابع معتبر، ایجاد یک جدول زمانی برای مدیریت شایعات و ترسیم استراتژی برای بازگرداندن اعتبار.

با یک برنامهی از پیش آماده و روشمند، مدیریت بحران دیپفیک آسانتر خواهد بود و عواقب ناگوار احتمالی آن به حداقل خواهد رسید.

منبع

![[ویدئو] بناهای تاریخی هوئه برای استقبال از بازدیدکنندگان بازگشایی شدند](https://vphoto.vietnam.vn/thumb/402x226/vietnam/resource/IMAGE/2025/11/05/1762301089171_dung01-05-43-09still013-jpg.webp)

![گذار دونگ نای به OCOP: [بخش 2] افتتاح کانال توزیع جدید](https://vphoto.vietnam.vn/thumb/402x226/vietnam/resource/IMAGE/2025/11/09/1762655780766_4613-anh-1_20240803100041-nongnghiep-154608.jpeg)

نظر (0)