अगर आपने कभी सोशल मीडिया ब्राउज़ किया है, तो संभवतः आपने AI द्वारा बनाई गई तस्वीरें या वीडियो देखे होंगे। कई लोग इनके झांसे में आ चुके हैं, जैसे कि ट्रैम्पोलिन पर कूदते खरगोशों का वायरल वीडियो। लेकिन OpenAI द्वारा विकसित ChatGPT की सहयोगी ऐप Sora, AI वीडियो को एक नए स्तर पर ले जा रही है, जिससे नकली सामग्री का पता लगाना और भी ज़रूरी हो गया है।

एआई वीडियो टूल्स की वजह से असली वीडियो की पहचान करना पहले से कहीं ज्यादा मुश्किल हो गया है। (स्रोत: सीनेट)

2024 में लॉन्च हुआ और हाल ही में सोरा 2 के साथ अपग्रेड किया गया, इस ऐप का इंटरफ़ेस टिकटॉक जैसा है, जहाँ सभी वीडियो AI द्वारा बनाए जाते हैं। "कैमियो" फ़ीचर की मदद से असली लोगों को कृत्रिम फ़ुटेज में डाला जा सकता है, जिससे बेहद वास्तविक दिखने वाले वीडियो बनते हैं।

इसलिए, कई विशेषज्ञों को आशंका है कि सोरा के कारण डीपफेक का प्रसार होगा, जिससे जानकारी विकृत हो जाएगी और वास्तविकता और कृत्रिमता के बीच की रेखा धुंधली हो जाएगी। मशहूर हस्तियां विशेष रूप से असुरक्षित हैं, जिसके चलते SAG-AFTRA जैसे संगठनों ने OpenAI से सुरक्षा बढ़ाने का आग्रह किया है।

कृत्रिम बुद्धिमत्ता (AI) द्वारा निर्मित सामग्री की पहचान करना तकनीकी कंपनियों, सोशल मीडिया प्लेटफॉर्मों और उपयोगकर्ताओं के लिए एक बड़ी चुनौती है। लेकिन सोरा का उपयोग करके बनाए गए वीडियो को पहचानने के तरीके मौजूद हैं।

सोरा वॉटरमार्क ढूंढें

सोरा वॉटरमार्क (नीले तीर द्वारा दर्शाया गया) एक ऐसा चिह्न है जो वीडियो बनाने के लिए उपयोग किए गए टूल की पहचान करता है। (स्रोत: सीनेट)

सोरा आईओएस ऐप पर बनाए गए प्रत्येक वीडियो को डाउनलोड करने पर एक वॉटरमार्क दिखाई देता है - सफेद सोरा लोगो (बादल आइकन) वीडियो के किनारों पर घूमता रहता है, जो टिकटॉक के वॉटरमार्क के समान है।

यह कृत्रिम बुद्धिमत्ता (AI) द्वारा निर्मित सामग्री की पहचान करने का एक दृश्य तरीका है। उदाहरण के लिए, Google का जेमिनी "नैनो-केला" मॉडल भी छवियों में स्वचालित रूप से वॉटरमार्क जोड़ देता है। हालांकि, वॉटरमार्क हमेशा विश्वसनीय नहीं होते। यदि वॉटरमार्क स्थिर है, तो इसे आसानी से क्रॉप करके हटाया जा सकता है। सोरा जैसे गतिशील वॉटरमार्क को भी विशेष एप्लिकेशन का उपयोग करके हटाया जा सकता है।

इस बारे में पूछे जाने पर, ओपनएआई के सीईओ सैम अल्टमैन ने तर्क दिया कि समाज को इस वास्तविकता को स्वीकार करना होगा कि कोई भी नकली वीडियो बना सकता है। सोरा से पहले, ऐसा कोई टूल मौजूद नहीं था जो इतना लोकप्रिय, सुलभ हो और जिसके लिए ऐसे वीडियो बनाने में किसी कौशल की आवश्यकता न हो। उनका दृष्टिकोण वैकल्पिक सत्यापन विधियों पर निर्भर रहने की आवश्यकता को रेखांकित करता है।

मेटाडेटा की जाँच करें

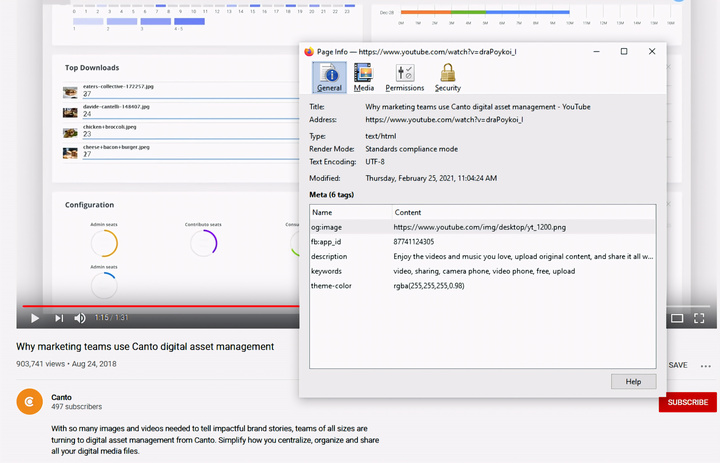

मेटाडेटा की जाँच करना – यह निर्धारित करने में एक महत्वपूर्ण कदम है कि क्या कोई वीडियो सोरा जैसे एआई द्वारा बनाया गया था। (स्रोत: कैंटो)

आपको लग सकता है कि मेटाडेटा की जांच करना बहुत जटिल है, लेकिन वास्तव में यह काफी सरल और बहुत प्रभावी है।

मेटाडेटा वह जानकारी है जो सामग्री बनाते समय स्वचालित रूप से उससे जुड़ जाती है, जैसे कैमरा प्रकार, स्थान, रिकॉर्डिंग का समय और फ़ाइल का नाम। चाहे सामग्री मानव द्वारा बनाई गई हो या कृत्रिम बुद्धिमत्ता (AI) द्वारा, उसमें मेटाडेटा होता है। AI द्वारा बनाई गई सामग्री में अक्सर स्रोत का उल्लेख भी शामिल होता है।

OpenAI, Coalition for Content Origin and Authenticity (C2PA) का सदस्य है, इसलिए सोरा वीडियो में C2PA मेटाडेटा शामिल होगा। आप कंटेंट ऑथेंटिसिटी इनिशिएटिव के वेरिफिकेशन टूल का उपयोग करके इसकी पुष्टि कर सकते हैं:

मेटाडेटा की जांच कैसे करें:

- verify.contentauthenticity.org पर जाएं

- जांच के लिए फाइल अपलोड करें।

- “खोलें” दबाएँ

- दाईं ओर दी गई तालिका में जानकारी देखें।

अगर वीडियो AI द्वारा बनाया गया है, तो सारांश में यह स्पष्ट रूप से बताया जाएगा। सोरा के वीडियो देखते समय, आपको "OpenAI द्वारा प्रकाशित" लिखा हुआ और AI द्वारा बनाए जाने की पुष्टि करने वाली जानकारी दिखाई देगी। सभी सोरा वीडियो में यह जानकारी होना आवश्यक है ताकि उनके स्रोत की पुष्टि हो सके।

स्रोत: https://vtcnews.vn/cach-nhan-biet-video-that-hay-do-ai-tao-ar972891.html

![[फोटो] प्रधानमंत्री फाम मिन्ह चिन्ह ने तोचिगी प्रांत (जापान) के राज्यपाल से मुलाकात की।](/_next/image?url=https%3A%2F%2Fvphoto.vietnam.vn%2Fthumb%2F1200x675%2Fvietnam%2Fresource%2FIMAGE%2F2025%2F12%2F16%2F1765892133176_dsc-8082-6425-jpg.webp&w=3840&q=75)

![[फोटो] प्रधानमंत्री फाम मिन्ह चिन्ह लाओस के शिक्षा और खेल मंत्री थोंगसालिथ मंग्नोरमेक से मुलाकात करते हुए।](/_next/image?url=https%3A%2F%2Fvphoto.vietnam.vn%2Fthumb%2F1200x675%2Fvietnam%2Fresource%2FIMAGE%2F2025%2F12%2F16%2F1765876834721_dsc-7519-jpg.webp&w=3840&q=75)

![[लाइव] 2025 सामुदायिक कार्य पुरस्कार समारोह](/_next/image?url=https%3A%2F%2Fvphoto.vietnam.vn%2Fthumb%2F1200x675%2Fvietnam%2Fresource%2FIMAGE%2F2025%2F12%2F16%2F1765899631650_ndo_tr_z7334013144784-9f9fe10a6d63584c85aff40f2957c250-jpg.webp&w=3840&q=75)

![[तस्वीर] 2025 कम्युनिटी एक्शन अवार्ड्स गाला से पहले लीक हुई तस्वीरें।](/_next/image?url=https%3A%2F%2Fvphoto.vietnam.vn%2Fthumb%2F1200x675%2Fvietnam%2Fresource%2FIMAGE%2F2025%2F12%2F16%2F1765882828720_ndo_br_thiet-ke-chua-co-ten-45-png.webp&w=3840&q=75)

टिप्पणी (0)