12月中旬、MetaはベトナムのMessengerアプリに「Meta AI」と呼ばれる人工知能チャットボットの統合を開始し、全ユーザーに無料で公開しました。このツールはLlama 3.2言語モデルを採用し、ベトナム語に対応しており、情報検索、画像作成、チャットが可能です。

その後間もなく、ベトナムの多くのユーザーがMeta AIの画像生成に重大なエラーがあることを発見しました。具体的には、「黒い犬」というキーワードを入力すると、チャットボットは肌の色が濃く、巻き毛の男性または少年の画像を表示しました。ベトナム語で「黒い犬の画像」と入力した場合も、Meta AIは同様の検索結果を表示しました。

コマンドが異なるコンテンツを求めているにもかかわらず、メタAIが有色人種を描くのは深刻な問題である

12月31日、Metaのベトナム代表は、この件について公式に発言しました。同社は上記の問題を認め、修正したと発表しました。また、Meta Vietnamは今回の件について謝罪し、この問題は既存の他の生成AIシステムでも発生する可能性があると述べました。

「この誤りをお詫び申し上げます。Metaは、皆様により安全で楽しい体験を提供するために、機能とAIモデルに安全対策を組み込んでいます。しかしながら、他の生成AIシステムと同様に、このモデルは不正確または不快なコンテンツを返す可能性がありますので、ユーザーには責任を持ってこれらのツールをご利用いただくようお願いいたします」と、同社の担当者は述べた。

Meta AIは、ある程度の試行期間を経て、言語を用いて非常にスムーズに応答する能力で、多くの人々から高く評価されています。画像作成機能も、ユーザーに無料で公開されているモデルと比較して優れた品質を提供しています。その理由の一つは、MetaがFacebookに投稿されたコンテンツをAIの学習プロセスの入力データとして利用し、自然なコマンドを表現・実行できるようにしていることが挙げられます。

しかし、人種差別やAIの基準に合わないような反応といった事態を避けるのは依然として困難です。Meta社は、人工知能分野の専門家による「レッドチームテスト」を通じてAIをテストし、意図しない使用を特定し、継続的な改善プロセスを通じて対処していると述べています。

[広告2]

出典: https://thanhnien.vn/meta-xin-loi-vi-su-co-ai-ve-con-cho-da-den-185241231104908626.htm

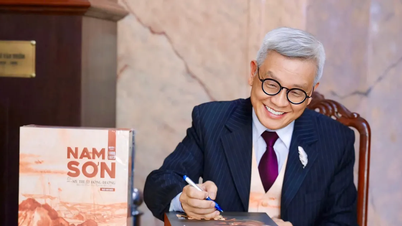

![[写真] ト・ラム事務総長がベトナム研究に関する国際会議に出席する代表団を歓迎](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/10/26/1761456527874_a1-bnd-5260-7947-jpg.webp)

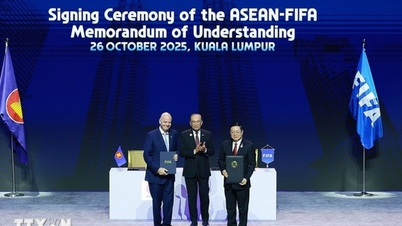

![[写真] ニャンダン新聞が第14回全国党大会の文書草案を展示し、意見を募る](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/10/26/1761470328996_ndo_br_bao-long-171-8916-jpg.webp)

コメント (0)