SGGP

ChatGPT를 흥미롭고 흥미로운 이유는 매끄러운 대화와 상당히 정확한 데이터 수집 능력 때문입니다. ChatGPT는 천문학, 문학, 예술부터 사업 전략, 마케팅, 물류, 세무 상담, 심지어 "아내는 항상 옳다"는 이야기까지 거의 모든 "돌려쓰기" 질문에 대한 해답을 제시합니다.

|

ChatGPT는 인공지능(AI) 소프트웨어를 출시한 지 불과 2개월 만에 사용자 1억 명을 돌파하여 세계 역사상 가장 빠르게 성장하는 애플리케이션이 되었습니다.

기술 대기업 구글은 자사의 "후계자" 오픈AI가 AI 챗봇 바드(Bard)를 서둘러 출시하며 전 세계의 이목을 집중시키는 것을 보고 가만히 있을 수 없었습니다. 그러나 바드를 출시하는 영상 에서 이 챗봇은 "제임스 웹 우주 망원경"에 대한 잘못된 답변을 내놓았습니다. 그 즉시 알파벳(구글)의 주가는 9% 폭락하며 1,000억 달러에 달하던 구글의 시가총액이 증발했습니다. 이는 경쟁사 마이크로소프트가 챗GPT에 투자한 금액의 10배에 달하는 규모입니다. 이는 AI 전쟁이 실제로 발발했음을 보여줍니다. 치열하고 통제하기 어려우며, 현대인의 상상을 초월하는 전쟁이 될 것입니다. 그때는 인간과 AI 사이에 전쟁이 벌어질 것입니다. 인류는 "누가 AI를 통제할 수 있을까?"라는 질문을 끊임없이 던질 것입니다.

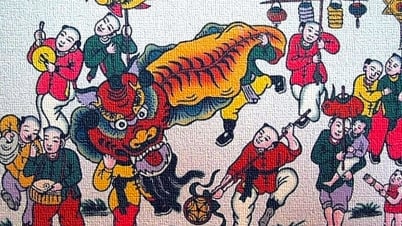

2023년 1월, 비주얼 미디어 기업 게티 이미지(미국)는 자사와 파트너사 이미지 수백만 장을 불법 복제하여 수익을 창출하는 도구를 운영한 기술 기업 스태빌리티 AI(Stability AI)를 고소하겠다고 경고했습니다. 2월 6일, 게티 이미지는 데이터베이스에서 1,200만 장의 이미지가 사용되어 저작권과 상표권을 침해했다고 주장하며 공식 소송을 제기했습니다. 이와 유사하게, 화가와 예술가들이 제작한 수백만 점의 예술 작품 또한 AI 아트 도구에 의해 노골적이고 무모하게 침해당했습니다. AI 도구는 방대한 데이터 소스에서 새롭고 아름다우며 초현실적인 그림과 사진을 만들어낼 수 있지만, 어디서 학습하고, 복제하고, "훔쳤는지"는 알 수 없습니다. AI 도구는 창작자와 예술가들에게 불안감을 안겨줍니다. 아무리 잠을 자지 못하고 몇 달, 몇 년 동안 작품을 제작하더라도, 단 한 시간 만에 수백 점의 초현실적인 작품을 제공하는 AI와 경쟁할 수 없기 때문에 그들의 가치는 여전히… 평가절하될 것이기 때문입니다.

ChatGPT(OpenAI) 또는 이후 Bard(Google), Ernie Bot/Wenxin Yiyan(Baidu), Ding Talk(Alibaba) 등은 방대한 디지털 지식 기반을 기반으로 다양한 답변을 제공하고, 심지어 에세이와 논문까지 작성할 수 있습니다. AI는 수많은 정보, 해결책, 그리고 추천을 제공하지만, 사람들은 그 출처가 어디인지, 신뢰할 수 있는지, 저작권이나 개인정보를 침해하는지 알지 못합니다. 문학 작품, 저널리즘 작품, 그리고 과학 연구 과정에서 윤리적 위반은 항상 뜨거운 감자였지만, 이제 AI가 정교한 알고리즘과 심층적인 지식으로 이러한 위반을 "조작"할 때 이를 감지하는 것은 더욱 어려워졌습니다.

따라서 AI를 포함한 기술 플랫폼을 위한 법적 통로를 마련하는 것은 입법자, 관리자, 그리고 기술 전문가들이 시급히 시작해야 할 과제입니다. 각 분야는 저작권, 상표권, 데이터 활용 방식에 대한 자체적인 규정과 규칙, 그리고 기술 사기, 복제, 그리고 법으로 보호되는 개인 및 단체의 이익 침해 행위에 대한 엄격한 제재가 필요합니다. 기술은 급속도로 발전하고 있으며, 4차 산업 혁명은 슈퍼 인터넷, 빅데이터, AI, 로봇, 나노 기술, 신소재 등을 통해 분명하게 드러납니다. 이러한 기술들은 인간의 삶에 효과적으로 기여하고 있습니다. 기계 지능은 인간에 의해 창조되었으며, 감정, 감각, 경험, 창의성, 직관, 판단력을 가질 수 없다는 점에서 인간과 완전히 다릅니다. 기술은 교사의 지위, 예술가의 창의성, 언론인의 헌신, 과학자의 윤리와 성실성을 바꿀 수 없습니다. 따라서 기술을 통제하기 전에, 사람들은 스스로를 통제하고, 공동체에 대한 자신의 역할과 책임을 인식하며, 건강하고 인간적인 사회를 유지하고 발전시켜야 합니다.

[광고_2]

원천

댓글 (0)