"마인드 캡셔닝" 기술은 뇌 신호를 사람들이 생각하는 이미지나 장면에 대한 정확한 묘사로 변환하여 과학계 를 놀라게 하고 있습니다. 이는 미국 과학자 그룹이 발표한 새로운 기술로, 인공지능과 신경과학 분야에서 눈부신 발전을 이룬 "마인드 캡셔닝" 기술입니다.

이 시스템은 뇌 활동을 해독하고 사람이 머릿속으로 보고 상상하는 것을 놀라운 정확도로 글로 표현할 수 있습니다.

사이언스 어드밴시스(Science Advances) 저널에 게재된 이 연구는 인간의 뇌가 주변 세계를 어떻게 해석하는지 이해하는 데 새로운 관점을 제시합니다. 동시에, 이 새로운 기술은 뇌졸중과 같은 언어 장애 환자를 지원하는 데에도 잠재적인 활용 가능성을 제시합니다.

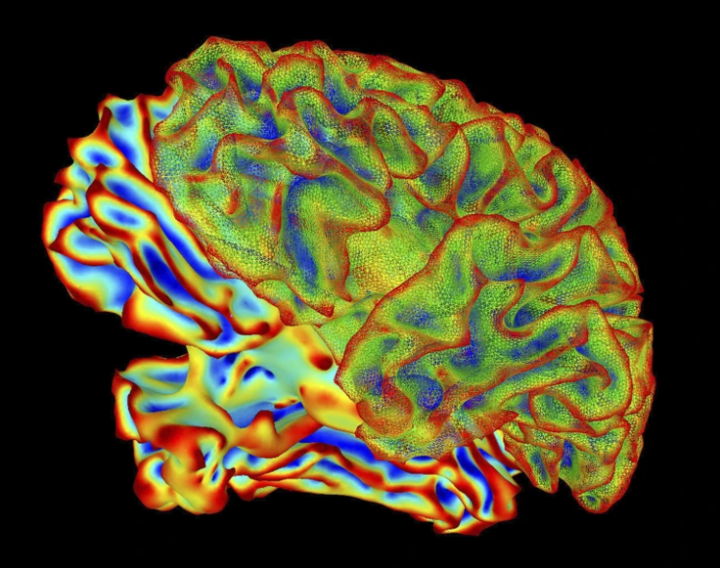

마인드 캡션 기술은 뇌 활동을 해석하여 사람들이 머릿속에서 보고 상상하는 것을 매우 정확하게 텍스트 설명으로 변환할 수 있습니다. (사진: Nature.com)

미국 캘리포니아 대학교 버클리 캠퍼스 연구팀에 따르면, 이 기술은 비침습적 뇌 영상 기술을 사용하여 신경 활동을 기록합니다. 그런 다음 과학자들은 고급 AI 언어 모델을 사용하여 참가자가 보고 상상하는 것을 예측하고 정확하게 설명합니다.

계산 신경과학자 알렉스 후스는 "이 시스템은 사람이 보고 있는 것을 매우 세부적으로 예측할 수 있는데, 이는 전례 없는 일입니다." 라고 말했습니다.

10년 넘게 연구자들은 뇌 신호를 기반으로 이미지나 소리를 예측하려고 노력해 왔습니다. 하지만 영상 이나 추상적인 도형과 같은 복잡한 내용을 언어로 "번역"하는 것은 여전히 큰 과제로 남아 있습니다.

이전 방법은 주어, 행동, 주변 환경 등 전체적인 맥락 대신 단일 키워드만 인식했습니다.

이러한 한계를 극복하기 위해 NTT 커뮤니케이션즈 사이언스 연구소(일본)의 신경과학자 호리카와 토모야스 연구팀은 심층 언어 AI 모델을 개발했습니다. 먼저, 심층 언어 모델을 사용하여 2,000개 이상의 영상 자막을 분석하고, 각 부분을 영상 콘텐츠를 나타내는 디지털 그래프인 "의미 시그니처"로 변환했습니다.

그런 다음 연구팀은 6명의 참가자가 영상을 시청하는 동안 이러한 "의미 서명"과 뇌 활동 사이의 연관성을 인식하도록 또 다른 AI 시스템을 훈련시켰습니다.

연구 결과에 따르면 AI는 참가자가 보고 상상하는 내용을 단순히 키워드를 나열하는 것이 아니라 완전한 설명 문장으로 정확하게 "번역"할 수 있는 것으로 나타났습니다.

전문가들은 "마인드 캡션" 기술이 신경과학 연구의 이정표일 뿐만 아니라 광범위한 실용화 가능성을 열어준다고 말합니다. 앞으로 이 기술은 언어 능력을 상실한 사람들을 지원하여 뇌 신호를 통해 소통할 수 있도록 도울 수 있습니다.

아직 초기 단계이기는 하지만, "마인드 캡션"은 인간 사고의 언어를 해독하는 여정에서 큰 진전을 이루었으며, 공상과학 영화에서만 볼 수 있었던 "마인드 리딩"이라는 가능성을 현실에 한 걸음 더 다가가게 했습니다.

출처: https://vtcnews.vn/cong-nghe-dot-pha-tri-tue-nhan-tao-doc-duoc-suy-nghi-con-nguoi-ar985947.html

![[사진] 산사태로 피해를 입은 14E 도로에서 사람들이 통행할 수 있도록 언덕을 깎아내는 모습](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/11/08/1762599969318_ndo_br_thiet-ke-chua-co-ten-2025-11-08t154639923-png.webp)

![[영상] 후에 기념물 재개장, 방문객 맞이](https://vphoto.vietnam.vn/thumb/402x226/vietnam/resource/IMAGE/2025/11/05/1762301089171_dung01-05-43-09still013-jpg.webp)

댓글 (0)