ການເພີ່ມຂຶ້ນຂອງປັນຍາປະດິດ (AI) ກໍາລັງສ້າງຈຸດປ່ຽນປະຫວັດສາດ, ບັງຄັບໃຫ້ປະເທດຕ່າງໆຕອບຄໍາຖາມທີ່ບໍ່ເຄີຍມີມາກ່ອນກ່ຽວກັບຈັນຍາບັນເຕັກໂນໂລຢີ, ຄວາມປອດໄພແລະຄວາມຮັບຜິດຊອບ.

ເມື່ອລະບົບ AI ກາຍເປັນລະບົບທີ່ມີປະສິດທິພາບ, ໄວຂຶ້ນ, ແລະເປັນເອກະລາດຫຼາຍຂຶ້ນ, ເສັ້ນລະຫວ່າງຜົນປະໂຫຍດ ແລະຄວາມສ່ຽງຈະມົວຫຼາຍຂຶ້ນ.

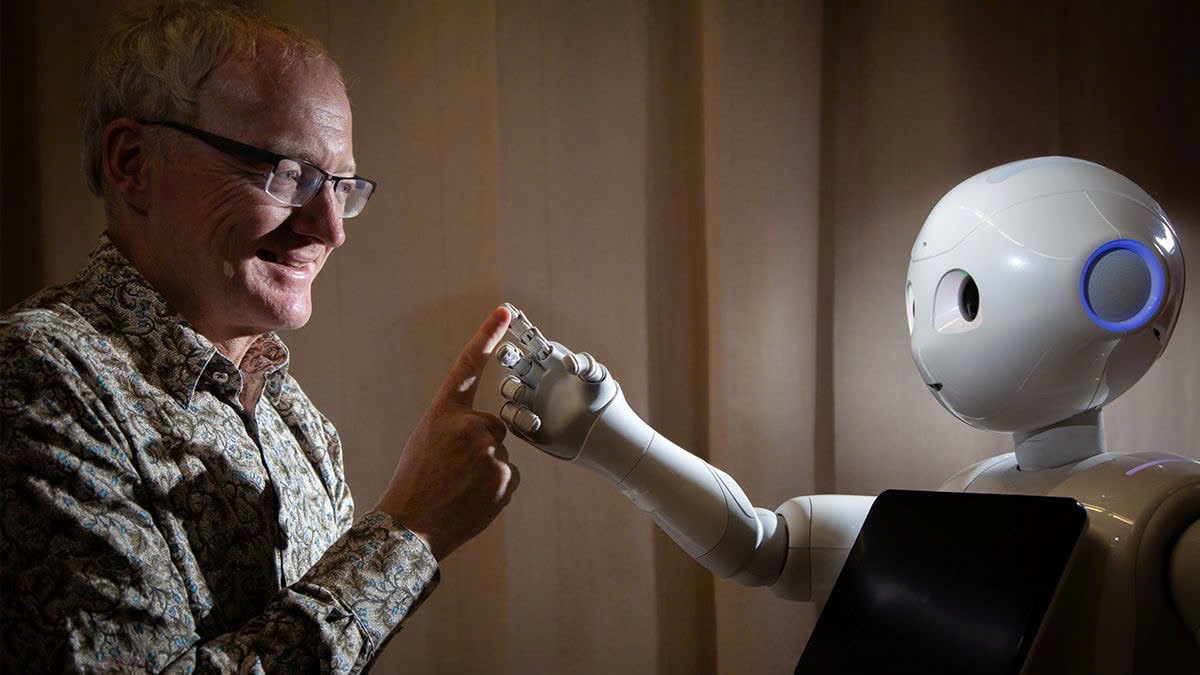

ເວທີປາໄສ “AI ເພື່ອມະນຸດສະທຳ: ຈັນຍາບັນ ແລະ ຄວາມປອດໄພຂອງ AI ໃນຍຸກໃໝ່” ທີ່ VinFuture Week 2025 ໄດ້ດຳເນີນໃນເວລາອັນເໝາະສົມ, ກາຍເປັນຊ່ອງວ່າງໃຫ້ ໂລກ ໄດ້ເບິ່ງຄືນວ່າ ມະນຸດກຳລັງປະເຊີນໜ້າກັບເຕັກໂນໂລຊີບໍ່ຢູ່ເຂດຊາຍແດນຂອງປະເທດໃດ.

ຈາກທັດສະນະການວິເຄາະ, ກອງປະຊຸມບໍ່ພຽງແຕ່ເປັນບ່ອນແລກປ່ຽນທາງວິຊາການ. ເປັນການຊີ້ໃຫ້ເຫັນວ່າ, ຫວຽດນາມ ແມ່ນຕະຫຼາດເຄື່ອນໄຫວດ້ວຍຄວາມໄວດີຈີຕອນພວມກ້າວເຂົ້າສູ່ການຄຸ້ມຄອງ AI ໃນທົ່ວໂລກ, ເຊິ່ງມາດຕະຖານຄຸນຄ່າ, ແລວທາງດ້ານກົດໝາຍ ແລະ ວິໄສທັດດ້ານຈັນຍາບັນແມ່ນສຳຄັນຄືກັບເຕັກໂນໂລຢີ.

ຈັນຍາບັນ AI: ຈາກ “ອຸປະສັກຕໍ່ກັບນະວັດຕະກໍາ” ໄປສູ່ພື້ນຖານການພັດທະນາແບບຍືນຍົງ

ສໍາລັບເວລາຫຼາຍປີ, ຈັນຍາບັນໄດ້ຖືກເຫັນວ່າເປັນອຸປະສັກຕໍ່ການປະດິດສ້າງເຕັກໂນໂລຢີ. ແນວໃດກໍ່ຕາມ, ດັ່ງທີ່ສາດສະດາຈານ Toby Walsh - ຫນຶ່ງໃນສຽງທີ່ເຄົາລົບທີ່ສຸດໃນຂົງເຂດ AI - ຢືນຢັນ, ຈັນຍາບັນແມ່ນເງື່ອນໄຂສໍາລັບການປະດິດສ້າງທີ່ເກີດຂື້ນຢ່າງຍືນຍົງ, ປອດໄພແລະຄາດຄະເນ.

ການໂຕ້ຖຽງຂອງລາວແມ່ນອີງໃສ່ຄວາມເປັນຈິງ: ແບບຈໍາລອງ AI ເພີ່ມຂະຫນາດຂໍ້ມູນ, ການຕັດສິນໃຈອັດຕະໂນມັດ, ແລະມີອິດທິພົນໂດຍກົງຕໍ່ມະນຸດໃນວິທີທີ່ເຖິງແມ່ນວ່ານັກພັດທະນາບໍ່ສາມາດຄວບຄຸມໄດ້ຢ່າງເຕັມສ່ວນ.

ເມື່ອ algorithms ສາມາດວິເຄາະ, ປະເມີນ, ຄາດຄະເນ, ແລະການຕັດສິນໃຈໃນນາມຂອງມະນຸດ, ການຂາດມາດຕະຖານດ້ານຈັນຍາບັນບໍ່ແມ່ນຄວາມສ່ຽງທາງດ້ານເຕັກນິກອີກຕໍ່ໄປ - ມັນເປັນຄວາມສ່ຽງຕໍ່ສັງຄົມ.

ເຫດການທີ່ຜ່ານມາທົ່ວໂລກສະແດງໃຫ້ເຫັນເຖິງສິ່ງດັ່ງກ່າວ: AI ທີ່ມີຄວາມລໍາອຽງໃນການຈ້າງ, ຮູບແບບການແນະນໍາທີ່ເຮັດໃຫ້ເກີດຄວາມບໍ່ເປັນລະບຽບຂອງສັງຄົມ, ສູດການຄິດໄລ່ການຂັບລົດຕົນເອງລົ້ມເຫລວໃນສະຖານະການທີ່ບໍ່ແນ່ນອນ…

ໃນສະພາບການນີ້, ຄໍາຖາມທີ່ວ່າ AI ຄວນຖືກຊ້າລົງຫຼືບໍ່ກາຍເປັນສິ່ງທີ່ລ້າສະໄຫມ. ສິ່ງທີ່ມະນຸດຕ້ອງການບໍ່ແມ່ນການຊ້າລົງ, ແຕ່ການເດີນໄປໃນທິດທາງທີ່ຖືກຕ້ອງ.

ຄວາມສ່ຽງ AI ບໍ່ມີຊາຍແດນຕິດ – ເປັນຫຍັງປະເທດຕ່າງໆຖືກບັງຄັບໃຫ້ຮ່ວມມື?

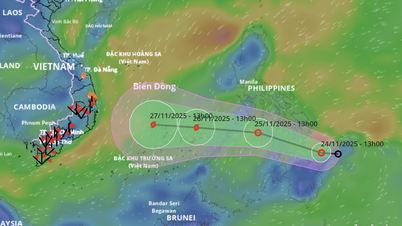

ສາດສະດາຈານ Edson Prestes ຍົກອອກຄໍາເຕືອນທີ່ສໍາຄັນ: ລະບົບ AI ໃດໆທີ່ພັດທະນາຢູ່ໃນປະເທດຫນຶ່ງສາມາດແຜ່ລາມໄປທົ່ວໂລກໃນບໍ່ເທົ່າໃດຊົ່ວໂມງຜ່ານເວທີດິຈິຕອນ. ອັນນີ້ສ້າງຄວາມຈິງທີ່ບໍ່ສະດວກ: ຄວາມສ່ຽງ AI ແມ່ນຄວາມສ່ຽງຂ້າມຊາຍແດນ, ແລະບໍ່ມີປະເທດໃດສາມາດ "ປິດປະຕູ" ເພື່ອປົກປ້ອງຕົນເອງ.

ພວກເຮົາໄດ້ເຫັນສິ່ງທີ່ເຄີຍມີມາກ່ອນໜ້ານີ້ຫຼາຍຢ່າງ: ວິທີການຈັດອັນດັບຂ່າວສ້າງຜົນກະທົບ “ຂໍ້ມູນຂ່າວສານ” ໃນຫຼາຍສິບປະເທດ. ລະບົບການຮັບຮູ້ໃບໜ້າແບບອະຄະຕິສົ່ງຜົນກະທົບຕໍ່ຜູ້ໃຊ້ຫຼາຍລ້ານຄົນທົ່ວໂລກ.

ຮູບແບບພາສາທີ່ຮົ່ວໄຫຼມີຜົນສະທ້ອນໃນຫຼາຍຕະຫຼາດ, ດັ່ງນັ້ນກົດລະບຽບຂອງແຕ່ລະປະເທດຈະບໍ່ພຽງພໍ.

ບັນດາຜູ້ຊ່ຽວຊານເຫັນດີວ່າ, ການຮ່ວມມືສາກົນແມ່ນສຳຄັນ. ສິ່ງນີ້ມີຄວາມສຳຄັນເປັນພິເສດແມ່ນເມື່ອ AI ໄດ້ກາຍເປັນພື້ນຖານໂຄງລ່າງໃໝ່ຂອງທຸກຂະແໜງ ເສດຖະກິດ ຄື: ການເງິນ, ສາທາລະນະສຸກ, ການສຶກສາ, ປ້ອງກັນປະເທດ, ບໍລິຫານ...

ໂລກຕ້ອງການມາດຕະຖານທົ່ວໄປ - ຄ້າຍຄືກັນກັບການບິນຫຼືຄວາມປອດໄພທາງອິນເຕີເນັດ - ເພື່ອຫຼີກເວັ້ນການມີຄວາມສ່ຽງທີ່ສາມາດແຜ່ລາມແລະສ້າງຄວາມເສຍຫາຍໃນຂະຫນາດໃຫຍ່.

ນີ້ຮຽກຮ້ອງໃຫ້ປະເທດມີສ່ວນຮ່ວມໃນເກມ, ແທນທີ່ຈະລໍຖ້າໃຫ້ເຕັກໂນໂລຢີມີຮູບຮ່າງແລະຫຼັງຈາກນັ້ນປັບຕົວ.

ຫວຽດນາມກາຍເປັນ “ຈຸດສະຫວ່າງ” ໃນແຜນທີ່ຈັນຍາບັນ AI ຂອງອາຊີຕາເວັນອອກສຽງໃຕ້

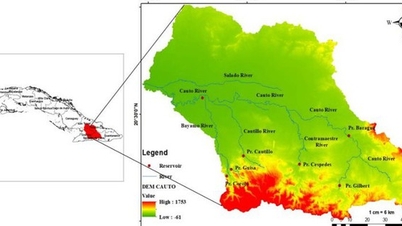

ຕາມທິດທາງດ້ານນະໂຍບາຍ, ຄຳເຫັນຂອງສາດສະດາຈານ Walsh ກ່ຽວກັບ ຫວຽດນາມ ມີຄວາມໝາຍຍຸດທະສາດຫຼາຍຢ່າງ. ຫວຽດນາມ ບໍ່ແມ່ນສູນພັດທະນາ AI ຂະໜາດໃຫຍ່ຄືກັບສະຫະລັດ ຫຼື ຈີນ, ແຕ່ມັນມີຂໍ້ໄດ້ປຽບສະເພາະເຊັ່ນ: ປະຊາກອນໄວໜຸ່ມ, ຄວາມຕ້ອງການດ້ານດິຈິຕອລຢ່າງແຂງແຮງ, ຄວາມໄວການຫັນປ່ຽນດີຈີຕອລທີ່ໄວທີ່ສຸດຂອງ ລັດຖະບານ ແລະ ທຸລະກິດໃນພາກພື້ນ, ລະບົບນິເວດການເລີ່ມຕົ້ນຂອງ AI ທີ່ມີການຂະຫຍາຍຕົວ ແລະ ນະໂຍບາຍເປີດດ້ວຍການທົດສອບ sandbox.

ປັດໄຈເຫຼົ່ານີ້ເຮັດໃຫ້ຫວຽດນາມມີຈຸດພິເສດຄື: ມັນອາດຈະບໍ່ແມ່ນຜູ້ນໍາດ້ານເຕັກໂນໂລຢີຫຼັກ, ແຕ່ມັນສາມາດເປັນຜູ້ນໍາໃນການສ້າງກອບດ້ານຈັນຍາບັນແລະວິທີການຈັດການກັບ AI - ຄ້າຍຄືກັບວິທີການ Estonia ນໍາພາໃນລັດຖະບານດິຈິຕອນເຖິງແມ່ນວ່າບໍ່ແມ່ນພະລັງງານເຕັກໂນໂລຢີ.

ຜູ້ຊ່ຽວຊານຕີລາຄາວ່າ ຫວຽດນາມ ພວມບັນລຸໄດ້ 3 ເງື່ອນໄຂທີ່ຫາຍາກຄື: ຄວາມຕ້ອງການພາຍໃນໃຫຍ່ - ປະຊາກອນໃຫຍ່, ການຫັນປ່ຽນຢ່າງແຂງແຮງຂອງການບໍລິການສາທາລະນະ, ການຫັນເປັນວິສາຫະກິດດີຈີຕອນຢ່າງວ່ອງໄວ; ຄວາມໄວນະໂຍບາຍທີ່ໄວແລະຕັດສິນ - ຈາກ VNeID ກັບ 12 ຖານຂໍ້ມູນແຫ່ງຊາດ, ຈາກຂໍ້ມູນເປີດໄປສູ່ການແກ້ໄຂຄວາມປອດໄພ AI; ຄວາມມຸ່ງມາດປາດຖະຫນາແຫ່ງຊາດ - ການເຕີບໂຕທາງດ້ານເສດຖະກິດດິຈິຕອນ, ການພັດທະນາຊັບພະຍາກອນມະນຸດ AI, ດຶງດູດຜູ້ຊ່ຽວຊານສາກົນ.

ຖ້າ ຫວຽດນາມ ສ້າງບັນດາມາດຖານດ້ານຈັນຍາບັນ ແລະ ແບບວິທີການຄຸ້ມຄອງທີ່ເໝາະສົມ, ມັນສາມາດກາຍເປັນຕົວແບບອ້າງອີງຂອງອາຊຽນ - ເຊິ່ງປະເທດອື່ນຊອກຫາວິທີກໍ່ສ້າງລະບົບຂອງຕົນ.

VinFuture 2025: ເຊິ່ງຫວຽດນາມສະແດງໃຫ້ເຫັນບົດບາດເປັນ "ຜູ້ປະກອບສ່ວນທາງສຽງ" ໃນເກມ AI ໂລກ.

ການສົນທະນາຂອງຄະນະ "AI ສໍາລັບມະນຸດ: ຈັນຍາບັນ AI ແລະຄວາມປອດໄພໃນຍຸກໃຫມ່" ບໍ່ພຽງແຕ່ກ່ຽວກັບວິທະຍາສາດເທົ່ານັ້ນ. ໄດ້ສົ່ງສານທີ່ຈະແຈ້ງວ່າ: ຫວຽດນາມຢາກເຂົ້າຮ່ວມການສົນທະນາທົ່ວໂລກກ່ຽວກັບອະນາຄົດຂອງ AI.

ໃນຂອບເຂດກົດໝາຍສາກົນຄື: ກົດໝາຍວ່າດ້ວຍ AI ຂອງ EU, ຫຼັກການ OECD AI ຫຼື G7 Hiroshima AI ໄດ້ຮັບການສ້າງຕັ້ງ, ແມ່ນຈຳເປັນໃຫ້ ຫວຽດນາມ ເຂົ້າຮ່ວມບັນດາເວທີປາໄສວິທະຍາສາດທີ່ມີຊື່ສຽງຄື: ປົກປັກຮັກສາຜົນປະໂຫຍດຂອງຊາດ, ເຂົ້າຮ່ວມບັນດາມາດຕະການສ້າງຮູບແບບ, ຖອດຖອນບົດຮຽນຈາກສາກົນ ແລະ ກໍ່ສ້າງຫາງສຽງນະໂຍບາຍໃນພາກພື້ນ.

VinFuture ແມ່ນຈຸດໝາຍປາຍທາງທີ່ເໝາະສົມ ເພາະມັນເຕົ້າໂຮມບັນດານັກວິທະຍາສາດຊັ້ນນຳ, ສ້າງສະພາບແວດລ້ອມແຫ່ງການແລກປ່ຽນທີ່ມີຄຸນນະພາບສູງ, ແລະ ບໍ່ຖືກກົດດັນດ້ານການເມືອງຄືບັນດາກອງປະຊຸມສາກົນແບບດັ້ງເດີມ.

ນີ້ກໍແມ່ນບ່ອນທີ່ ຫວຽດນາມ ສາມາດນຳໃຊ້ວິທີ “ມະນຸດເປັນໃຈກາງ” ໃຫ້ແກ່ AI, ແມ່ນທ່າອ່ຽງໃນບັນດາປະຊາທິປະໄຕ ແລະ ບັນດາພື້ນຖານເສດຖະກິດທີ່ພົ້ນເດັ່ນ.

ການສົນທະນາໃນປີນີ້ໄດ້ສຸມໃສ່ສາມຄໍາຖາມຍຸດທະສາດ: AI ຈະປ່ຽນແປງໂລກແນວໃດ? ຄຸນຄ່າອັນໃດຄວນຖືກເຂົ້າລະຫັດ AI ເພື່ອຮັບປະກັນຄວາມຍຸຕິທໍາ? AI ສາມາດພັດທະນາເພື່ອຮັບໃຊ້ຜົນປະໂຫຍດລວມຂອງມະນຸດໄດ້ແນວໃດ? ເຫຼົ່ານີ້ແມ່ນບໍ່ພຽງແຕ່ຄໍາຖາມສໍາລັບນັກວິທະຍາສາດ, ແຕ່ຍັງເປັນຄໍາຖາມສໍາລັບທຸກໆປະເທດທີ່ກໍາລັງປະເຊີນກັບຄື້ນໃຫມ່ຂອງເຕັກໂນໂລຢີ.

ສາດສະດາຈານ Prestes ໄດ້ເນັ້ນຫນັກເຖິງຄວາມເປັນຈິງທີ່ເຢັນ: ປະເທດທີ່ພຽງແຕ່ນໍາໃຊ້ເຕັກໂນໂລຢີສະເຫມີແມ່ນຂຶ້ນກັບ; ປະເທດທີ່ພັດທະນາເຕັກໂນໂລຢີຈະເປັນເອກະລາດແລະສາມາດປົກປ້ອງຄຸນຄ່າຂອງຕົນເອງ.

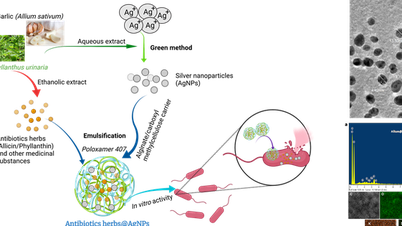

ສິ່ງດັ່ງກ່າວນຳໄປສູ່ສອງຂໍ້ສະເໜີແນະສຳຄັນຂອງຫວຽດນາມ: ໜຶ່ງແມ່ນເຂົ້າຮ່ວມຢ່າງເລິກເຊິ່ງກ່ວາອີກໃນການພັດທະນາເຕັກໂນໂລຢີ AI ຫຼັກ. ບໍ່ຈຳເປັນຕ້ອງແຂ່ງຂັນກັບ Big Tech, ແຕ່ຫວຽດນາມ ຕ້ອງພັດທະນາບັນດາຕົວແບບ, ກົນໄກ ແລະ ແອັບພລິເຄຊັນສະເພາະເພື່ອຮັບໃຊ້ຄວາມຕ້ອງການພາຍໃນປະເທດລວມມີ: ລັດຖະບານອີເລັກໂທຣນິກ, ການສຶກສາສະຫຼາດ, ຢາປ້ອງກັນ, ຄຸ້ມຄອງຄວາມສ່ຽງໄພພິບັດ, ແລະ ກະສິກຳສະຫຼາດ. ສອງແມ່ນສ້າງມາດຕະຖານດ້ານຈັນຍາບັນ AI ຂອງຊາດຢ່າງຕັ້ງໜ້າ.

ນີ້ອາດຈະອີງໃສ່ຫຼັກການຂອງຄວາມໂປ່ງໃສ, ຄວາມເປັນສ່ວນຕົວຂອງຂໍ້ມູນ, ການບໍ່ຈໍາແນກ, ຄວາມປອດໄພຂອງລະບົບແລະຄວາມຮັບຜິດຊອບ.

ຖ້າຫວຽດນາມເຮັດໄດ້ດີ, ມາດຕະຖານນີ້ສາມາດກາຍເປັນເອກະສານອ້າງອີງຂອງອາຊຽນ - ຄ້າຍຄືກັນກັບບົດບາດນໍາພາຂອງປະເທດພວກເຮົາໃນກອບການຫັນເປັນດິຈິຕອນຂອງພາກພື້ນ.

ການສົນທະນາຄະນະ "Ai ສໍາລັບມະນຸດ: AI ຈັນຍາບັນແລະຄວາມປອດໄພໃນຍຸກໃຫມ່" ມີການເຂົ້າຮ່ວມຂອງຜູ້ເວົ້າແລະນັກວິທະຍາສາດຊັ້ນນໍາຂອງໂລກ:

● ຮອງສາດສະດາຈານ César de la Fuente, ມະຫາວິທະຍາໄລ Pennsylvania, ສະຫະລັດອາເມລິກາ — Alfred Sloan Research Fellowship (2025). ລາວຢູ່ໃນອັນດັບ 1% ຂອງນັກຄົ້ນຄວ້າທີ່ອ້າງເຖິງຫຼາຍທີ່ສຸດໃນໂລກໃນຂົງເຂດການຄົ້ນຄວ້າລະຫວ່າງວິຊາ;

● ຮອງສາດສະດາຈານ Luu Anh Tuan, ມະຫາວິທະຍາໄລເຕັກນິກ Nanyang, ສິງກະໂປ, ຜູ້ອໍານວຍການບໍລິຫານສູນຄົ້ນຄວ້າປັນຍາປະດິດ ຢູ່ມະຫາວິທະຍາໄລ VinUni, ຫວຽດນາມ;

● Prof. Edson Prestes, Federal University of Rio Grande do Sul, Brazil, ຫົວຫນ້າກຸ່ມການຄົ້ນຄວ້າທີ່ບໍ່ແມ່ນຫຸ່ນຍົນແລະນັກຄົ້ນຄວ້າຂອງສະພາການຄົ້ນຄວ້າແຫ່ງຊາດ Brazilian ສໍາລັບການພັດທະນາວິທະຍາສາດແລະເຕັກໂນໂລຢີ (CNPq), ສະມາຊິກຂອງຄະນະກໍາມະການທົ່ວໂລກກ່ຽວກັບ AI ທີ່ມີຄວາມຮັບຜິດຊອບໃນຂະແຫນງການທະຫານ;

● Prof. Leslie Gabriel Valiant, FRS, Harvard University, USA, AM Turing Award Winner (2010), ສະມາຊິກສະພາລາງວັນ VinFuture;

● ອາຈານ Toby Walsh, ARC Honorary Scholar and Scientia Professor of AI at UNSW Sydney, Australia, ຜູ້ອໍານວຍການວິທະຍາສາດຂອງ UNSW.AI, ສະຖາບັນ AI Interdisciplinary ຂອງ UNSW;

ການນໍາສະເຫນີວິດີໂອ:

● Prof. Yoshua Bengio, Université de Montréal, ປະທານຮ່ວມ ແລະ CEO ຂອງ LawZero, ຜູ້ກໍ່ຕັ້ງ ແລະທີ່ປຶກສາດ້ານວິທະຍາສາດຂອງສະຖາບັນ Mila AI – Quebec, ປະເທດການາດາ, ສະມາຊິກສະພາທີ່ປຶກສາວິທະຍາສາດຂອງສະຫະປະຊາຊາດກ່ຽວກັບຄວາມແຕກໂຕນທາງດ້ານວິທະຍາສາດ ແລະ ເຕັກໂນໂລຊີ; ຜູ້ຮ່ວມໄດ້ຮັບລາງວັນໃຫຍ່ VinFuture 2024;

● ດຣ. Vinton Gray Cerf, Google, USA, ຫນຶ່ງໃນ “ພໍ່ຂອງອິນເຕີເນັດ”; ຮ່ວມກັນໄດ້ຮັບລາງວັນໃຫຍ່ VinFuture 2022;

ສາດສະດາຈານ Geoffrey Hinton, ມະຫາວິທະຍາໄລ Toronto, ປະເທດການາດາ, ຜູ້ຊະນະລາງວັນໂນແບລດ້ານຟີຊິກສາດປີ 2024 ແລະໄດ້ຮັບກຽດເປັນ “ພໍ່ຂອງ AI”; ຜູ້ຮ່ວມຊະນະເລີດ VinFuture Main Prize 2024;

ທີ່ມາ: https://vietnamnet.vn/nhung-bo-nao-xuat-sac-nhat-the-gioi-dang-chuan-bi-do-bo-viet-nam-2465795.html

![[ຮູບພາບ] ທ່ານນາຍົກລັດຖະມົນຕີ ຟ້າມບິ່ງມິງ ໄດ້ເຂົ້າຮ່ວມກອງປະຊຸມປະກອບສ່ວນຮັກຊາດຂອງຂະແໜງການທະນາຄານ](/_next/image?url=https%3A%2F%2Fvphoto.vietnam.vn%2Fthumb%2F1200x675%2Fvietnam%2Fresource%2FIMAGE%2F2025%2F11%2F24%2F1763981997729_tt-nhnn-jpg.webp&w=3840&q=75)

![[ຮູບພາບ] ທ່ານປະທານສະພາແຫ່ງຊາດ ເຈີ່ນດ້າຍກວາງ ຕ້ອນຮັບຄະນະຜູ້ແທນວິສາຫະກິດ ເອີລົບ - ອາຊຽນ.](/_next/image?url=https%3A%2F%2Fvphoto.vietnam.vn%2Fthumb%2F1200x675%2Fvietnam%2Fresource%2FIMAGE%2F2025%2F11%2F24%2F1763989198212_ndo_br_bnd-7394-jpg.webp&w=3840&q=75)

![[ຮູບພາບ] ຖັດຈາກ "ພູຖັງຂີ້ເຫຍື້ອ" ຫຼັງຈາກນ້ຳຖ້ວມ, ຊາວເມືອງ Tuy Hoa ມານະພະຍາຍາມຟື້ນຟູຊີວິດຂອງຕົນ.](/_next/image?url=https%3A%2F%2Fvphoto.vietnam.vn%2Fthumb%2F1200x675%2Fvietnam%2Fresource%2FIMAGE%2F2025%2F11%2F24%2F1763951389752_image-1-jpg.webp&w=3840&q=75)

(0)