ຕ້ອງການອອກແບບກົນໄກການຄຸ້ມຄອງ AI ທີ່ທັນສະໄຫມ, synchronous

ສະແດງຄວາມເຫັນດີເຫັນພ້ອມກ່ຽວກັບວິທີຮ່າງກົດໝາຍສະບັບນີ້ເປັນຂອບກົດໝາຍຄຸ້ມຄອງ ແລະ ຊຸກຍູ້ການຄົ້ນຄວ້າ, ພັດທະນາ, ຜັນຂະຫຍາຍ ແລະ ນຳໃຊ້ປັນຍາປະດິດຢູ່ຫວຽດນາມ, ບັນດາຜູ້ແທນສະພາແຫ່ງຊາດໄດ້ຕີລາຄາສູງການກະກຽມຂອງລັດຖະບານ; ຮ່າງເອກະສານກົດໝາຍໄດ້ຮັບການກໍ່ສ້າງຢ່າງລະອຽດ, ຮັບປະກັນຄວາມເປັນລະບຽບຮຽບຮ້ອຍ; ພ້ອມກັນນັ້ນ, ການສະເໜີຍົກເລີກບາງມາດຕາ ແລະ ຂໍ້ກ່ຽວຂ້ອງໃນກົດໝາຍວ່າດ້ວຍອຸດສາຫະກຳ ເຕັກໂນໂລຊີດີຈີຕອນ ແມ່ນຈຳເປັນເພື່ອຫຼີກເວັ້ນການຊ້ອນແຝງ, ສ້າງພື້ນຖານນິຕິກຳທີ່ເປັນເອກະພາບໃນການຄຸ້ມຄອງ ແລະ ຊຸກຍູ້ການພັດທະນາ AI. ແນວໃດກໍດີ, ເພື່ອສຳເລັດໂຄງການກົດໝາຍສະບັບນີ້, ບັນດາຜູ້ແທນໄດ້ຮຽກຮ້ອງໃຫ້ຄະນະກຳມະການຮ່າງກົດໝາຍສືບຕໍ່ກວດກາ ແລະ ປັບປຸງ, ເພີ່ມເຕີມ ແລະ ຍົກເລີກບັນດາມາດຕາ ແລະ ມາດຕາຢ່າງເໝາະສົມ.

ພາບບັນຍາກາດກອງປະຊຸມກຸ່ມ 6 ໃນຕອນເຊົ້າວັນທີ 21 ພະຈິກ

ໂດຍສະເພາະກ່ຽວກັບຂອບເຂດລະບຽບການ ແລະ ວິຊາສະເພາະ, ທ່ານຮອງປະທານສະພາແຫ່ງຊາດ ຟ້າມບິ່ງມິງ ໃຫ້ຮູ້ວ່າ: ຕ້ອງສືບຕໍ່ຊີ້ແຈ້ງບັນຫານີ້. ເພາະວ່າ ປະຈຸບັນ, ບັນດາຂໍ້ກຳນົດກ່ຽວກັບ “ການເຄື່ອນໄຫວຄົ້ນຄ້ວາ” ໃນຮ່າງກົດໝາຍແມ່ນມີຄວາມສ່ຽງທີ່ຈະທັບຊ້ອນກັບບັນດາເນື້ອໃນທີ່ກົດໝາຍ ວ່າດ້ວຍວິທະຍາສາດ , ເຕັກໂນໂລຢີ ແລະ ນະວັດຕະກຳໄດ້ກຳນົດໄວ້ແລ້ວ. ໃນຂະນະນັ້ນ, ຮ່າງກົດໝາຍດັ່ງກ່າວຍັງບໍ່ທັນມີນະໂຍບາຍສະເພາະເພື່ອຊຸກຍູ້ການຄົ້ນຄ້ວາກ່ຽວກັບລະບົບປັນຍາປະດິດ, ແລະ ຍັງບໍ່ທັນກຳນົດວິຊາທີ່ປະຕິບັດກິດຈະກຳນີ້ຢ່າງຈະແຈ້ງ. ສະນັ້ນ, ບັນດາຜູ້ແທນໄດ້ສະເໜີໃຫ້ຊີ້ແຈງວ່າ ການເຄື່ອນໄຫວໃດຢູ່ໃນຂອບເຂດລະບຽບການຂອງກົດໝາຍ, ບັນດາການເຄື່ອນໄຫວພາຍໃຕ້ກົດໝາຍປະຈຸບັນ ເພື່ອຮັບປະກັນຄວາມເປັນໄປໄດ້, ສອດຄ່ອງ ແລະ ຫຼີກລ່ຽງການທັບຊ້ອນກັນ.

ທ່ານຮອງສະພາແຫ່ງຊາດຫວຽດນາມ ຟ້າມບິ່ງມິງ ( Lang Son ) ໃຫ້ຄຳເຫັນໃສ່ຮ່າງກົດໝາຍວ່າດ້ວຍປັນຍາທຽມ. ພາບ: ຮວ່າງ

ກ່ຽວກັບການອະທິບາຍຂໍ້ກຳນົດ, ທ່ານສະມາຊິກສະພາແຫ່ງຊາດຫວຽດນາມ Pham Trong Nghia ໄດ້ເອົາໃຈໃສ່ເປັນພິເສດເຖິງແນວຄວາມຄິດ “ແກ້ງແຍ້ງ” ໃນຮູບແບບປັນຍາປະດິດທົ່ວໄປ. ຜູ້ຕາງຫນ້າກ່າວວ່ານີ້ແມ່ນຄໍາສັບສະເພາະ, ຍັງບໍ່ທັນເປັນທີ່ນິຍົມ, ດັ່ງນັ້ນເນື້ອໃນຕ້ອງໄດ້ຮັບການກໍານົດຢ່າງຈະແຈ້ງເພື່ອອໍານວຍຄວາມສະດວກໃນການນໍາໃຊ້ແລະການບັງຄັບໃຊ້ກົດຫມາຍຕໍ່ມາ. ປະຈຸບັນຮ່າງກົດໝາຍດັ່ງກ່າວໄດ້ກຳນົດພຽງແຕ່ໜຶ່ງປະໂຫຍກກ່ຽວກັບຄະນະກຳມະການປັນຍາປະດິດແຫ່ງຊາດ, ເຊິ່ງບໍ່ໄດ້ສະແດງໃຫ້ເຫັນຢ່າງຈະແຈ້ງຄື: ຖານະດ້ານກົດໝາຍ; ໜ້າທີ່, ໜ້າທີ່, ອຳນາດ; ໂຄງປະກອບການຈັດຕັ້ງ, ກົນໄກການດຳເນີນງານ; ການພົວພັນກັບບັນດາກະຊວງແລະສາຂາ. ຕາມນັ້ນແລ້ວ, ຜູ້ແທນໄດ້ສະເໜີໃຫ້ຊີ້ແຈງຄວາມຈຳເປັນຂອງການສ້າງຕັ້ງສະຖາບັນນີ້, ພ້ອມກັນນັ້ນກໍຕີລາຄາຄວາມສອດຄ່ອງກັບນະໂຍບາຍປັບປຸງກົງຈັກຂອງພັກຕາມລະບຽບການຂອງພັກ. ໃນກໍລະນີທີ່ຈະສືບຕໍ່ຮັກສາມັນ, ມັນຈໍາເປັນຕ້ອງໄດ້ເພີ່ມເຕີມລະບຽບການຫຼືມອບຫມາຍໃຫ້ລັດຖະບານສະແດງໃຫ້ເຫັນບັນຫາຂ້າງເທິງນີ້ໂດຍລະອຽດ.

ກ່ຽວກັບບັນດາການກະທຳຕ້ອງຫ້າມ, ບັນດາຜູ້ແທນໃຫ້ຮູ້ວ່າ: ຮ່າງກົດໝາຍຍັງບໍ່ທັນກຳນົດບັນດາການກະທຳຕ້ອງຫ້າມ, ໃນຂະນະນີ້ແມ່ນ “ເຄື່ອງປ້ອງກັນທາງກົດໝາຍ” ສຳຄັນເພື່ອປົກປັກຮັກສາສິດທິມະນຸດ, ຮັບປະກັນການແຂ່ງຂັນທີ່ຍຸຕິທຳ ແລະ ສອດຄ່ອງກັບມາດຕະຖານສາກົນ. ໃນຂະນະນັ້ນ, ກົດໝາຍວ່າດ້ວຍປັນຍາປະດິດ (AI) ຂັ້ນສູງຂອງໂລກໄດ້ກຳນົດຢ່າງຈະແຈ້ງການກະທຳທີ່ຕ້ອງຫ້າມເຊັ່ນ: ການລ່ວງລະເມີດຂໍ້ມູນສ່ວນຕົວ, ການຈຳແນກແບບເປັນລະບົບ, ການນຳໃຊ້ AI ເພື່ອຈຸດປະສົງທີ່ເປັນອັນຕະລາຍ ແລະ ອື່ນໆ. ສະນັ້ນ, ຈຶ່ງສະເໜີໃຫ້ເພີ່ມມາດຕາແຍກຕ່າງຫາກກ່ຽວກັບການກະທຳທີ່ຕ້ອງຫ້າມ, ໂດຍອີງໃສ່ຫຼັກການຄື: ຄວາມໂປ່ງໃສ, ຄວາມປອດໄພ, ຄວາມຮັບຜິດຊອບ, ການກວດກາມະນຸດສະທຳ, ການຄວບຄຸມຢ່າງຍຸດຕິທຳ ແລະ ຄວາມບໍ່ເປັນທຳ.

ຕອນເຊົ້າວັນທີ 21/11, ທ່ານຜູ້ແທນສະພາແຫ່ງຊາດ ຫງວຽນທິຟຸກ (ເມືອງເຫ້ວ) ກ່າວຄຳເຫັນທີ່ກອງປະຊຸມປຶກສາຫາລືກຸ່ມດັ່ງກ່າວ.

ປະກອບຄຳເຫັນໃສ່ຮ່າງກົດໝາຍ, ບັນດາຜູ້ແທນສະພາແຫ່ງຊາດ ທ່ານນາງ ຫງວຽນທິສຸ (ນະຄອນ) ສຸມໃສ່ວິເຄາະບັນດາລະບຽບການກ່ຽວກັບພື້ນຖານໂຄງລ່າງ, ແຫຼ່ງຊັບພະຍາກອນມະນຸດ ແລະ ຂອບຈັນຍາບັນ AI - ເສົາຄ້ຳຫຼັກທີ່ກຳນົດປະສິດທິຜົນຂອງການປະຕິບັດກົດໝາຍໃນພາກປະຕິບັດ.

ພິເສດ, ໃນໝວດທີ III (ມາດຕາ 17 ແລະ 18) ຄຸ້ມຄອງພື້ນຖານໂຄງລ່າງປັນຍາປະດິດ, ບັນດາຜູ້ແທນໃຫ້ຮູ້ວ່າ: ແຜນທີ່ເສັ້ນທາງໃນການປະຕິບັດພື້ນຖານໂຄງລ່າງ AI ແຫ່ງຊາດ, ບົດບາດຂອງກະຊວງ, ສາຂາ, ທ້ອງຖິ່ນ ກໍ່ຄືວິສາຫະກິດ, ສະຖາບັນຄົ້ນຄວ້າໃນຂະບວນການກໍ່ສ້າງ ແລະດໍາເນີນງານຍັງບໍ່ທັນໄດ້ກໍານົດຢ່າງຈະແຈ້ງ. ບັນດາຜູ້ແທນໄດ້ສະເໜີເພີ່ມທະວີການຜັນຂະຫຍາຍແຜນການປະຕິບັດສະເພາະກ່ຽວກັບກຳນົດເວລາ, ຄວາມຮັບຜິດຊອບຂອງແຕ່ລະອົງການ ແລະ ກົນໄກຕິດຕາມກວດກາ ເພື່ອຮັບປະກັນຄວາມເປັນໄປໄດ້ເມື່ອກົດໝາຍປະກາດໃຊ້.

ກ່ຽວກັບການພັດທະນາຊັບພະຍາກອນມະນຸດ (ມາດຕາ 24), ຄະນະຜູ້ແທນ ຫງວຽນທິຊວຽດ ໃຫ້ຮູ້ວ່າ: ຮ່າງກົດໝາຍພຽງແຕ່ກໍານົດຈຸດປະສົງເທົ່ານັ້ນ, ແຕ່ບໍ່ມີກົນໄກໜູນຊ່ວຍຕົວຈິງໃຫ້ແກ່ບັນດາສະຖາບັນຝຶກອົບຮົມ ແລະ ນັກສຶກສາເຊັ່ນ: ທຶນຮອນ, ມາດຕະຖານການຝຶກອົບຮົມສາກົນ ຫຼື ບັນດາໂຄງການຮ່ວມກັບວິສາຫະກິດ ແລະ ສະຖາບັນຄົ້ນຄວ້າ. ສະນັ້ນ, ຕ້ອງເພີ່ມທະວີນະໂຍບາຍດ້ານການສຶກສາ, ສະຫນັບສະຫນູນການຝຶກອົບຮົມ ແລະ ຊຸກຍູ້ການພົວພັນຄູ່ຮ່ວມມືລະຫວ່າງພາກລັດ - ເອກະຊົນ.

ກ່ຽວກັບຂອບຈັນຍາບັນ AI ແຫ່ງຊາດ (ມາດຕາ 27), ບັນດາຜູ້ແທນຖືວ່າ: ລະບຽບການປະຈຸບັນມີພຽງແຕ່ຫຼັກການ ແລະ ຂາດກົນໄກໃນການຕິດຕາມ, ຕີລາຄາ ແລະ ຮັບມືກັບບັນດາການລະເມີດ, ສ້າງຄວາມຍາກລຳບາກໃນການຮັບປະກັນຄວາມຜູກມັດໃນພາກປະຕິບັດ; ໃນຂະນະດຽວກັນ, ຄໍາວ່າ "ຈັນຍາບັນ AI" ບໍ່ໄດ້ຖືກກໍານົດຢ່າງຊັດເຈນແລະບໍ່ໄດ້ມອບຫມາຍຄວາມຮັບຜິດຊອບສະເພາະໃຫ້ອົງການຈັດຕັ້ງແລະບຸກຄົນໃນເວລາທີ່ລະເມີດ. ສະນັ້ນ, ບັນດາຜູ້ແທນຈຶ່ງໄດ້ສະເໜີໃຫ້ປ່ຽນຄຳສັບ “ກວດກາ” ເປັນ “ສາທາລະນະ” ໃນລະບຽບການປັບປຸງຂອບຈັນຍາບັນ; ພ້ອມກັນນັ້ນ, ເພີ່ມທະວີບັນດາຂໍ້ກຳນົດກ່ຽວກັບການສ້າງຕັ້ງອົງການຈັນຍາບັນ AI ແຫ່ງຊາດ ຮັບຜິດຊອບຕິດຕາມ, ກວດກາ ແລະ ແກ້ໄຂບັນດາການກະທຳລະເມີດ; ກໍານົດພັນທະການປະຕິບັດຕາມສໍາລັບອົງການຈັດຕັ້ງແລະບຸກຄົນທີ່ພັດທະນາຫຼືປະຕິບັດລະບົບ AI ຄວາມສ່ຽງສູງ; ຢືນຢັນມູນຄ່າຜູກມັດທາງດ້ານກົດໝາຍຂອງຂອບດ້ານຈັນຍາບັນຂອງ AI, ໃນນັ້ນການລະເມີດສາມາດຖືກລົງໂທດທາງບໍລິຫານ ຫຼື ອາດຊະຍາກຳ; ແລະຊຸກຍູ້ການມີສ່ວນຮ່ວມຂອງອົງການຈັດຕັ້ງທາງສັງຄົມ, ນັກວິຊາການ, ແລະທຸລະກິດໃນກິດຈະກໍາການກໍ່ສ້າງແລະປະເມີນຜົນຈັນຍາບັນ AI. ທ່ານຜູ້ແທນ ຫງວຽນທິຊວນ ເນັ້ນໜັກວ່າ: “ພຽງແຕ່ເມື່ອບັນດາກົນໄກດັ່ງກ່າວໄດ້ຮັບການສຳເລັດແລ້ວ ຈຶ່ງສາມາດກຳນົດຂອບດ້ານຈັນຍາບັນ AI ໄດ້ຢ່າງມີປະສິດທິຜົນ, ຮັບປະກັນໃຫ້ເຕັກໂນໂລຢີພັດທະນາໄປຕາມທິດຖືກຕ້ອງ, ປອດໄພ ແລະ ເພື່ອປະຊາຊົນ.

ຄວາມຮັບຜິດຊອບແມ່ນຫຍັງເມື່ອ AI ເຮັດຜິດພາດ?

ປຶກສາຫາລືກ່ຽວກັບຮ່າງກົດໝາຍວ່າດ້ວຍປັນຍາປະດິດ, ທ່ານຮອງສະພາແຫ່ງຊາດ ຟ້າມຫງວ໋ຽດບິ່ງ (ນະຄອນ ເຫ້ວ) ໃຫ້ຮູ້ວ່າ: ປັນຍາປະດິດພວມສ້າງການປ່ຽນແປງຢ່າງເລິກເຊິ່ງໃນຂົງເຂດການແພດ, ຈາກການຜ່າຕັດ, ການວິນິດໄສເຖິງການຄົ້ນຄວ້າວິທະຍາສາດ. ຜູ້ແທນກ່າວວ່າການຜ່າຕັດທາງໄກໄດ້ປະກົດຕົວມາເປັນເວລາຫຼາຍກວ່າ 20 ປີ, ແລະມາຮອດປັດຈຸບັນ, ລະບົບຫຸ່ນຍົນຈໍານວນຫຼາຍສາມາດປະຕິບັດການຜ່າຕັດ endoscopic ໂດຍບໍ່ມີການແຊກແຊງໂດຍກົງຈາກມະນຸດ. ດ້ວຍການພັດທະນາຢ່າງໄວວາຂອງເຕັກໂນໂລຢີ, ຖ້າອະນຸຍາດໃຫ້, AI ສາມາດປະຕິບັດຂັ້ນຕອນການຜ່າຕັດຢ່າງສົມບູນ, ເຖິງແມ່ນວ່າຈະຂົ່ມຂູ່ທີ່ຈະປ່ຽນບົດບາດແບບດັ້ງເດີມຂອງແພດຜ່າຕັດ. ໃນການວິນິດໄສຮູບພາບ, AI ໄດ້ຖືກນໍາໃຊ້ຢ່າງກວ້າງຂວາງໃນໂຮງຫມໍ, ລວມທັງໂຮງຫມໍສູນກາງ Hue, ສະຫນັບສະຫນູນການອ່ານ X-rays, CT scans, ແລະຮູບເງົາສະຫມອງ.

ທ່ານຜູ້ແທນສະພາແຫ່ງຊາດ ຟ້າມບິ່ງຮີບ (ນະຄອນເຫ້ວ) ໄດ້ປະກອບຄຳເຫັນໃສ່ຮ່າງກົດໝາຍວ່າດ້ວຍປັນຍາປະດິດຢູ່ກຸ່ມ 6. ພາບ: ຮວ່າງ.

ຢ່າງໃດກໍ່ຕາມ, ບັນດາຜູ້ແທນໄດ້ເນັ້ນຫນັກເຖິງຄວາມຈໍາເປັນສໍາລັບຄວາມຮັບຜິດຊອບໃນເວລາທີ່ AI ເຮັດຜິດພາດ. ໃນປັດຈຸບັນ, ຜົນໄດ້ຮັບ AI ທັງຫມົດຍັງຕ້ອງໄດ້ຮັບການກວດສອບແລະກວດສອບໂດຍແພດຫມໍແລະ radiologists. ເມື່ອຜົນໄດ້ຮັບບໍ່ກົງກັບຄວາມເປັນຈິງທາງດ້ານຄລີນິກ, ທ່ານຫມໍຈະແກ້ໄຂແລະປັບປຸງໃຫ້ເຂົາເຈົ້າເພື່ອໃຫ້ AI ສືບຕໍ່ຮຽນຮູ້. ຂະບວນການ "ການຮຽນຮູ້ແບບຕົວຕັ້ງຕົວຕີ" ນີ້ໄດ້ຖືກ ນຳ ໃຊ້ໂດຍໂຮງ ໝໍ ຫຼາຍແຫ່ງ, ແຕ່ກອບດ້ານກົດ ໝາຍ ທີ່ຈະແຈ້ງແມ່ນຍັງຕ້ອງການເພື່ອຮັບປະກັນຄວາມປອດໄພຂອງຄົນເຈັບ.

ຄະນະຜູ້ແທນ Pham Nhu Hiep ຍັງໄດ້ສະແດງຄວາມເປັນຫ່ວງກ່ຽວກັບຜົນກະທົບຂອງ AI ຕໍ່ການຄົ້ນຄວ້າວິທະຍາສາດ, ຍ້ອນວ່າຊອບແວການກວດສອບການລ່ວງລະເມີດໄດ້ກາຍເປັນທີ່ນິຍົມແລະບາງເຄື່ອງມື AI ປະຈຸບັນສາມາດຂຽນບົດວິທະຍານິພົນປະລິນຍາເອກເກືອບທັງຫມົດພາຍໃນມື້ດຽວໂດຍອີງໃສ່ຂໍ້ມູນທີ່ສະຫນອງໃຫ້. ສິ່ງດັ່ງກ່າວເປັນສິ່ງທ້າທາຍອັນໃຫຍ່ຫຼວງຕໍ່ຈັນຍາບັນຂອງການຄົ້ນຄວ້າ ແລະ ຄວາມຊື່ສັດທາງວິທະຍາສາດ, ແລະ ຄວນຖືກພິຈາລະນາລວມເຂົ້າໃນລະບຽບກົດໝາຍສະເພາະ.

ກ່ຽວກັບຄວາມຮັບຜິດຊອບທາງດ້ານກົດຫມາຍຂອງຜູ້ໃຫ້ບໍລິການ AI (ມາດຕາ 13), ບັນດາຜູ້ແທນໄດ້ສະເຫນີໃຫ້ຊີ້ແຈງເຖິງຫນ່ວຍງານທີ່ຮັບຜິດຊອບໃນເວລາທີ່ລະບົບ AI ເຮັດໃຫ້ເກີດເຫດການຫຼືອຸປະຕິເຫດ. ກໍລະນີຂອງລົດທີ່ຂັບລົດຕົນເອງເປັນຕົວຢ່າງປົກກະຕິ: ຖ້າການປະທະກັນເກີດຂື້ນ, ມັນຈໍາເປັນຕ້ອງກໍານົດຄວາມຮັບຜິດຊອບຂອງລະບົບ, ຜູ້ຜະລິດຫຼືຫນ່ວຍງານຄຸ້ມຄອງການດໍາເນີນງານ. ຜູ້ແທນໄດ້ອ້າງເຖິງອຸປະຕິເຫດລົດ Tesla ໃນປີ 2015 ທີ່ບັງຄັບໃຫ້ຜູ້ຜະລິດຕ້ອງຈ່າຍຄ່າຊົດເຊີຍຂະຫນາດໃຫຍ່, ຢືນຢັນວ່າ AI ບໍ່ສາມາດຮັບຜິດຊອບດ້ວຍຕົນເອງ, ແຕ່ຄວາມຮັບຜິດຊອບຕ້ອງເປັນຂອງມະນຸດ - ອົງການຈັດຕັ້ງແລະບຸກຄົນທີ່ອອກແບບ, ຜະລິດແລະວາງລະບົບດັ່ງກ່າວ.

ໂດຍອ້າງອີງໃສ່ແນວຄວາມຄິດຂອງຈັນຍາບັນ AI, ເຊິ່ງໄດ້ນໍາໃຊ້ໂດຍຫຼາຍປະເທດເພື່ອກໍານົດສິ່ງທີ່ AI ໄດ້ຮັບການອະນຸຍາດແລະບໍ່ອະນຸຍາດໃຫ້ປະຕິບັດ, ຜູ້ແທນ Pham Nhu Hiep ຍັງຍອມຮັບວ່າໃນສະພາບການຂອງລະບົບ AI ມີຄວາມສາມາດຮຽນຮູ້ດ້ວຍຕົນເອງ, ຄິດຕົນເອງແລະຍັງເກີນຂອບເຂດຈໍາກັດຕົ້ນສະບັບຂອງຜູ້ຜະລິດ, ການພັດທະນາແລະການດໍາເນີນງານຂອງ AI ຕ້ອງຖືກວາງໄວ້ໃນຂອບທາງດ້ານກົດຫມາຍແລະທາງດ້ານກົດຫມາຍ. ນີ້ແມ່ນບໍ່ພຽງແຕ່ຮັບປະກັນຄວາມປອດໄພໃຫ້ແກ່ສັງຄົມເທົ່ານັ້ນ, ຫາກຍັງເປັນການສ້າງພື້ນຖານໃຫ້ແກ່ການພັດທະນາຂະແໜງການ AI ຢູ່ ຫວຽດນາມ ຢ່າງເຂັ້ມແຂງ.

ເພື່ອຄຸ້ມຄອງ AI ໃຫ້ມີປະສິດຕິຜົນ, ຂໍ້ມູນປ້ອນຂໍ້ມູນ ແລະຊັບສິນທາງປັນຍາຕ້ອງມີຄວາມຊັດເຈນ.

ເຫັນດີກັບຄຳເຫັນທີ່ກ່າວມານີ້, ທ່ານຮອງປະທານສະພາແຫ່ງຊາດ Trinh Xuan An (Dong Nai) ໄດ້ປະກອບຄຳເຫັນຢ່າງເລິກເຊິ່ງກ່ຽວກັບຮ່າງກົດໝາຍວ່າດ້ວຍປັນຍາປະດິດ, ໂດຍສຸມໃສ່ບັນດາບັນຫາຕົ້ນຕໍຄື: ຂໍ້ມູນເຂົ້າ, ຊັບສິນທາງປັນຍາ, ຂອບເຂດການນຳໃຊ້, ວິທີການຄຸ້ມຄອງຄວາມສ່ຽງ ແລະ ຕົວແບບການຈັດຕັ້ງປະຕິບັດ.

ຕອນເຊົ້າວັນທີ 21/11, ທ່ານຜູ້ແທນສະພາແຫ່ງຊາດ Trinh Xuan An (ດົ່ງນາຍ) ກ່າວຄຳເຫັນທີ່ກຸ່ມ 6.

ກ່ຽວກັບການປ້ອນຂໍ້ມູນສໍາລັບ AI, ບັນດາຜູ້ແທນກ່າວວ່າຂໍ້ມູນແມ່ນພື້ນຖານຂອງປັນຍາປະດິດ, ແຕ່ຮ່າງກົດຫມາຍບໍ່ໄດ້ຊີ້ແຈງເນື້ອໃນນີ້. ລະບຽບການກ່ຽວກັບຂໍ້ມູນປະຈຸບັນຢູ່ພາຍໃຕ້ກົດໝາຍຂໍ້ມູນ ແລະກົດໝາຍວ່າດ້ວຍການປົກປ້ອງຂໍ້ມູນສ່ວນຕົວ. ຖ້າບໍ່ໄດ້ກ່າວເຖິງໂດຍສະເພາະໃນກົດຫມາຍນີ້, ຢ່າງຫນ້ອຍຕ້ອງມີເອກະສານອ້າງອີງຢ່າງເຕັມທີ່. ບັນດາຜູ້ແທນໄດ້ເຫັນດີກັບຂໍ້ກໍານົດວ່າຂໍ້ມູນຕ້ອງ "ຖືກຕ້ອງ - ພຽງພໍ - ສະອາດ - ມີຊີວິດຢູ່", ແຕ່ໄດ້ເນັ້ນຫນັກເຖິງຄວາມຈໍາເປັນທີ່ຈະຕ້ອງເພີ່ມເງື່ອນໄຂທີ່ຂໍ້ມູນຕ້ອງໄດ້ຮັບການປັບປຸງເປັນລະບົບແລະຢ່າງຕໍ່ເນື່ອງ, ເພາະວ່ານີ້ແມ່ນເງື່ອນໄຂເພື່ອໃຫ້ AI ດໍາເນີນການຢ່າງມີປະສິດທິພາບແລະປອດໄພ.

ກ່ຽວກັບຊັບສິນທາງປັນຍາ, ທ່ານປະທານສະພາແຫ່ງຊາດ Trinh Xuan An ໃຫ້ຄຳເຫັນວ່າ, ເນື້ອໃນຂອງຮ່າງລັດຖະທຳມະນູນຍັງມີລັກສະນະພິເສດ, ໃນຂະນະທີ່ AI ແມ່ນຜະລິດຕະພັນຂອງມະນຸດ ແລະ ຕິດພັນກັບບັນດາບັນຫາລິຂະສິດ, ສິດເປັນເຈົ້າຂອງ, ຄວາມຮັບຜິດຊອບດ້ານກົດໝາຍ ແລະ ຈັນຍາບັນ. ຖ້າອົງປະກອບຂອງຊັບສິນທາງປັນຍາບໍ່ຊັດເຈນໃນກົດຫມາຍ, ການຄຸ້ມຄອງ AI ຈະມີຄວາມຫຍຸ້ງຍາກຫຼາຍ. ດັ່ງນັ້ນ, ຜູ້ແທນຈຶ່ງໄດ້ສະເໜີໃຫ້ປັບປຸງກົດໝາຍວ່າດ້ວຍຊັບສິນທາງປັນຍາ ແລະ ພ້ອມດຽວກັນນັ້ນກໍໃຫ້ການຄຸ້ມຄອງບັນຫາການເປັນເຈົ້າຂອງໃນກົດໝາຍສະບັບນີ້.

ກ່ຽວກັບຂອບເຂດຂອງຄໍາຮ້ອງສະຫມັກ, ຜູ້ແທນໄດ້ຊີ້ໃຫ້ເຫັນຄວາມບໍ່ສົມເຫດສົມຜົນໃນມາດຕາ 1 ເມື່ອກົດຫມາຍຍົກເວັ້ນການນໍາໃຊ້ AI ສໍາລັບການປ້ອງກັນຊາດ, ຄວາມປອດໄພ, cryptography, ແລະທາງປັນຍາ, ແຕ່ຂໍ້ຕໍ່ໄປນີ້ເປີດຄວາມເປັນໄປໄດ້ຂອງການປັບຕົວຖ້າຫາກວ່າລະບົບເຫຼົ່ານີ້ຖືກນໍາໃຊ້ເພື່ອຈຸດປະສົງອື່ນໆ. ໃນສະພາບແວດລ້ອມດິຈິຕອນ, ມັນເປັນການຍາກທີ່ຈະແຍກ AI ສໍາລັບຄວາມປອດໄພແລະການປ້ອງກັນແລະຈຸດປະສົງພົນລະເຮືອນ, ເນື່ອງຈາກວ່າ AI ພ້ອມກັນສາມາດສະຫນັບສະຫນູນໃນຢາປົວພະຍາດ, ອຸດສາຫະກໍາປ້ອງກັນ, ຫຼືລະບົບບໍ່ມີຄົນຂັບ. ດັ່ງນັ້ນ, ການຍົກເວັ້ນໂດຍພາກສະຫນາມແມ່ນບໍ່ເປັນໄປໄດ້. ຜູ້ແທນໄດ້ແນະນໍາການສ້າງກອບກົດລະບຽບທົ່ວໄປ, ແທນທີ່ຈະແບ່ງອອກຕາມຈຸດປະສົງຂອງການນໍາໃຊ້.

ຕອນເຊົ້າວັນທີ 21 ພະຈິກນີ້, ບັນດາຜູ້ແທນສະພາແຫ່ງຊາດແຂວງ ດົ່ງນາຍ ໄດ້ເຂົ້າຮ່ວມກອງປະຊຸມສົນທະນາກຸ່ມ 6.

ກ່ຽວກັບວິທີການຄຸ້ມຄອງ ແລະ ຈັດແບ່ງຄວາມສ່ຽງ, ຜູ້ແທນໃຫ້ຮູ້ວ່າ: ຮ່າງກົດໝາຍພວມ “ນຳໃຊ້” ຮູບແບບການຄຸ້ມຄອງເອີຣົບ, ສ້າງພາລະໜັກໜ່ວງທີ່ບໍ່ຈຳເປັນໃນສະພາບທີ່ ຫວຽດນາມ ຕ້ອງຊຸກຍູ້ການພັດທະນາ AI. ການຈັດປະເພດຄວາມສ່ຽງ 4 ລະດັບໃນຮ່າງແມ່ນມີຄວາມຊັບຊ້ອນ ແລະ ບໍ່ສອດຄ່ອງກັບກົດໝາຍວ່າດ້ວຍຄຸນນະພາບຜະລິດຕະພັນ. ຜູ້ແທນໄດ້ສະເຫນີໃຫ້ຈັດປະເພດພຽງແຕ່ສອງກຸ່ມ: ຜະລິດຕະພັນ AI ທີ່ມີຄວາມສ່ຽງແລະບໍ່ມີຄວາມສ່ຽງ, ແລະປະສົມປະສານການຄຸ້ມຄອງຄວາມສ່ຽງກັບການຄຸ້ມຄອງໂດຍອີງໃສ່ປະສິດທິພາບຜົນຜະລິດແລະຜົນກະທົບທາງດ້ານເສດຖະກິດ. ທ່ານຍັງກ່າວວ່າ, ລະບຽບການໃຫ້ວິສາຫະກິດປະເມີນຄວາມສ່ຽງດ້ວຍຕົນເອງ ແລະ ມອບໃຫ້ລັດຖະບານກຳນົດມາດຖານແມ່ນ “ປິດເຄິ່ງ, ເປີດເຄິ່ງ”, ຍາກທີ່ຈະປະຕິບັດໃນພາກປະຕິບັດ.

ກ່ຽວກັບຮູບແບບການຈັດຕັ້ງປະຕິບັດ, ທ່ານປະທານສະພາແຫ່ງຊາດ Trinh Xuan An ໄດ້ສະແດງຄວາມວິຕົກກັງວົນກ່ຽວກັບເລື່ອງສະເໜີສ້າງຕັ້ງກອງທຶນງົບປະມານພິເສດ ແລະ ສະພາແຫ່ງຊາດ ກ່ຽວກັບ AI. ອີງຕາມຜູ້ແທນ, ມັນຈໍາເປັນຕ້ອງພິຈາລະນາຢ່າງລະອຽດກ່ຽວກັບຄວາມຈໍາເປັນຂອງສະຖາບັນເຫຼົ່ານີ້, ຫຼີກເວັ້ນສະຖານະການ "ການສ້າງຕັ້ງກອງທຶນແລະຄະນະກໍາມະການສໍາລັບທຸກສິ່ງທຸກຢ່າງ" ແຕ່ມີປະສິດທິພາບຕໍ່າ. ຖ້າມີຄວາມຈໍາເປັນແທ້ໆ, ກອງທຶນ AI ຄວນຖືກລວມເຂົ້າໃນກອງທຶນທີ່ມີຢູ່, ຍົກເວັ້ນກໍລະນີພິເສດເຊັ່ນ: ກອງທຶນຮັບໃຊ້ການປ້ອງກັນຊາດແລະຄວາມປອດໄພ. ຜູ້ແທນກໍ່ໃຫ້ຂໍ້ສັງເກດວ່າ AI ຕ້ອງຕິດພັນກັບບັນດາການເຄື່ອນໄຫວເສດຖະກິດ ແລະ ຂໍ້ລິເລີ່ມຂອງວິສາຫະກິດ, ສະນັ້ນ ຮູບແບບການຄຸ້ມຄອງຕ້ອງປັບປຸງ ແລະ ມຸ່ງໄປເຖິງປະສິດທິຜົນຕົວຈິງ.

ຜູ້ແທນສະພາແຫ່ງຊາດ ບຸ່ຍຊວນທອງ (ດົງນາຍ)

ເຫັນດີກັບຄຳເຫັນທີ່ກ່າວມານີ້, ທ່ານນາງຮອງປະທານສະພາແຫ່ງຊາດ ຫງວຽນທິຢວານ ແລະ ບຸ່ຍຊວນທອງ (ດົ່ງນາຍ) ໄດ້ເນັ້ນໜັກເຖິງຂອບເຂດຈັນຍາບັນໃນການນຳໃຊ້ປັນຍາປະດິດ. ອີງຕາມຜູ້ແທນ Bui Xuan Thong, ຖ້າມັນຖືກກໍານົດວ່າຜູ້ໃຊ້ຕ້ອງຮັບຜິດຊອບຕໍ່ການຕັດສິນໃຈທີ່ເຮັດໂດຍ AI, ຄວາມຈິງແລ້ວການຕັດສິນໃຈສຸດທ້າຍແມ່ນຍັງເປັນມະນຸດ. AI ແມ່ນພຽງແຕ່ເຄື່ອງມືເພື່ອສະຫນອງຂໍ້ມູນອ້າງອີງ. ບຸກຄົນທີ່ຕັດສິນໃຈສຸດທ້າຍແມ່ນຮັບຜິດຊອບຕໍ່ການຕັດສິນໃຈນັ້ນ. ດັ່ງນັ້ນ, ກອບດ້ານຈັນຍາບັນຄວນສຸມໃສ່ຄວາມຮັບຜິດຊອບຂອງມະນຸດໃນການນໍາໃຊ້ຂໍ້ມູນຈາກ AI, ບໍ່ແມ່ນການກໍານົດວ່າ AI ຕ້ອງມີຄວາມຮັບຜິດຊອບ.

ກ່ຽວກັບບັນຫາການຈັດການລະເມີດ, ບັນດາຜູ້ແທນກ່າວວ່າ, ຮ່າງກົດໝາຍໂດຍທົ່ວໄປໄດ້ລະບຸວ່າສາມາດຈັດການທາງບໍລິຫານ, ພົນລະເຮືອນ, ຫຼືອາດຊະຍາກຳ, ແຕ່ບໍ່ແມ່ນຈະແຈ້ງກ່ຽວກັບຂອບເຂດຄວາມຮັບຜິດຊອບ. ສະນັ້ນ, ຄວນກຳນົດຢ່າງຈະແຈ້ງວ່າພຶດຕິກຳໃດຈະຂຶ້ນກັບຄວາມຮັບຜິດຊອບທາງອາຍາ, ພຶດຕິກຳໃດຈະຂຶ້ນກັບຄວາມຮັບຜິດຊອບບໍລິຫານ, ແລະ ຄວາມຮັບຜິດຊອບສະເພາະຂອງຜູ້ໃຫ້ບໍລິການ, ຜູ້ພັດທະນາ ແລະ ຜູ້ໃຊ້. ພ້ອມກັນນັ້ນ, ຍັງຕ້ອງໄດ້ເສີມຂະຫຍາຍພຶດຕິກຳທີ່ຕ້ອງຫ້າມ ແລະ ປັບປຸງຂອບເຂດນີ້ໃຫ້ຊັດເຈນ ທັງສ້າງເງື່ອນໄຂໃຫ້ແກ່ການພັດທະນາ AI ແລະ ກຳນົດຄວາມຮັບຜິດຊອບຂອງພາກສ່ວນທີ່ກ່ຽວຂ້ອງຢ່າງຈະແຈ້ງ.

ທີ່ມາ: https://daibieunhandan.vn/artificial-intelligence-must-operate-in-the-law-and-moral-system-10396524.html

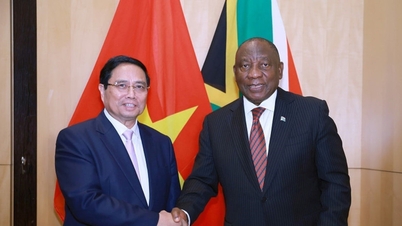

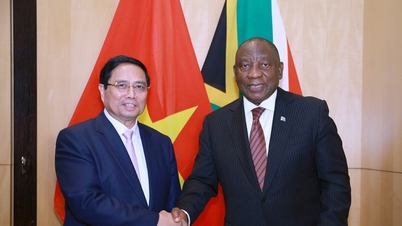

![[ຮູບພາບ] ທ່ານເລຂາທິການໃຫຍ່ To Lam ຕ້ອນຮັບປະທານສະພາສູງ ສເຊັກ Milos Vystrcil](/_next/image?url=https%3A%2F%2Fvphoto.vietnam.vn%2Fthumb%2F1200x675%2Fvietnam%2Fresource%2FIMAGE%2F2025%2F11%2F21%2F1763723946294_ndo_br_1-8401-jpg.webp&w=3840&q=75)

![[ຮູບພາບ] ໄປຢ້ຽມຢາມ Hung Yen ເພື່ອຊົມເຊີຍ "ພະຍາກອນໄມ້" ວັດຖຸບູຮານໃນໃຈກາງຂອງເຂດທົ່ງພຽງພາກເຫນືອ](/_next/image?url=https%3A%2F%2Fvphoto.vietnam.vn%2Fthumb%2F1200x675%2Fvietnam%2Fresource%2FIMAGE%2F2025%2F11%2F21%2F1763716446000_a1-bnd-8471-1769-jpg.webp&w=3840&q=75)

![[ຮູບພາບ] ທ່ານປະທານສະພາແຫ່ງຊາດ Tran Thanh Man ເຈລະຈາກັບປະທານສະພາສູງ ສ.ເຊັກໂກ Milos Vystrcil](/_next/image?url=https%3A%2F%2Fvphoto.vietnam.vn%2Fthumb%2F1200x675%2Fvietnam%2Fresource%2FIMAGE%2F2025%2F11%2F21%2F1763715853195_ndo_br_bnd-6440-jpg.webp&w=3840&q=75)

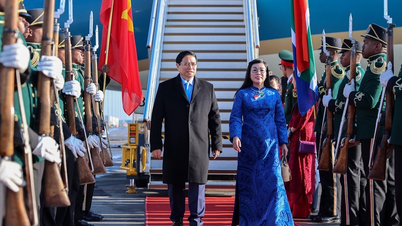

![[ຮູບພາບ] ທ່ານປະທານປະເທດ ເລືອງເກື່ອງ ໄດ້ຮັບຕ້ອນທ່ານປະທານສະພາແຫ່ງຊາດ ສເກົາຫຼີ Woo Won Shik](/_next/image?url=https%3A%2F%2Fvphoto.vietnam.vn%2Fthumb%2F1200x675%2Fvietnam%2Fresource%2FIMAGE%2F2025%2F11%2F21%2F1763720046458_ndo_br_1-jpg.webp&w=3840&q=75)

(0)