ທ່ານປະທານຄະນະກຳມະການວິທະຍາສາດ, ເຕັກໂນໂລຊີ ແລະ ສິ່ງແວດລ້ອມ ຫງວຽນແທ່ງຫາຍ ໄດ້ສະເໜີເພີ່ມບັນດາລະບຽບການຫ້າມນຳໃຊ້ AI ເພື່ອຈັດຕັ້ງການເລືອກຕັ້ງ, ເຮັດໃຫ້ເກີດຄວາມວຸ້ນວາຍ ທາງການເມືອງ , ປຸກລະດົມ, ຝ່າຝືນຄວາມໝັ້ນຄົງແຫ່ງຊາດ. ພາບ: Quochoi.vn

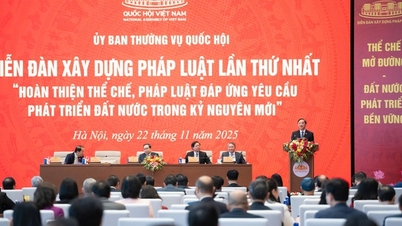

ວັນທີ 21 ພະຈິກ, ສືບຕໍ່ກອງປະຊຸມສະໄໝສາມັນເທື່ອທີ 10, ສະພາແຫ່ງຊາດ ໄດ້ຮັບຟັງບົດລາຍງານກ່ຽວກັບວຽກງານກວດກາໂຄງການກົດໝາຍວ່າດ້ວຍປັນຍາປະດິດ (AI).

ສະເໜີບົດລາຍງານກວດກາ, ທ່ານປະທານກຳມາທິ ການວິທະຍາສາດ , ເຕັກໂນໂລຊີ ແລະ ສິ່ງແວດລ້ອມຂອງສະພາແຫ່ງຊາດ ຫງວຽນແທ່ງຫາຍ ຖືວ່າ, ດ້ວຍທັດສະນະກໍ່ສ້າງກົດໝາຍເປັນກອບກົດໝາຍ, ໂດຍທົ່ວໄປແລ້ວ, ເນື້ອໃນສ່ວນຫຼາຍຂອງຮ່າງກົດໝາຍແມ່ນເໝາະສົມກັບເງື່ອນໄຂຕົວຈິງໃນໄລຍະຕົ້ນຂອງການພັດທະນາ AI ຢູ່ ຫວຽດນາມ ປະຈຸບັນ.

ເພື່ອຮັບປະກັນຄວາມເປັນໄປໄດ້ຂອງກົດໝາຍ, ຄະນະກຳມະການແນະນຳໃຫ້ອົງການຮ່າງເອົາໃຈໃສ່ບາງເນື້ອໃນຕື່ມອີກ, ເຊັ່ນ: ສືບຕໍ່ກວດກາຄືນ ແລະ ໃຫ້ສົມບູນແບບ ເພື່ອແນໃສ່ຮັບປະກັນໃຫ້ບັນດາລະບຽບການມີຄວາມຈະແຈ້ງ, ສອດຄ່ອງ, ມີຫຼັກການ ແລະ ທິດທາງເພື່ອສືບຕໍ່ສ້າງເອກະສານຊີ້ນຳ ແລະ ນຳໃຊ້ຢ່າງມີປະສິດທິຜົນ.

ສຳເລັດຮ່າງດຳລັດໃຫ້ລະອຽດ ແລະ ທິດທາງໃນການຈັດຕັ້ງປະຕິບັດ, ເອກະສານແນະນຳອື່ນໆທີ່ກ່ຽວຂ້ອງ ແລະ ອອກ ຫຼື ສະເໜີໃຫ້ລັດຖະບານອອກໃຫ້ທັນເວລາ ເພື່ອບໍ່ໃຫ້ເກີດຊ່ອງຫວ່າງທາງດ້ານກົດໝາຍ.

ກ່ຽວກັບລະບຽບການກວດກາກ່ອນການກວດກາ, ຄະນະກໍາມະການໄດ້ສະເຫນີໃຫ້ທົບທວນຄືນແລະຫຼຸດຜ່ອນລະບຽບການກວດກາກ່ອນເຊັ່ນ: ຂໍ້ກໍານົດຂອງເອກະສານດ້ານວິຊາການແລະບັນທຶກການດໍາເນີນງານກ່ອນທີ່ຈະວາງຜະລິດຕະພັນເຂົ້າໄປໃນການໄຫຼວຽນຂອງ, ເຊິ່ງຈະເຮັດໃຫ້ຄ່າໃຊ້ຈ່າຍໃນການປະຕິບັດຕາມ, ຊ້າລົງຂະບວນການປະດິດສ້າງແລະຄໍາຮ້ອງສະຫມັກ AI, ຫຼຸດຜ່ອນການແຂ່ງຂັນແລະການດຶງດູດການລົງທຶນ, ແລະຈໍາເປັນຕ້ອງໄດ້ສຶກສາການປ່ຽນແປງທີ່ເຂັ້ມແຂງກັບກົນໄກການກວດກາຫລັງ.

ກ່ຽວກັບລະບົບຖານຂໍ້ມູນລະບົບ AI ແຫ່ງຊາດ ແລະ ຖານຂໍ້ມູນການບໍລິການ AI, ຄະນະກຳມະການໄດ້ສະເໜີເພີ່ມຫຼັກການຫຼັກເພື່ອຮັບປະກັນຄຸນນະພາບຂອງຂໍ້ມູນການບໍລິການ AI ເຊັ່ນ: ຂໍ້ມູນຕ້ອງ “ຖືກຕ້ອງ-ພຽງພໍ-ສະອາດ-ມີຊີວິດ-ເອກະພາບ-ແບ່ງປັນ”.

ມີກົນໄກເຊື່ອມຕໍ່ກັນ ແລະ ແບ່ງປັນຂໍ້ມູນ ເພື່ອປ້ອງກັນບໍ່ໃຫ້ຂໍ້ມູນຖືກກະຈາຍ, ສ້າງຂໍ້ບົກຜ່ອງໃນການຄົ້ນຄວ້າ ແລະ ພັດທະນາ AI; ມີລະບຽບການບັງຄັບກ່ຽວກັບການຮັບປະກັນຄວາມປອດໄພເຄືອຂ່າຍ, ຄວາມປອດໄພຂໍ້ມູນແລະການປ້ອງກັນ ພື້ນຖານໂຄງລ່າງ AI ແຫ່ງຊາດ , ການປ້ອງກັນຄວາມສ່ຽງຂອງການ hijacking ແລະຂໍ້ມູນຮົ່ວໄຫລ.

ກ່ຽວກັບຄວາມຮັບຜິດຊອບທາງດ້ານກົດຫມາຍຂອງພາກສ່ວນທີ່ກ່ຽວຂ້ອງ, ການກະທໍາແລະຄວາມຜິດພາດທີ່ມະນຸດສາມາດປະຕິບັດໄດ້ໂດຍ AI. ໃນຂະນະດຽວກັນ, ມີຫຼາຍທັດສະນະທີ່ແຕກຕ່າງກັນກ່ຽວກັບຄວາມຮັບຜິດຊອບທາງດ້ານກົດຫມາຍຂອງ AI, ສະນັ້ນມັນຍາກທີ່ຈະກໍານົດຄວາມຮັບຜິດຊອບໃນຄວາມຫມາຍພື້ນເມືອງ. ເມື່ອເກີດເຫດການຈະເກີດຄວາມຂັດແຍ່ງກັນກ່ຽວກັບຄວາມຮັບຜິດຊອບດ້ານບໍລິຫານ, ທາງແພ່ງ, ແລະທາງອາຍາ.

ດັ່ງນັ້ນ, ມັນຈໍາເປັນຕ້ອງເພີ່ມຫຼັກການເພື່ອຈໍາແນກຄວາມຮັບຜິດຊອບລະຫວ່າງວິຊາແລະພາກສ່ວນທີ່ກ່ຽວຂ້ອງ, ລວມທັງຜູ້ສະຫນອງຕ່າງປະເທດ, ເມື່ອໃຫ້ບໍລິການ AI ຂ້າມຊາຍແດນແລະຈໍາແນກລະຫວ່າງກໍລະນີທີ່ຕັ້ງໃຈແລະບໍ່ຕັ້ງໃຈຫຼືຄວາມຜິດພາດເນື່ອງຈາກຂໍ້ຈໍາກັດດ້ານວິຊາການແລະສະຖານະການທີ່ບໍ່ສາມາດຄາດເດົາໄດ້.

ກ່ຽວກັບບັນດາການກະທຳຕ້ອງຫ້າມ, ຕາມທ່ານປະທານສະພາແຫ່ງຊາດ ຫງວຽນແທງຫາຍ, ໄດ້ສະເໜີເພີ່ມທະວີບັນດາຂໍ້ກຳນົດກ່ຽວກັບບັນດາການກະທຳຕ້ອງຫ້າມ ເພື່ອປະກອບສ່ວນຊີ້ນຳບັນດາການກະທຳລະເມີດແຕ່ຂັ້ນຕອນຄົ້ນຄວ້າເຖິງການຜັນຂະຫຍາຍການນຳໃຊ້ AI.

ອັນນີ້ຕ້ອງລວມເຖິງພຶດຕິກຳຂອງຜູ້ໃຊ້, ອົງກອນ ແລະ ບຸກຄົນຜູ້ທີ່ສວຍໃຊ້ AI ເພື່ອປະຕິບັດການຫ້າມໃນທິດທາງຕໍ່ໄປນີ້: ຫ້າມການນຳໃຊ້ AI ເພື່ອສ້າງຄວາມວຸ້ນວາຍ, ຍຸຍົງການເມືອງ, ລະເມີດຄວາມໝັ້ນຄົງແຫ່ງຊາດ, ໝູນໃຊ້ການລົງຄະແນນສຽງ ແລະ ການເລືອກຕັ້ງ;

ຫ້າມ ໃຊ້ AI ເພື່ອສ້າງເນື້ອຫາປອມ, ສ້າງຮູບພາບ, ວີດີໂອ, ຮັບໃຊ້ການສໍ້ໂກງ, ດູຖູກກຽດສັກສີ, ກຽດສັກສີ, ເຮັດໃຫ້ເກີດການແບ່ງແຍກ ແລະຈຸດປະສົງທີ່ບໍ່ດີອື່ນໆ.

ມ. ຮື

(0)