ໃນເດືອນທີ່ຜ່ານມາ, ຜູ້ຊ່ຽວຊານດ້ານຄວາມປອດໄພຂອງເດັກນ້ອຍແລະນັກຄົ້ນຄວ້າໄດ້ເຕືອນວ່າ AI ສ້າງສັນສາມາດເຮັດໃຫ້ເກີດການລ່ວງລະເມີດທາງອິນເຕີເນັດຫຼາຍຂຶ້ນ.

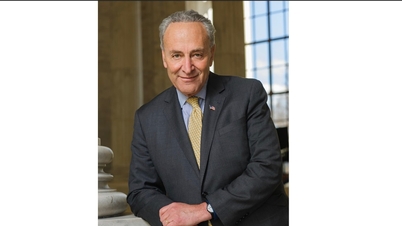

CEO ຂອງ Meta ທ່ານ Mark Zuckerberg ກ່າວຢູ່ໃນການໄຕ່ສວນຄະດີຂອງສະພາຕຸລາການຂອງສະພາສູງສະຫະລັດໃນວັນທີ 31 ມັງກອນ 2024, ຕໍ່ຫນ້າຝູງຊົນຂອງຜູ້ເຂົ້າຮ່ວມທີ່ຖືຮູບພາບທີ່ສ້າງຂຶ້ນໂດຍ AI. ພາບ: Reuters

NCMEC ຍັງບໍ່ທັນໄດ້ເປີດເຜີຍຈຳນວນບົດລາຍງານກ່ຽວກັບເນື້ອໃນການລ່ວງລະເມີດເດັກຈາກທຸກແຫຼ່ງທີ່ໄດ້ຮັບໃນປີ 2023. ແຕ່ໃນປີ 2022, ມັນໄດ້ຮັບລາຍງານກ່ຽວກັບບັນຫາປະມານ 88,3 ລ້ານໄຟລ໌.

ທ່ານ John Shehan, ຮອງປະທານຂອງ NCMEC ກ່າວວ່າ "ພວກເຮົາໄດ້ຮັບບົດລາຍງານຈາກບໍລິສັດ AI ທີ່ມີນະວັດກໍາຂອງຕົນເອງ, ເວທີ (ອອນໄລນ໌) ແລະສະມາຊິກສາທາລະນະ," John Shehan, ຮອງປະທານຂອງ NCMEC ກ່າວ.

CEOs ຂອງ Meta, X, TikTok, Snap ແລະ Discord ໄດ້ເປັນພະຍານຢູ່ໃນການພິຈາລະນາຄະດີຂອງວຽງຈັນຝົນຂອງສະຫະລັດກ່ຽວກັບຄວາມປອດໄພຂອງເດັກນ້ອຍໃນເວທີອອນໄລນ໌ໃນວັນພຸດ (31 ມັງກອນ). ສະມາຊິກສະພາສະຫະລັດໄດ້ຕັ້ງຄໍາຖາມກ່ຽວກັບບໍລິສັດສື່ມວນຊົນສັງຄົມກ່ຽວກັບຄວາມພະຍາຍາມຂອງພວກເຂົາເພື່ອປົກປ້ອງເດັກນ້ອຍຈາກ "ຜູ້ລ້າອອນໄລນ໌".

ນັກຄົ້ນຄວ້າທີ່ອົງການສັງເກດການອິນເຕີເນັດ Stanford ກ່າວໃນລາຍງານເມື່ອເດືອນມິຖຸນາທີ່ຜ່ານມາວ່າ AI ທົ່ວໄປສາມາດຖືກນໍາໃຊ້ໂດຍນັກສະແດງທີ່ບໍ່ດີເພື່ອທໍາຮ້າຍເດັກນ້ອຍໃນຊີວິດຈິງຫຼາຍຄັ້ງໂດຍການສ້າງຮູບພາບປອມຂອງພວກເຂົາ.

Fallon McNulty, ຜູ້ ອຳ ນວຍການ CyberTipline ຂອງ NCMEC, ເຊິ່ງເອົາບົດລາຍງານການຂູດຮີດເດັກນ້ອຍທາງອິນເຕີເນັດ, ກ່າວວ່າເນື້ອຫາທີ່ສ້າງໂດຍ AI ແມ່ນກາຍເປັນ "ຮູບຖ່າຍຫຼາຍຂື້ນ", ເຮັດໃຫ້ມັນຍາກທີ່ຈະ ກຳ ນົດວ່າຜູ້ເຄາະຮ້າຍແມ່ນຄົນທີ່ແທ້ຈິງ.

McNulty ກ່າວວ່າ OpenAI, ບໍລິສັດທີ່ສ້າງ ChatGPT, ໄດ້ສ້າງຕັ້ງຂະບວນການເພື່ອສົ່ງບົດລາຍງານໃຫ້ NCMEC, ແລະອົງການຈັດຕັ້ງກໍາລັງເຈລະຈາກັບບໍລິສັດ AI ອື່ນໆ.

ຮວ່າງຫາຍ (ຕາມ Reuters, FT)

ທີ່ມາ

![[ຮູບພາບ] 60 ປີແຫ່ງວັນສ້າງຕັ້ງສະມາຄົມນັກສິລະປິນຫວຽດນາມ](/_next/image?url=https%3A%2F%2Fvphoto.vietnam.vn%2Fthumb%2F1200x675%2Fvietnam%2Fresource%2FIMAGE%2F2025%2F12%2F05%2F1764935864512_a1-bnd-0841-9740-jpg.webp&w=3840&q=75)

![[ຮູບພາບ] ທ່ານປະທານສະພາແຫ່ງຊາດ ເຈີ່ນດ້າຍກວາງ ເຂົ້າຮ່ວມພິທີມອບລາງວັນ VinFuture 2025](/_next/image?url=https%3A%2F%2Fvphoto.vietnam.vn%2Fthumb%2F1200x675%2Fvietnam%2Fresource%2FIMAGE%2F2025%2F12%2F05%2F1764951162416_2628509768338816493-6995-jpg.webp&w=3840&q=75)

(0)