Het complexe beeld van het gebruik van AI-killerrobots

Door AI wapensystemen te laten besturen, kunnen doelen worden geïdentificeerd, aangevallen en vernietigd zonder menselijke tussenkomst. Dit roept serieuze juridische en ethische vragen op.

De ernst van de situatie benadrukkend, zei de Oostenrijkse minister van Buitenlandse Zaken Alexander Schallenberg: "Dit is het Oppenheimer-moment van onze generatie."

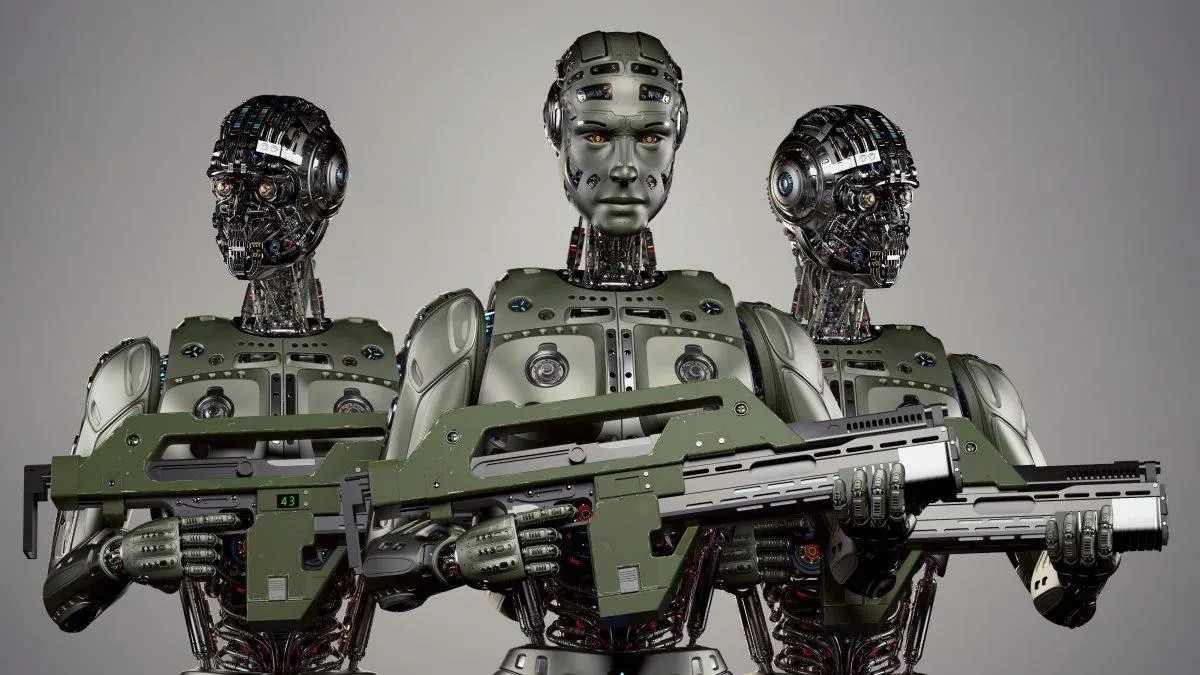

Robots en wapens die gebruikmaken van kunstmatige intelligentie worden steeds vaker gebruikt in de legers van veel landen. Foto: Forbes

De vraag in hoeverre de ‘geest uit de fles is’ is een prangende vraag geworden, aangezien drones en kunstmatige intelligentie (AI) steeds vaker door legers over de hele wereld worden gebruikt.

"Het gebruik van drones in moderne conflicten door Rusland en Oekraïne, het gebruik van drones door de VS bij gerichte aanvalsoperaties in Afghanistan en Pakistan en, zoals vorige maand onthuld, als onderdeel van het Israëlische Lavender-programma, laat zien hoe de informatieverwerkingscapaciteiten van AI actief worden gebruikt door 's werelds legers om hun aanvalskracht te vergroten", aldus Wilson Jones, defensieanalist bij GlobalData.

Onderzoek door het in Londen gevestigde Office of War Investigative Journalism wees uit dat het Lavender AI-systeem van het Israëlische leger een nauwkeurigheid van 90% had bij het identificeren van personen met Hamas-banden, wat betekent dat 10% dat niet had. Dit resulteerde in burgerdoden dankzij de identificatie- en besluitvormingscapaciteiten van de AI.

Een bedreiging voor de mondiale veiligheid

Door AI op deze manier in te zetten, wordt de noodzaak van technologiebeheer in wapensystemen benadrukt.

"Het gebruik van AI in wapensystemen, vooral wanneer gebruikt voor doelgerichte aanvallen, roept fundamentele vragen op over ons – mensen – en onze relatie tot oorlog , en meer specifiek onze aannames over hoe we geweld zouden kunnen gebruiken in gewapende conflicten", legde Dr. Alexander Blanchard, senior onderzoeker in het programma Governance of Artificial Intelligence aan het Stockholm International Peace Research Institute (SIPRI), een onafhankelijke onderzoeksgroep gericht op wereldwijde veiligheid, uit aan Army Technology.

AI-systemen kunnen zich onvoorspelbaar gedragen in chaotische omgevingen en kunnen er mogelijk niet in slagen doelen nauwkeurig te identificeren. Foto: MES

"Verandert AI de manier waarop het leger doelen selecteert en geweld gebruikt? Deze veranderingen roepen op hun beurt een scala aan juridische, ethische en operationele vragen op. De grootste zorgen zijn van humanitaire aard", voegde Dr. Blanchard eraan toe.

"Velen maken zich zorgen dat, afhankelijk van hoe autonome systemen zijn ontworpen en gebruikt, ze burgers en anderen die door het internationaal recht worden beschermd, een groter risico op letsel kunnen opleveren", legde de SIPRI-expert uit. "Dit komt doordat AI-systemen, vooral in chaotische omgevingen, onvoorspelbaar kunnen opereren en mogelijk niet nauwkeurig doelen kunnen identificeren en burgers aanvallen, of strijders die niet in gevecht zijn, kunnen identificeren."

Wilson Jones, defensieanalist bij GlobalData, gaf aan dat de manier waarop schuld wordt vastgesteld, discutabel kan zijn.

"Onder het huidige oorlogsrecht bestaat er een concept van bevelsverantwoordelijkheid", aldus Jones. "Dit betekent dat een officier, generaal of andere leider wettelijk verantwoordelijk is voor de acties van troepen onder zijn bevel. Als troepen oorlogsmisdaden plegen, is de officier verantwoordelijk, zelfs als hij de bevelen niet heeft gegeven; de bewijslast ligt bij hem om aan te tonen dat hij er alles aan heeft gedaan om oorlogsmisdaden te voorkomen."

"Bij AI-systemen maakt dit de zaken ingewikkelder. Is een IT-technicus verantwoordelijk? Een systeemontwerper? Het is onduidelijk. Als het onduidelijk is, ontstaat er een moreel risico als actoren denken dat hun acties niet beschermd worden door de bestaande wetgeving", benadrukte Jones.

Een Amerikaanse soldaat patrouilleert met een robothond. Foto: Forbes

Wapenbeheersingsverdragen. Verschillende belangrijke internationale overeenkomsten beperken en reguleren bepaalde wapentoepassingen. Er zijn verboden op chemische wapens, verdragen tegen de verspreiding van kernwapens en het Verdrag inzake bepaalde conventionele wapens, dat het gebruik van specifieke wapens verbiedt of beperkt, omdat deze wapens onnodig of ongerechtvaardigd leed veroorzaken aan strijdende partijen of burgers zonder onderscheid treffen.

"Kernwapenbeheersing vereiste decennia van internationale samenwerking en daaropvolgende verdragen om te worden gehandhaafd", legt defensieanalist Wilson Jones uit. "Zelfs toen gingen we door met atmosferische testen tot in de jaren negentig. Een belangrijke reden voor het succes van de non-proliferatie van kernwapens was de samenwerking tussen de Verenigde Staten en de Sovjet-Unie in de bipolaire wereldorde. Die bestaat niet meer, en de technologie die AI creëert, is voor veel landen toegankelijker dan kernenergie."

Een bindend verdrag zou alle relevante spelers aan tafel moeten brengen om af te spreken een instrument te gebruiken dat hun militaire macht vergroot. Dat zal waarschijnlijk niet werken, omdat AI de militaire effectiviteit kan verbeteren tegen minimale financiële en materiële kosten.

Huidige geopolitieke vooruitzichten

Hoewel landen binnen de Verenigde Naties de noodzaak van verantwoord militair gebruik van AI hebben erkend, moet er nog veel werk worden verzet.

"Zonder een duidelijk regelgevingskader blijven deze claims grotendeels ambitieus", vertelde Laura Petrone, hoofdanalist bij GlobalData, aan Army Technology. "Het is geen verrassing dat sommige landen hun eigen soevereiniteit willen behouden bij beslissingen over binnenlandse defensie en nationale veiligheid, vooral in het huidige geopolitieke klimaat."

Mevrouw Petrone voegde eraan toe dat de EU-AI-wet weliswaar een aantal vereisten voor AI-systemen stelt, maar dat deze geen betrekking heeft op AI-systemen voor militaire doeleinden.

"Ik denk dat de AI-wet, ondanks deze uitsluiting, een belangrijke poging is om een langverwacht kader voor AI-toepassingen te creëren, wat in de toekomst tot een zekere mate van uniformiteit van relevante normen zou kunnen leiden", merkte ze op. "Deze uniformiteit zal ook belangrijk zijn voor AI in het militaire domein."

Nguyen Khanh

Bron: https://www.congluan.vn/moi-nguy-robot-sat-thu-ai-dang-de-doa-an-ninh-toan-cau-post304170.html

Reactie (0)