Sora (OpenAI)

Sora to najnowsza ogłoszona nazwa, która jednak wzbudziła najwięcej zamieszania. Częściowo dlatego, że jest produktem OpenAI — znanego twórcy ChatGPT — ale głównie ze względu na jakość filmów tworzonych przez program za pomocą samych poleceń tekstowych.

Sukces firmy z ChatGPT zapewnia jej sztucznej inteligencji dogłębne rozumienie języka. Klipy demonstrujące możliwości Sory pokazują postaci poruszające się i wyrażające siebie w sposób równie realistyczny, jak film nakręcony z udziałem człowieka.

„Surrealistyczny” film stworzony przez Sorę z poleceń tekstowych

Jednak ze względów bezpieczeństwa Sora nie jest jeszcze dostępna do użytku publicznego. OpenAI podejmie odpowiednie środki ostrożności przed udostępnieniem jej publicznie, zwłaszcza biorąc pod uwagę rosnącą liczbę użytkowników sztucznej inteligencji wykorzystywanych do niecnych celów, takich jak podszywanie się pod innych użytkowników lub popełnianie przestępstw.

Lumiere (Google)

Lumiere to produkt firmy Google, który umożliwia również generowanie filmów z tekstu, w oparciu o model dyfuzji struktury STUNet (Space-Time-U-Net). Lumiere nie zajmuje się łączeniem nieruchomych klatek, lecz zamiast tego, sztuczna inteligencja identyfikuje szczegóły w filmie (część przestrzenna), śledzi ich ruch i zmiany w tym samym czasie (część czasowa), wspomagając w ten sposób płynny przebieg procesu.

Podobnie jak Sora, Lumiere nie został jeszcze wprowadzony na rynek. Firma zaprezentowała ten model dopiero pod koniec stycznia 2024 roku, po premierze Gemini – rozbudowanego modelu językowego, który właśnie został zsynchronizowany z Bardem.

VideoPoet (Google)

Ten duży model językowy (LLM) jest trenowany na podstawie ogromnego repozytorium filmów, zdjęć, plików audio i tekstu opracowanego przez wyszukiwarkę Google w 2023 roku. VideoPoet może wykonywać różne zadania na podstawie źródeł danych wejściowych, takich jak tekst, zdjęcia, filmy... w celu tworzenia filmów, wyróżniania treści, konwersji filmów na dźwięk, przekształcania nieruchomych obrazów w animacje...

Pierwotny pomysł na VideoPoet zrodził się z potrzeby przetłumaczenia dowolnego autoregresyjnego modelu językowego na system generowania wideo. Obecne autoregresyjne modele językowe potrafią przetwarzać tekst i kod programistyczny jak ludzie, ale mają problemy z przetwarzaniem wideo. VideoPoet rozwiązuje ten problem, stosując tokenizację do tłumaczenia danych wejściowych z dowolnego formatu na zrozumiały język.

Narzędzia do tworzenia filmów z tekstu testują swoje granice

Emu Video (Meta)

Oprócz Google i OpenAI, Meta jest również jednym z największych graczy technologicznych aktywnie działających w obszarze sztucznej inteligencji. Firma będąca właścicielem Facebooka opracowała również sztuczną inteligencję do tworzenia filmów o nazwie Emu Video, która potrafi konwertować obrazy na tekst, a następnie wykorzystywać go jako dane do tworzenia klipów.

Emu Video zbiera pozytywne recenzje od beta testerów, z czego 81% preferuje go w porównaniu z Imagen Video (Google). Ponad 90% wybrało model Meta w porównaniu z PYOCO (Nvidia), nawet lepszy niż Make-A-Video Meta (96%).

CogVideo (Uniwersytet Tsinghua, Chiny)

W przeciwieństwie do powyższych modeli, które są produktami wiodących światowych firm technologicznych, CogVideo to sztuczna inteligencja opracowana przez zespół badawczy z Uniwersytetu Tsinghua – prestiżowej uczelni w Chinach i Azji. Program opiera się na CogView2, wstępnie wytrenowanym modelu przetwarzania tekstu na obraz.

Ekspert w dziedzinie sztuki komputerowej Glenn Marshall, który testował CogVideo, powiedział, że „reżyserzy mogą stracić pracę”. Jego klip zatytułowany The Crow , stworzony za pomocą CogVideo, spotkał się z dużym uznaniem i został nominowany do nagrody Brytyjskiej Akademii Filmowej (BAFTA).

Link źródłowy

![[Zdjęcie] Lam Dong: Zbliżenie nielegalnego jeziora z uszkodzoną ścianą](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/11/03/1762166057849_a5018a8dcbd5478b1ec4-jpg.webp)

![[Zdjęcie] Sekretarz generalny To Lam przyjmuje ambasadora Singapuru Jayę Ratnam](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/11/03/1762171461424_a1-bnd-5309-9100-jpg.webp)

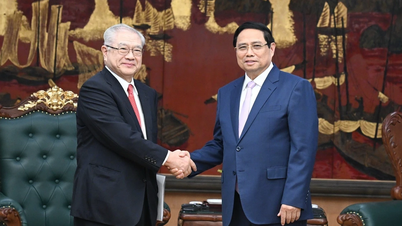

![[Zdjęcie] Premier Pham Minh Chinh przyjmuje przewodniczącego Stowarzyszenia Przyjaźni Japońsko-Wietnamskiej w regionie Kansai](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/11/03/1762176259003_ndo_br_dsc-9224-jpg.webp)

Komentarz (0)