Se você já navegou pelas redes sociais, provavelmente se deparou com imagens ou vídeos criados por IA. Muitas pessoas foram enganadas, como no vídeo viral de coelhos pulando em uma cama elástica. Mas o Sora – um aplicativo irmão do ChatGPT, desenvolvido pela OpenAI – está elevando os vídeos com IA a um novo patamar, tornando a detecção de conteúdo falso cada vez mais urgente.

As ferramentas de IA para vídeo estão tornando mais difícil do que nunca identificar vídeos genuínos. (Fonte: CNET)

Lançado em 2024 e recentemente atualizado com o Sora 2, este aplicativo tem uma interface semelhante à do TikTok, onde todos os vídeos são gerados por inteligência artificial. O recurso "cameo" permite que pessoas reais sejam inseridas em filmagens simuladas, criando vídeos assustadoramente realistas.

Portanto, muitos especialistas temem que o Sora cause a disseminação de deepfakes, distorcendo informações e tornando tênue a linha entre realidade e ficção. Celebridades são particularmente vulneráveis, levando organizações como o SAG-AFTRA a pedir à OpenAI que reforce a proteção contra a pirataria.

Identificar conteúdo gerado por IA é um grande desafio para empresas de tecnologia, plataformas de mídia social e usuários. Mas existem maneiras de reconhecer vídeos criados com o Sora.

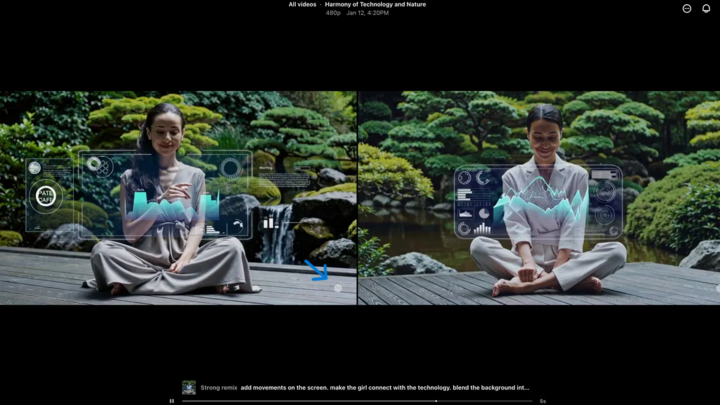

Encontre a marca d'água Sora

A marca d'água Sora (indicada pela seta azul) é um marcador que identifica a ferramenta usada para criar o vídeo. (Fonte: CNET)

Todos os vídeos criados no aplicativo Sora para iOS têm uma marca d'água ao serem baixados – o logotipo branco da Sora (ícone de nuvem) se move ao redor das bordas do vídeo, semelhante à marca d'água do TikTok.

Esta é uma forma visual de identificar conteúdo gerado por IA. Por exemplo, o modelo "nano-banana" Gemini do Google também adiciona automaticamente uma marca d'água às imagens. No entanto, as marcas d'água nem sempre são confiáveis. Se a marca d'água for estática, ela pode ser facilmente recortada. Mesmo marcas d'água dinâmicas, como a do Sora, podem ser removidas usando aplicativos especializados.

Questionado sobre isso, o CEO da OpenAI, Sam Altman, argumentou que a sociedade precisa se adaptar à realidade de que qualquer pessoa pode criar vídeos falsos. Antes do Sora, nunca existiu uma ferramenta tão popular, acessível e que não exigisse nenhuma habilidade para criar tais vídeos. Sua perspectiva destaca a necessidade de se recorrer a métodos alternativos de verificação.

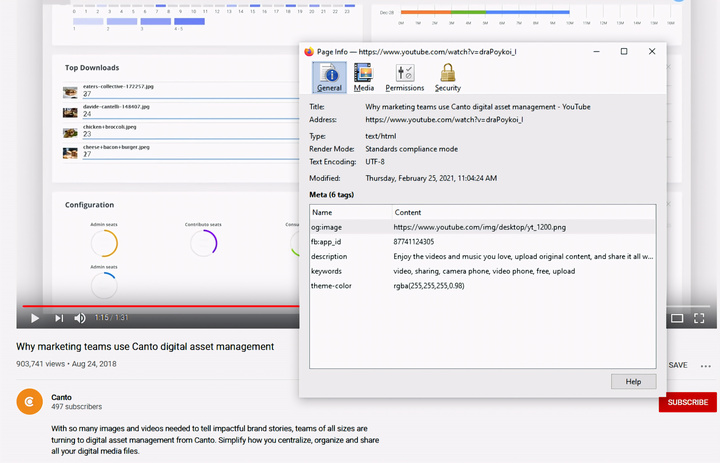

Verificar metadados

Verificar metadados é uma etapa crucial para determinar se um vídeo foi criado por IA, como o Sora. (Fonte: Canto)

Você pode achar que verificar metadados é muito complicado, mas na verdade é bem simples e muito eficaz.

Metadados são um conjunto de informações anexadas automaticamente ao conteúdo quando ele é criado, como tipo de câmera, localização, horário da gravação e nome do arquivo. Independentemente de o conteúdo ser gerado por humanos ou por IA, ele possui metadados. No caso de conteúdo gerado por IA, os metadados geralmente incluem informações de atribuição da fonte.

A OpenAI é membro da Coalizão para Origem e Autenticidade de Conteúdo (C2PA), portanto, os vídeos da Sora contêm metadados C2PA. Você pode verificar isso usando a ferramenta de verificação da iniciativa de autenticidade de conteúdo:

Como verificar os metadados:

- Acesse verify.contentauthenticity.org

- Faça o upload do arquivo para verificação.

- Pressione “Abrir”

- Veja as informações na tabela à direita.

Se o vídeo foi criado por IA, o resumo indicará isso claramente. Ao verificar vídeos do Sora, você verá a frase "publicado pela OpenAI" e informações confirmando que o vídeo foi criado usando IA. Todos os vídeos do Sora devem conter essas informações para que sua origem seja verificada.

Fonte: https://vtcnews.vn/cach-nhan-biet-video-that-hay-do-ai-tao-ar972891.html

![[Foto] O calor no local do espetáculo de fogos de artifício na noite de abertura do Festival Internacional de Fogos de Artifício de Da Nang 2026](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2026/05/27/1779889741485_ndo_br_z7872039145157-fecaba5112f39e8352544099d7ef4738-5140-jpg.webp)

![[Foto] A coragem dos novos recrutas da Brigada 144 no campo de treinamento.](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2026/05/27/1779881651341_anh-man-hinh-2026-05-27-luc-18-32-52.png)

![[Foto] A coragem dos novos recrutas da Brigada 144 no campo de treinamento.](https://vphoto.vietnam.vn/thumb/402x226/vietnam/resource/IMAGE/2026/05/27/1779881651341_anh-man-hinh-2026-05-27-luc-18-32-52.png)

Comentário (0)