Após o lançamento do ChatGPT, o primeiro aplicativo de IA da startup OpenAI, no final de 2022, uma onda de desenvolvimento de aplicativos de IA, especialmente IA generativa, foi desencadeada, trazendo muitos benefícios para todos os aspectos da vida. No entanto, isso também acarreta muitos riscos.

Invasão de privacidade

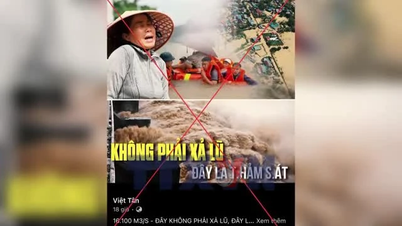

Nos últimos anos, muitas organizações e indivíduos sofreram perdas significativas devido ao uso de inteligência artificial por cibercriminosos para criar vídeos falsos que imitam as imagens e vozes de pessoas reais. Um exemplo clássico disso é o golpe Deepfake, que consiste em enganar a vítima, fazendo-a acreditar que a pessoa falsa é real.

De acordo com o Relatório de Fraude de Identidade publicado pela Sumsub no final de novembro de 2023, os golpes com deepfakes aumentaram dez vezes em todo o mundo nos dois anos entre 2022 e 2023. Este foi também o período em que os aplicativos gerados por IA explodiram em todo o mundo .

A Status Labs observa que a tecnologia Deepfake impactou significativamente a cultura, a privacidade e a reputação pessoal. Grande parte das notícias e da atenção em torno do Deepfake se concentrou em pornografia de celebridades, conteúdo de vingança, desinformação, notícias falsas, chantagem e golpes. Por exemplo, em 2019, uma empresa de energia dos EUA foi vítima de um golpe de US$ 243.000, no qual hackers se fizeram passar por líderes da empresa e suas vozes, exigindo que funcionários transferissem dinheiro para parceiros.

A Reuters informou que, em 2023, aproximadamente 500 mil arquivos de vídeo e áudio deepfake foram compartilhados nas redes sociais em todo o mundo. Além dos deepfakes criados por diversão, também existem golpes elaborados por pessoas mal-intencionadas para enganar o público. Algumas fontes indicam que, em 2022, os golpes com deepfakes causaram prejuízos estimados em US$ 11 milhões em todo o mundo.

Muitos especialistas em tecnologia têm alertado sobre os pontos negativos da IA, incluindo questões de direitos de propriedade intelectual e autenticidade, e ainda, disputas de propriedade intelectual entre "obras" criadas por IA. Por exemplo, alguém pode usar IA para pintar um quadro sobre um determinado tema, e outra pessoa também pode usar IA para fazer o mesmo, resultando em pinturas com muitas semelhanças.

Isso leva facilmente a disputas de propriedade. No entanto, até o momento, o mundo ainda não decidiu sobre o reconhecimento de direitos autorais para conteúdo gerado por IA (reconhecendo direitos autorais para indivíduos que encomendam a criação de IA ou para empresas que desenvolvem aplicativos de IA).

Uma imagem criada por um aplicativo de IA.

É difícil distinguir entre o genuíno e o falso.

Então, o conteúdo gerado por IA pode infringir direitos autorais? Tecnologicamente, o conteúdo gerado por IA é sintetizado por algoritmos a partir de dados com os quais foram treinados. Esses bancos de dados são coletados por desenvolvedores de aplicativos de IA de diversas fontes, principalmente da vasta base de conhecimento da internet. Muitas dessas obras já possuem direitos autorais pertencentes aos seus respectivos proprietários.

Em 27 de dezembro de 2023, o The New York Times entrou com um processo contra a OpenAI (com o ChatGPT) e a Microsoft, alegando que milhões de seus artigos foram usados para treinar chatbots e plataformas de IA dessas duas empresas. As evidências apresentadas incluíam conteúdo gerado pelos chatbots a pedido dos usuários, semelhante ou idêntico ao conteúdo dos artigos. O jornal não podia ignorar o fato de que sua propriedade intelectual estava sendo usada por essas empresas para obter lucro.

O The New York Times é o primeiro grande jornal americano a entrar com um processo judicial por violação de direitos autorais relacionado à IA. É possível que outros jornais também entrem com ações judiciais no futuro, especialmente após o sucesso do caso do The New York Times.

Anteriormente, a OpenAI firmou acordos de licenciamento com a Associated Press em julho de 2023 e com a Axel Springer – editora alemã proprietária da Politico e da Business Insider – em dezembro de 2023.

A atriz Sarah Silverman também se envolveu em diversos processos judiciais em julho de 2023, alegando que a Meta e a OpenAI usaram suas memórias como material de treinamento para programas de IA. Muitos escritores também expressaram preocupação após revelações de que sistemas de IA incorporaram dezenas de milhares de livros em seus bancos de dados, o que levou a processos judiciais movidos por autores como Jonathan Franzen e John Grisham.

Enquanto isso, a Getty Images, uma empresa de serviços fotográficos, também processou uma empresa de inteligência artificial por criar imagens com base em comandos de texto, supostamente por meio do uso não autorizado de material de imagem protegido por direitos autorais da empresa.

Os usuários podem enfrentar problemas de direitos autorais ao usarem "de forma descuidada" "obras" que encomendaram de ferramentas de IA. Especialistas sempre recomendam o uso de ferramentas de IA apenas para pesquisa, coleta de dados e sugestões para fins de referência.

Em outro ponto, as aplicações de IA confundem os usuários, dificultando a distinção entre conteúdo genuíno e falso. Editoras e redações podem ficar perplexas ao receber manuscritos. Professores também enfrentam dificuldades para saber se os trabalhos dos alunos utilizaram IA.

A comunidade agora terá que estar mais vigilante, pois é difícil distinguir entre conteúdo real e falso. Por exemplo, será difícil para a pessoa comum detectar se uma foto foi manipulada ou editada por IA.

São necessárias regulamentações legais relativas ao uso da IA.

Enquanto se aguarda o desenvolvimento de ferramentas capazes de detectar interferências de IA, os órgãos reguladores precisam estabelecer normas legais claras e específicas sobre o uso dessa tecnologia para a criação de conteúdo original. Essas normas devem indicar claramente ao público quais conteúdos ou obras foram manipulados por IA, por exemplo, adicionando, por padrão, uma marca d'água às imagens processadas por IA.

Fonte: https://nld.com.vn/mat-trai-cua-ung-dung-tri-tue-nhan-tao-196240227204333618.htm

![[Foto] O primeiro-ministro Pham Minh Chinh participa da Conferência sobre a Implementação das Tarefas para 2026 do Setor da Indústria e do Comércio.](/_next/image?url=https%3A%2F%2Fvphoto.vietnam.vn%2Fthumb%2F1200x675%2Fvietnam%2Fresource%2FIMAGE%2F2025%2F12%2F19%2F1766159500458_ndo_br_shared31-jpg.webp&w=3840&q=75)

![[INFOGRÁFICO] Legion Go Gen 2 estabelece um novo padrão para jogos.](https://vphoto.vietnam.vn/thumb/402x226/vietnam/resource/IMAGE/2025/12/19/1766146888809_info-taycamgames-02-jpg.webp)

Comentário (0)