O panorama complexo do uso de robôs assassinos com inteligência artificial.

Permitir que a IA controle sistemas de armas pode significar que alvos sejam identificados, atacados e destruídos sem intervenção humana. Isso levanta sérias questões legais e éticas.

Sublinhando a gravidade da situação, o Ministro dos Negócios Estrangeiros austríaco, Alexander Schallenberg, afirmou: "Este é o Momento Oppenheimer da nossa geração."

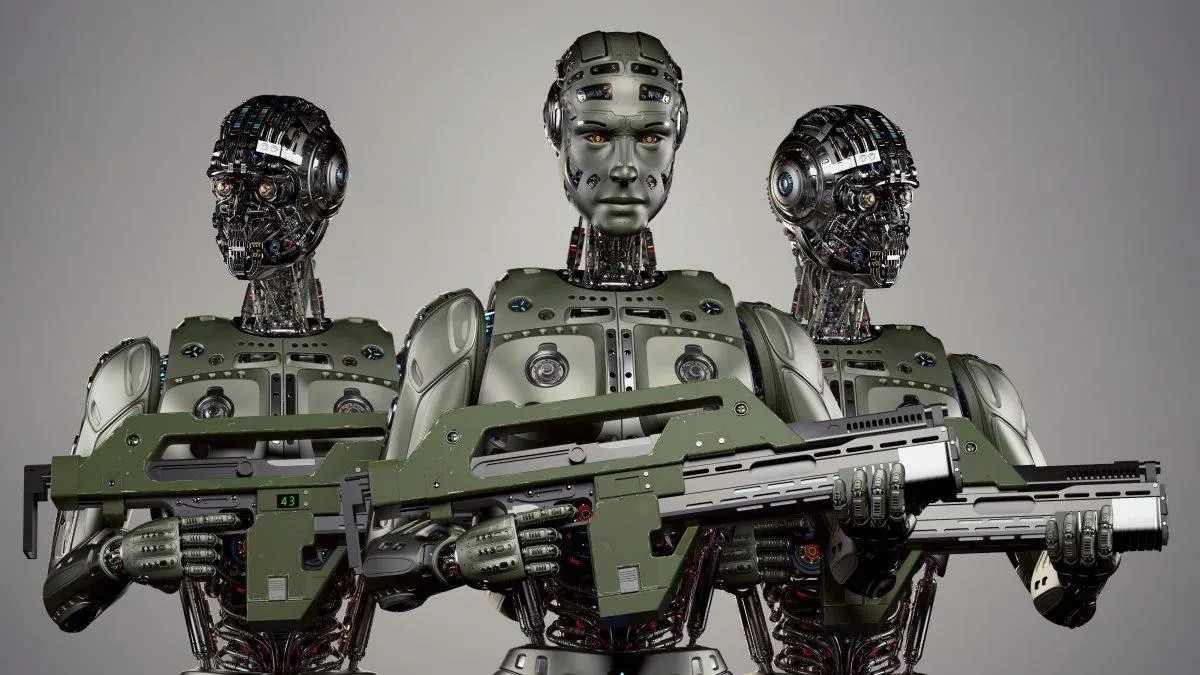

Robôs e armas que utilizam inteligência artificial estão começando a ser amplamente usados nos exércitos de muitos países. Foto: Forbes

De fato, até que ponto o "gênio escapou da lâmpada" tornou-se uma questão premente, visto que drones e inteligência artificial (IA) têm sido amplamente utilizados por forças militares em todo o mundo .

“O uso de drones em conflitos modernos pela Rússia e Ucrânia, o uso de drones pelos EUA em operações de ataque direcionadas no Afeganistão e no Paquistão e, como revelado recentemente no mês passado, como parte do programa Lavender de Israel, mostram como as capacidades de processamento de informações da IA estão sendo ativamente usadas pelas forças armadas do mundo para aumentar seu poder ofensivo”, disse Wilson Jones, analista de defesa da GlobalData.

Investigações conduzidas pelo Escritório de Jornalismo Investigativo de Guerra (Office of War Investigative Journalism), com sede em Londres, revelaram que o sistema de IA Lavender, utilizado pelas forças armadas israelenses, apresentava uma taxa de precisão de 90% na identificação de indivíduos com ligações ao Hamas, o que significa que 10% não as possuíam. Isso resultou em mortes de civis devido à capacidade de identificação e tomada de decisão da IA.

Uma ameaça à segurança global

Utilizar a IA desta forma enfatiza a necessidade de gerir a tecnologia nos sistemas de armamento.

“O uso da IA em sistemas de armas, especialmente quando usada para direcionamento de alvos, levanta questões fundamentais sobre nós – humanos – e nossa relação com a guerra , e mais especificamente sobre nossas suposições a respeito de como podemos usar a violência em conflitos armados”, explicou o Dr. Alexander Blanchard, pesquisador sênior do programa de Governança da Inteligência Artificial do Instituto Internacional de Pesquisa da Paz de Estocolmo (SIPRI), um grupo de pesquisa independente focado em segurança global, à Army Technology.

Sistemas de IA, quando usados em ambientes caóticos, podem se comportar de maneira imprevisível e falhar na identificação precisa de alvos. Foto: MES

“A inteligência artificial altera a forma como os militares selecionam alvos e aplicam a força contra eles? Essas mudanças, por sua vez, levantam uma série de questões legais, éticas e operacionais. As maiores preocupações são de ordem humanitária”, acrescentou o Dr. Blanchard.

“Muitos temem que, dependendo de como os sistemas autônomos forem projetados e utilizados, eles possam colocar civis e outras pessoas protegidas pelo direito internacional em maior risco de danos”, explicou o especialista do SIPRI. “Isso porque os sistemas de IA, especialmente quando usados em ambientes caóticos, podem operar de forma imprevisível e podem falhar na identificação precisa de alvos e ataques a civis, ou na identificação de combatentes que não estão em combate.”

Ao abordar o assunto, Wilson Jones, analista de defesa da GlobalData, observou que a forma como a culpa é determinada poderia ser questionável.

“De acordo com o atual direito da guerra, existe o conceito de responsabilidade de comando”, disse o Sr. Jones. “Isso significa que um oficial, general ou outro líder é legalmente responsável pelas ações das tropas sob seu comando. Se as tropas cometerem crimes de guerra, o oficial é responsável mesmo que não tenha dado as ordens; o ônus da prova recai sobre ele para demonstrar que fez tudo o que era possível para evitar crimes de guerra.”

“Com os sistemas de IA, isso complica as coisas. Um técnico de TI é o responsável? Um projetista de sistemas? Não está claro. Se não estiver claro, cria-se um risco moral se os agentes acharem que suas ações não são protegidas pelas leis existentes”, enfatizou o Sr. Jones.

Um soldado americano patrulha com um cão robô. Foto: Forbes

Convenções de controle de armas: Vários importantes acordos internacionais limitam e regulamentam certos usos de armas. Existem proibições de armas químicas, tratados de não proliferação nuclear e a Convenção sobre Certas Armas Convencionais, que proíbe ou limita o uso de armas específicas consideradas causadoras de sofrimento desnecessário ou injustificável aos beligerantes ou que afetem civis indiscriminadamente.

“O controle de armas nucleares exigiu décadas de cooperação internacional e tratados subsequentes para serem implementados”, explica o analista de defesa Wilson Jones. “Mesmo assim, continuamos com os testes atmosféricos até a década de 1990. Um dos principais motivos para o sucesso da não proliferação nuclear foi a cooperação entre os Estados Unidos e a União Soviética na ordem mundial bipolar. Essa cooperação não existe mais, e a tecnologia que cria inteligência artificial é mais acessível a muitos países do que a energia nuclear.”

“Um tratado vinculativo teria que reunir todos os atores relevantes para concordar em não usar uma ferramenta que aumente seu poder militar. É improvável que isso funcione, porque a IA pode melhorar a eficácia militar com custos financeiros e materiais mínimos.”

Panorama geopolítico atual

Embora os países das Nações Unidas tenham reconhecido a necessidade do uso militar responsável da IA, ainda há muito trabalho a ser feito.

“Sem um quadro regulatório claro, essas reivindicações permanecem em grande parte aspiracionais”, disse Laura Petrone, analista principal da GlobalData, à Army Technology. “Não é surpresa que alguns países queiram manter sua própria soberania ao decidir sobre questões de defesa interna e segurança nacional, especialmente no atual clima geopolítico.”

A Sra. Petrone acrescentou que, embora a Lei de IA da UE estabeleça alguns requisitos para sistemas de IA, ela não aborda sistemas de IA para fins militares.

“Acredito que, apesar dessa exclusão, a Lei de IA representa um esforço importante para estabelecer uma estrutura há muito esperada para aplicações de IA, o que poderá levar a um certo grau de uniformidade das normas relevantes no futuro”, comentou ela. “Essa uniformidade também será importante para a IA no domínio militar.”

Nguyen Khanh

Fonte: https://www.congluan.vn/moi-nguy-robot-sat-thu-ai-dang-de-doa-an-ninh-toan-cau-post304170.html

Comentário (0)