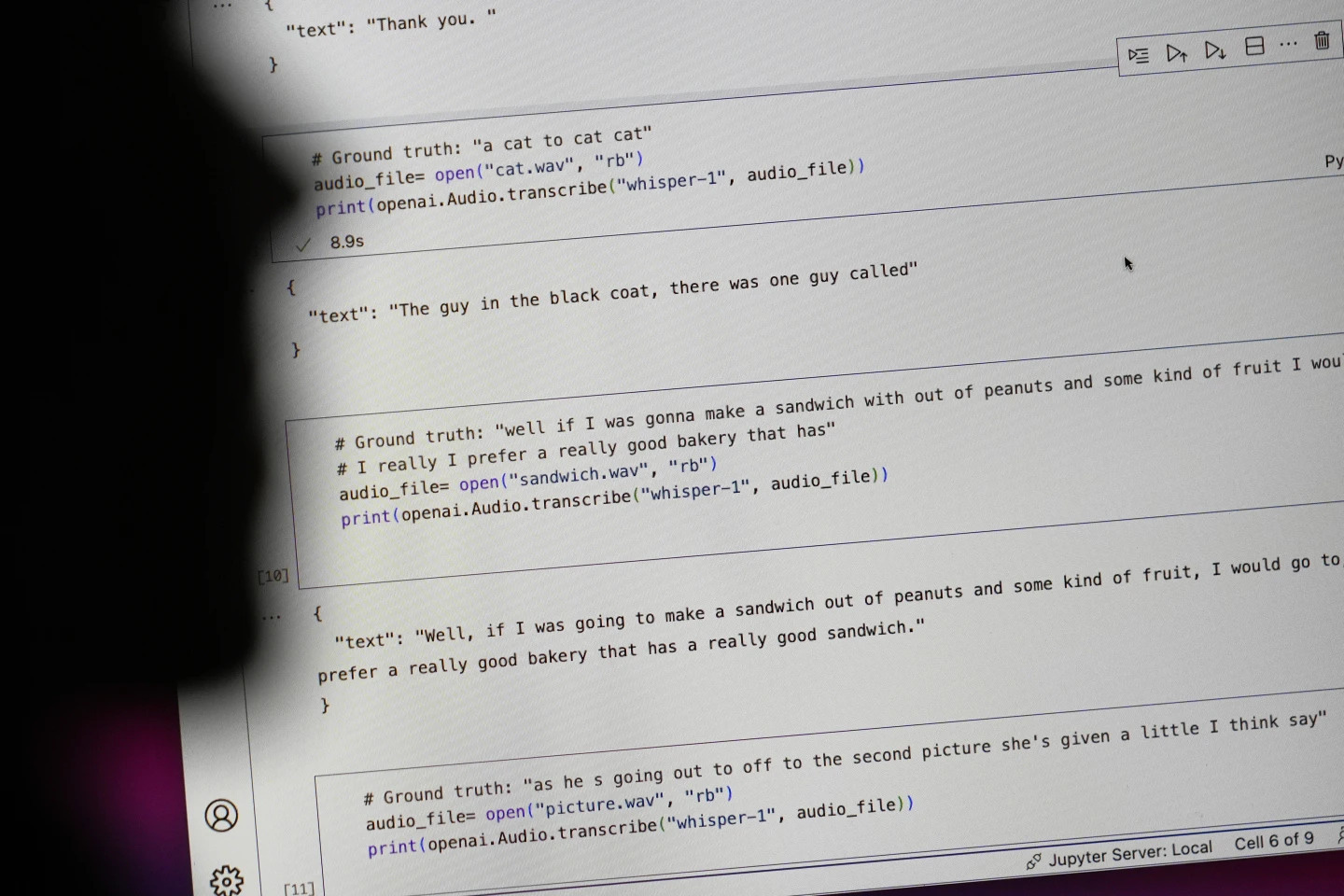

Gigantul tehnologic OpenAI și-a lăudat instrumentul de conversie a vorbirii în text, Whisper, ca fiind o inteligență artificială cu „precizie și robustețe asemănătoare cu cele umane”. Însă Whisper avea un defect major: genera text și propoziții complet false.

Unele dintre textele generate de inteligența artificială – numite „halucinații” – pot include comentarii rasiste, limbaj violent și chiar tratamente medicale imaginare – Foto: AP

O parte din textul generat de inteligența artificială este așa-numită „halucinatorie”, spun experții, potrivit AP, inclusiv comentarii rasiale, limbaj violent și chiar tratamente medicale imaginare.

Rată ridicată de „iluzie” în textele generate de inteligența artificială

Experții sunt deosebit de îngrijorați deoarece Whisper este utilizat pe scară largă în multe industrii din întreaga lume pentru a traduce și transcrie interviuri, a genera text în tehnologii populare de consum și a crea subtitrări pentru videoclipuri.

Mai îngrijorător este faptul că multe centre medicale folosesc Whisper pentru a transfera consultații între medici și pacienți, deși OpenAI a avertizat că instrumentul nu ar trebui utilizat în zone „cu risc ridicat”.

Amploarea problemei este dificil de determinat, dar cercetătorii și inginerii spun că se confruntă în mod regulat cu „halucinații” Whisper în munca lor.

Un cercetător de la Universitatea din Michigan a declarat că a găsit „halucinații” în opt din zece transcrieri audio pe care le-a examinat. Un inginer informatician a găsit „halucinații” în aproximativ jumătate din transcrierile a peste 100 de ore de audio pe care le-a analizat. Un alt dezvoltator a declarat că a găsit „halucinații” în aproape toate cele 26.000 de înregistrări pe care le-a creat folosind Whisper.

Problema persistă chiar și în cazul unor mostre audio scurte și clare înregistrate. Un studiu recent realizat de informaticieni a descoperit 187 de „iluzii” în peste 13.000 de clipuri audio clare pe care le-au examinat. Această tendință ar duce la zeci de mii de transcrieri false în milioane de înregistrări, au declarat cercetătorii.

Astfel de erori pot avea „consecințe foarte grave”, în special în mediul spitalicesc, potrivit Alondrei Nelson, care a condus Biroul de Știință și Tehnologie al Casei Albe în administrația Biden până anul trecut.

„Nimeni nu își dorește un diagnostic greșit”, a spus Nelson, acum profesor la Institutul pentru Studii Avansate din Princeton, New Jersey. „Trebuie să existe un standard mai înalt.”

Whisper este folosit și pentru a crea subtitrări pentru persoanele surde și cu deficiențe de auz - o populație care prezintă un risc deosebit de a suferi traduceri greșite. Acest lucru se datorează faptului că persoanele surde și cu deficiențe de auz nu au nicio modalitate de a identifica pasajele fabricate „ascunse în tot restul textului”, spune Christian Vogler, surd și director al Programului de Accesibilitate Tehnologică de la Universitatea Gallaudet.

OpenAI este chemat să rezolve problema

Prevalența unor astfel de „halucinații” i-a determinat pe experți, susținători și foști angajați OpenAI să solicite guvernului federal să ia în considerare reglementări privind inteligența artificială. Cel puțin, OpenAI trebuie să abordeze această deficiență.

„Această problemă este rezolvabilă dacă firma este dispusă să o prioritizeze”, a declarat William Saunders, inginer de cercetare din San Francisco, care a părăsit OpenAI în februarie din cauza îngrijorărilor legate de direcția companiei.

„Ar fi o problemă dacă l-ai lansa și oamenii ar avea atâta încredere în ceea ce poate face încât l-ar integra în toate celelalte sisteme.” Un purtător de cuvânt al OpenAI a declarat că firma lucrează constant la modalități de atenuare a „iluziilor” și apreciază descoperirile cercetătorilor, adăugând că OpenAI încorporează feedback-ul în actualizările modelului.

Deși majoritatea dezvoltatorilor presupun că instrumentele de transformare a textului în vorbire pot face greșeli de scriere sau alte erori, inginerii și cercetătorii spun că nu au văzut niciodată un instrument de transformare a textului în vorbire bazat pe inteligență artificială care să „halucineze” la fel de mult ca Whisper.

Premiul Nobel pentru Fizică 2024: Oamenii care au pus bazele inteligenței artificiale

Premiul Nobel pentru Fizică 2024: Oamenii care au pus bazele inteligenței artificialeSursă: https://tuoitre.vn/cong-cu-ai-chuyen-loi-noi-thanh-van-ban-cua-openai-bi-phat-hien-bia-chuyen-20241031144507089.htm

![[Foto] Da Nang: Sute de oameni își unesc forțele pentru a curăța o rută turistică vitală după furtuna nr. 13](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/11/07/1762491638903_image-3-1353-jpg.webp)

Comentariu (0)