Biroul Procurorului General din New Hampshire a anunțat luni că investighează o posibilă manipulare a alegătorilor, după plângerile privind o voce falsă care suna exact ca președintele american Joe Biden și care îndemna alegătorii să nu voteze în alegerile primare din stat.

Cercetătorii au avertizat, de asemenea, cu privire la utilizarea audio-ului deepfake pentru a imita politicieni și lideri, cazuri proeminente apărând în 2023 în Marea Britanie, India, Nigeria, Sudan, Etiopia și Slovacia.

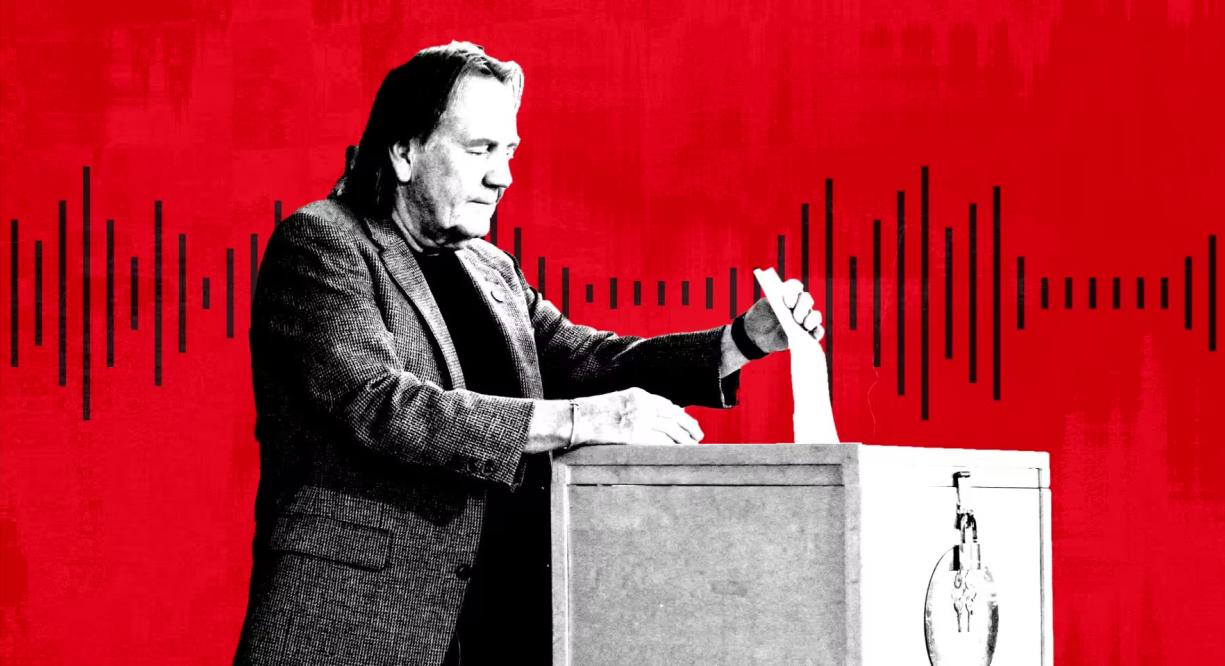

O persoană votează la alegerile primare din New Hampshire, SUA. Foto: Getty

Conform experților, audio-ul deepfake a devenit o formă populară de dezinformare datorită apariției unei game de instrumente de inteligență artificială ieftine și eficiente de la startup-uri. Microsoft a dezvoltat, de asemenea, un nou model de inteligență artificială care poate copia voci din doar trei secunde de înregistrare.

„Când vine vorba de manipulare vizuală, toată lumea este familiarizată cu Photoshop sau cel puțin știe că există”, a spus Henry Ajder, expert în inteligență artificială și deepfake și consultant pentru Adobe, Meta și EY. „Există foarte puțină conștientizare a modului în care poate fi manipulat sunetul, așa că, pentru mine, asta ne lasă cu adevărat vulnerabili.”

În septembrie, NewsGuard, un sistem care evaluează calitatea și fiabilitatea site-urilor de știri, a descoperit o rețea de conturi TikTok care se deghizează în site-uri de știri legitime, folosind conținut generat de inteligență artificială pentru a răspândi teorii ale conspirației și dezinformări politice. Înregistrări deepfake, inclusiv vocea fostului președinte american Barack Obama, au acumulat sute de milioane de vizualizări.

Vocile false par să fi fost generate de un instrument furnizat de ElevenLabs, susținută de Andreessen Horowitz, iar clipurile au acumulat sute de milioane de vizualizări, a declarat NewsGuard.

„Peste 99% dintre utilizatorii platformei noastre creează conținut interesant, creativ și util, dar recunoaștem că există cazuri de utilizare abuzivă și am dezvoltat și introdus continuu protecții pentru a le limita”, a declarat ElevenLabs.

ElevenLabs, fondată acum doi ani de foștii angajați Google și Palantir, Piotr Dabkowski și Mati Staniszewski, oferă gratuit instrumente rudimentare de generare audio prin inteligență artificială, cu un singur clic. Abonamentele costă de la 1 dolar pe lună până la 330 de dolari pe lună și chiar mai mult, pentru cei care caută servicii mai complexe.

Anul trecut, agențiile de informații americane au avertizat într-un raport că „escrocheriile cu inteligență artificială personalizată au crescut semnificativ din cauza lansării unor modele sofisticate și bine antrenate de clonare vocală bazate pe inteligență artificială”.

Pe lângă escrocheriile cu motive financiare, experții politici trag acum un semnal de alarmă cu privire la clipurile audio virale deepfake, precum și la utilizarea deepfake-urilor pentru apeluri automate sau campanii. „Poți construi o campanie de dezinformare puternică și pe scară largă, vizând telefoanele”, a declarat AJ Nash, vicepreședinte și distins membru al departamentului de informații la grupul de securitate cibernetică ZeroFox.

Unele dintre aceste companii au fost proactive în găsirea altor modalități de combatere a dezinformării. Microsoft a emis o declarație de etică, îndemnând utilizatorii să raporteze orice utilizare abuzivă a instrumentului său audio bazat pe inteligență artificială. ElevenLabs și-a construit propriile instrumente de detectare pentru a identifica înregistrările audio create de sistemul său.

În timpul alegerilor din Nigeria din 2023, o înregistrare manipulată de inteligența artificială a devenit virală pe rețelele de socializare „pretinzând că sugerează că un candidat al opoziției plănuia să fraudeze votul”, potrivit grupului pentru drepturile omului Freedom House.

În Slovacia, o înregistrare audio falsă a candidatului opoziției Michal Šimečka, care aparent complota pentru fraudarea alegerilor, a devenit virală cu doar câteva zile înainte de alegerile prezidențiale din septembrie.

„Deepfake-ul din New Hampshire este o reamintire a numeroaselor moduri în care deepfake-urile pot deruta și înșela”, a declarat Robert Weissman, președintele grupului non-profit Public Citizen pentru susținerea consumatorilor. „Momentul deepfake-urilor politice a sosit. Factorii de decizie trebuie să acționeze rapid pentru a pune în aplicare măsuri de siguranță, altfel ne vom confrunta cu haos electoral.”

Mai Anh (conform FT)

Sursă

![[Foto] Panorama rundei finale a Premiilor pentru Acțiune Comunitară 2025](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/11/15/1763206932975_chi-7868-jpg.webp)

![[Foto] Secretarul general To Lam îl primește pe vicepreședintele Luxshare-ICT Group (China)](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/11/15/1763211137119_a1-bnd-7809-8939-jpg.webp)

![[Foto] Prim-ministrul Pham Minh Chinh se întâlnește cu reprezentanți ai unor profesori remarcabili](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/11/15/1763215934276_dsc-0578-jpg.webp)

Comentariu (0)