Если вы когда-либо просматривали социальные сети, скорее всего, вы сталкивались с изображениями или видео, созданными искусственным интеллектом. Многих обманули, как, например, с вирусным видео, где кролики прыгают на батуте. Но Sora — приложение-близнец ChatGPT, разработанное OpenAI, — выводит видео, созданное с помощью ИИ, на новый уровень, делая обнаружение фейкового контента все более актуальным.

Инструменты искусственного интеллекта для анализа видео затрудняют идентификацию подлинных видеороликов. (Источник: CNET)

Запущенное в 2024 году и недавно обновленное до Sora 2, это приложение имеет интерфейс, похожий на TikTok, где все видео генерируются искусственным интеллектом. Функция «камео» позволяет вставлять реальных людей в смоделированные видеоролики, создавая пугающе реалистичные видео.

Поэтому многие эксперты опасаются, что Sora приведет к распространению дипфейков, искажению информации и размыванию границ между реальностью и вымыслом. Знаменитости особенно уязвимы, поэтому такие организации, как SAG-AFTRA, призывают OpenAI усилить защиту.

Распознавание контента, созданного с помощью ИИ, является серьезной проблемой как для технологических компаний, так и для социальных сетей и пользователей. Но существуют способы распознавания видеороликов, созданных с помощью Sora.

Найдите водяной знак Sora

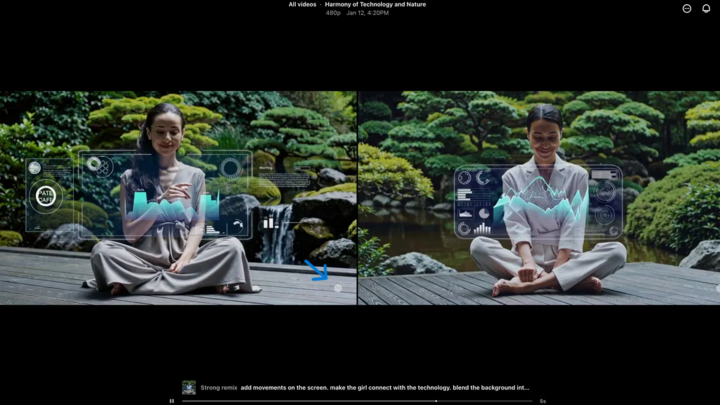

Водяной знак Sora (обозначен синей стрелкой) — это маркер, указывающий на инструмент, использованный для создания видео. (Источник: CNET)

Каждое видео, созданное в приложении Sora для iOS, при загрузке содержит водяной знак – белый логотип Sora (значок облака) перемещается по краям видео, подобно водяному знаку TikTok.

Это визуальный способ идентификации контента, созданного с помощью ИИ. Например, модель «нано-банана» от Google Gemini также автоматически добавляет водяной знак к изображениям. Однако водяные знаки не всегда надежны. Если водяной знак статичный, его легко можно удалить. Даже динамические водяные знаки, такие как у Соры, можно удалить с помощью специализированных приложений.

Отвечая на вопрос по этому поводу, генеральный директор OpenAI Сэм Альтман заявил, что обществу необходимо адаптироваться к реальности, в которой любой может создавать поддельные видеоролики. До появления Sora не существовало инструмента, который был бы настолько популярен, доступен и не требовал бы никаких специальных навыков для создания подобных видео. Его точка зрения подчеркивает необходимость использования альтернативных методов проверки.

Проверьте метаданные

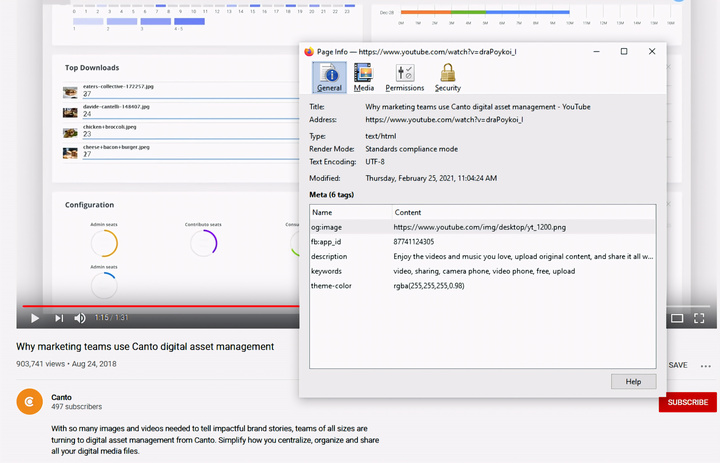

Проверка метаданных — важнейший шаг в определении того, было ли видео создано искусственным интеллектом, например, Sora. (Источник: Canto)

Возможно, вам покажется, что проверка метаданных слишком сложна, но на самом деле это довольно просто и очень эффективно.

Метаданные — это набор информации, автоматически добавляемой к контенту при его создании, например, тип камеры, местоположение, время записи и имя файла. Независимо от того, создан ли контент человеком или искусственным интеллектом, он содержит метаданные. В случае контента, созданного искусственным интеллектом, метаданные часто включают информацию об аутентификации источника.

OpenAI является членом Коалиции за происхождение и подлинность контента (C2PA), поэтому видеоролики Sora будут содержать метаданные C2PA. Вы можете проверить это с помощью инструмента проверки подлинности контента:

Как проверить метаданные:

- Посетите verify.contentauthenticity.org

- Загрузите файл для проверки.

- Нажмите «Открыть»

- См. информацию в таблице справа.

Если видео создано с помощью ИИ, это будет четко указано в описании. При проверке видео Соры вы увидите строку «опубликовано OpenAI» и информацию, подтверждающую, что видео создано с использованием ИИ. Все видео Соры должны содержать эту информацию для подтверждения их происхождения.

Источник: https://vtcnews.vn/cach-nhan-biet-video-that-hay-do-ai-tao-ar972891.html

![[Изображение] Национальное собрание обсуждает реализацию плана социально-экономического развития.](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2026/04/20/1776696707422_ndo_br_img-20260420-185419-jpg.webp)

![[Фото] Генеральный секретарь и президент То Лам встречается с делегатами Национального собрания от этнических меньшинств.](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2026/04/20/1776696701056_a1-bnd-8331-3342-jpg.webp)

Комментарий (0)