Генеральная прокуратура Нью-Гэмпшира объявила в понедельник, что расследует возможную фальсификацию результатов голосования после жалоб на фальшивый голос, который звучал точь-в-точь как голос президента США Джо Байдена, призывавшего избирателей не голосовать на праймериз в штате.

Исследователи также предупредили об использовании поддельных аудиозаписей для имитации политиков и лидеров, наиболее заметные случаи которых произошли в 2023 году в Великобритании, Индии, Нигерии, Судане, Эфиопии и Словакии.

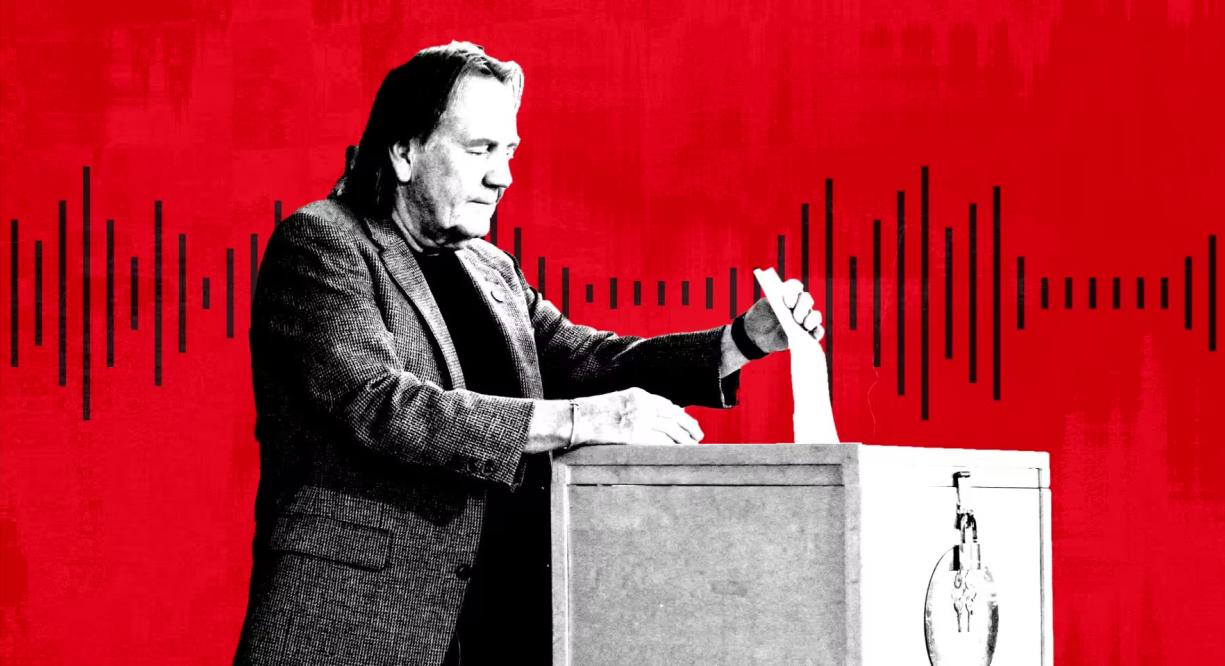

Человек голосует на предварительных выборах в Нью-Гэмпшире, США. Фото: Getty

По словам экспертов, дипфейк-аудио стало популярной формой дезинформации благодаря появлению ряда недорогих и эффективных инструментов искусственного интеллекта, разработанных стартапами. Microsoft также разработала новую модель искусственного интеллекта, способную копировать голоса всего за три секунды записи.

«Когда речь идёт о визуальной обработке, все знакомы с Photoshop или, по крайней мере, знают о его существовании», — сказал Генри Айдер, эксперт по искусственному интеллекту и дипфейку, а также консультант Adobe, Meta и EY. «Очень мало кто знает, как можно манипулировать аудио, поэтому, на мой взгляд, это действительно делает нас уязвимыми».

В сентябре NewsGuard, система оценки качества и надёжности новостных сайтов, обнаружила сеть аккаунтов TikTok, маскирующихся под легитимные новостные сайты и использующих контент, сгенерированный искусственным интеллектом, для распространения теорий заговора и политической дезинформации. Записи дипфейков, включая голос бывшего президента США Барака Обамы, набрали сотни миллионов просмотров.

По данным NewsGuard, фальшивые закадровые голоса, по всей видимости, были созданы с помощью инструмента, предоставленного компанией ElevenLabs, спонсируемой Andreessen Horowitz, а клипы набрали сотни миллионов просмотров.

«Более 99% пользователей нашей платформы создают интересный, креативный и полезный контент, но мы признаем, что существуют случаи злоупотребления, и мы постоянно разрабатываем и внедряем меры защиты, чтобы ограничить их», — заявили в ElevenLabs.

Компания ElevenLabs, основанная два года назад бывшими сотрудниками Google и Palantir Петром Дабковским и Мати Станишевским, предлагает простые инструменты для генерации звука на базе искусственного интеллекта бесплатно, всего одним кликом. Стоимость подписки варьируется от 1 до 330 долларов в месяц и выше для тех, кто ищет более сложные услуги.

В прошлом году разведывательные службы США в своем отчете предупредили, что «число случаев мошенничества с использованием персонализированного ИИ значительно возросло из-за появления сложных и хорошо обученных моделей клонирования голоса на основе ИИ».

Помимо мошенничества с финансовой целью, политические эксперты бьют тревогу по поводу вирусных аудиозаписей с дипфейками, а также использования дипфейков для автоматических звонков или проведения кампаний. «Можно создать мощную и масштабную кампанию по дезинформации, атакуя телефоны», — заявил Эй Джей Нэш, вице-президент и видный специалист по разведке в группе кибербезопасности ZeroFox.

Некоторые из этих компаний активно ищут другие способы борьбы с дезинформацией. Microsoft опубликовала этическое заявление, призывая пользователей сообщать о любых злоупотреблениях её ИИ-инструмента для обработки аудиоданных. ElevenLabs разработала собственные инструменты обнаружения аудиозаписей, созданных её системой.

По данным правозащитной организации Freedom House, во время выборов 2023 года в Нигерии в социальных сетях стал вирусным видеоролик, обработанный с помощью искусственного интеллекта, «якобы намекающий на то, что кандидат от оппозиции планировал фальсифицировать результаты голосования».

В Словакии фальшивая аудиозапись кандидата от оппозиции Михала Шимечки, предположительно замышляющего фальсификацию выборов, стала вирусной всего за несколько дней до президентских выборов в стране в сентябре.

«Нью-Гэмпширский дипфейк — напоминание о том, как много способов, которыми дипфейки могут сбивать с толку и мошенничать, — сказал Роберт Вайсман, президент некоммерческой организации по защите прав потребителей Public Citizen. — Настал момент политического дипфейка. Политикам необходимо быстро принять меры безопасности, иначе нас ждёт избирательный хаос».

Май Ань (по данным FT)

Источник

![[Фото] Газета «Нхан Дан» запускает «Отечество в сердце: фильм-концерт»](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/10/16/1760622132545_thiet-ke-chua-co-ten-36-png.webp)

Комментарий (0)