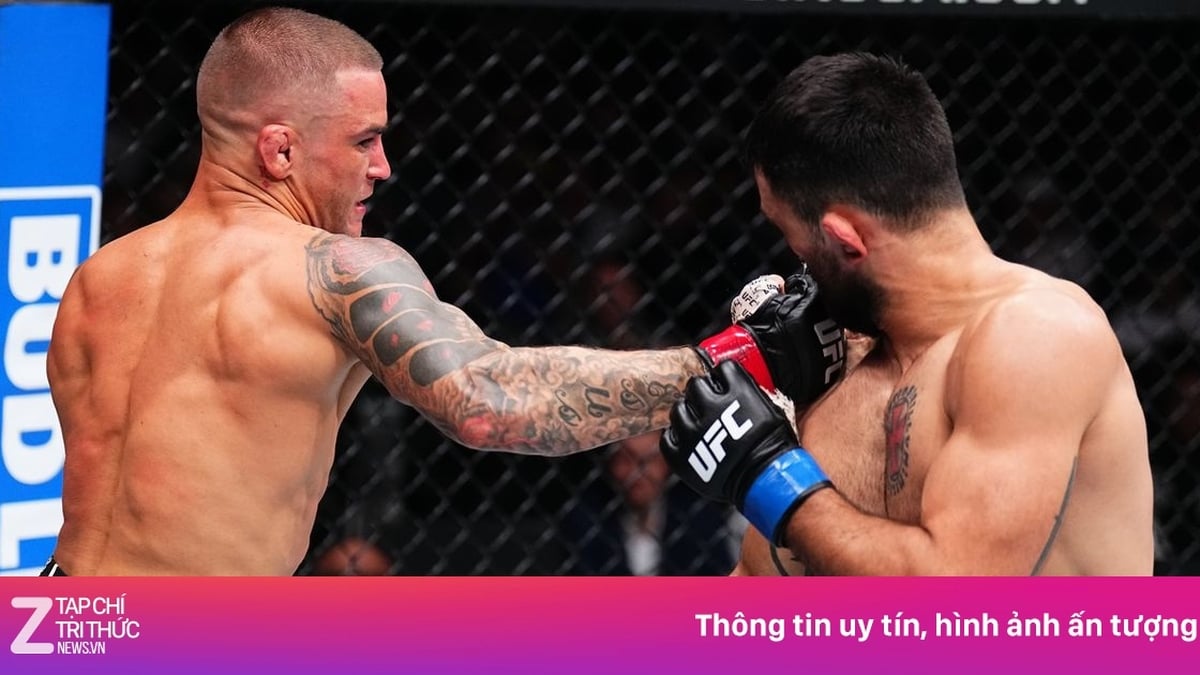

Изображение, иллюстрирующее тенденцию видеороликов с обменом лицами

От вирусных видеороликов с «морфингом» в социальных сетях до персонализированной рекламы технология подмены лиц, широко известная как «дипфейк» или «обмен лицами», стала цифровым культурным явлением.

Тенденция к пересадке лица

Всего за несколько секунд пользователи могут «превратиться» в голливудскую суперзвезду, персонажа мультфильма или даже в знаменитость прошлого. Однако за удобством и увлекательностью этого тренда скрывается сложный процесс оцифровки лицевых данных, поднимающий множество вопросов о конфиденциальности и безопасности персональных данных.

Привлекательность тренда на пересадку лица обусловлена психологией развлечения и желанием быть в курсе последних тенденций в социальных сетях.

Многих, особенно молодёжь, привлекает любопытство и возможность создавать уникальный контент. Однако из-за отсутствия понимания технологий искусственного интеллекта и безопасности данных они легко игнорируют риски.

Технология пересадки лица использует искусственный интеллект (ИИ), в частности алгоритмы глубокого обучения, для анализа и реконструкции изображений лица.

Такие приложения, как FaceApp, Reface или профессиональные платформы для редактирования видео, такие как Adobe After Effects, интегрируют ИИ, который может распознавать черты лица, такие как глаза, нос, рот, выражения и освещение.

Затем технология накладывает лицо человека на лицо персонажа на видео, создавая продукт, который выглядит невероятно реалистично.

Для этого данные о лице собираются с помощью изображений или видео, предоставленных пользователями. Приложения обычно требуют от пользователей загрузить одно или несколько селфи, а затем используют модели искусственного интеллекта для анализа и сохранения информации о структуре лица.

Эти данные включают в себя ориентиры лица, цвет кожи, углы наклона лица и даже выражения, которые кодируются в цифровые векторы для компьютерной обработки.

Риски превращения лиц в биометрические данные

Лицо — это разновидность биометрических данных, очень личная и не подлежащая изменению, как пароль.

В случае утечки этих данных пользователи не смогут «изменить лицо», чтобы защитить себя. Технология дипфейка, позволяющая создавать видео с поддельными голосами и изображениями, становится серьёзной угрозой.

Многие приложения, особенно приложения с иностранных платформ, не имеют чёткого юридического представительства во Вьетнаме, но всё ещё широко используются. Кроме того, политики конфиденциальности часто написаны сложно и запутанно, что приводит к невнимательности пользователей и их легкому принятию без раздумий.

Во Вьетнаме были зафиксированы случаи использования видеороликов с подменой лиц с целью опорочить репутацию или совершить финансовое мошенничество, что нанесло серьезный ущерб личной репутации и общественному доверию.

Более того, существует риск использования данных о лицах для обучения систем распознавания без согласия, в целях от коммерческих до наблюдения, без ведома пользователей.

Что нужно сделать для защиты данных о лице?

Чтобы принять участие в тенденции трансплантации лица и при этом обеспечить защиту персональных данных, пользователям необходимо выработать необходимые привычки и знания.

Во-первых, всегда проверяйте происхождение приложения перед загрузкой любых изображений. Приложения с неизвестным происхождением или без информации о разработчике следует избегать, так как они могут представлять риск кражи данных.

Затем внимательно ознакомьтесь с политикой конфиденциальности приложения, уделив особое внимание тому, как хранятся, используются и передаются данные о лицах. Если политика неясна или запрашивает ненужный доступ, например, ко всей вашей фотогалерее или местоположению, рассмотрите возможность отказа.

Выбор надежных платформ, таких как платформы крупных компаний, таких как Adobe или Reface, которые имеют прозрачную политику конфиденциальности, — эффективный способ минимизировать риск.

Кроме того, пользователям следует ограничить загрузку фотографий высокого разрешения или фотографий, содержащих конфиденциальную информацию, и публиковать видеоролики с заменой лиц только на закрытых платформах, избегая публикации публичного контента, который может быть использован для злоупотреблений.

Для повышения безопасности регулярно проверяйте разрешения приложений на вашем устройстве и используйте антивирусное программное обеспечение для обнаружения подозрительной активности.

В конечном счете, изучение технологии deepfake и способов выявления поддельного контента поможет пользователям оставаться бдительными и не стать жертвами мошенничества или клеветы.

Риски превращения лиц в «биометрические данные»

Утрата конфиденциальности: лица — это разновидность биометрических данных, которую невозможно заменить, как пароли. После утечки данных пользователи не смогут «изменить свои лица», как PIN-коды.

Риск быть выданным за другое лицо с помощью deepfake: Поддельные видео с голосом и лицом становятся все более популярными, вызывая путаницу, финансовое мошенничество или личную клевету.

Используется для обучения ИИ без ведома: Фотографии пользователей могут использоваться для обучения систем распознавания лиц, повышая точность коммерческого ИИ, без какой-либо компенсации или уведомления.

Что нужно сделать для защиты данных о лице?

Внимательно ознакомьтесь с политикой конфиденциальности: перед использованием приложения проверьте, как поставщик обрабатывает ваши данные.

Ограничьте предоставление конфиденциальных данных: загружайте только необходимые изображения и избегайте использования неизвестных приложений.

Используйте надежные платформы: отдавайте приоритет заявкам от крупных компаний с прозрачной политикой конфиденциальности.

Обновление по кибербезопасности: узнайте о рисках технологии deepfake и о том, как распознать поддельный контент.

Source: https://tuoitre.vn/trao-luu-ghep-mat-vao-video-du-lieu-khuon-mat-dang-bi-so-hoa-ra-sao-20250529105826111.htm

Комментарий (0)