|

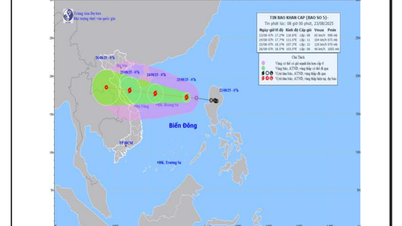

| Illustrativ bild. (Källa: Ministeriet för vetenskap och teknik ) |

För att fullgöra sin funktion som statlig förvaltning av vetenskaplig forskning, teknisk utveckling och innovation, och för att uppfylla de praktiska kraven för tillämpning av artificiell intelligens (AI) i statliga myndigheter, har ministeriet för vetenskap och teknik utfärdat riktlinjer om några allmänna principer för statstjänstemän, offentliganställda och arbetstagare i statliga myndigheter som använder stora språkmodeller (AI-chattrobotar) för arbetsändamål.

Denna guide syftar till att ge allmänna, lättförståeliga principer för tjänstemän, offentliganställda och anställda inom myndigheter för att använda stora språkmodeller (AI-chattrobotar) för att stödja sitt arbete effektivt och säkert.

Organisationer och enheter som behöver tillämpa AI-chattrobotar i sitt arbete uppmuntras att proaktivt lära sig om och använda detta dokument för att implementera och sprida det inom sina organisationer på ett sätt som passar deras specifika behov. Detta dokument bidrar till att säkerställa att tillämpningen av AI är säker och ger praktiska fördelar.

Generaldirektör Mai Xuan Thanh, tillsammans med vice ordförande för Hanois folkkommitté Ha Minh Hai, biträdande generaldirektör Vu Manh Cuong, ordförande för Vietnams skatterådgivningsförening Nguyen Thi Cuc och biträdande direktör för Hanois skatteavdelning Phan Tien Hoa, förrättade ceremonin med att trycka på knappen för att starta applikationen "Virtuell assistent för att stödja skattebetalare".

Vetenskaps- och teknikministeriet anger tydligt att principerna för tillhandahållande av data och användning av AI-chattrobotar är: Inga data eller dokument som klassificeras som statshemligheter, såväl som känslig information såsom personlig information, interna dokument eller data som kan påverka säkerheten eller organisationen, ska delas med AI-chattroboten. Säkerställ att data eller information som tillhandahålls AI-chattroboten inte strider mot Vietnams historiska traditioner, kultur, etik, geografi, politiska åsikter, territoriella suveränitet eller seder. Använd inte heller innehåll som gör intrång i upphovsrätt, immateriella rättigheter eller andra relaterade rättigheter.

När du använder AI-chattrobotar, undvik att skapa konton med användarnamn eller lösenord som är desamma som officiella konton (arbets-e-postkonton, interna system etc.) för att säkerställa informationssäkerhet. Använd AI-chattrobotar försiktigt, effektivt och ansvarsfullt. Kontrollera och utvärdera också noggrant resultaten från AI-chattroboten före användning. Se till att informationen är korrekt, relevant för arbetssammanhanget och inte orsakar missförstånd eller fel vid tillämpning. Förlita dig inte helt på AI-chattrobotar; kombinera deras användning med personlig kunskap och erfarenhet för att fatta välgrundade beslut.

För myndigheter och enheter är det nödvändigt att sprida information och vägleda tjänstemän, statstjänstemän och anställda om användningen av AI-chattrobotar i enlighet med myndighetens eller enhetens funktioner, uppgifter, befogenheter och specifika egenskaper. Tonvikt bör läggas på att säkerställa cybersäkerhet.

Ansvaret för att använda AI-chattrobotar ligger hos chefen för myndigheten eller organisationen. De ansvarar för att hantera och säkra AI-chattrobotkontot; i händelse av att myndighetens eller enhetens konto komprometteras eller utges för att vara personifierad måste myndigheten eller enheten meddela AI-chattrobotens driftsättningsenhet för snabba åtgärder.

Åtkomsthantering och behörigheter i AI-chattrobotar måste överensstämma med funktioner, uppgifter och behörighet för deltagarna som använder AI-chattroboten.

När tjänstemän, statsanställda eller offentliganställda säger upp sig eller övergår till en annan tjänst måste myndigheten eller enheten hämta säkerhetsnyckeln (om sådan finns) eller radera AI-chatbotens användarkonto för att säkerställa säkerhet och strikt hantering.

Bygg gradvis upp din egen kunskapsdatabas och etablera sedan specialiserade chattrobotar för att betjäna din myndighets eller enhets verksamhet.

Regelbundet övervaka och snabbt utvärdera användningen av AI-chattrobotar av tjänstemän, statstjänstemän och anställda under deras ledning. Enheten som driftsätter AI-chattroboten ansvarar för att tillhandahålla detaljerade instruktionsmanualer och regelbundet tekniskt stöd för att säkerställa smidig och säker användning.

För tjänstemän, statsanställda och anställda är det nödvändigt att själva hantera och ta ansvar för att skydda den personliga information som deklareras på myndighetens eller enhetens informationsplattformar och system; de får inte avslöja inloggningskonton eller göra obehöriga kopplingar mellan myndighetens informationsplattformar och system och AI-chattroboten.

När du använder chattrobotar i allmänhet, och AI-chattrobotar i synnerhet, vid offentliga internetåtkomstpunkter, tillåt absolut inte lösenordslagring under användning. Lämna inte ut personuppgifter, identitetsinformation eller annan känslig information om dig själv eller andra till AI-chattroboten. Använd inte chattrobotar i allmänhet, och AI-chattrobotar i synnerhet, för olagliga ändamål, för att bryta mot allmän moral eller för aktiviteter som hacking, skapande av deepfakes eller bedrägerier.

Om det uppstår svårigheter, hinder eller större problem under implementeringsprocessen vid användning av AI-chattrobotar, bör myndigheter och enheter kontakta den nationella avdelningen för digital transformation vid ministeriet för vetenskap och teknik för stöd.

Enligt uppgift utvecklar ministeriet för vetenskap och teknik ett nationellt AI-transformationsprogram för att tillämpa AI inom alla områden och bygga en gemensam AI-datorinfrastruktur.

Det nationella AI-transformationsprogrammet måste återspegla en "landsomfattande" och "omfattande" strategi, med målet att varje medborgare och offentlig tjänsteman ska ha en virtuell assistent.

Följaktligen är tidsfristen för att lämna in det nationella AI-transformationsprogrammet till premiärministern för offentliggörande maj 2025, och en virtuell assistent måste finnas tillgänglig för medborgarna senast november 2025.

Enligt nhandan.vn

Källa: https://baoapbac.vn/xa-hoi/202504/huong-dan-su-dung-chatbot-ai-ho-tro-can-bo-cong-chuc-trong-cong-viec-1038813/

![[Bild] Vietnams färgstarka innovationsresa](/_next/image?url=https%3A%2F%2Fvphoto.vietnam.vn%2Fthumb%2F1200x675%2Fvietnam%2Fresource%2FIMAGE%2F2025%2F12%2F14%2F1765703036409_image-1.jpeg&w=3840&q=75)

Kommentar (0)