|

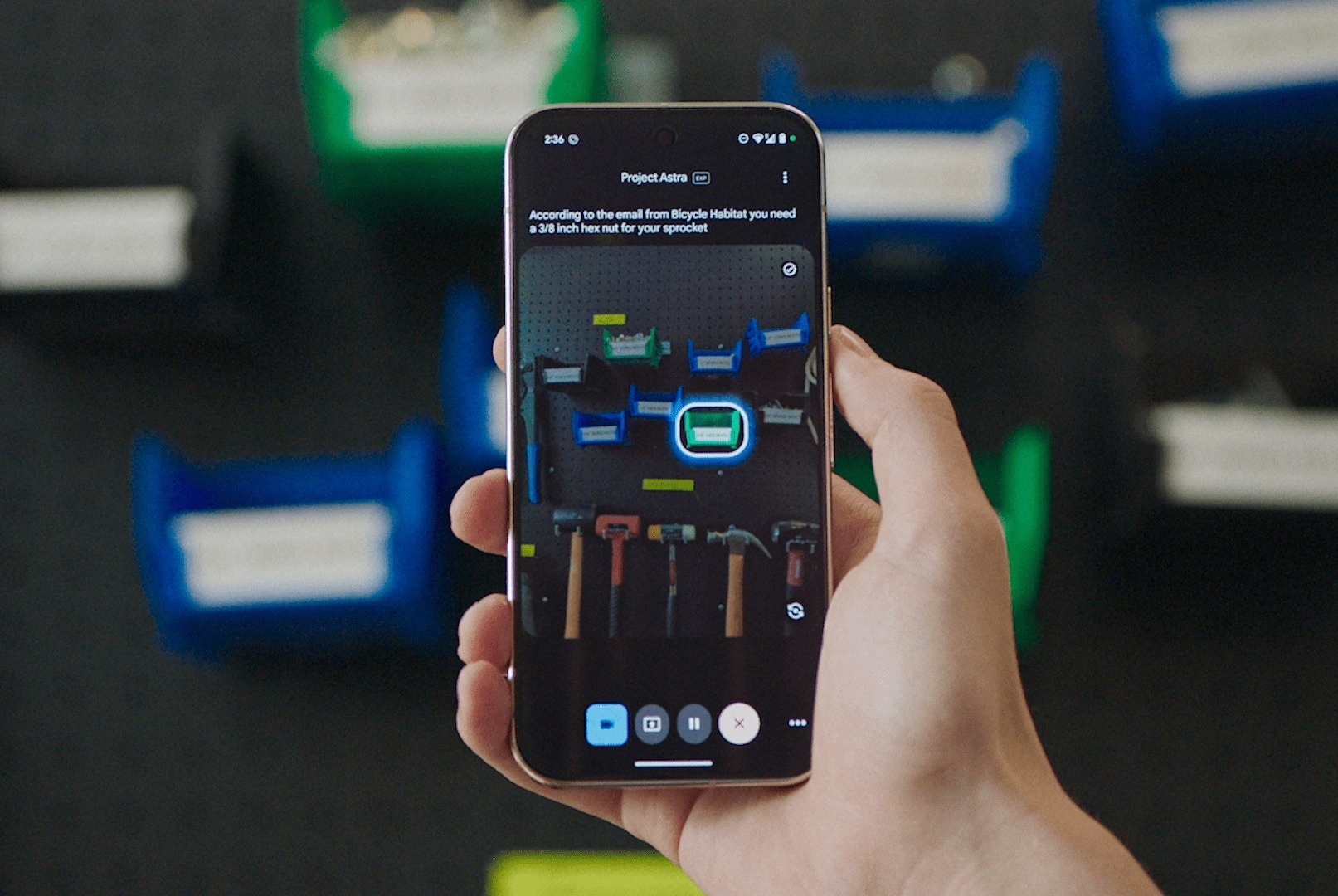

อินเทอร์เฟซแบบโต้ตอบของ Project Astra ภาพ: Google |

ในงาน I/O 2025 ซึ่งจัดขึ้นในช่วงเช้าตรู่ของวันที่ 21 พฤษภาคม (ตามเวลาเวียดนาม) Google ได้ประกาศเปิดตัวฟีเจอร์ใหม่มากมายของ Project Astra โดย Project Astra ซึ่งเปิดตัวครั้งแรกในปี 2024 ใช้โมเดล AI แบบมัลติโมดัลเพื่อใช้ประโยชน์และวิเคราะห์ภาพและข้อมูลภาพแบบเรียลไทม์ นี่คือความมุ่งมั่นอันยิ่งใหญ่ของ Google ที่มีเป้าหมายเพื่อทำให้ AI มีประโยชน์มากขึ้นในชีวิตจริง

หลังจากช่วงการทดสอบ คุณสมบัติบางอย่างของ Project Astra เช่น การตอบสนองด้วยเสียง หน่วยความจำ และการคำนวณพื้นฐาน จะปรากฏบนแอป Gemini และ Google

ในระหว่างกิจกรรม Google ได้สาธิตวิธีการที่ Astra สามารถช่วยในชีวิตประจำวันได้ นอกจากการตอบคำถามและใช้กล้องเพื่อจดจำตำแหน่งที่คุณวางแว่นตาไว้แล้ว Astra ยังสามารถทำภารกิจต่างๆ ได้อย่างอัตโนมัติโดยที่คุณไม่ต้องถาม

“แอสตราสามารถเลือกเวลาที่จะพูดได้ตามสิ่งที่เห็น มันจะสังเกตและตอบสนองตามนั้นอย่างต่อเนื่อง” เกร็ก เวย์น นักวิจัยจากดีพมายด์กล่าว

The Verge รายงานว่าฟีเจอร์นี้อาจเปลี่ยนวิธีการทำงานของ AI แทนที่จะรอให้ผู้ใช้หันกล้องไปขอความช่วยเหลือ Astra สามารถตรวจสอบ รับฟัง และให้ความช่วยเหลือโดยอัตโนมัติได้อย่างต่อเนื่องหากจำเป็น ปัจจุบัน Google กำลังมุ่งเน้นการพัฒนา Astra สำหรับสมาร์ทโฟนและแว่นตาอัจฉริยะ

Wayne ยกตัวอย่างการทำงานของ Astra มาให้ ขณะทำการบ้าน เครื่องมือนี้สามารถติดตามและแจ้งเตือนผู้ใช้ได้ทันทีเมื่อตรวจพบข้อผิดพลาด แทนที่จะรอให้ผู้ใช้ทำการบ้านเสร็จและขอให้ตรวจสอบ

เดมิส ฮัสซาบิส ซีอีโอของ DeepMind กล่าวว่าการฝึก Astra ให้ทำงานต่างๆ ด้วยตนเองนั้นเป็นหนึ่งในทักษะทางเทคนิคที่ยากที่สุด เขาเรียกทักษะนี้ว่า “การอ่านสถานการณ์” เพราะ AI จำเป็นต้องกำหนดเวลาที่ควรช่วยเหลือ วิธีช่วยเหลือ และเวลาที่ควรจะเงียบ ซึ่งเป็นสิ่งที่มนุษย์ทำได้ค่อนข้างดี แต่ยากที่จะวัดปริมาณและศึกษา

การอัปเกรดครั้งต่อไปของ Astra คือการขุดข้อมูลผู้ใช้บนเว็บและผลิตภัณฑ์ของ Google The Verge รายงานว่าเครื่องมือนี้สามารถรู้ตารางเวลาเพื่อแจ้งเตือนเมื่อต้องออกจากบ้าน อ่านเนื้อหาในอีเมลเพื่อดึงข้อมูลหมายเลขโทรศัพท์เมื่อเช็คอินที่โรงแรม...

|

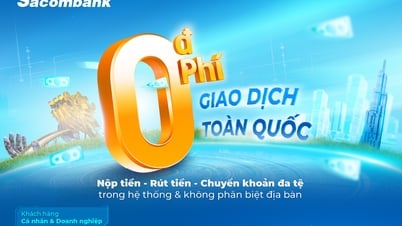

ฟีเจอร์ไฮไลต์ของ Project Astra ที่ช่วยสแกนวัตถุและเปรียบเทียบข้อมูลที่สกัดมาจากแอปพลิเคชันอื่น ภาพ: Google |

ชิ้นส่วนสุดท้ายของปริศนาของ Astra คือความสามารถในการเรียนรู้วิธีใช้โทรศัพท์ Android Bibo Xiu ตัวแทนฝ่ายผลิตภัณฑ์ของ DeepMind ได้สาธิตการใช้งานในงานนี้ โดยชี้กล้องโทรศัพท์ไปที่หูฟัง Sony และขอให้ Astra ระบุรุ่นของหูฟัง

หลังจากที่ Astra ตอบว่าหูฟังน่าจะเป็น Sony WH-1000XM4 หรือ WH-1000XM3 ซิ่วก็ถามเครื่องมือต่อไปเพื่อหาคู่มือการใช้งาน แล้วอธิบายวิธีเชื่อมต่อกับโทรศัพท์ หลังจากที่ Astra แนะนำแล้ว ซิ่วก็ขัดจังหวะและขอให้แชทบอทเชื่อมต่อให้ Astra รีบเปิดการตั้งค่าและดำเนินการเองทันที

กระบวนการนี้ไม่ได้ราบรื่นนัก เพราะ Xiu ต้องให้ Astra คอยตรวจสอบหน้าจอโทรศัพท์ ในอนาคต Google ตั้งเป้าให้แชทบอทสามารถติดตามหน้าจอได้โดยอัตโนมัติ

ใน วิดีโอ Google อีกอันหนึ่ง ผู้ใช้คนหนึ่งขอให้ Astra ค้นหาคู่มือจักรยาน Huffy จากนั้นไปที่หน้าเฉพาะที่มีคำแนะนำในการซ่อมชิ้นส่วนจักรยาน Astra ยังสามารถค้นหาวิดีโอ YouTube เกี่ยวกับวิธีการถอดสกรูที่ชำรุด จากนั้นติดต่อร้านค้าที่ใกล้ที่สุดเพื่อหาอะไหล่ทดแทน ทุกอย่างเกิดขึ้นได้อย่างราบรื่นในการสาธิต

แม้ว่า Astra จะยังไม่ได้รับการเผยแพร่อย่างแพร่หลาย แต่ Google กล่าวว่าฟีเจอร์วิเคราะห์ภาพ Gemini Live จะเปิดตัวให้กับผู้ใช้ iOS ทุกคน (ก่อนหน้านี้รองรับเฉพาะ Android เท่านั้น)

ในอนาคต AI ของ Google จะไม่เพียงแค่ทำตามคำสั่งเท่านั้น แต่ Astra จะช่วย "เข้าใจสิ่งที่มองเห็นและไม่สามารถมองเห็นได้ในขณะนั้น" Xiu กล่าว

ที่มา: https://znews.vn/ai-cua-google-ngay-cang-thong-minh-post1554615.html

![[ข่าวการเดินเรือ] กว่า 80% ของความสามารถในการขนส่งตู้คอนเทนเนอร์ทั่วโลกอยู่ในมือของ MSC และพันธมิตรการขนส่งรายใหญ่](https://vphoto.vietnam.vn/thumb/402x226/vietnam/resource/IMAGE/2025/7/16/6b4d586c984b4cbf8c5680352b9eaeb0)

การแสดงความคิดเห็น (0)