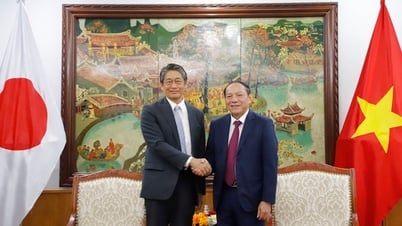

เคซีย์ ฮาร์เรลล์ ผู้ป่วยโรคกล้ามเนื้ออ่อนแรงด้านข้าง (amyotrophic lateral sclerosis) เป็นอาสาสมัครในโครงการทดลองทางคลินิกระยะยาวของ BrainGate2 และใช้อินเทอร์เฟซระหว่างสมองกับเครื่องจักรเพื่อสนทนากับครอบครัวและเพื่อนๆ - รูปภาพ: nytimes.com

ตามที่ นิวยอร์กไทมส์ รายงาน วารสาร Cell ได้ตีพิมพ์ผลการศึกษาวิจัยเมื่อวันที่ 14 สิงหาคมที่ผ่านมา โดยแสดงให้เห็นว่า นักวิทยาศาสตร์ ไม่เพียงแต่ถอดรหัสคำพูดที่ผู้ป่วยที่สูญเสียการพูดพยายามจะพูดได้เท่านั้น แต่ยังสามารถถอดรหัสคำพูดที่พวกเขาจินตนาการไว้ในหัวได้อีกด้วย

การทดลองนี้เป็นส่วนหนึ่งของการทดลองทางคลินิก BrainGate2 ซึ่งดำเนินมายาวนาน ซึ่งใช้อินเทอร์เฟซระหว่างสมองกับเครื่องจักรเพื่อฟื้นฟูการสื่อสารให้กับผู้ป่วยที่มีการสูญเสียการพูดอันเนื่องมาจากภาวะทางระบบประสาท

ในปี 2023 เคซีย์ แฮร์เรลล์ ผู้ป่วยโรคกล้ามเนื้ออ่อนแรง (ALS) ได้ฝังกลุ่มอิเล็กโทรดจำนวน 4 กลุ่มที่ประกอบด้วยเข็มขนาดเล็กในคอร์เทกซ์สั่งการกล้ามเนื้อด้านซ้ายของสมอง ซึ่งทำหน้าที่สร้างคำสั่งสำหรับกล้ามเนื้อในการพูด

คอมพิวเตอร์จะบันทึกสัญญาณไฟฟ้าของสมองของเขาขณะที่เขาพยายามพูดคำศัพท์ และด้วยปัญญาประดิษฐ์ (AI) คอมพิวเตอร์จึงสามารถคาดเดาคำศัพท์ได้เกือบ 6,000 คำอย่างแม่นยำถึง 97.5% จากนั้นจึงสังเคราะห์คำศัพท์เหล่านั้นโดยใช้เสียงของเขาก่อนเกิดโรค

ในการศึกษาวิจัยใหม่นี้ ทีมวิจัยที่นำโดยนักประสาทวิทยา Erin Kunz (มหาวิทยาลัย Stanford) ได้เปรียบเทียบสัญญาณของสมองเมื่อผู้เข้าร่วมการทดลองเพียงแค่ "จินตนาการ" ว่ากำลังพูดคำๆ หนึ่งออกมา และเมื่อพวกเขาพยายามพูดคำนั้นออกมาดังๆ

ผลการศึกษาแสดงให้เห็นว่ารูปแบบการทำงานของสมองค่อนข้างคล้ายคลึงกัน แต่อ่อนกว่าสำหรับคำพูดที่จินตนาการขึ้น ในตอนแรก คอมพิวเตอร์สามารถทำนายคำที่จินตนาการขึ้นได้อย่างถูกต้องในอัตราที่ค่อนข้างสูงในบางคน แต่เมื่อได้รับการฝึกฝนเฉพาะด้าน "คำพูดภายใน" ระบบก็พัฒนาขึ้นอย่างมีนัยสำคัญ รวมถึงกับมิสเตอร์ฮาร์เรลล์ด้วย และสามารถถอดรหัสคำส่วนใหญ่หรือทั้งหมดในประโยคที่สมบูรณ์ เช่น "ฉันสงสัยว่าคุณอยู่ที่นี่มานานเท่าไหร่แล้ว" ได้อย่างถูกต้อง

นักวิจัยพบว่าวิธีการนี้เหนื่อยน้อยกว่าการพยายามออกเสียงคำศัพท์ ทำให้ผู้ป่วยสามารถสื่อสารได้นานขึ้นและเร็วขึ้น อย่างไรก็ตาม พวกเขายังพบด้วยว่าบางครั้งระบบอาจ "ได้ยิน" คำที่ผู้เข้าร่วมไม่ได้ตั้งใจจะพูด เช่น เมื่อพวกเขานับตัวเลขบนหน้าจออย่างเงียบๆ คอมพิวเตอร์จะถอดรหัสคำนั้นเพื่อนับจำนวน

เพื่อปกป้องความเป็นส่วนตัว ทีมงานได้เสนอวิธีแก้ปัญหาสองวิธี วิธีแรกคือการถอดรหัสเฉพาะคำพูดที่ตั้งใจไว้ โดยไม่คำนึงถึง "เสียงภายใน" การทดสอบแสดงให้เห็นว่าสัญญาณทั้งสองประเภทมีความแตกต่างกันมากพอที่คอมพิวเตอร์จะแยกแยะได้

ประการที่สอง ใช้ "รหัสผ่านภายใน" เพื่อเปิด/ปิดการถอดรหัส ผู้ป่วยรายหนึ่งใช้วลี "Chitty Chitty Bang Bang" เป็นรหัสผ่าน และเครื่องสามารถจดจำได้แม่นยำถึง 98.75% โดยถอดรหัสเนื้อหาได้หลังจาก "ได้ยิน" รหัสผ่านนี้เท่านั้น

“การศึกษานี้ถือเป็นก้าวสำคัญทางจริยธรรมในทิศทางที่ถูกต้อง หากพิจารณาอย่างจริงจัง จะช่วยให้ผู้ป่วยสามารถควบคุมข้อมูลที่จะแบ่งปันและช่วงเวลาที่จะแบ่งปันได้มากขึ้น” โคเฮน มาร์คัส ไลโอเนล บราวน์ นักชีวจริยธรรมจากมหาวิทยาลัยวูลลองกองในออสเตรเลียกล่าว

ความกลัวที่ AI 'แอบฟัง' ความคิด

Evelina Fedorenko นักประสาทวิทยาการรู้คิดจากสถาบันเทคโนโลยีแมสซาชูเซตส์ (MIT) ซึ่งไม่ได้มีส่วนร่วมในการศึกษาครั้งนี้ เรียกสิ่งนี้ว่า "ความสำเร็จเชิงวิธีการ"

แต่เธอตั้งคำถามว่าการฝังอุปกรณ์จะดักฟังความคิดของเราหลายอย่างได้หรือไม่ และเธอก็ไม่คิดว่าภาษามีบทบาทสำคัญในการคิด

เธอตั้งข้อสังเกตว่าแม้ว่าระบบคอมพิวเตอร์ BrainGate2 จะถอดรหัสคำที่ผู้ป่วยจินตนาการไว้ได้สำเร็จ แต่กลับมีประสิทธิภาพลดลงอย่างมากเมื่อผู้เข้าร่วมตอบสนองต่อคำขอปลายเปิด ตัวอย่างเช่น ในบางการทดลอง พวกเขาถูกขอให้คิดถึงงานอดิเรกในวัยเด็ก

“สิ่งที่พวกเขาบันทึกไว้ส่วนใหญ่เป็นเรื่องไร้สาระ” เธอตั้งข้อสังเกต “ฉันสงสัยว่าความคิดที่เกิดขึ้นเองตามธรรมชาติของมนุษย์ส่วนใหญ่ไม่ใช่ประโยคที่สมบูรณ์และเรียบเรียงอย่างดี”

ที่มา: https://tuoitre.vn/ai-giai-ma-duoc-tieng-noi-noi-tam-mo-ra-hy-vong-cho-nguoi-khong-the-noi-20250815093350614.htm

![[ภาพ] เลขาธิการโต ลัม เข้าร่วมพิธีเปิดอนุสาวรีย์ “ลุงโฮ อิน ตัน เตรา”](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/8/14/679bb11e3ce14b2aabc31a9c8676d269)

![[ภาพ] สะพานบินห์คานห์ นครโฮจิมินห์ เตรียมพร้อมเข้าเส้นชัยแล้ว](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/8/14/b0dcfb8ba9374bd9bc29f26e6814cee2)

![[ภาพ] ความสัมพันธ์สามัคคีพิเศษระหว่างเวียดนามและคิวบา](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/8/15/5f06c789ab1647c384ccb78b222ad18e)

![[ภาพ] เดินขบวนอย่างมั่นคงภายใต้ธงทหาร: พร้อมสำหรับเทศกาลใหญ่](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/8/15/86df2fb3199343e0b16b178d53f841ec)

การแสดงความคิดเห็น (0)