(CLO) เครื่องมือแปลงคำพูดเป็นข้อความ Whisper ของ OpenAI ได้รับการโฆษณาว่า "มีประสิทธิภาพและแม่นยำในระดับใกล้เคียงกับมนุษย์" แต่มีข้อเสียสำคัญประการหนึ่ง นั่นก็คือ มีแนวโน้มที่จะสร้างข้อความสั้นๆ หรือแม้แต่ประโยคทั้งหมดขึ้นมา!

ผู้เชี่ยวชาญกล่าวว่าข้อความบางส่วนที่ถูกแต่งขึ้น ซึ่งในวงการเรียกว่าข้อความหลอนประสาท อาจมีการวิพากษ์วิจารณ์เกี่ยวกับเชื้อชาติ ความรุนแรง และแม้แต่การรักษา ทางการแพทย์ ในจินตนาการ

ผู้เชี่ยวชาญกล่าวว่าการกุเรื่องดังกล่าวถือเป็นเรื่องร้ายแรง เนื่องจาก Whisper ถูกใช้ในหลายอุตสาหกรรมทั่ว โลก ในการแปลและถอดเสียงบทสัมภาษณ์ สร้างวิดีโอข้อความและคำบรรยาย

ที่น่ากังวลยิ่งกว่านั้น คือ ศูนย์การแพทย์กำลังใช้เครื่องมือที่ใช้ Whisper ในการบันทึกการปรึกษาระหว่างแพทย์กับคนไข้ แม้ว่า OpenAI จะเตือนว่าไม่ควรใช้เครื่องมือดังกล่าวใน "พื้นที่เสี่ยงสูง" ก็ตาม

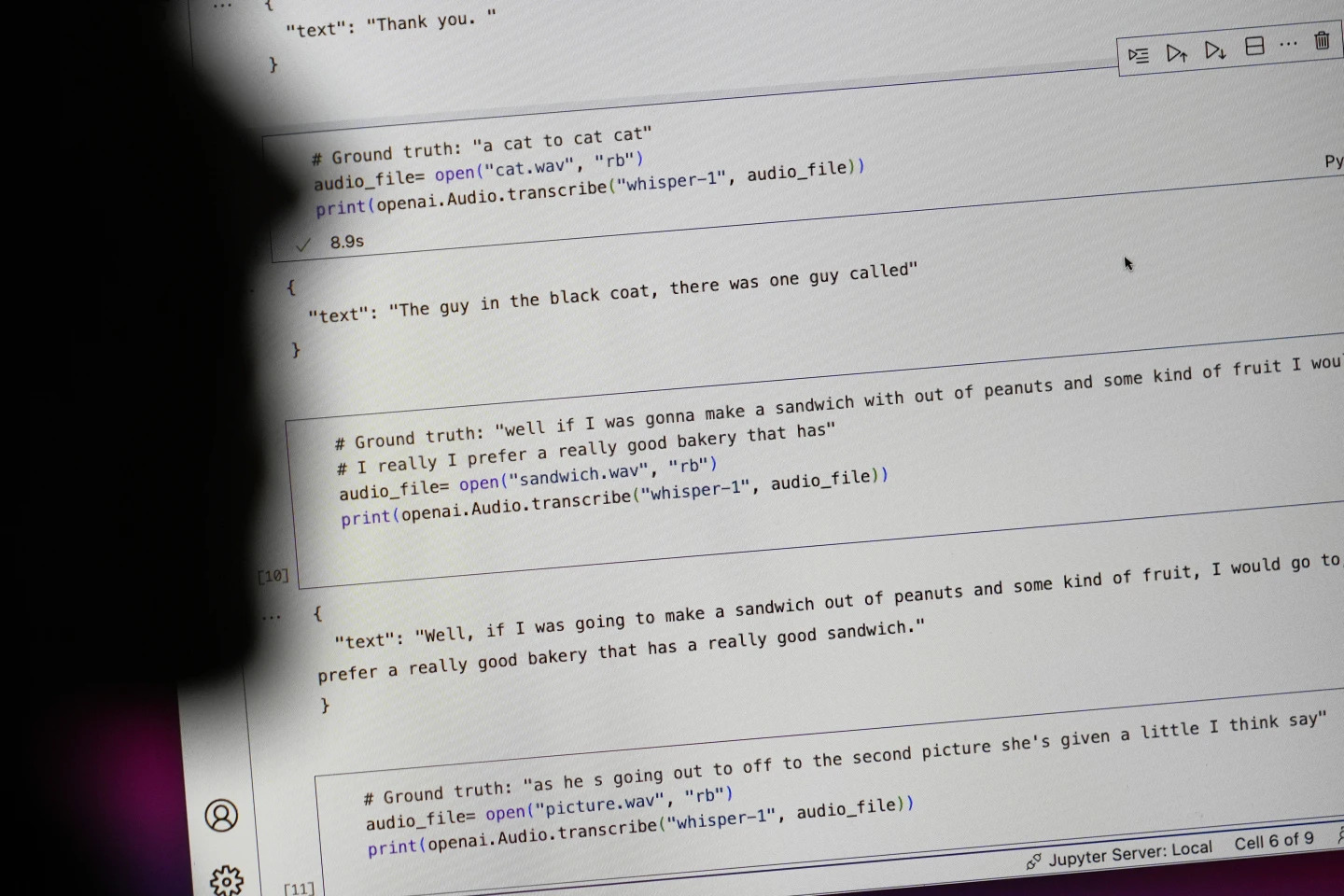

ประโยคที่ขึ้นต้นด้วย "#Groundtruth" คือประโยคที่ถูกพูดจริง ส่วนประโยคที่ขึ้นต้นด้วย "#text" คือประโยคที่ Whisper ถอดความออกมา ภาพ: AP

นักวิจัยและวิศวกรกล่าวว่า Whisper มักทำให้เกิดภาพหลอนระหว่างการใช้งาน ยกตัวอย่างเช่น นักวิจัยจากมหาวิทยาลัยมิชิแกนกล่าวว่าเขาพบภาพหลอนใน 8 ใน 10 ของการบันทึกที่เขาตรวจสอบ

วิศวกรการเรียนรู้ของเครื่องรุ่นแรกๆ ค้นพบการบิดเบือนในทรานสคริปต์ Whisper ที่เขาวิเคราะห์กว่า 100 ชั่วโมง ประมาณครึ่งหนึ่ง นักพัฒนาอีกรายหนึ่งกล่าวว่าเขาพบภาพหลอนในทรานสคริปต์ 26,000 ทรานสคริปต์ที่สร้างด้วย Whisper เกือบทั้งหมด

ภาพลวงตานี้ยังคงอยู่แม้ในตัวอย่างเสียงสั้นๆ ที่บันทึกไว้อย่างดี การศึกษาเมื่อเร็วๆ นี้โดย นักวิทยาศาสตร์ คอมพิวเตอร์พบความเพี้ยน 187 จุดในคลิปเสียงที่ชัดเจนกว่า 13,000 คลิปที่พวกเขาตรวจสอบ

นักวิจัยกล่าวว่าแนวโน้มดังกล่าวจะทำให้เกิดข้อผิดพลาดนับหมื่นรายการในบันทึกหลายล้านรายการ

ความผิดพลาดดังกล่าวอาจก่อให้เกิด “ผลลัพธ์ที่ร้ายแรงจริงๆ” โดยเฉพาะอย่างยิ่งในโรงพยาบาล Alondra Nelson ศาสตราจารย์จากคณะสังคมศาสตร์ สถาบันการศึกษาระดับสูง กล่าว

“ไม่มีใครอยากได้รับการวินิจฉัยผิด จำเป็นต้องมีกำแพงที่สูงกว่านี้” เนลสันกล่าว

ศาสตราจารย์อัลลิสัน โคเนค จากมหาวิทยาลัยคอร์เนลล์ และโมนา สโลน จากมหาวิทยาลัยเวอร์จิเนีย ได้ตรวจสอบข้อความสั้นๆ หลายพันฉบับที่พวกเขารวบรวมมาจาก TalkBank ซึ่งเป็นคลังข้อมูลงานวิจัยที่เก็บรักษาไว้ที่มหาวิทยาลัยคาร์เนกีเมลลอน พวกเขาพบว่าภาพหลอนเกือบ 40% เป็นอันตรายหรือรบกวนจิตใจ เนื่องจากผู้พูดอาจถูกเข้าใจผิดหรือบิดเบือน

ผู้พูดในบันทึกเสียงหนึ่งบรรยายถึง "เด็กผู้หญิงอีกสองคนและผู้หญิงหนึ่งคน" แต่ Whisper ได้กุเรื่องความคิดเห็นเกี่ยวกับเชื้อชาติเพิ่มเติม โดยเสริมว่า "เด็กผู้หญิงอีกสองคนและผู้หญิงหนึ่งคน เอ่อ ซึ่งเป็นคนผิวดำ"

ในอีกบทหนึ่ง Whisper ได้ประดิษฐ์ยาที่ไม่มีอยู่จริงที่เรียกว่า "ยาปฏิชีวนะที่มีฤทธิ์เพิ่มขึ้น"

ในขณะที่นักพัฒนาส่วนใหญ่ยอมรับว่าเครื่องมือถอดเสียงสามารถสะกดผิดหรือเกิดข้อผิดพลาดอื่นๆ ได้ วิศวกรและนักวิจัยกล่าวว่าพวกเขาไม่เคยเห็นเครื่องมือถอดเสียงที่ขับเคลื่อนด้วย AI ที่ทำให้ประสาทหลอนได้เท่ากับ Whisper มาก่อน

เครื่องมือนี้ถูกรวมเข้ากับ ChatGPT ซึ่งเป็นแชทบอทเรือธงของ OpenAI หลายเวอร์ชัน และเป็นบริการแบบบูรณาการในแพลตฟอร์มคลาวด์คอมพิวติ้งของ Oracle และ Microsoft ซึ่งให้บริการแก่บริษัทหลายพันแห่งทั่วโลก นอกจากนี้ยังใช้ในการถอดเสียงและแปลข้อความเป็นหลายภาษาอีกด้วย

หง็อก อันห์ (ตามรายงานของเอพี)

ที่มา: https://www.congluan.vn/cong-cu-chuyen-giong-noi-thanh-van-ban-ai-cung-co-the-xuyen-tac-post319008.html

การแสดงความคิดเห็น (0)