การโทรหลอกลวง Deepfake: การหลอกลวงรูปแบบใหม่และซับซ้อนมาก

กรณีตัวอย่างหนึ่งคือ คุณวีทีเอ็ม (อายุ 26 ปี จากลองเบียน ฮานอย ) ที่ได้รับข้อความจากญาติที่อยู่ต่างประเทศขอให้โอนเงิน 75 ล้านดองเข้าบัญชีหนึ่ง ตอนนั้นคุณวีทีเอ็มคิดว่าเป็นญาติ จึงรีบโอนเงินให้ทันที

คุณวีทีเอ็มเล่าว่า เมื่อเธอได้รับข้อความขอยืมเงินจากญาติ เธอจึงโทรกลับไปตรวจสอบ วิดีโอ อย่างละเอียด และพบว่าภาพดังกล่าวเป็นเพื่อนของเธอจริง ๆ คุณวีทีเอ็มจึงไว้ใจและโอนเงินให้ แต่หลังจากนั้นไม่นาน เธอเห็นโพสต์บนหน้าส่วนตัวของญาติที่ระบุว่าบัญชีเฟซบุ๊กของเธอถูกแฮ็กโดยมิจฉาชีพเพื่อขอให้เพื่อนและญาติยืมเงิน คุณวีทีเอ็มจึงโทรกลับไปหาญาติและพบว่าเธอถูกหลอก

หรือกรณีของนายวีซี (อายุ 42 ปี จากเมืองโกเญือ กรุงฮานอย) ที่ถูกกล่าวหาว่าถูกหลอกเอาเงินไป 30 ล้านดอง ผ่านวิดีโอคอลของ Deepfake โดยเฉพาะอย่างยิ่งเมื่อเร็วๆ นี้ ญาติคนหนึ่งที่บัญชีต่างประเทศส่งข้อความขอยืมเงินเนื่องจากมีเรื่องเร่งด่วน ทันทีหลังจากนั้น นางแทมก็ได้รับวิดีโอคอลผ่านแอปพลิเคชัน Messenger ของเฟซบุ๊ก

“การสนทนาทางโทรศัพท์นั้นใช้เวลาเพียงไม่กี่วินาที แต่ผมเห็นหน้าคนที่ผมรักและวิธีที่คุ้นเคยในการเรียกเขา แต่สายก็ขาดๆ หายๆ จากนั้นผมก็ได้รับข้อความว่าสัญญาณอ่อน ผมจึงไม่สามารถวิดีโอคอลต่อได้ ผมจึงเปลี่ยนไปส่งข้อความเพื่อความสะดวก ผมเชื่อใจเขาและโอนเงินตามที่เขาสั่ง” คุณวีซีเล่า

ผู้เชี่ยวชาญด้านเทคโนโลยี โง มินห์ เฮียว จากศูนย์เฝ้าระวัง ความมั่นคงปลอดภัยไซเบอร์ แห่งชาติ (NCSC) แสดงความคิดเห็นเกี่ยวกับประเด็นนี้ว่า เทคโนโลยีปัญญาประดิษฐ์ (AI) กำลังช่วยเหลือชีวิตผู้คนอย่างมาก อย่างไรก็ตาม ผู้ร้ายได้ใช้ประโยชน์จากเทคโนโลยี AI เพื่อสร้างภาพคัดลอกเสียง ตั้งแต่การแฮ็กบัญชีเฟซบุ๊กและอินสตาแกรม... จากนั้นศึกษาข้อความ รูปแบบที่อยู่ ประวัติการทำธุรกรรม... เพื่อสร้างสายปลอมและหลอกลวงเงินจากญาติและครอบครัวของผู้ถูกแฮ็กบัญชี ไปจนถึงการโทรหาเหยื่อโดยตรงเพื่อสร้างสถานการณ์เร่งด่วนที่ต้องโอนเงิน

“หลังจากเข้าควบคุม Facebook ของเหยื่อได้แล้ว ผู้หลอกลวงก็ส่งข้อความหาเหยื่อเพื่อขอยืมเงิน จากนั้นก็วิดีโอคอลหาเหยื่อด้วยวิดีโอ Deepfake แล้ววางสายไปไม่กี่วินาที จากนั้นก็บอกว่าสัญญาณโทรศัพท์หาย... ณ จุดนี้ เหยื่อก็ไว้ใจเขาและโอนเงินให้เพราะอีกฝ่ายจำเป็นต้องขอยืมเงินอย่างเร่งด่วน” ผู้เชี่ยวชาญด้านเทคโนโลยี Ngo Minh Hieu แสดงความคิดเห็น

นายโง ตวน อันห์ ประธานกรรมการและประธานเจ้าหน้าที่บริหารบริษัท สมาร์ท ไซเบอร์ ซีเคียวริตี้ จอยท์ สต็อก จำกัด กล่าวว่า ปัจจุบันการฉ้อโกงออนไลน์สามารถแบ่งได้เป็นสองวิธีหลัก ได้แก่ การปลอมแปลงเป็นหน่วยงานสืบสวนและศาล และการแสวงหาผลประโยชน์จาก “ความโลภ” ของประชาชน เช่น การรับรางวัลใหญ่และการหาเงินง่ายๆ... การฉ้อโกงทั้งสองรูปแบบนี้มีหลายสถานการณ์ รวมถึงกรณีที่ผู้ใช้จะได้รับคำแนะนำให้ตรวจสอบข้อมูลผ่านวิดีโอคอล ซึ่งผู้ฉ้อโกงเป็นผู้คิดค้นวิธีการ “ทำให้เป็นกลาง” เพื่อหลอกลวงเหยื่อ

Deepfake ทำงานอย่างไร?

ตามรายงานของตำรวจกรุงฮานอย Deepfake เป็นเทคโนโลยีที่ประยุกต์ใช้ ปัญญาประดิษฐ์ (AI) เพื่อสร้างผลิตภัณฑ์เทคโนโลยีเสียง ภาพ และวิดีโอที่ปลอมแปลงวัตถุในชีวิตจริงด้วยความแม่นยำสูงมาก

Deepfake จะใช้ไฟล์ภาพใบหน้าและเสียงของบุคคลจริงเพื่อสร้างใบหน้าและเสียงที่ตรงกับลักษณะใบหน้าและการแสดงออกของบุคคลอื่น จากนั้นจึงสร้างวิดีโอที่เลียนแบบบุคคลจริงได้อย่างสมบูรณ์แบบ บุคคลเหล่านั้นจะรวบรวมภาพและเสียงของผู้ใช้บนโซเชียลมีเดียผ่านอินเทอร์เน็ต โดยใช้เทคโนโลยี Deepfake เพื่อสร้างภาพเคลื่อนไหวและวิดีโอปลอมของผู้ใช้ที่กำลังพูดคุยออนไลน์ด้วยใบหน้า น้ำเสียง และวิธีการเรียกชื่อที่เหมือนกัน

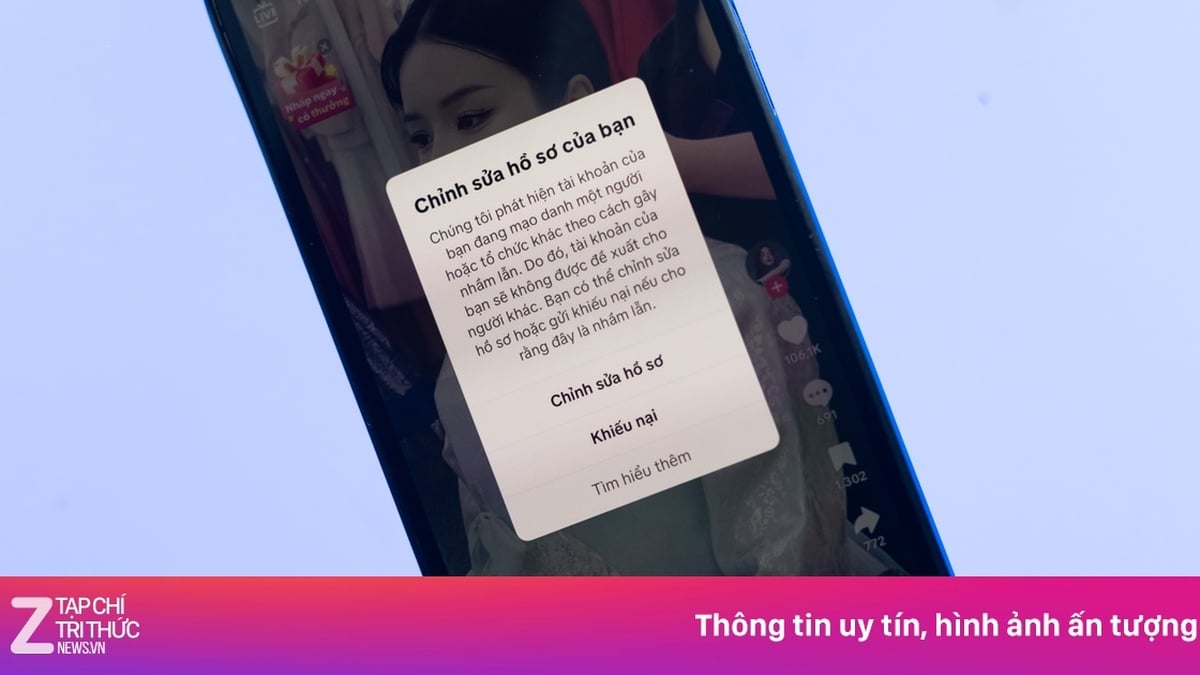

ผู้ถูกโจมตีจะสร้างบัญชีโซเชียลมีเดียปลอมโดยใช้ข้อมูลและรูปโปรไฟล์เดียวกันกับผู้ใช้ ผูกมิตรกับเหยื่อในรายชื่อเพื่อน และส่งข้อความขอยืมเงินตามสถานการณ์ที่เกิดขึ้น ในบางกรณี ผู้ถูกโจมตีอาจใช้บัญชีโซเชียลมีเดียของผู้ใช้เพื่อส่งข้อความถึงเหยื่อในรายชื่อเพื่อนโดยตรง เพื่อสร้างความไว้วางใจจากเหยื่อ ผู้ถูกโจมตีจะอัปโหลดวิดีโอ Deepfake ที่มีอยู่แล้วไปยังช่องทางวิดีโอคอล ทำให้เหยื่อสามารถจดจำภาพและเสียงของคนรู้จักได้ และโอนเงินอย่างรวดเร็วตามที่ผู้ถูกโจมตีร้องขอ

ตำรวจกรุงฮานอยเสริมว่าด้วยเทคโนโลยี Deepfake วิดีโอปลอมจึงมีความแม่นยำสูง ทำให้แยกแยะระหว่างของจริงและของปลอมได้ยาก อย่างไรก็ตาม วิดีโอที่ผู้ถูกกระทำมักมีเนื้อหาทั่วไปที่ไม่สอดคล้องกับบริบทการสื่อสารจริงของผู้ถูกกระทำ ซึ่งอาจทำให้ผู้ถูกกระทำเกิดความสงสัยและถูกตรวจจับได้ เพื่อปกปิดข้อบกพร่องข้างต้น ผู้ถูกกระทำมักสร้างวิดีโอที่มีเสียงที่ได้ยินยาก ภาพไม่ชัด คล้ายกับวิดีโอคอลที่มีสัญญาณไม่เสถียรในพื้นที่ที่มีสัญญาณโทรศัพท์มือถือ/Wi-Fi อ่อน นี่เป็นกลโกงที่ใหม่และซับซ้อนมาก

จะป้องกันไม่ให้ข้อมูลใบหน้าและเสียงถูกขโมยได้อย่างไร?

ตามที่ผู้เชี่ยวชาญด้านเทคโนโลยี Ngo Minh Hieu กล่าวไว้ วิธีที่ดีที่สุดในการหลีกเลี่ยง Deepfake คือการที่ผู้ใช้จำกัดการแชร์รูปภาพหรือวิดีโอส่วนตัวออนไลน์ และรักษาความปลอดภัยบัญชีโซเชียลมีเดียและอีเมลด้วยรหัสผ่านระดับสูงอยู่เสมอ

หากคุณแชร์วิดีโอหรือคลิปออนไลน์ คุณควรบิดเบือนเสียงของคุณและแทนที่ด้วยเสียงหุ่นยนต์หรือ AI เพื่อป้องกันไม่ให้ผู้ร้ายรู้ถึงเสียงจริงของคุณ

หาก Deepfake ถูกปลอมแปลง ผู้ใช้ควรแจ้งให้ทุกคนทราบโดยทันทีและรายงานไปยังหน่วยงานที่ canhbao.ncsc.gov.vn หรือรายงานไปยังโครงการ chongluadao https://chongluadao.vn ในเวลาเดียวกัน จำเป็นต้องเพิ่มการตระหนักรู้เกี่ยวกับการรับรู้การฉ้อโกงในโลกไซเบอร์ที่: dauhieuluadao.com

ตำรวจนครฮานอยแนะนำให้ประชาชนระมัดระวังเมื่อได้รับข้อความหรือวิดีโอคอลที่มีเนื้อหาเกี่ยวกับการยืมหรือให้ยืมเงินผ่านแอปพลิเคชันโซเชียลเน็ตเวิร์ก ประชาชนควรตั้งสติเมื่อได้รับข้อความหรือวิดีโอคอลที่มีเนื้อหาเกี่ยวกับการยืมหรือให้ยืมเงินผ่านแอปพลิเคชันโซเชียลเน็ตเวิร์ก จากนั้นให้โทรหรือติดต่อญาติโดยตรงเพื่อยืนยัน (อย่าโทรผ่านแอปพลิเคชันโซเชียลเน็ตเวิร์ก เช่น Zalo, Messenger, Viber, Telegram เป็นต้น) หากสงสัยว่ามีบุคคลแอบอ้างเป็นญาติบนโซเชียลมีเดียเพื่อฉ้อโกงหรือยักยอกทรัพย์สิน ให้แจ้งเจ้าหน้าที่ตำรวจในพื้นที่ทันที เพื่อให้ความช่วยเหลือและปราบปราม ป้องกัน และดำเนินการตามกฎหมายอย่างเคร่งครัด

คุณโง ตวน อันห์ ได้แบ่งปันวิธีป้องกันและปราบปรามสายหลอกลวง โดยระบุว่าประชาชนควรระมัดระวังและอย่าคลิกลิงก์แปลก ๆ หากจะโอนเงิน มีวิธีตรวจสอบที่ง่ายและมีประสิทธิภาพ นั่นคือ ตรวจสอบในแอปพลิเคชันธนาคารออนไลน์ของธนาคาร เพื่อดูว่าข้อมูลของญาติหรือเพื่อนที่แสดงเมื่อกรอกหมายเลขบัญชีถูกต้องหรือไม่ก่อนโอนเงิน

ผู้เชี่ยวชาญด้านเทคโนโลยี Ngo Minh Hieu กล่าวว่า สัญญาณที่ควรจดจำและหลีกเลี่ยงการโทรผ่าน Deepfake ก็คือ ใบหน้าของตัวละครในวิดีโอขาดอารมณ์ และค่อนข้าง "เฉยเมย" เมื่อพูด หรือท่าทางที่ดูเก้ๆ กังๆ ไม่เป็นธรรมชาติ หรือทิศทางของศีรษะและร่างกายของตัวละครในวิดีโอไม่สอดคล้องกัน

บริษัทด้านความปลอดภัยระบุว่า Deepfake เป็นการผสมผสานระหว่างคำว่า “deep” ใน “deep learning” และ “fake” Deep learning คือการใช้ AI ขั้นสูงที่ประยุกต์ใช้อัลกอริทึมมากมายเพื่อสังเคราะห์ฟีเจอร์ขั้นสูงจากข้อมูลอินพุต จากนั้นเทคโนโลยีนี้สามารถสังเคราะห์และเรียนรู้จากข้อมูลที่ผู้ใช้ป้อน เช่น ใบหน้ามนุษย์ การเคลื่อนไหวร่างกาย และเสียง Deepfake สามารถเชื่อมโยงใบหน้าของบุคคลหนึ่งเข้ากับอีกบุคคลหนึ่งในวิดีโอได้อย่างน่าเชื่อถือ |

สไตล์ออฟฟิศ

แหล่งที่มา

![[ข่าวการเดินเรือ] กว่า 80% ของความสามารถในการขนส่งตู้คอนเทนเนอร์ทั่วโลกอยู่ในมือของ MSC และพันธมิตรการขนส่งรายใหญ่](https://vphoto.vietnam.vn/thumb/402x226/vietnam/resource/IMAGE/2025/7/16/6b4d586c984b4cbf8c5680352b9eaeb0)

การแสดงความคิดเห็น (0)