นักวิจัยจากมหาวิทยาลัยสแตนฟอร์ดและวอชิงตันใช้เงินเพียง 50 ดอลลาร์เพื่อสร้างแบบจำลอง AI ที่ใช้เหตุผล

การทดสอบการเขียนโปรแกรมและคณิตศาสตร์แสดงให้เห็นว่า S1 (ชื่อของโมเดล) มีประสิทธิภาพเทียบเท่ากับโมเดล AI ที่ใช้เหตุผลล้ำสมัย เช่น o1 ของ OpenAI และ R1 ของ DeepSeek

ที่น่าสังเกตคือ S1 เป็นโมเดลโอเพ่นซอร์สที่สามารถเข้าถึงได้บนที่เก็บ GitHub ทุกคน

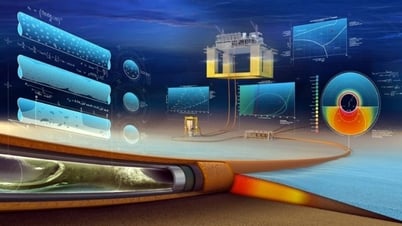

ทีมพัฒนาได้แจ้งว่าพวกเขาเริ่มต้นจากโมเดลพื้นฐานที่มีอยู่ จากนั้นจึงปรับปรุงให้ละเอียดขึ้นด้วยกระบวนการ "กลั่นกรอง" ซึ่งเป็นกระบวนการดึงความสามารถ "การใช้เหตุผล" ออกมาจากโมเดล AI อื่นด้วยการฝึกคำตอบของโมเดลนั้น

โดยเฉพาะอย่างยิ่ง S1 สกัดมาจากแบบจำลอง Gemini 2.0 Flash Thinking Experimental ของ Google กระบวนการกลั่นนี้คล้ายคลึงกับวิธีที่ นักวิทยาศาสตร์ จากมหาวิทยาลัยเบิร์กลีย์ใช้ในการสร้างแบบจำลองนี้ โดยมีต้นทุนประมาณ 450 ดอลลาร์สหรัฐ (ประมาณ 11.3 ล้านดอง)

นักวิจัยที่อยู่เบื้องหลัง s1 ได้ค้นพบวิธีที่ง่ายที่สุดในการบรรลุประสิทธิภาพการใช้เหตุผลที่แข็งแกร่งและ "ปรับขนาดขึ้นในระหว่างการทดสอบ" ซึ่งหมายถึงการอนุญาตให้โมเดล AI คิดมากขึ้นก่อนที่จะตอบคำถาม

นี่เป็นหนึ่งในความก้าวหน้าครั้งสำคัญของ o1 ของ OpenAI ซึ่ง DeepSeek และห้องปฏิบัติการ AI อื่นๆ พยายามจำลองโดยใช้เทคนิคต่างๆ

เอกสาร S1 แสดงให้เห็นว่าโมเดลการใช้เหตุผลสามารถกลั่นกรองได้ด้วยชุดข้อมูลขนาดค่อนข้างเล็กผ่านกระบวนการที่เรียกว่าการปรับแต่งอย่างละเอียดภายใต้การดูแล (SFT) ซึ่งโมเดล AI จะได้รับคำสั่งอย่างชัดเจนให้เลียนแบบพฤติกรรมบางอย่างในชุดข้อมูล

โดยทั่วไปแล้ว SFT จะมีราคาถูกกว่าแนวทางการเรียนรู้เชิงเสริมแรงขนาดใหญ่ที่ DeepSeek ใช้ในการฝึกอบรมโมเดล R1

Google มอบการเข้าถึง Gemini 2.0 Flash Thinking Experimental ฟรี แม้ว่าจะมีข้อจำกัดความถี่รายวัน ผ่านทางแพลตฟอร์ม Google AI Studio

อย่างไรก็ตาม เงื่อนไขของ Google ห้ามไม่ให้มีการวิศวกรรมย้อนกลับโมเดลเพื่อพัฒนาบริการที่แข่งขันกับผลิตภัณฑ์ AI ของบริษัท

S1 พัฒนาจากโมเดล AI ขนาดเล็กที่สามารถดาวน์โหลดได้ฟรีจาก Qwen ซึ่งเป็นห้องปฏิบัติการ AI ของอาลีบาบา เพื่อฝึก S1 นักวิจัยได้สร้างชุดข้อมูลคำถามที่คัดสรรมาอย่างดีจำนวน 1,000 ข้อ พร้อมด้วยคำตอบและกระบวนการ "คิด" เบื้องหลังคำตอบแต่ละข้อจาก Gemini 2.0 Flash Thinking Experimental ของ Google

กระบวนการฝึกอบรมใช้เวลาน้อยกว่า 30 นาทีด้วย GPU Nvidia H100 จำนวน 16 ตัว แต่ยังคงให้ผลลัพธ์ที่ยอดเยี่ยมในการวัดค่า AI หลายแบบ นิคลาส มูนนิกฮอฟฟ์ นักวิจัยจากมหาวิทยาลัยสแตนฟอร์ด กล่าวว่า ค่าเช่าพลังประมวลผลที่จำเป็นอยู่ที่ประมาณ 20 ดอลลาร์เท่านั้น

นักวิจัยใช้กลวิธีเพื่อให้ S1 ตรวจสอบงานของตนและขยาย "ระยะเวลาในการคิด" เช่น ขอให้โมเดลรอโดยการเพิ่มคำว่า "รอ" ลงในกระบวนการคิด ซึ่งช่วยให้โมเดลได้คำตอบที่แม่นยำยิ่งขึ้น

ภายในปี 2025 Meta, Google และ Microsoft วางแผนที่จะลงทุนหลายแสนล้านดอลลาร์ในโครงสร้างพื้นฐาน AI ซึ่งบางส่วนจะถูกนำไปใช้ในการฝึกอบรมโมเดล AI รุ่นต่อไป การลงทุนในระดับนี้อาจยังจำเป็นต่อการขับเคลื่อนนวัตกรรมด้าน AI

การกลั่นได้รับการพิสูจน์แล้วว่าเป็นวิธีที่ดีในการจำลองความสามารถของโมเดล AI ด้วยต้นทุนต่ำ แต่ไม่สามารถสร้างโมเดล AI ใหม่ที่เหนือกว่าสิ่งที่มีอยู่ในปัจจุบันได้

(ตามข้อมูลของ TechCrunch)

ที่มา: https://vietnamnet.vn/he-lo-bi-mat-tao-ra-mo-hinh-ai-ly-luan-sieu-re-chua-den-2-trieu-dong-2369052.html

การแสดงความคิดเห็น (0)