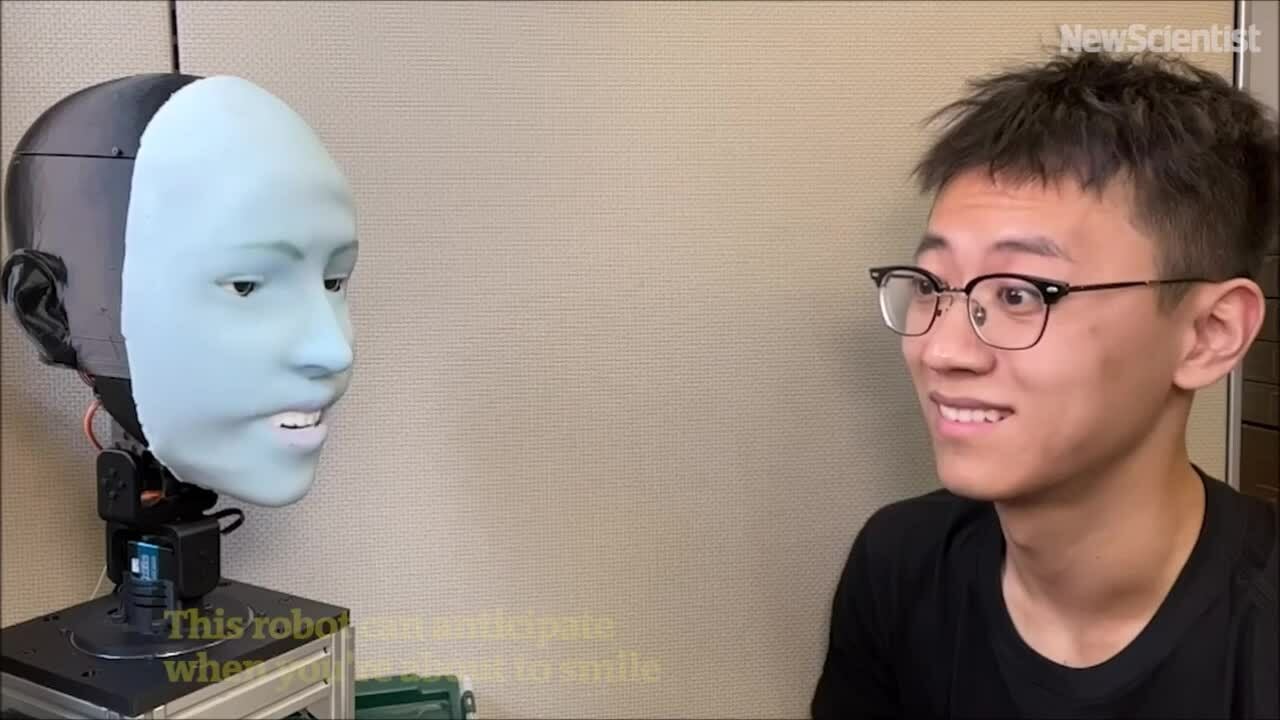

หุ่นยนต์อีโม อเมริกัน สามารถคาดเดารอยยิ้มได้ประมาณ 840 มิลลิวินาที ก่อนที่คนตรงข้ามจะยิ้มและยิ้มในเวลาเดียวกัน

หุ่นยนต์อีโมสามารถคาดเดาการแสดงออกและยิ้มได้ในเวลาเดียวกันกับบุคคลตรงข้าม วิดีโอ : New Scientist

มนุษย์กำลังเริ่มคุ้นเคยกับหุ่นยนต์ที่สามารถสื่อสารด้วยคำพูดได้อย่างคล่องแคล่ว ซึ่งส่วนหนึ่งเป็นผลมาจากความก้าวหน้าของโมเดลภาษาขนาดใหญ่อย่าง ChatGPT แต่ทักษะการสื่อสารแบบอวัจนภาษา โดยเฉพาะการแสดงออกทางสีหน้า ยังคงล้าหลังอยู่มาก การออกแบบหุ่นยนต์ที่ไม่เพียงแต่สามารถแสดงสีหน้าได้หลากหลาย แต่ยังรู้วิธีแสดงสีหน้าเหล่านั้นในเวลาที่เหมาะสมนั้นเป็นเรื่องยากอย่างยิ่ง

ห้องปฏิบัติการ Creative Machines Lab ที่คณะวิศวกรรมศาสตร์ มหาวิทยาลัยโคลัมเบีย ได้ศึกษาปัญหานี้มานานกว่าห้าปีแล้ว งานวิจัยใหม่ที่ตีพิมพ์ในวารสาร Science Robotics ทีมวิจัยได้เปิดตัว Emo หุ่นยนต์ AI ที่สามารถคาดการณ์การแสดงออกทางสีหน้าของมนุษย์และแสดงอารมณ์ได้แบบเรียลไทม์ TechXplore รายงานเมื่อวันที่ 27 มีนาคม หุ่นยนต์นี้สามารถคาดการณ์รอยยิ้มได้ประมาณ 840 มิลลิวินาทีก่อนที่มนุษย์จะยิ้ม และยิ้มตามไปด้วย

อีโมเป็นหุ่นยนต์ฮิวแมนนอยด์ที่มีใบหน้าพร้อมแอคชูเอเตอร์ 26 ตัว ที่ช่วยให้แสดงอารมณ์ได้หลากหลาย ส่วนหัวของหุ่นยนต์หุ้มด้วยซิลิโคนนุ่มพร้อมระบบเชื่อมต่อแม่เหล็ก ช่วยให้ปรับแต่งและบำรุงรักษาได้อย่างรวดเร็ว เพื่อการโต้ตอบที่สมจริงยิ่งขึ้น ทีมงานได้ผสานกล้องความละเอียดสูงเข้ากับรูม่านตาของดวงตาแต่ละข้าง ทำให้อีโมสามารถโต้ตอบกับดวงตาได้ ซึ่งเป็นสิ่งสำคัญในการสื่อสารแบบอวัจนภาษา

ทีมพัฒนาโมเดล AI สองโมเดล โมเดลแรกทำนายการแสดงออกทางสีหน้าของมนุษย์โดยการวิเคราะห์การเปลี่ยนแปลงเล็กๆ น้อยๆ บนใบหน้าตรงข้าม และโมเดลที่สองสร้างคำสั่งการเคลื่อนไหวโดยใช้การแสดงออกที่ตรงกัน

เพื่อฝึกให้หุ่นยนต์แสดงอารมณ์ ทีมวิจัยได้นำอีโมมาวางไว้หน้ากล้องและให้หุ่นยนต์เคลื่อนไหวอย่างสุ่ม หลังจากผ่านไปไม่กี่ชั่วโมง หุ่นยนต์ก็เรียนรู้ความสัมพันธ์ระหว่างการแสดงออกทางสีหน้าและคำสั่งการเคลื่อนไหว คล้ายกับวิธีที่มนุษย์ฝึกฝนการแสดงออกทางอารมณ์โดยการมองกระจก ทีมวิจัยเรียกสิ่งนี้ว่า "การสร้างแบบจำลองตนเอง" ซึ่งคล้ายกับการจินตนาการถึงตนเองขณะแสดงอารมณ์ต่างๆ

จากนั้น ทีมงานได้เปิดวิดีโอแสดงสีหน้าของมนุษย์ให้อีโมสังเกตทีละเฟรม หลังจากฝึกฝนมาหลายชั่วโมง อีโมสามารถคาดเดาสีหน้าได้โดยการสังเกตการเปลี่ยนแปลงเล็กๆ น้อยๆ บนใบหน้าของบุคคลขณะที่พวกเขาเริ่มยิ้ม

“ผมคิดว่าการทำนายการแสดงออกทางสีหน้าของมนุษย์ได้อย่างแม่นยำถือเป็นการปฏิวัติวงการปฏิสัมพันธ์ระหว่างมนุษย์กับหุ่นยนต์ ก่อนหน้านี้ หุ่นยนต์ไม่ได้ถูกออกแบบมาให้พิจารณาการแสดงออกทางสีหน้าของมนุษย์ระหว่างการปฏิสัมพันธ์กัน แต่ตอนนี้ หุ่นยนต์สามารถผสานการแสดงออกทางสีหน้าเพื่อตอบสนองต่อสิ่งต่างๆ ได้แล้ว” ยูหัง หู นักศึกษาปริญญาเอกจากห้องปฏิบัติการ Creative Machines Lab และหนึ่งในสมาชิกทีมวิจัยกล่าว

“การให้หุ่นยนต์แสดงสีหน้าแบบเรียลไทม์พร้อมกับมนุษย์ ไม่เพียงแต่ช่วยปรับปรุงคุณภาพการโต้ตอบเท่านั้น แต่ยังช่วยสร้างความไว้วางใจระหว่างมนุษย์และหุ่นยนต์อีกด้วย ในอนาคต เมื่อหุ่นยนต์มีปฏิสัมพันธ์กับมนุษย์ มันจะสังเกตและตีความสีหน้าของคุณ เหมือนกับมนุษย์จริงๆ” หูกล่าวเสริม

Thu Thao (อ้างอิงจาก TechXplore )

ลิงค์ที่มา

![[ข่าวการเดินเรือ] กว่า 80% ของความสามารถในการขนส่งตู้คอนเทนเนอร์ทั่วโลกอยู่ในมือของ MSC และพันธมิตรการขนส่งรายใหญ่](https://vphoto.vietnam.vn/thumb/402x226/vietnam/resource/IMAGE/2025/7/16/6b4d586c984b4cbf8c5680352b9eaeb0)

การแสดงความคิดเห็น (0)