Як працюють підроблені зображення зі штучним інтелектом?

Штучний інтелект сьогодні всюди – навіть на війні. Застосування штучного інтелекту настільки покращилося цього року, що майже кожен може використовувати генератори штучного інтелекту для створення зображень, які виглядають реалістично, принаймні на перший погляд.

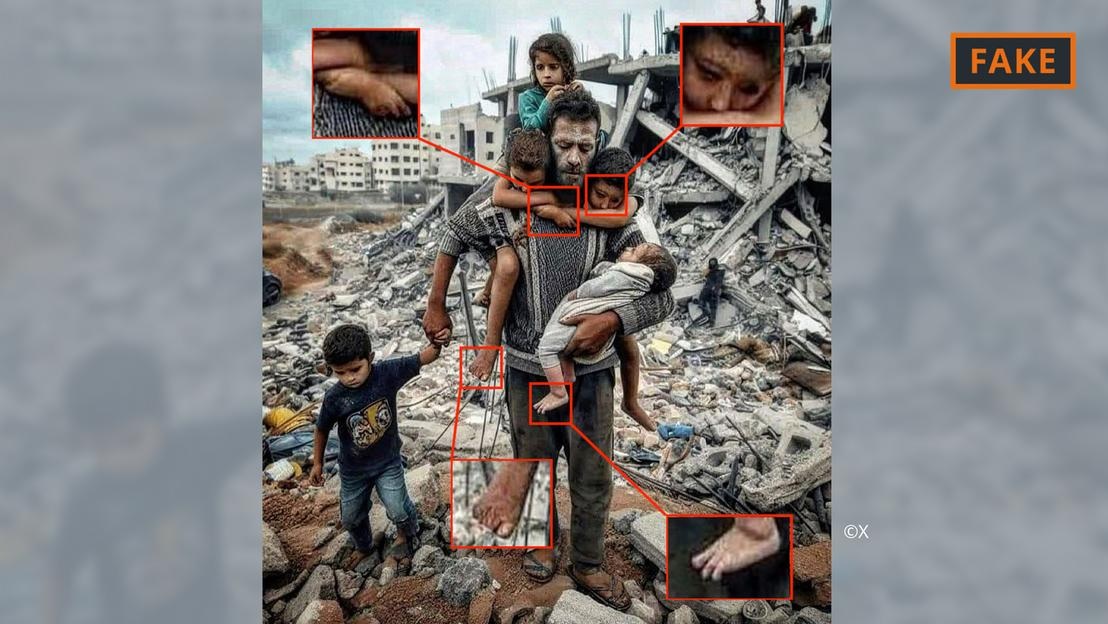

Згенероване штучним інтелектом фальшиве фото війни в Газі.

Користувачі просто надають інструментам, таким як Midjourney або Dall-E, кілька підказок, включаючи специфікації та інформацію, для цього. Потім інструменти штучного інтелекту перетворюють текстові або навіть голосові підказки на зображення.

Цей процес створення зображень базується на так званому машинному навчанні. Наприклад, якщо творець просить показати 70-річного чоловіка, який їде на велосипеді, він шукатиме у своїй базі даних відповідні терміни зображенням.

На основі наявної інформації алгоритм штучного інтелекту генеруватиме зображення літнього велосипедиста. Зі збільшенням кількості вхідних даних та технічними оновленнями ці інструменти значно покращилися та постійно навчаються.

Все це застосовується до зображень, пов’язаних із конфліктом на Близькому Сході. У конфлікті, де «емоції настільки високі», дезінформація, зокрема поширена через зображення, створені штучним інтелектом, має величезний вплив, каже експерт зі штучного інтелекту Хані Фарід.

Фарід, професор цифрової аналітики в Каліфорнійському університеті в Берклі, сказав, що запеклі битви є ідеальним середовищем для створення та поширення фейкового контенту, а також для розпалювання емоцій.

Типи зображень війни між Ізраїлем та ХАМАС, створених штучним інтелектом

Зображення та відео, створені за допомогою штучного інтелекту, підживлювали дезінформацію, пов'язану з війною в Україні, і це продовжує відбуватися у війні між Ізраїлем та ХАМАС.

За словами експертів, зображення війни, створені штучним інтелектом, що поширюються в соціальних мережах, часто поділяються на дві категорії. Одна зосереджена на стражданнях людей і викликає співчуття. Інша — це фальшивий штучний інтелект, який перебільшує події, тим самим провокуючи конфлікти та ескалацію насильства.

Фальшиве фото батька та дитини під завалами в Газі, створене штучним інтелектом.

Наприклад, до першої категорії належить фотографія вище, на якій зображено батька та його п’ятьох дітей на тлі купи уламків. Її неодноразово поширювали в X (раніше Twitter) та Instagram, і її переглянули сотні тисяч разів.

Це зображення було позначено спільнотою, принаймні на X, як підробка. Його можна розпізнати за різними помилками та невідповідностями, типовими для зображень, створених штучним інтелектом (див. зображення вище).

Подібні аномалії також можна побачити на підробленому зображенні, створеному за допомогою штучного інтелекту, яке стало вірусним на X нижче, де нібито зображена палестинська родина, яка разом обідає на руїнах.

Фальшиве фото палестинської вечірки, створене штучним інтелектом.

Тим часом, інше зображення, на якому зображено військових, що розмахують ізраїльськими прапорами, проходячи через поселення, заповнене розбомбленими будинками, належить до другої категорії, спрямованої на розпалювання ненависті та насильства.

Звідки беруться такі зображення зі штучним інтелектом?

Більшість зображень конфлікту, створених штучним інтелектом, публікуються на платформах соціальних мереж, але вони також доступні на низці інших платформ та організацій, і навіть на деяких новинних сайтах.

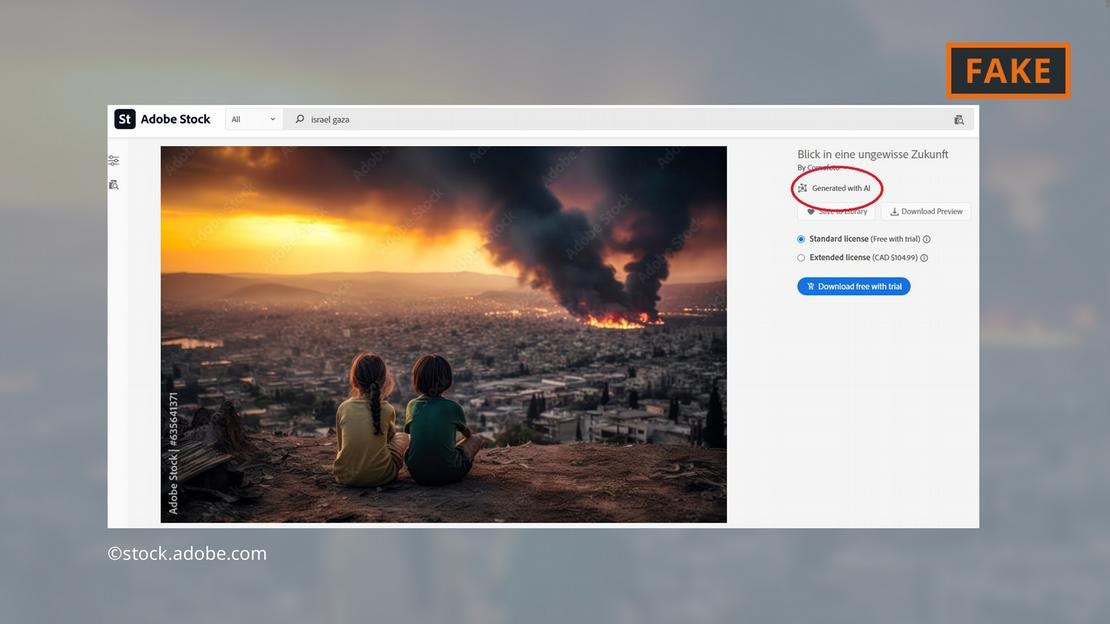

Компанія-розробник програмного забезпечення Adobe потрапила в заголовки газет, додавши зображення, згенеровані штучним інтелектом, до своєї колекції стокових фотографій до кінця 2022 року. Вони будуть відповідно позначені в базі даних.

Adobe також тепер пропонує на продаж зображення війни на Близькому Сході, створені за допомогою штучного інтелекту, — наприклад, вибухи, протести людей або клуби диму за мечеттю Аль-Акса.

Adobe пропонує зображення бойових дій у Газі, створені за допомогою штучного інтелекту.

Критики вважають це тривожним, оскільки деякі сайти продовжують використовувати зображення, не позначаючи їх як створені штучним інтелектом. Наприклад, відповідне зображення з’явилося на сторінці «Новини» без жодних ознак того, що воно було створене штучним інтелектом.

Навіть Європейська парламентська дослідницька служба, науковий підрозділ Європейського парламенту, проілюструвала онлайн-текст про конфлікт на Близькому Сході зображенням, створеним за допомогою штучного інтелекту, з бази даних Adobe, не позначивши його як створене штучним інтелектом.

Європейська обсерваторія цифрових медіа закликає журналістів та медіа-фахівців бути надзвичайно обережними під час використання зображень, створених штучним інтелектом, радячи утриматися від їх використання, особливо під час висвітлення реальних подій, таких як війна в Газі.

Наскільки небезпечні зображення зі штучним інтелектом?

Вірусний контент та зображення, створені штучним інтелектом, неминуче викликають у користувачів занепокоєння щодо всього, з чим вони стикаються в Інтернеті. «Якщо ми потрапимо у світ, де зображення, аудіо та відео можна маніпулювати, все стане підозрілим», – пояснює дослідник Каліфорнійського університету в Берклі Фарід. «Тож ви втрачаєте довіру до всього, включаючи правду».

Саме це сталося в наступному випадку: зображення того, що вважається обвугленим трупом ізраїльської дитини, опублікував у соціальних мережах прем'єр-міністр Ізраїлю Біньямін Нетаньягу та кілька інших політиків.

Пізніше інфлюенсер, який виступав проти Ізраїлю, Джексон Хінкл заявив, що зображення було створено за допомогою штучного інтелекту. Заява Хінкла була переглянута понад 20 мільйонів разів у соціальних мережах і призвела до гарячих дискусій на платформі.

Зрештою, численні організації та інструменти перевірки заявили, що зображення було справжнім, а твердження Хінкла було хибним. Однак, очевидно, що жоден інструмент не може допомогти користувачам легко повернути втрачену довіру!

Хоанг Хай (за даними DW)

Джерело

![[Фото] Прем'єр-міністр Фам Мінь Чінь відвідав щорічний бізнес-форум В'єтнаму](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/11/10/1762780307172_dsc-1710-jpg.webp)

![[Фото] Прем'єр-міністр Фам Мінь Чінь взяв участь у Конгресі патріотичного змагання Міністерства закордонних справ на період 2025-2030 років](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/11/10/1762762603245_dsc-1428-jpg.webp)

![Перехідний період Донг Най OCOP: [Стаття 3] Зв'язок туризму зі споживанням продукції OCOP](https://vphoto.vietnam.vn/thumb/402x226/vietnam/resource/IMAGE/2025/11/10/1762739199309_1324-2740-7_n-162543_981.jpeg)

Коментар (0)