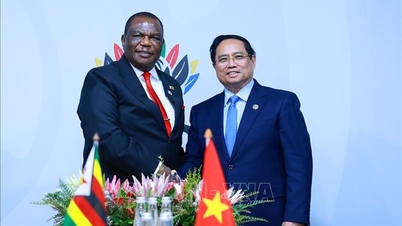

اقترح رئيس لجنة العلوم والتكنولوجيا والبيئة، نجوين ثانه هاي، إضافة لوائح تحظر استخدام الذكاء الاصطناعي للتلاعب بالانتخابات أو التسبب في اضطرابات سياسية أو تحريض أو انتهاك الأمن القومي. الصورة: Quochoi.vn

في 21 نوفمبر، استمرارًا للدورة العاشرة، استمعت الجمعية الوطنية إلى تقرير بشأن دراسة مشروع قانون الذكاء الاصطناعي.

وقال رئيس لجنة العلوم والتكنولوجيا والبيئة في الجمعية الوطنية نجوين ثانه هاي، في تقديم تقرير المراجعة، إنه بهدف بناء القانون كقانون إطاري، فإن معظم أحكام مشروع القانون بشكل عام مناسبة للظروف العملية في المراحل المبكرة من تطوير الذكاء الاصطناعي في فيتنام اليوم.

ولضمان جدوى القانون، توصي اللجنة بأن تولي هيئة الصياغة الاهتمام ببعض المحتويات الإضافية، مثل الاستمرار في المراجعة والتحسين لضمان أن تكون اللوائح الإطارية واضحة ومتماسكة وتحتوي على مبادئ وتوجهات لمواصلة تطوير الوثائق التوجيهية وتطبيقها بشكل فعال في الممارسة العملية.

استكمال مشروع المرسوم مع تفصيل وتوجيه تنفيذه، والوثائق التوجيهية الأخرى ذات الصلة وإصدارها أو تقديمها إلى الحكومة لإصدارها في الوقت المناسب لتجنب خلق ثغرات قانونية.

وفيما يتعلق باللوائح الخاصة بما قبل التفتيش، اقترحت اللجنة مراجعة وتقليص اللوائح الخاصة بما قبل التفتيش مثل متطلبات الوثائق الفنية وسجلات التشغيل قبل طرح المنتجات للتداول، وهو ما سيزيد من تكاليف الامتثال، ويبطئ عملية الابتكار وتطبيق الذكاء الاصطناعي، ويقلل القدرة التنافسية وجذب الاستثمار، ويحتاج إلى دراسة التحول القوي إلى آلية ما بعد التفتيش.

وفيما يتعلق بقاعدة بيانات نظام الذكاء الاصطناعي الوطني وقاعدة بيانات خدمات الذكاء الاصطناعي، اقترحت اللجنة إضافة مبادئ أساسية لضمان جودة بيانات خدمات الذكاء الاصطناعي مثل: يجب أن تكون البيانات "صحيحة - كافية - نظيفة - حية - موحدة - مشتركة".

هناك آلية للترابط وتبادل البيانات لمنع تشتت البيانات، مما قد يؤدي إلى خلق اختناقات في البحث والتطوير في مجال الذكاء الاصطناعي؛ وهناك لوائح إلزامية لضمان أمن الشبكة، وأمن البيانات والدفاع عن البنية التحتية الوطنية للذكاء الاصطناعي ، ومنع خطر الاختطاف وتسريب البيانات.

فيما يتعلق بالمسؤولية القانونية للأطراف المعنية، يُمكن للذكاء الاصطناعي أيضًا أن يُرتكب أفعالًا وأخطاءً بشرية. ومع ذلك، تتباين وجهات النظر حول المسؤولية القانونية للذكاء الاصطناعي، مما يُصعّب تحديد المسؤولية بالمعنى التقليدي. عند وقوع حادث، يُثير نزاعات حول المسؤولية الإدارية والمدنية والجنائية.

لذلك، من الضروري استكمال المبادئ للتمييز بين المسؤوليات بين الأطراف المعنية والأطراف ذات الصلة، بما في ذلك الموردين الأجانب، عند تقديم خدمات الذكاء الاصطناعي عبر الحدود والتمييز بين الحالات أو الأخطاء المتعمدة وغير المتعمدة بسبب القيود التقنية والمواقف غير المتوقعة.

وفيما يتعلق بالأفعال المحظورة، اقترحت اللجنة، وفقا لرئيسها نجوين ثانه هاي، استكمال اللوائح المتعلقة بالأفعال المحظورة للمساهمة في التعرف المبكر على الانتهاكات من مرحلة البحث إلى نشر استخدام الذكاء الاصطناعي.

ويجب أن يشمل ذلك سلوك المستخدمين والمنظمات والأفراد الذين يستغلون الذكاء الاصطناعي للقيام بأعمال محظورة في الاتجاه التالي: حظر استخدام الذكاء الاصطناعي لإحداث الاضطرابات، والتحريض على السياسة، وانتهاك الأمن القومي، والتلاعب بالأصوات والانتخابات؛

لا تستخدم الذكاء الاصطناعي لإنشاء محتوى مزيف، أو إنشاء صور، أو مقاطع فيديو، أو تقديم الاحتيال، أو إهانة الشرف، أو الكرامة، أو التسبب في الانقسام، أو غيرها من الأغراض السيئة.

السيد هوي

تعليق (0)