في منتصف ديسمبر، بدأت ميتا بدمج روبوت محادثة ذكي يُدعى ميتا إيه آي في تطبيق ماسنجر في فيتنام، وأصدرته مجانًا لجميع المستخدمين. يستخدم هذا الروبوت نموذج لغة لاما 3.2، ويدعم اللغة الفيتنامية، ويتيح البحث عن المعلومات، وإنشاء الصور، والدردشة.

بعد فترة وجيزة، اكتشف العديد من المستخدمين في فيتنام خطأً فادحًا في برنامج Meta AI أثناء إنشاء الصور. تحديدًا، عند إدخال كلمة "كلب أسود"، كان برنامج الدردشة الآلي يعرض صورة رجل أو فتى داكن البشرة بشعر مجعد. وعند إدخال كلمة "صورة كلب أسود" باللغة الفيتنامية، كان برنامج Meta AI يعرض نتائج مماثلة.

إن رسم الذكاء الاصطناعي للأشخاص ذوي البشرة الملونة أثناء طلب الأمر لمحتوى مختلف يعد مشكلة خطيرة

في 31 ديسمبر، أعلن ممثل شركة ميتا في فيتنام رسميًا عن الحادثة. وأكدت الشركة المشكلة المذكورة وأعلنت حلها. كما اعتذرت ميتا فيتنام عن الحادثة، مشيرةً إلى أن هذه المشكلة قد تحدث في أنظمة ذكاء اصطناعي توليدية أخرى موجودة.

نعتذر عن هذا الخطأ. تعمل ميتا على بناء إجراءات وقائية في ميزاتنا ونماذج الذكاء الاصطناعي لدينا لتوفير تجربة أكثر أمانًا ومتعة للجميع. ومع ذلك، وكما هو الحال مع أنظمة الذكاء الاصطناعي التوليدية الأخرى، قد يعرض هذا النموذج محتوى غير دقيق أو مسيء، لذا نشجع المستخدمين على استخدام هذه الأدوات بمسؤولية، وفقًا لممثل الشركة.

بعد فترة من الخبرة، يحظى Meta AI بتقدير كبير من قِبل الكثيرين لقدرته على استخدام اللغة للاستجابة بسلاسة تامة. كما تُقدم ميزة إنشاء الصور جودة عالية مقارنةً بالنموذج المجاني المُتاح للمستخدمين. قد يعود جزء من السبب إلى استخدام Meta للمحتوى المنشور على فيسبوك كبيانات إدخال في عملية تدريب الذكاء الاصطناعي، مما يُمكّن هذه الأداة من التعبير عن الأوامر وتنفيذها تلقائيًا.

مع ذلك، لا يزال من الصعب تجنب حوادث كالعنصرية أو ردود الفعل التي لا تتوافق مع معايير الذكاء الاصطناعي. تقول ميتا إنها تختبر ذكاءها الاصطناعي مع خبراء في مجال الذكاء الاصطناعي من خلال اختبارات "التعاون الأحمر" لتحديد الاستخدامات غير المقصودة، والتي تُعالجها بعد ذلك من خلال عملية تحسين مستمرة.

[إعلان 2]

المصدر: https://thanhnien.vn/meta-xin-loi-vi-su-co-ai-ve-con-cho-da-den-185241231104908626.htm

![[صورة] رئيس الوزراء فام مينه تشينه والأمين العام للأمم المتحدة أنطونيو غوتيريش يحضران المؤتمر الصحفي لحفل توقيع اتفاقية هانوي](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/10/25/1761391413866_conguoctt-jpg.webp)

![[صورة] استقبل الأمين العام تو لام الوفد المشارك في المؤتمر الدولي للدراسات الفيتنامية](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/10/26/1761456527874_a1-bnd-5260-7947-jpg.webp)

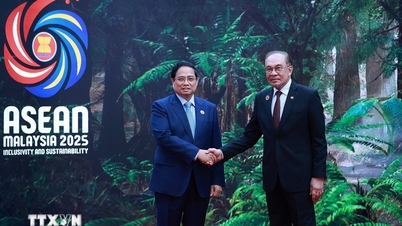

![[صورة] رئيس الوزراء فام مينه تشينه يحضر افتتاح القمة السابعة والأربعين لرابطة دول جنوب شرق آسيا](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/10/26/1761452925332_c2a-jpg.webp)

![[صورة] رئيس الجمعية الوطنية تران ثانه مان يستقبل الأمين العام للأمم المتحدة أنطونيو غوتيريش](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/10/25/1761390815792_ctqh-jpg.webp)

تعليق (0)