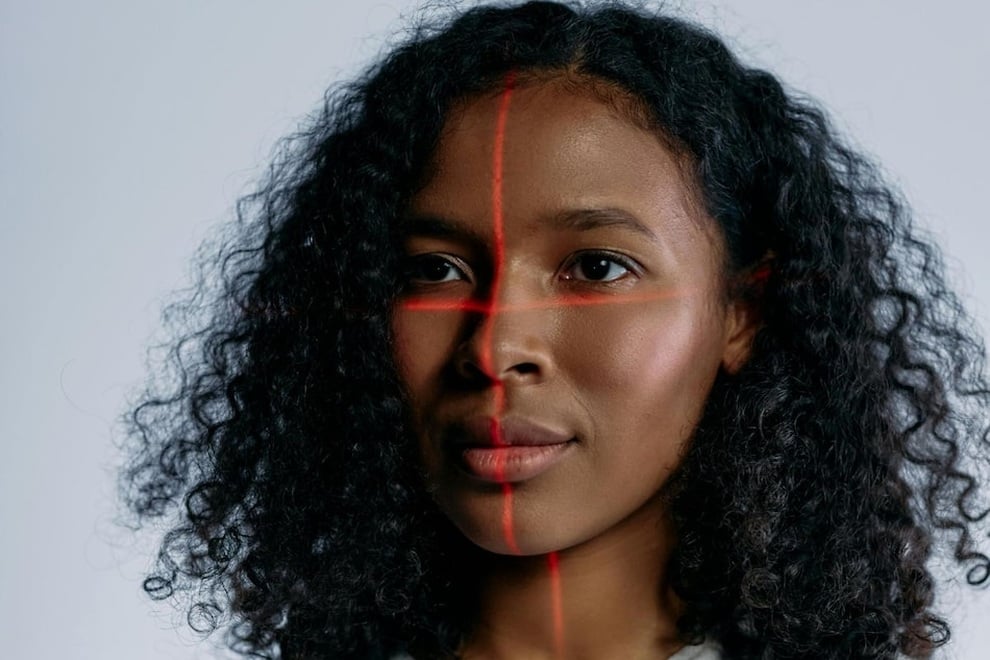

(دان تري) - يمكن لنموذج Chameleon AI إضافة أقنعة رقمية لحماية الصور من أدوات التعرف على الوجه.

نجح فريق من الباحثين في تطوير نظام ذكاء اصطناعي يمكنه حماية المستخدمين من عمليات مسح الوجه التي يقوم بها المتسللون والمحتالون للوصول إلى المعلومات الشخصية والحسابات الرقمية.

هذه الأداة تسمى الحرباء.

يعمل Chameleon عن طريق "إخفاء" وجه المستخدم من خلال إنشاء قناع مخفي، وقد تم تحسين نموذج الذكاء الاصطناعي هذا بالبيانات مما يجعل من الممكن استخدامه على الأجهزة ذات التقنية المنخفضة الأداء.

تم نشر نموذج الذكاء الاصطناعي هذا من قبل باحثين في معهد جورجيا للتكنولوجيا (Georgia Tech، الولايات المتحدة الأمريكية) في مجلة arXiv.

وسوف يساعد المستخدمين على حماية هوياتهم من محاولات مسح بيانات الوجه التي يقوم بها المتسللون وروبوتات جمع البيانات بالذكاء الاصطناعي.

قال البروفيسور لينج ليو، قسم بيانات الحوسبة الذكية في كلية علوم الكمبيوتر في معهد جورجيا للتكنولوجيا: "إن مشاركة البيانات والتحليلات التي تحافظ على الخصوصية مثل Chameleon من شأنها أن تساعد في تعزيز الحوكمة المسؤولة وتبني تقنية الذكاء الاصطناعي، وخلق زخم في المجال العلمي من خلال الابتكار المسؤول والمبتكر".

بمجرد تطبيق نموذج القناع، لن تتمكن أدوات التعرف على الوجه من اكتشاف الصورة لأن الفحص سيظهرها "كشخص آخر".

في الواقع، توجد بالفعل أدوات ذكاء اصطناعي مماثلة، ولكن Chameleon يأتي مع الكثير من التحسينات مثل تحسين البيانات وجودة أمان الصورة الأعلى.

وبدلاً من استخدام أقنعة منفصلة لكل صورة، تقوم الأداة بإنشاء قناع لكل مستخدم استنادًا إلى عدد قليل من صور الوجه التي قام المستخدم بتحديثها، كما لاحظ الباحثون.

أحد التحديات التي تواجه هذه الأداة هو الحفاظ على جودة الصورة، لذلك استخدم الباحثون تقنية مظلمة لتحسين "الإدراك" من Chameleon.

سيقوم تلقائيًا بمعالجة القناع دون أي تدخل يدوي أو ضبط المعلمات، مما يسمح للذكاء الاصطناعي بعدم التغاضي عن جودة الصورة الإجمالية.

إنها أداة ذكاء اصطناعي موجهة نحو الخصوصية، وكشف الباحثون أنهم يخططون قريبًا لإصدار كود Chameleon علنًا على GitHub، والذي سيتم بعد ذلك جعله مفتوح المصدر واستخدامه من قبل المطورين للتكامل في التطبيقات.

[إعلان 2]

المصدر: https://dantri.com.vn/suc-manh-so/nguoi-dung-tranh-duoc-lua-dao-tu-nhan-dang-khuon-mat-nho-cong-cu-ai-moi-20241203130212300.htm

![[صورة] دا نانغ: مئات الأشخاص يتعاونون لتنظيف طريق سياحي حيوي بعد العاصفة رقم 13](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/11/07/1762491638903_image-3-1353-jpg.webp)

تعليق (0)