أكد ممثلو شركة OpenAI الأمريكية استعدادهم للتعاون مع هيئة حماية البيانات الإيطالية لمعالجة المخاوف المتعلقة بـ ChatGPT - وهو روبوت محادثة مدعوم بالذكاء الاصطناعي (AI).

أصدرت هيئة مراقبة الخصوصية الإيطالية بيانًا في 6 أبريل ذكرت فيه أن الحكومة الإيطالية ليس لديها أي نية لعرقلة تطوير الذكاء الاصطناعي والابتكار التكنولوجي، وأكدت على أهمية الامتثال للقوانين التي تحمي البيانات الشخصية للمواطنين الإيطاليين والأوروبيين.

وفي الوقت نفسه، أكدت شركة OpenAI التزامها بزيادة الشفافية في استخدام البيانات الشخصية وتعزيز الآليات القائمة لتنفيذ حقوق الأطفال وحمايتهم، وستقدم مقترحات أخرى للنظر فيها من قبل هيئة مراقبة الخصوصية.

في 31 مارس، قامت هيئة حماية البيانات الإيطالية بتقييد روبوت الدردشة ChatGPT مؤقتًا وسط مزاعم تفيد بأن OpenAI ربما جمعت بشكل غير قانوني بيانات شخصية لمستخدمين إيطاليين. وقالت الوكالة إنه سيتم تعليق عمليات روبوت المحادثة حتى يفي التطبيق بمعايير الخصوصية واللوائح الإيطالية. وقد جذبت هذه الخطوة اهتمامًا عالميًا، حيث تخضع برامج المحادثة الآلية لتدقيق متزايد.

في إن إيه

خوفًا من تسرب البيانات، إيطاليا تحظر ChatGPT

قررت السلطات الإيطالية، في 31 مارس/آذار، حظر أداة الذكاء الاصطناعي المسماة ChatGPT مؤقتًا، حيث تجري البلاد تحقيقات في إمكانية انتهاك تطبيق chatbot لقواعد حماية البيانات الصارمة للاتحاد الأوروبي.

![[صورة] الأمين العام تو لام يعقد اجتماعا قصيرا مع الرئيس الروسي فلاديمير بوتن](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/5/10/bfaa3ffbc920467893367c80b68984c6)

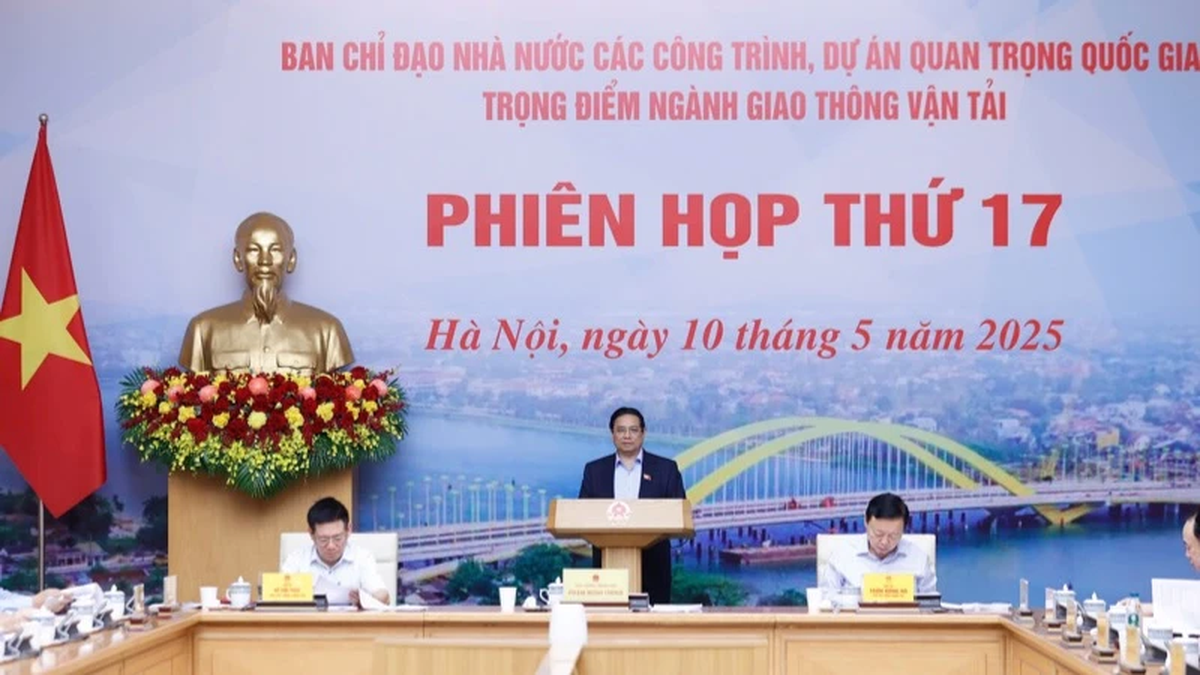

![[صورة] رئيس الوزراء فام مينه تشينه يرأس اجتماع اللجنة التوجيهية للمشاريع الرئيسية في قطاع النقل.](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/5/10/0f4a774f29ce4699b015316413a1d09e)

تعليق (0)