নকল এআই ছবি কীভাবে কাজ করে?

আজকাল কৃত্রিম বুদ্ধিমত্তা সর্বত্রই আছে - এমনকি যুদ্ধের সময়ও। এই বছর কৃত্রিম বুদ্ধিমত্তার প্রয়োগগুলি এতটাই উন্নত হয়েছে যে প্রায় যে কেউই কৃত্রিম বুদ্ধিমত্তা জেনারেটর ব্যবহার করে এমন ছবি তৈরি করতে পারে যা বাস্তবসম্মত দেখায়, অন্তত প্রথম নজরে।

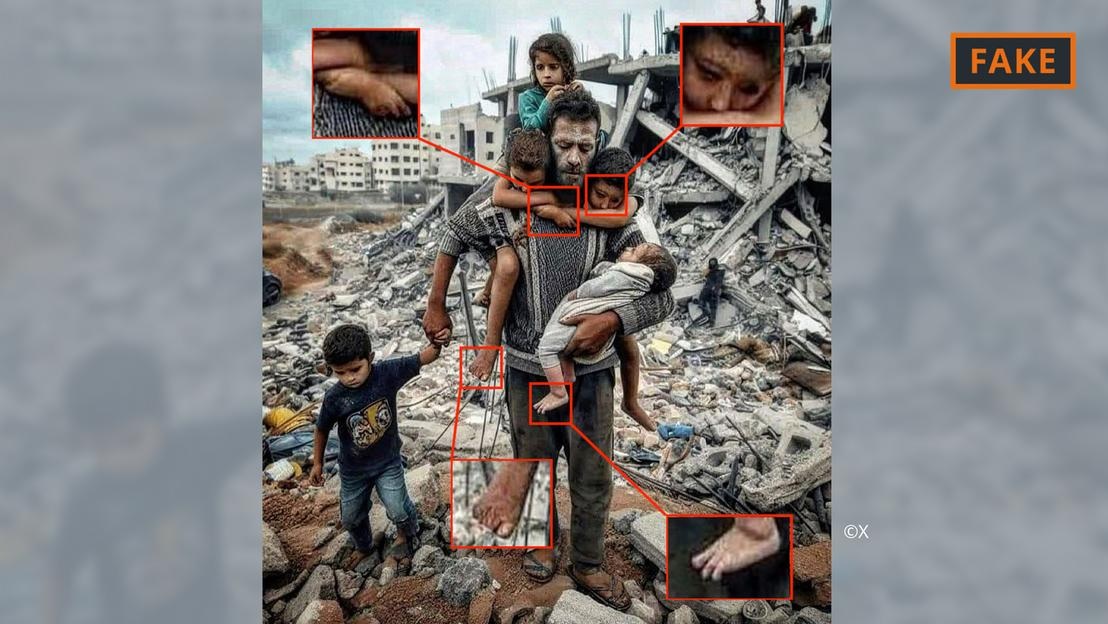

গাজা যুদ্ধের একটি কৃত্রিম বুদ্ধিমত্তা-উত্পাদিত ভুয়া ছবি।

ব্যবহারকারীরা কেবল মিডজার্নি বা ডাল-ই এর মতো টুলগুলি স্পেসিফিকেশন এবং তথ্য সহ কয়েকটি প্রম্পট সহ সরবরাহ করে। এরপর এআই টুলগুলি টেক্সট, এমনকি ভয়েস, প্রম্পটগুলিকে ছবিতে রূপান্তর করে।

এই ছবি তৈরির প্রক্রিয়াটি মেশিন লার্নিং নামে পরিচিত একটি পদ্ধতির উপর ভিত্তি করে তৈরি। উদাহরণস্বরূপ, যদি কোনও নির্মাতা ৭০ বছর বয়সী একজন বৃদ্ধকে সাইকেল চালাতে দেখাতে বলেন, তাহলে তারা ছবির সাথে শব্দের মিল খুঁজে বের করার জন্য তাদের ডাটাবেস অনুসন্ধান করবেন।

উপলব্ধ তথ্যের উপর ভিত্তি করে, AI অ্যালগরিদম বয়স্ক সাইক্লিস্টের একটি চিত্র তৈরি করবে। ক্রমবর্ধমান ইনপুট এবং প্রযুক্তিগত আপডেটের সাথে, এই সরঞ্জামগুলি ব্যাপকভাবে উন্নত হয়েছে এবং ক্রমাগত শিখছে।

এই সবই মধ্যপ্রাচ্যের সংঘাতের সাথে সম্পর্কিত চিত্রগুলিতে প্রয়োগ করা হচ্ছে। এমন একটি সংঘাত যেখানে "আবেগ এত বেশি", সেখানে ভুল তথ্য, যার মধ্যে AI চিত্রের মাধ্যমে ছড়িয়ে পড়াও রয়েছে, বিশাল প্রভাব ফেলে, বলেছেন AI বিশেষজ্ঞ হ্যানি ফরিদ।

বার্কলেতে ক্যালিফোর্নিয়া বিশ্ববিদ্যালয়ের ডিজিটাল অ্যানালিটিক্সের অধ্যাপক ফরিদ বলেন, ভয়াবহ লড়াই হল ভুয়া বিষয়বস্তু তৈরি এবং প্রচারের জন্য নিখুঁত প্রজনন ক্ষেত্র, সেইসাথে আবেগকে উস্কে দেওয়ার জন্য।

ইসরায়েল-হামাস যুদ্ধের কৃত্রিম বুদ্ধিমত্তার (এআই) চিত্রের ধরণ

কৃত্রিম বুদ্ধিমত্তার সাহায্যে তৈরি ছবি এবং ভিডিওগুলি ইউক্রেনের যুদ্ধ সম্পর্কিত ভুল তথ্য প্রচারে ইন্ধন জুগিয়েছে এবং ইসরায়েল-হামাস যুদ্ধেও এটি ঘটছে।

বিশেষজ্ঞদের মতে, যুদ্ধ সম্পর্কিত সোশ্যাল মিডিয়ায় প্রচারিত AI ছবিগুলি প্রায়শই দুটি বিভাগে পড়ে। একটি মানুষের দুর্দশার উপর আলোকপাত করে এবং সহানুভূতি জাগিয়ে তোলে। অন্যটি হল নকল AI যা ঘটনাগুলিকে অতিরঞ্জিত করে, যার ফলে সংঘাত এবং সহিংসতা বৃদ্ধি পায়।

গাজার ধ্বংসস্তূপের মধ্যে বাবা এবং সন্তানের কৃত্রিম বুদ্ধিমত্তা দ্বারা তৈরি ভুয়া ছবি।

উদাহরণস্বরূপ, প্রথম বিভাগে ধ্বংসস্তূপের স্তূপের সামনে একজন বাবা এবং তার পাঁচ সন্তানের উপরের ছবিটি অন্তর্ভুক্ত রয়েছে। এটি X (পূর্বে টুইটার) এবং ইনস্টাগ্রামে একাধিকবার শেয়ার করা হয়েছে এবং লক্ষ লক্ষ বার দেখা হয়েছে।

এই ছবিটি কমিউনিটি, অন্তত X-তে, জাল হিসেবে চিহ্নিত করেছে। এটি AI চিত্রগুলিতে সাধারণ বিভিন্ন ত্রুটি এবং অসঙ্গতি দ্বারা চিহ্নিত করা যেতে পারে (উপরের ছবিটি দেখুন)।

নীচের X-এ ভাইরাল হওয়া ভুয়া AI ছবিতেও একই রকম অসঙ্গতি দেখা যাচ্ছে, যেখানে একটি ফিলিস্তিনি পরিবারকে ধ্বংসাবশেষের উপর একসাথে খাওয়ার দৃশ্য দেখানো হয়েছে।

ফিলিস্তিনি দলের কৃত্রিম বুদ্ধিমত্তা-উত্পাদিত ভুয়া ছবি।

এদিকে, আরেকটি ছবিতে দেখা যাচ্ছে যে সৈন্যরা বোমা বিস্ফোরিত বাড়িঘরে ভরা একটি বসতি অতিক্রম করার সময় ইসরায়েলি পতাকা উড়িয়ে যাচ্ছে, যা দ্বিতীয় শ্রেণীর, যা ঘৃণা ও সহিংসতা উস্কে দেওয়ার জন্য তৈরি করা হয়েছে।

এই ধরনের AI ছবি কোথা থেকে আসে?

সংঘাতের বেশিরভাগ কৃত্রিম বুদ্ধিমত্তা (এআই) দ্বারা তৈরি ছবি সোশ্যাল মিডিয়া প্ল্যাটফর্মে পোস্ট করা হয়, তবে এগুলি অন্যান্য বেশ কয়েকটি প্ল্যাটফর্ম এবং সংস্থা এবং এমনকি কিছু সংবাদ সাইটেও পাওয়া যায়।

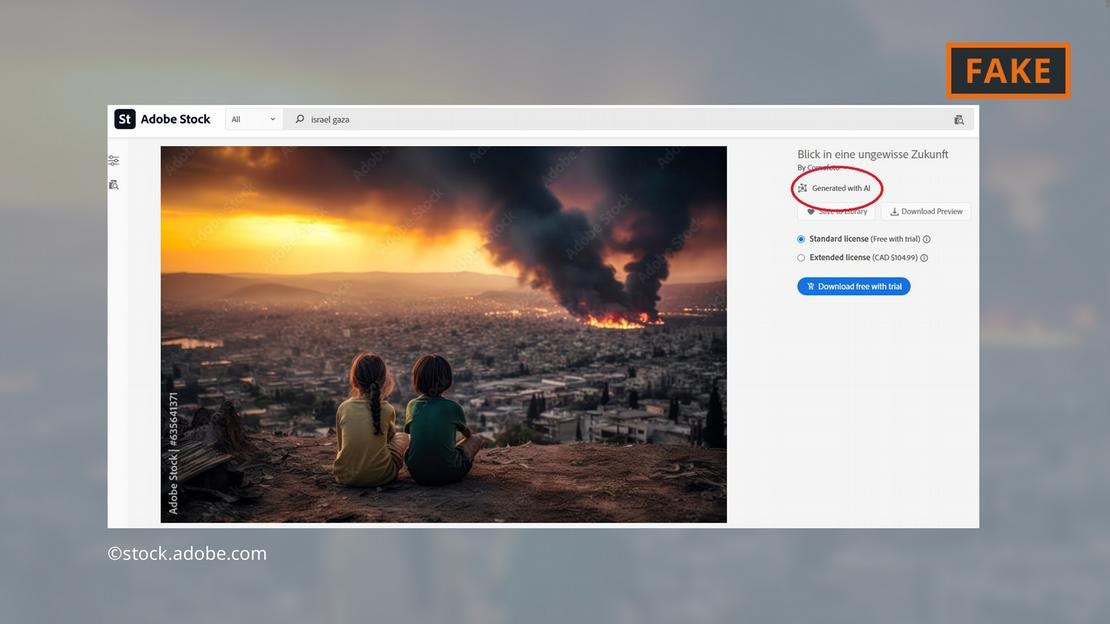

সফটওয়্যার কোম্পানি অ্যাডোবি ২০২২ সালের শেষ নাগাদ তাদের স্টক ফটো রেঞ্জে এআই-জেনারেটেড ছবি যুক্ত করে শিরোনামে এসেছে। ডাটাবেসে সেগুলি সেই অনুযায়ী লেবেল করা হবে।

অ্যাডোবি এখন মধ্যপ্রাচ্য যুদ্ধের কৃত্রিম বুদ্ধিমত্তার ছবিও বিক্রির জন্য অফার করছে — যেমন বিস্ফোরণ, বিক্ষোভকারী মানুষের ছবি, অথবা আল-আকসা মসজিদের পিছনে ধোঁয়ার কুণ্ডলী।

অ্যাডোবি গাজার যুদ্ধের কৃত্রিম বুদ্ধিমত্তা (এআই) দ্বারা তৈরি ছবি অফার করছে।

সমালোচকরা এটিকে উদ্বেগজনক বলে মনে করেছেন, কারণ কিছু সাইট ছবিগুলিকে AI-উত্পাদিত হিসেবে লেবেল না দিয়েই ব্যবহার করে চলেছে। উদাহরণস্বরূপ, প্রশ্নবিদ্ধ ছবিটি "নিউজব্রেক" পৃষ্ঠায় প্রকাশিত হয়েছে, কোনও ইঙ্গিত ছাড়াই যে এটি AI-উত্পাদিত।

এমনকি ইউরোপীয় পার্লামেন্টের বৈজ্ঞানিক শাখা, ইউরোপীয় পার্লামেন্টারি রিসার্চ সার্ভিস, অ্যাডোবি ডাটাবেস থেকে একটি এআই ইমেজ ব্যবহার করে মধ্যপ্রাচ্যের সংঘাত সম্পর্কে একটি অনলাইন লেখা চিত্রিত করেছে — এটিকে এআই-উত্পাদিত হিসাবে লেবেল করা হয়নি।

ইউরোপীয় ডিজিটাল মিডিয়া অবজারভেটরি সাংবাদিক এবং মিডিয়া পেশাদারদের AI ছবি ব্যবহার করার সময় অত্যন্ত সতর্কতা অবলম্বন করার আহ্বান জানাচ্ছে, বিশেষ করে গাজা যুদ্ধের মতো বাস্তব জীবনের ঘটনাগুলি কভার করার সময়, তাদের ব্যবহার না করার পরামর্শ দিচ্ছে।

কৃত্রিম বুদ্ধিমত্তার ছবি কতটা বিপজ্জনক?

ভাইরাল এআই কন্টেন্ট এবং চিত্রাবলী ব্যবহারকারীদের অনলাইনে যা কিছু দেখা যায় তা নিয়ে অস্বস্তি বোধ করা স্বাভাবিক। "যদি আমরা এমন এক জগতে প্রবেশ করি যেখানে ছবি, অডিও এবং ভিডিও ব্যবহার করা যেতে পারে , তাহলে সবকিছুই সন্দেহজনক হয়ে ওঠে," ব্যাখ্যা করেন ইউসি বার্কলে গবেষক ফরিদ। "তাই আপনি সবকিছুর উপর আস্থা হারিয়ে ফেলবেন, এমনকি সত্যের উপরও।"

নিচের ঘটনাটিতে ঠিক তাই ঘটেছে: ইসরায়েলি প্রধানমন্ত্রী বেঞ্জামিন নেতানিয়াহু এবং আরও বেশ কয়েকজন রাজনীতিবিদ সোশ্যাল মিডিয়ায় একটি ইসরায়েলি শিশুর পোড়া মৃতদেহের ছবি শেয়ার করেছেন।

ইসরায়েল-বিরোধী একজন প্রভাবশালী জ্যাকসন হিঙ্কল পরে দাবি করেন যে ছবিটি কৃত্রিম বুদ্ধিমত্তা ব্যবহার করে তৈরি করা হয়েছে। হিঙ্কলের বক্তব্য সোশ্যাল মিডিয়ায় দুই কোটিরও বেশি বার দেখা হয়েছে এবং প্ল্যাটফর্মে উত্তপ্ত বিতর্কের জন্ম দিয়েছে।

অবশেষে, অসংখ্য সংস্থা এবং যাচাইকরণ সরঞ্জাম ঘোষণা করে যে ছবিটি আসল এবং হিঙ্কলের দাবি মিথ্যা। তবে, এটা স্পষ্ট যে কোনও সরঞ্জাম ব্যবহারকারীদের তাদের হারানো আস্থা সহজেই ফিরে পেতে সাহায্য করতে পারে না!

হোয়াং হাই (ডিডাব্লিউ অনুসারে)

[বিজ্ঞাপন_২]

উৎস

মন্তব্য (0)