কৃত্রিম বুদ্ধিমত্তা মানুষকে ইমেল লেখা, সিনেমা সুপারিশ করা, তথ্য বিশ্লেষণ করা এবং রোগ নির্ণয়ে সহায়তা করছে...

কিন্তু কৃত্রিম বুদ্ধিমত্তা যতই বুদ্ধিমান হচ্ছে, ততই নিরাপত্তাহীনতার অনুভূতিও তৈরি হচ্ছে। এর একটা কারণ হলো আমরা যে প্রযুক্তি ব্যবহার করছি তা পুরোপুরি বুঝতে পারছি না। বাকিটা আমাদের নিজস্ব মনস্তাত্ত্বিক প্রবৃত্তি থেকে উদ্ভূত।

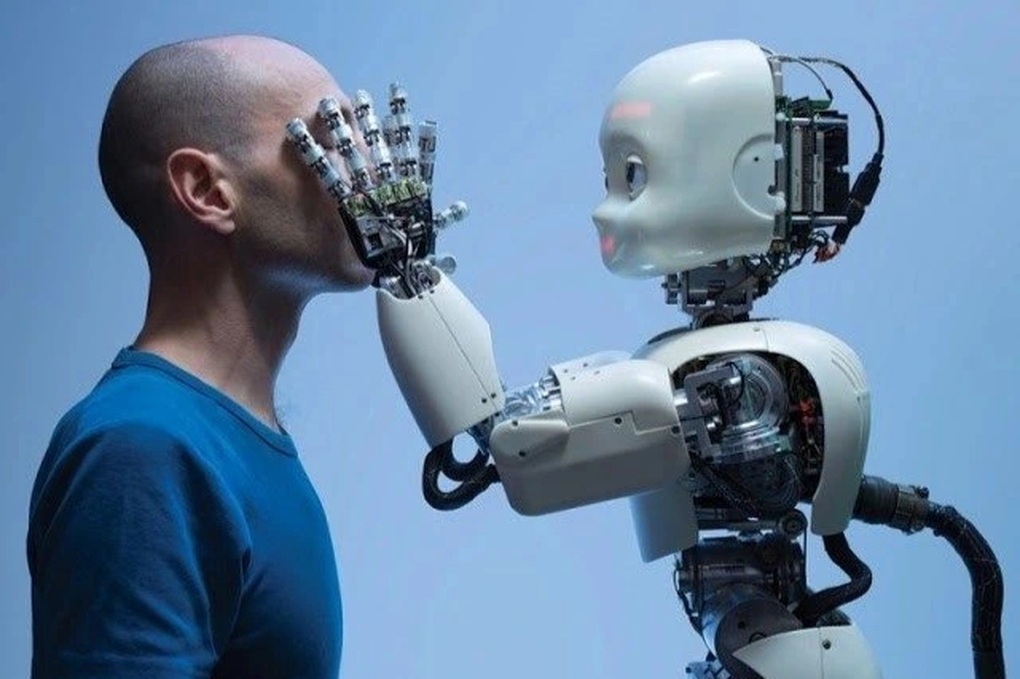

মানুষের মনস্তাত্ত্বিক অভিযোজন ক্ষমতার তুলনায় কৃত্রিম বুদ্ধিমত্তা দ্রুত বিকশিত হচ্ছে (চিত্রের ছবি)।

যখন AI একটি "ব্ল্যাক বক্স" হয়ে যায় এবং ব্যবহারকারীরা নিয়ন্ত্রণ হারিয়ে ফেলে

মানুষ যা বোঝে এবং নিয়ন্ত্রণ করে, তার উপর আস্থা রাখে। যখন আপনি একটি বোতাম টিপবেন, তখন লিফটটি নড়ে উঠবে। যখন আপনি একটি সুইচ উল্টান, তখন আলো জ্বলবে। স্পষ্ট প্রতিক্রিয়া নিরাপত্তার অনুভূতি তৈরি করবে।

বিপরীতে, অনেক AI সিস্টেম একটি বন্ধ বাক্সের মতো কাজ করে। আপনি ডেটা ইনপুট করেন, কিন্তু এটি যেভাবে ফলাফল তৈরি করে তা লুকানো থাকে। এর ফলে ব্যবহারকারীদের পক্ষে এটি বোঝা বা জিজ্ঞাসা করা অসম্ভব হয়ে পড়ে।

অস্বচ্ছতার এই অনুভূতি অস্থির করে তোলে। ব্যবহারকারীদের কেবল এমন একটি টুল প্রয়োজন যা কাজ করে না, বরং এটি কেন কাজ করে তাও জানতে হবে।

যদি AI কোনও ব্যাখ্যা দিতে ব্যর্থ হয়, তাহলে মানুষ এটি নিয়ে প্রশ্ন তুলতে শুরু করে। এর ফলে "অ্যালগরিদম বিদ্বেষ" নামক একটি ধারণার উদ্ভব হয়, যা আচরণগত গবেষকরা এমন একটি ঘটনা হিসাবে বর্ণনা করেন যেখানে মানুষ অন্যদের সিদ্ধান্ত বেছে নেওয়ার প্রবণতা রাখে, এমনকি যদি তারা ভুলও হয়, মেশিনের বিচারের উপর বিশ্বাস করার পরিবর্তে।

অনেকেই এআই খুব বেশি নির্ভুল হয়ে যাওয়ার ব্যাপারে সতর্ক থাকেন। একটি কন্টেন্ট সুপারিশ ইঞ্জিন যদি খুব ভালোভাবে পড়ে তবে তা বিরক্তিকর হতে পারে। নজরদারি বা কারসাজির অনুভূতি দেখা দিতে শুরু করে, যদিও সিস্টেমটির নিজস্ব কোনও আবেগ বা উদ্দেশ্য নেই।

এই প্রতিক্রিয়াটি একটি সহজাত আচরণ থেকে উদ্ভূত হয়: নৃতাত্ত্বিকতা। যদিও আমরা জানি যে AI মানুষ নয়, তবুও আমরা এর প্রতি এমনভাবে প্রতিক্রিয়া জানাই যেন আমরা কোনও ব্যক্তির সাথে যোগাযোগ করছি। যখন AI খুব ভদ্র বা খুব ঠান্ডা হয়, তখন ব্যবহারকারীরা অদ্ভুত এবং অবিশ্বাসী বোধ করেন।

মানুষ মানুষকে ক্ষমা করে, কিন্তু যন্ত্রকে নয়।

একটি মজার বিরোধিতা হল, যখন মানুষ ভুল করে, তখন আমরা সহানুভূতিশীল এবং গ্রহণযোগ্য হতে পারি। কিন্তু যখন ত্রুটিটি AI থেকে আসে, বিশেষ করে যখন এটিকে বস্তুনিষ্ঠ এবং ডেটা-চালিত হিসাবে প্রচার করা হয়, তখন ব্যবহারকারীরা প্রায়শই বিশ্বাসঘাতকতা বোধ করেন।

এটি প্রত্যাশা লঙ্ঘনের ঘটনার সাথে সম্পর্কিত। আমরা আশা করি মেশিনগুলি যুক্তিসঙ্গত, নির্ভুল এবং অভ্রান্ত হবে। যখন সেই বিশ্বাস লঙ্ঘিত হয়, তখন মানসিক প্রতিক্রিয়া প্রায়শই আরও তীব্র হয়। ব্যবহারকারী যদি নিয়ন্ত্রণের বাইরে বা ব্যাখ্যাতীত বোধ করেন তবে অ্যালগরিদমের একটি ছোট ত্রুটিও গুরুতর হিসাবে বিবেচিত হতে পারে।

আমাদের সহজাতভাবেই ভুলের কারণ বুঝতে হবে। মানুষের ক্ষেত্রে, আমরা হয়তো জিজ্ঞাসা করতে পারি কেন। কৃত্রিম বুদ্ধিমত্তার ক্ষেত্রে, উত্তরটি প্রায়শই অস্তিত্বহীন বা খুব অস্পষ্ট।

যখন শিক্ষক, লেখক, আইনজীবী বা ডিজাইনাররা তাদের কাজের একটি অংশ হিসেবে কৃত্রিম বুদ্ধিমত্তাকে কাজে লাগাতে দেখেন, তখন তারা কেবল চাকরি হারানোর ভয় পান না, বরং তাদের দক্ষতা এবং ব্যক্তিগত পরিচয়ের মূল্য নিয়েও চিন্তিত হন।

এটি একটি স্বাভাবিক প্রতিক্রিয়া, যাকে পরিচয় হুমকি বলা হয়। এটি অস্বীকার, প্রতিরোধ বা মানসিক প্রতিরক্ষার দিকে পরিচালিত করতে পারে। এই ক্ষেত্রে, সন্দেহ আর কোনও আবেগগত প্রতিক্রিয়া নয় বরং একটি আত্মরক্ষার প্রক্রিয়া।

বিশ্বাস কেবল যুক্তি দিয়ে আসে না।

মানুষ আবেগ, অঙ্গভঙ্গি, চোখের যোগাযোগ এবং সহানুভূতির মাধ্যমে বিশ্বাস করে। AI স্পষ্টবাদী হতে পারে, এমনকি হাস্যকরও হতে পারে, কিন্তু এটি জানে না কিভাবে একটি প্রকৃত সংযোগ তৈরি করতে হয়।

বিশেষজ্ঞরা "অদ্ভুত উপত্যকা"-র ঘটনাটিকে এমন এক অস্বস্তিকর অনুভূতি হিসেবে বর্ণনা করেছেন যা প্রায় মানুষের মতো, কিন্তু এমন কিছুর অভাব যা তাদেরকে অবাস্তব করে তোলে।

যখন যন্ত্রগুলি খুব বেশি মানুষ হয়ে ওঠে, তখন নিরাপত্তাহীনতার অনুভূতি আরও স্পষ্ট হয়ে ওঠে (ছবি: গেটি)।

AI-তে, আবেগের অনুপস্থিতি অনেক মানুষকে দিশেহারা করে তোলে, বিশ্বাস করবে নাকি সন্দেহ করবে তা নিয়ে অনিশ্চয়তা তৈরি করে।

ভুয়া খবর, ভুয়া ভিডিও এবং অ্যালগরিদমিক সিদ্ধান্তে ভরা এই পৃথিবীতে , আবেগগতভাবে বিসর্জনের অনুভূতি মানুষকে প্রযুক্তি সম্পর্কে সতর্ক করে তোলে। এআই কোনও ভুল করে বলে নয়, বরং আমরা জানি না এটি সম্পর্কে কীভাবে অনুভব করতে হয়।

তাছাড়া, সন্দেহ কখনও কখনও কেবল একটি অনুভূতির চেয়েও বেশি কিছু। অ্যালগরিদম ইতিমধ্যেই নিয়োগ, ফৌজদারি রায় এবং ঋণ অনুমোদনের ক্ষেত্রে পক্ষপাত তৈরি করেছে। যারা অস্বচ্ছ ডেটা সিস্টেম দ্বারা ক্ষতিগ্রস্ত হয়েছেন, তাদের জন্য সতর্ক থাকা যুক্তিসঙ্গত।

মনোবিজ্ঞানীরা একে বলে 'শিক্ষাগত অবিশ্বাস'। যখন কোনও ব্যবস্থা বারবার ব্যর্থ হয়, তখন এটা বোধগম্য যে আস্থা হারিয়ে যাবে। মানুষ কেবল বলা হয়েছে বলেই বিশ্বাস করবে না। বিশ্বাস অর্জন করতে হবে, চাপিয়ে দেওয়া যাবে না।

যদি AI ব্যাপকভাবে গ্রহণ করতে হয়, তাহলে ডেভেলপারদের এমন সিস্টেম তৈরি করতে হবে যা বোঝা যাবে, প্রশ্ন করা যাবে এবং জবাবদিহি করা যাবে। ব্যবহারকারীদের কেবল এদিক-ওদিক থেকে পর্যবেক্ষণ করার পরিবর্তে সিদ্ধান্ত গ্রহণে জড়িত থাকতে হবে। বিশ্বাস তখনই সত্যিকার অর্থে টিকিয়ে রাখা সম্ভব যখন মানুষ সম্মানিত এবং ক্ষমতায়িত বোধ করবে।

সূত্র: https://dantri.com.vn/cong-nghe/vi-sao-tri-tue-nhan-tao-cham-vao-noi-so-sau-nhat-cua-con-nguoi-20251110120843170.htm

![[ছবি] ঝড় ও বন্যার পর দা নাংয়ের পাহাড় ও বনের "ক্ষতচিহ্ন"](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/11/13/1762996564834_sl8-jpg.webp)

![[ছবি] সাধারণ সম্পাদক টু লাম লং থান আন্তর্জাতিক বিমানবন্দর প্রকল্প পরিদর্শন করেছেন](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/11/13/1763008564398_vna-potal-tong-bi-thu-to-lam-tham-du-an-cang-hang-khong-quoc-te-long-thanh-8404600-1261-jpg.webp)

![[ইনফোগ্রাফিক] ২০২৬-২০৩০ ৫ বছর মেয়াদের জন্য প্রধান উন্নয়ন লক্ষ্য এবং লক্ষ্যমাত্রা](https://vphoto.vietnam.vn/thumb/402x226/vietnam/resource/IMAGE/2025/11/13/1763013984385_cdn-nhandan-vn-images-22f099ca8bc7ae81aa2a8d3416a84bf8267bcc4f3a0ec01ee7b087ca4f1e19412ad321b4a75a62c5b1a9229f3bdfa20548b9382a8c3d1e37736b78a1be2bbad7-_1763006939481-1.jpeg)

![দং নাই ওসিওপি রূপান্তর: [ধারা ৩] ওসিওপি পণ্য ব্যবহারের সাথে পর্যটনের সংযোগ স্থাপন](https://vphoto.vietnam.vn/thumb/402x226/vietnam/resource/IMAGE/2025/11/10/1762739199309_1324-2740-7_n-162543_981.jpeg)

মন্তব্য (0)