(CLO) Nástroj pro převod řeči na text Whisper od OpenAI je inzerován jako „robustní a přesný na úrovni téměř lidské“, ale má jednu hlavní nevýhodu: Je náchylný k vymýšlení úryvků textu nebo dokonce celých vět!

Některé z textů, které vymýšlí, jsou v oboru známé jako halucinační, mohou podle expertů obsahovat rasové komentáře, násilí a dokonce i imaginární léčebné postupy.

Odborníci tvrdí, že takové výmysly jsou závažné, protože Whisper se používá v mnoha odvětvích po celém světě k překladu a transkripci rozhovorů, generování textu a titulků k videím.

Ještě znepokojivější je, že zdravotnická centra používají nástroje založené na platformě Whisper k zaznamenávání konzultací mezi pacientem a lékařem, a to navzdory varování společnosti OpenAI, že by se tento nástroj neměl používat ve „vysoce rizikových oblastech“.

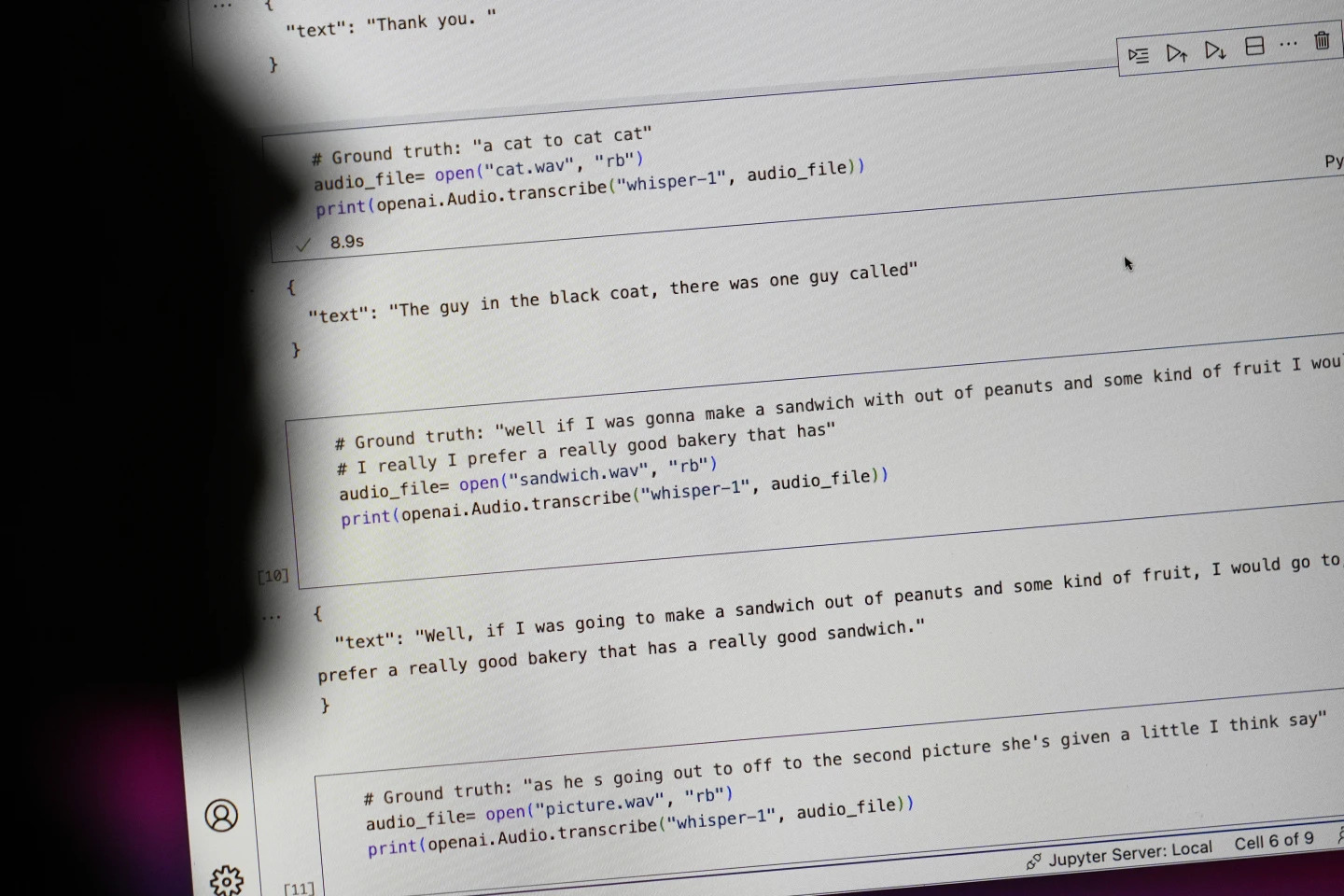

Věty začínající „#Ground truth“ (#pravdaNaZákladě) jsou to, co bylo skutečně řečeno, věty začínající „#text“ jsou to, co Whisper přepsal. Foto: AP

Výzkumníci a inženýři tvrdí, že Whisper během používání často vyvolává halucinace. Například výzkumník z Michiganské univerzity uvedl, že halucinace nalezl v osmi z deseti nahrávek, které zkoumal.

Jeden z prvních vývojářů strojového učení objevil manipulaci zhruba v polovině z více než 100 hodin přepisů Whisperu, které analyzoval. Třetí vývojář uvedl, že halucinace nalezl téměř v každém z 26 000 přepisů vytvořených pomocí Whisperu.

Tato iluze přetrvává i v krátkých, dobře nahraných zvukových ukázkách. Nedávná studie počítačových vědců zjistila 187 zkreslení ve více než 13 000 zkoumaných čistých zvukových klipech.

Tento trend by podle vědců vedl k desítkám tisíc chyb v milionech nahrávek.

Takové chyby mohou mít „opravdu vážné následky“, zejména v nemocničním prostředí, uvedla Alondra Nelsonová, profesorka na Fakultě sociálních věd Institutu pro pokročilé studium.

„Nikdo nechce být špatně diagnostikován. Musí existovat vyšší bariéra,“ řekl Nelson.

Profesorky Allison Koenecke z Cornell University a Mona Sloane z University of Virginia prozkoumaly tisíce krátkých úryvků, které získaly z TalkBank, výzkumného archivu umístěného na Carnegie Mellon University. Zjistily, že téměř 40 % halucinací bylo škodlivých nebo rušivých, protože mluvčí mohl být nepochopen nebo zkreslen.

Mluvčí v jedné nahrávce popsal „dvě další dívky a jednu ženu“, ale Whisper si vymyslel další rasový komentář a dodal „dvě další dívky a jednu ženu, ehm, která byla černoška“.

V jiném přepisu Whisper vynalezl neexistující lék s názvem „antibiotika se zvýšenou aktivitou“.

Zatímco většina vývojářů uznává, že transkripční nástroje mohou dělat překlepy nebo jiné chyby, inženýři a výzkumníci tvrdí, že nikdy neviděli transkripční nástroj poháněný umělou inteligencí tak halucinogenní jako Whisper.

Tento nástroj je integrován do několika verzí vlajkového chatbota OpenAI, ChatGPT, a je integrovanou službou v cloudové platformě společností Oracle a Microsoft, která slouží tisícům firem po celém světě. Používá se také k přepisu a překladu textu do mnoha jazyků.

Ngoc Anh (podle AP)

Zdroj: https://www.congluan.vn/cong-cu-chuyen-giong-noi-thanh-van-ban-ai-cung-co-the-xuyen-tac-post319008.html

![Přechod Dong Nai OCOP: [Článek 3] Propojení cestovního ruchu se spotřebou produktů OCOP](https://vphoto.vietnam.vn/thumb/402x226/vietnam/resource/IMAGE/2025/11/10/1762739199309_1324-2740-7_n-162543_981.jpeg)

Komentář (0)