Die rasante Entwicklung der künstlichen Intelligenz (KI) bringt der Menschheit viele Vorteile. Allerdings birgt sie auch Risiken, darunter das Problem der Fake News.

Ein typisches Beispiel hierfür sind Falschinformationen wie über das verheerende Erdbeben im pazifischen Nordwesten, die von einem KI-Bildgenerator erzeugt wurden.

Daher müssen wir bei der Verbreitung von Informationen und Inhalten in sozialen Netzwerken wachsam sein. Die folgenden Methoden können Ihnen dabei helfen, von KI erstellte Fotos zu identifizieren.

Zoomen Sie hinein und schauen Sie genauer hin

Der erste Tipp: Schauen Sie sich das Foto genau an, wählen Sie die höchstmögliche Auflösung und zoomen Sie dann in die Details hinein. Durch das Vergrößern des Bildes werden Unstimmigkeiten und Fehler sichtbar, die auf den ersten Blick möglicherweise nicht sichtbar sind.

Gefälschte Fotos des verhafteten ehemaligen Präsidenten Donald Trump (links) und von Papst Franziskus in einem weißen Mantel, erstellt von der KI Midjourney.

Finden Sie die Bildquelle

Wenn Sie sich nicht sicher sind, ob ein Bild echt oder künstlich generiert ist, suchen Sie nach der Quelle. Laden Sie das Bild in Tools wie Google Image Reverse Search, TinEye oder Yandex hoch, und Sie können möglicherweise die Originalquelle finden.

Die Ergebnisse dieser Suchen können auch Links zu seriösen Medien enthalten, die zusätzlichen Kontext bieten.

Achten Sie auf die Körperproportionen

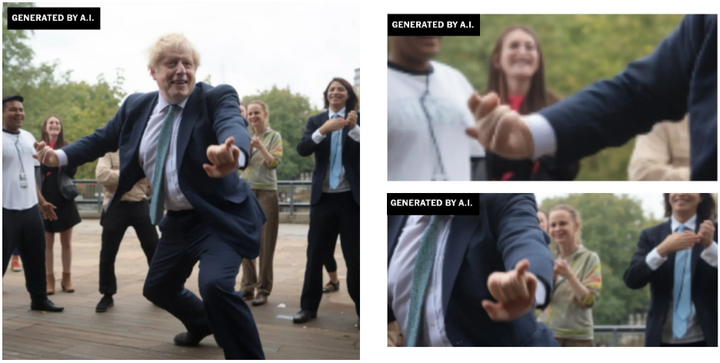

Es kommt nicht selten vor, dass KI-generierte Bilder Unterschiede in den Proportionen aufweisen. Hände können zu klein oder Finger zu lang sein oder Kopf und Beine passen nicht zum Rest des Körpers.

Hände stellen eine große Fehlerquelle in KI-Bildprogrammen dar. Personen auf Fotos haben oft sechs oder vier Finger.

Weitere häufige Fehler sind Personen mit zu vielen Zähnen, seltsam deformierten Brillengläsern oder unrealistisch geformten Ohren. Auch reflektierende Oberflächen wie Helmvisiere stellen für KI-Programme ein Problem dar.

Ein Handfehler in einem KI-generierten Foto des tanzenden ehemaligen britischen Premierministers Boris Johnson. (Foto: Eliot Higgins)

Der KI-Experte Henry Ajder warnt jedoch, dass neue Versionen des Midjourney-Programms immer besser darin werden, Hände zu generieren, was bedeutet, dass diese Art von Fehlern von den Benutzern auf lange Sicht unentdeckt bleiben wird.

Das Bild ist zu schön, zu glatt

KI erzeugt oft Bilder, die zu schön sind, um wahr zu sein. Folgen Sie Ihrer Intuition: Sind solche Bilder perfekter Menschen real?

„Die falschen Gesichter sind zu rein, die Kleidung ist recht harmonisch“, sagte Andreas Dengel vom Deutschen KI-Forschungszentrum der DW.

Die Haut von Menschen auf KI-Bildern ist oft glatt und makellos, auch ihre Haare und Zähne sind perfekt. Dabei handelt es sich meist nicht um eine reale Person.

Viele Fotos haben eine künstlerische, glänzende und funkelnde Qualität, die selbst professionelle Fotografen bei Aufnahmen im Studio nur schwer erreichen können.

THANH TUNG (Synthese)

[Anzeige_2]

Quelle

![[Foto] Abfall sammeln, grüne Samen säen](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/10/18/1760786475497_ndo_br_1-jpg.webp)

![[Foto] Abschlusszeremonie des 18. Kongresses des Parteikomitees von Hanoi](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/10/17/1760704850107_ndo_br_1-jpg.webp)

![[Foto] Generalsekretär To Lam nimmt am 95. Jahrestag des Traditionstags der Parteizentrale teil](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/10/18/1760784671836_a1-bnd-4476-1940-jpg.webp)

Kommentar (0)