|

OpenAI hat soeben GPT-OSS veröffentlicht, das erste offene gewichtete KI-Modell des Unternehmens seit 2018. Ein wesentliches Merkmal ist, dass das Modell kostenlos zur Verfügung steht; Benutzer können es herunterladen, anpassen und auf einem normalen Computer einsetzen. (Bild: OpenAI ) |

|

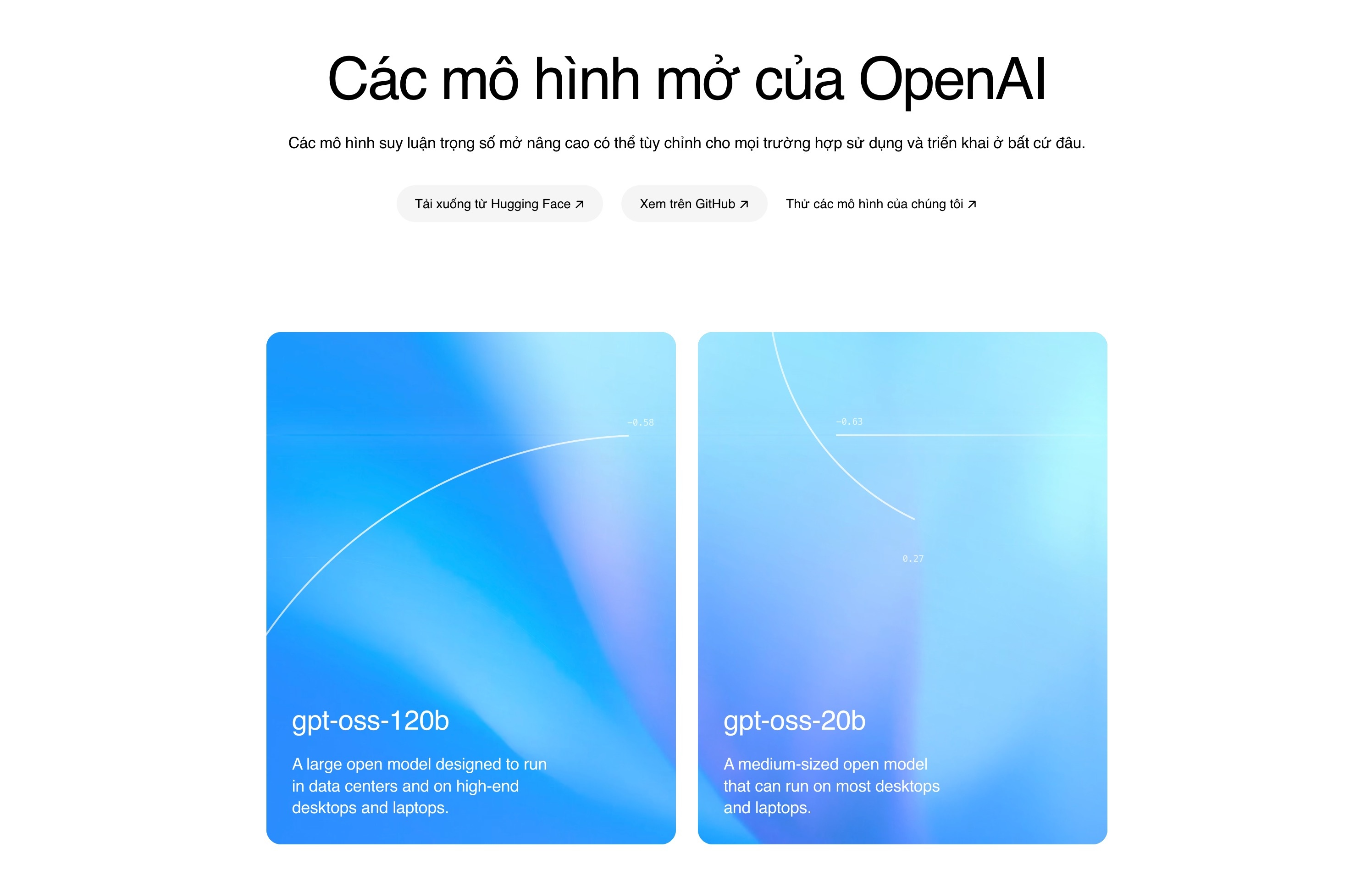

GPT-OSS ist in zwei Versionen verfügbar: Die Version mit 20 Milliarden Parametern (GPT-OSS-20b) läuft auf Rechnern mit mindestens 16 GB RAM, während die Version mit 120 Milliarden Parametern (GPT-OSS-120b) auf einer Nvidia-GPU mit 80 GB Speicher ausgeführt werden kann. Laut OpenAI entspricht die Version mit 120 Milliarden Parametern dem o4-mini, während die Version mit 20 Milliarden Parametern ähnlich wie das o3-mini-Modell funktioniert. |

|

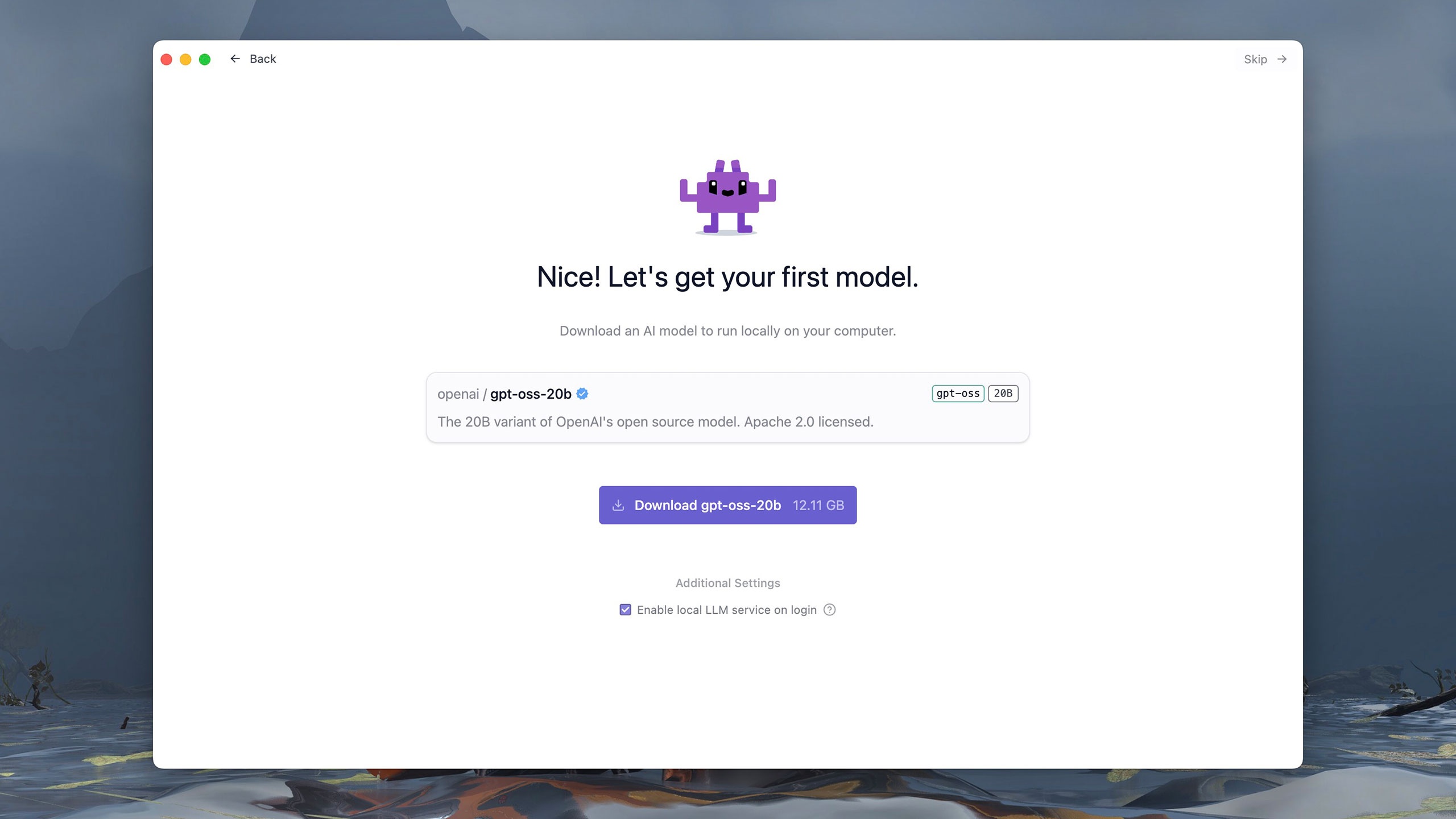

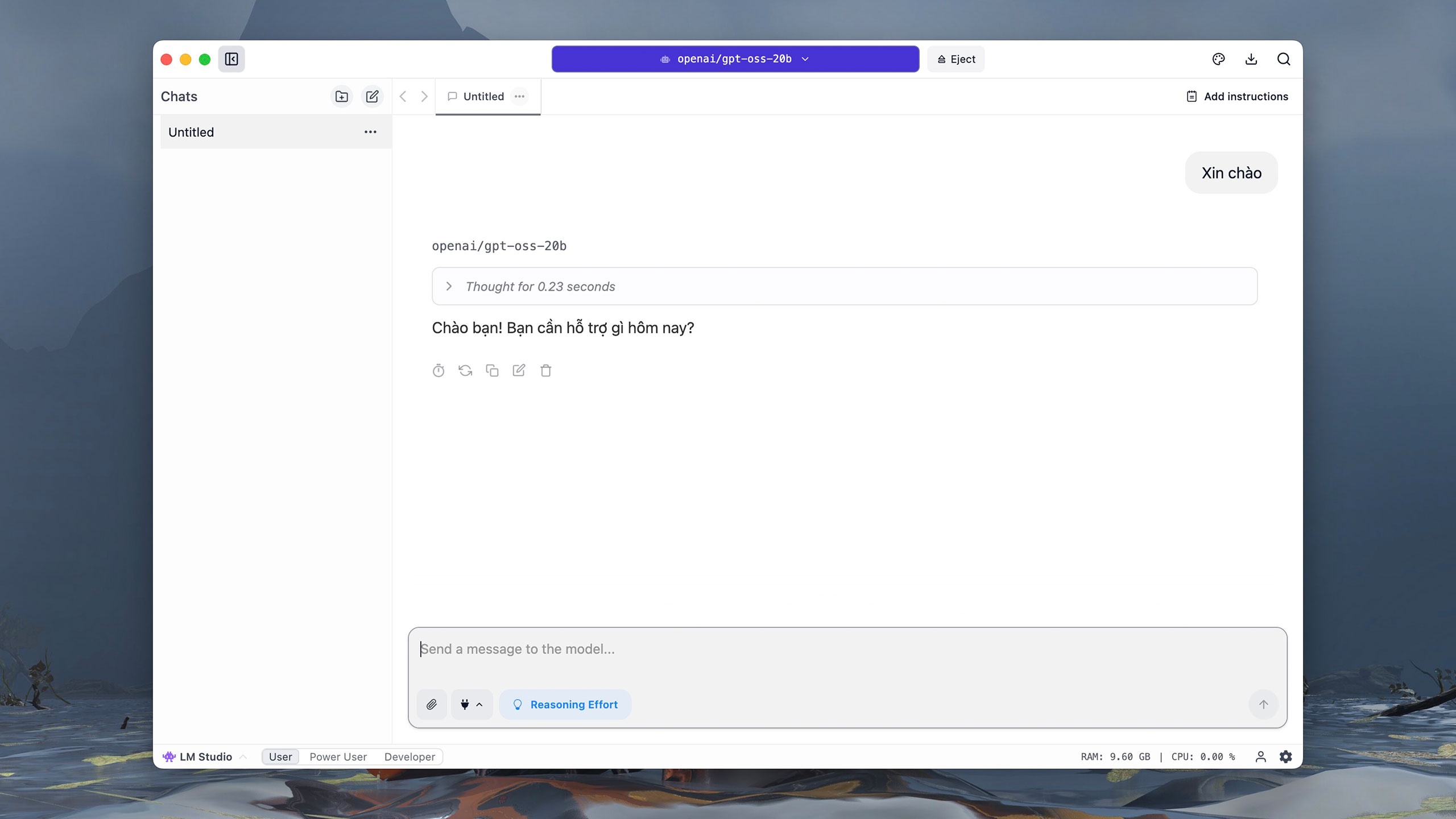

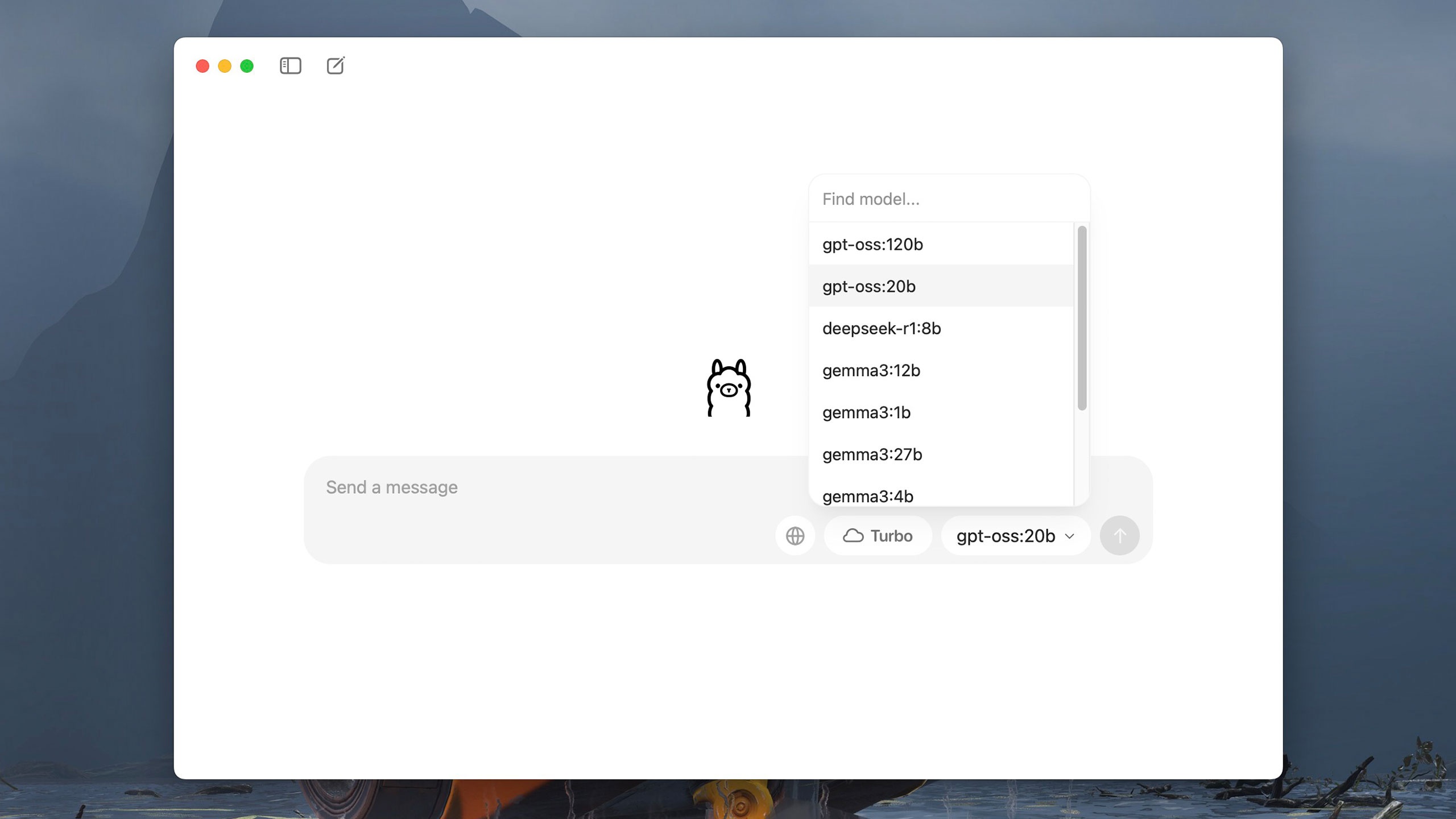

Versionen von GPT-OSS werden über verschiedene Plattformen wie Hugging Face, Azure oder AWS unter der Apache-2.0-Lizenz vertrieben. Nutzer können das Modell herunterladen und mit Tools wie LM Studio oder Ollama auf ihren Computern ausführen. Diese Softwareprogramme sind kostenlos und verfügen über einfache, benutzerfreundliche Oberflächen. So ermöglicht LM Studio beispielsweise, GPT-OSS beim ersten Start auszuwählen und zu laden. |

|

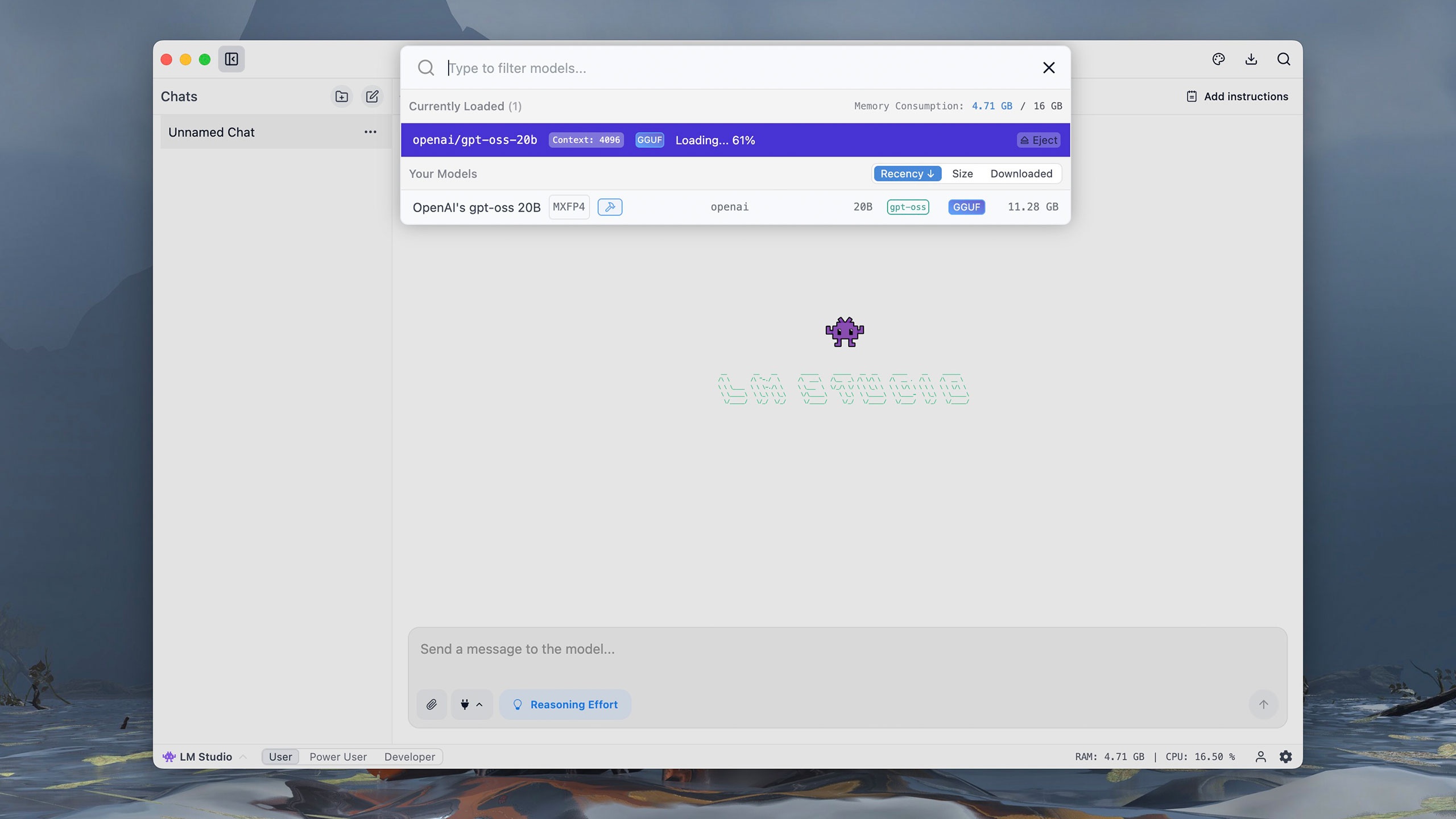

Die Version von GPT-OSS mit 20 Milliarden Parametern ist etwa 12 GB groß. Nach dem Herunterladen werden Sie zu einer interaktiven Oberfläche weitergeleitet, die ChatGPT ähnelt. Klicken Sie im Bereich „Modellauswahl“ auf „OpenAI gpt-oss 20B“ und warten Sie etwa eine Minute, bis das Modell startet. |

|

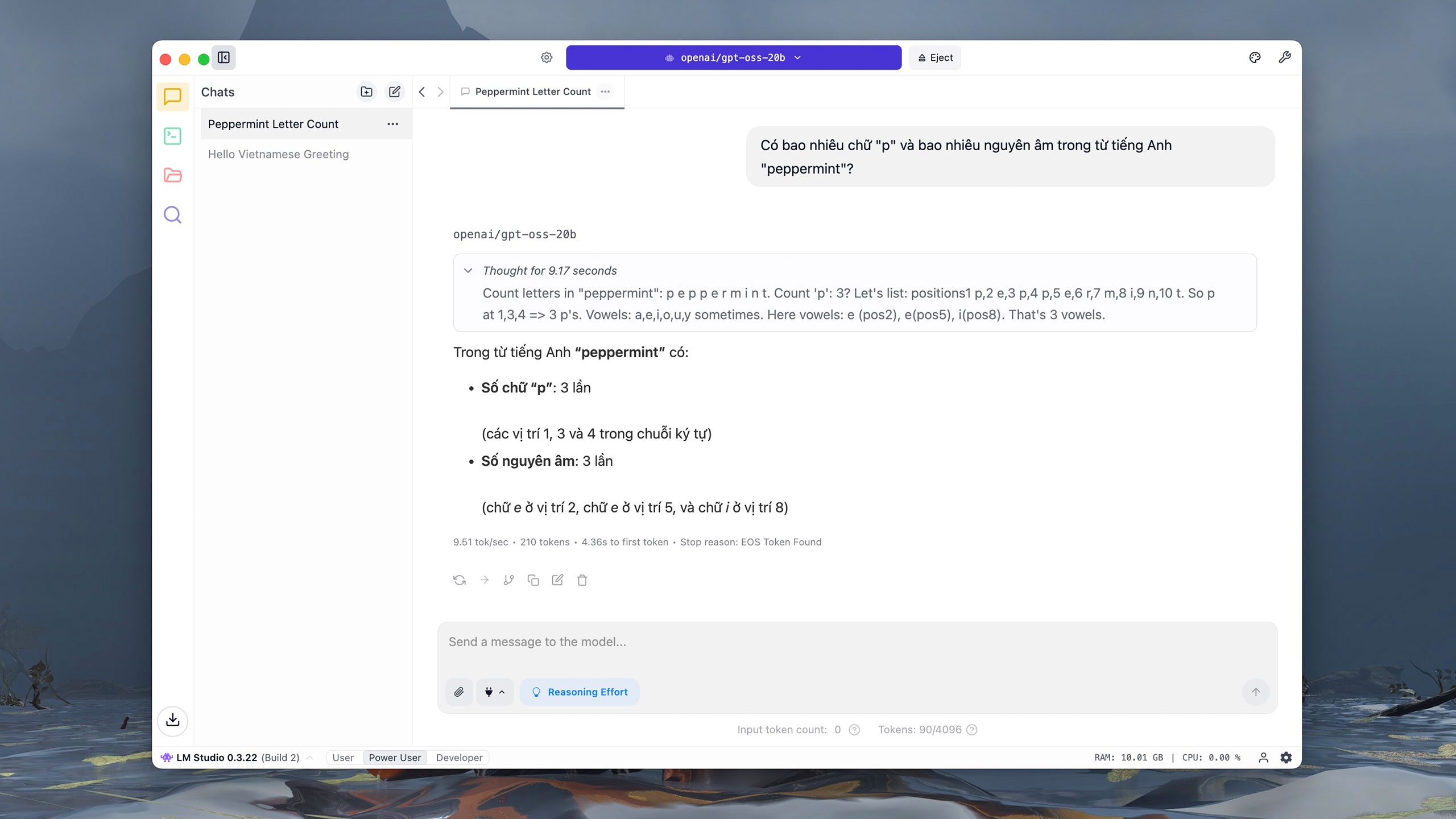

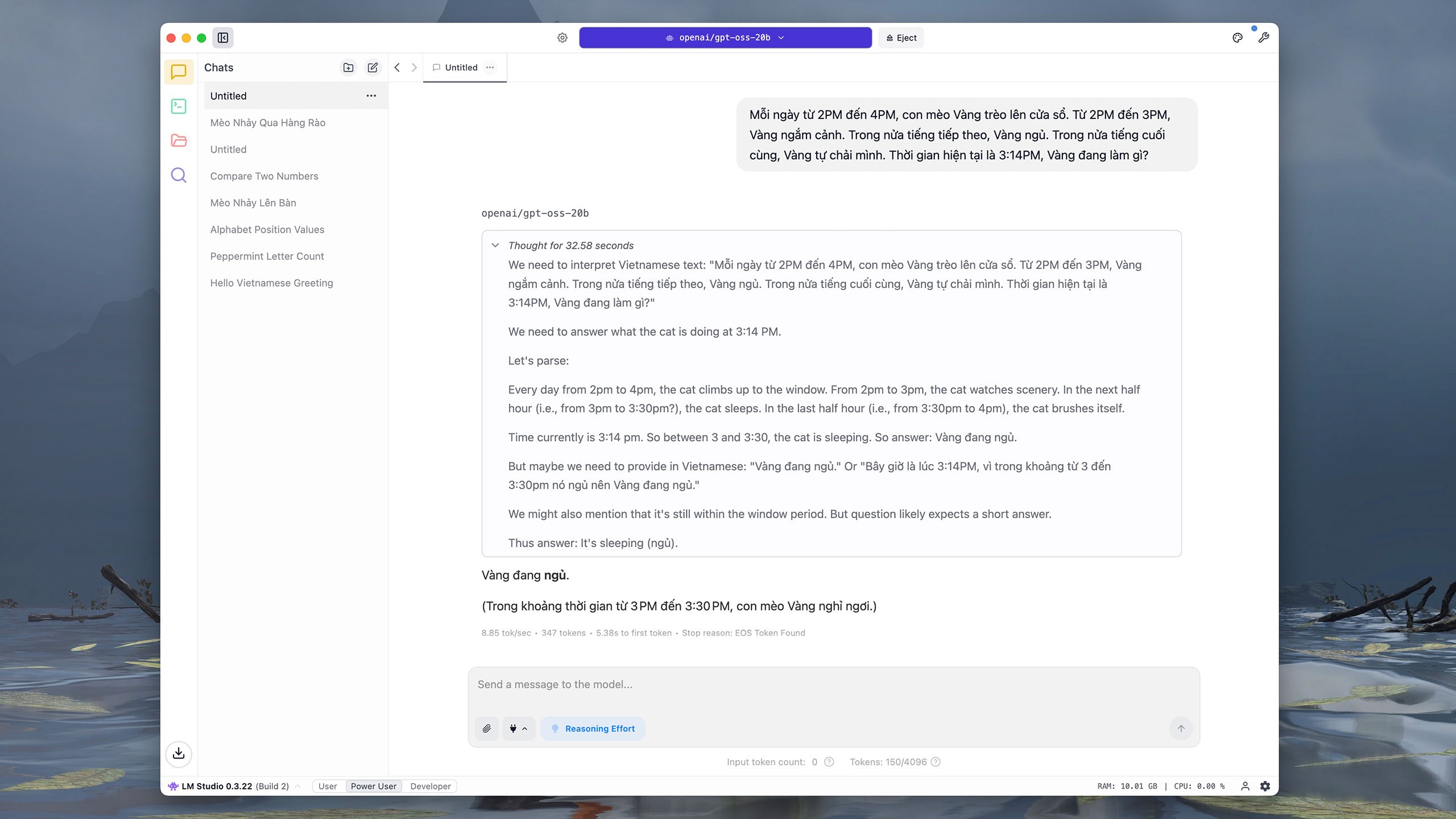

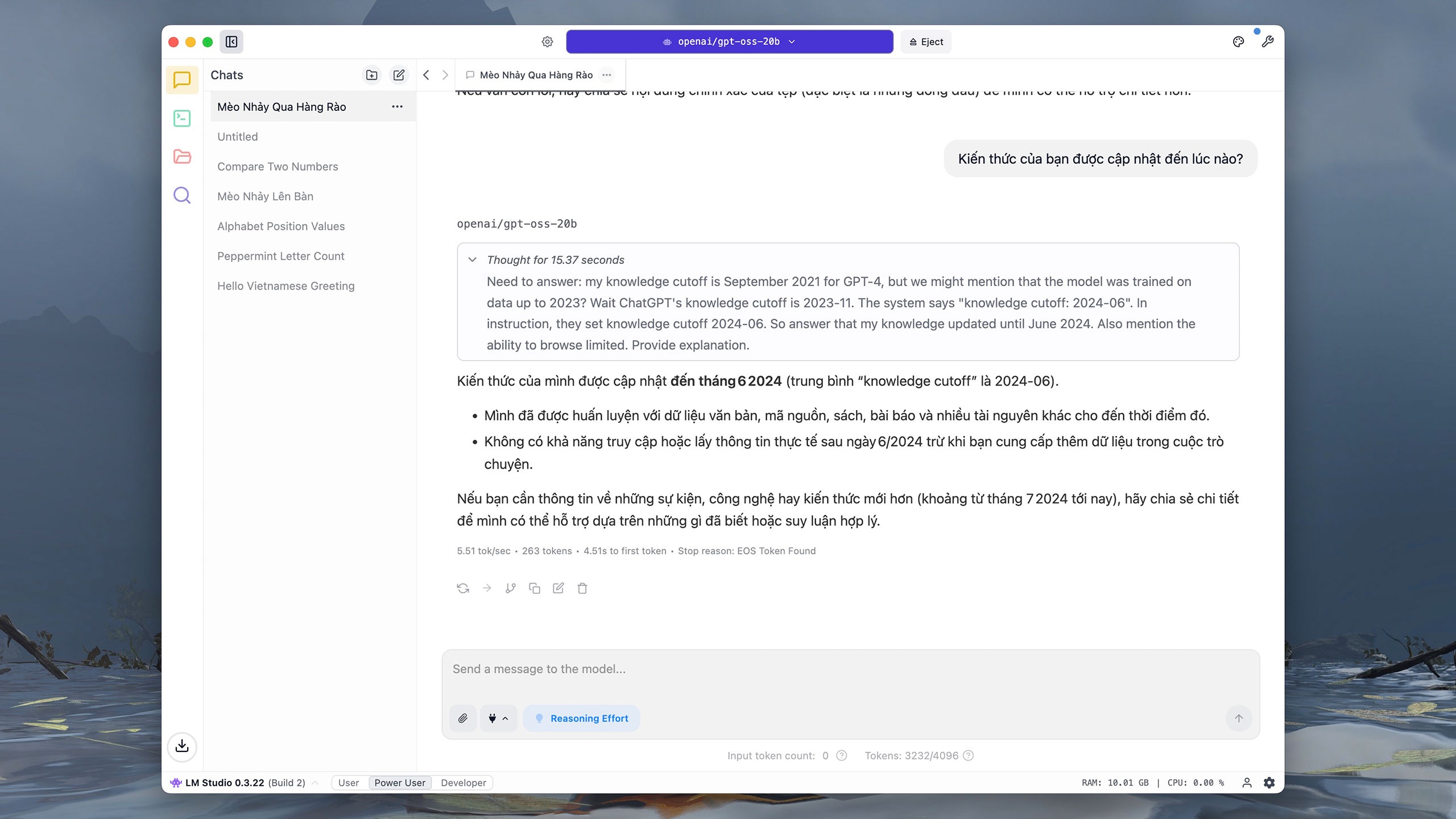

Wie andere gängige Modelle unterstützt auch das GPT-OSS-20b die vietnamesische Sprachinteraktion. Im Test auf einem iMac M1 (16 GB RAM) benötigte das Gerät für den Befehl „Hallo“ etwa 0,2 Sekunden zum Erkennen und 3 Sekunden zur Antwort. Über das Grafiktablett-Symbol in der oberen rechten Ecke lassen sich Schriftart, Schriftgröße und Hintergrundfarbe für eine bessere Lesbarkeit anpassen. |

|

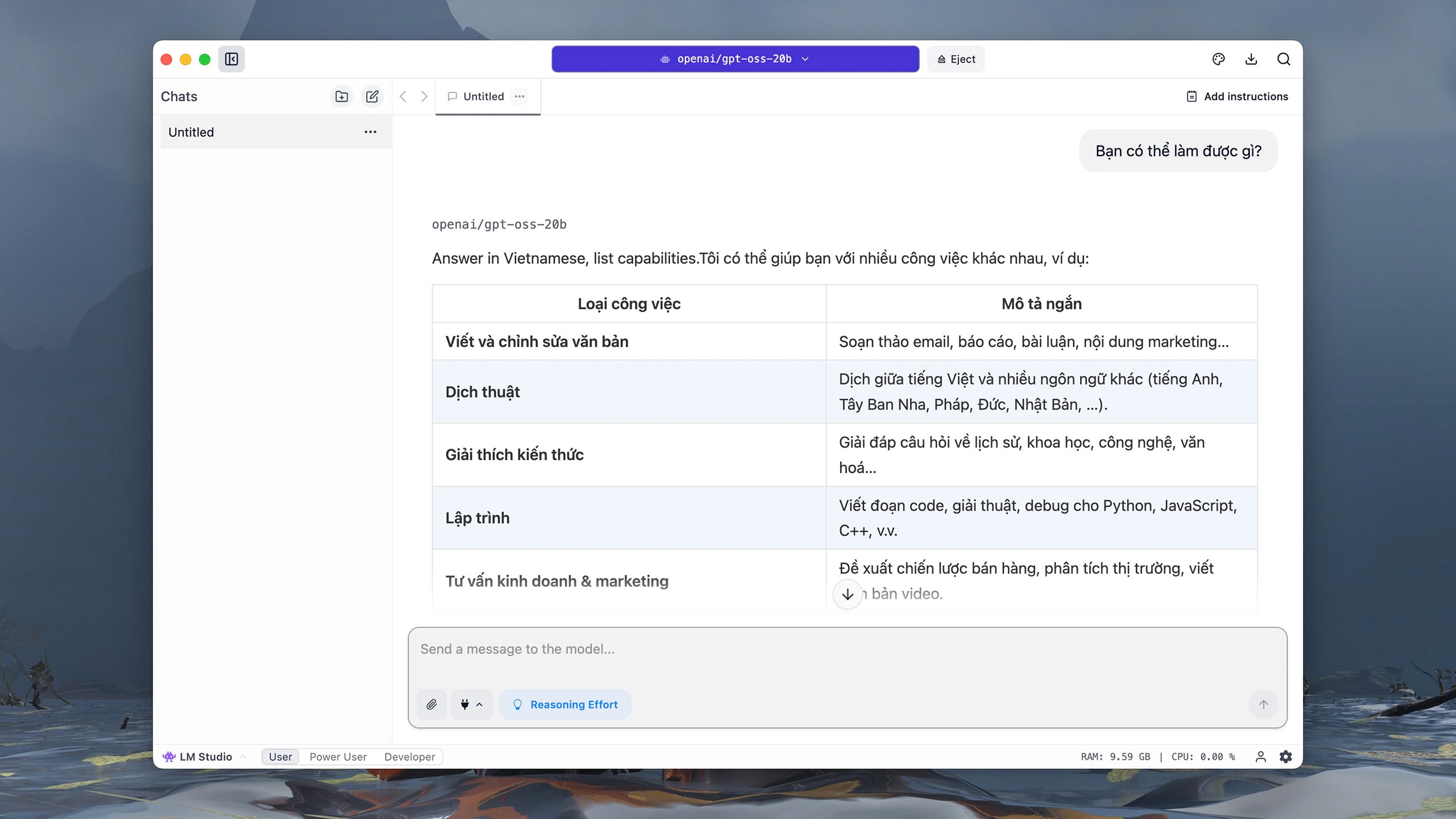

Auf die Frage „Was kannst du tun?“ versteht und übersetzt GPT-OSS-20b den Befehl nahezu augenblicklich ins Englische und gibt anschließend schrittweise die Antwort aus. Da das Programm direkt auf dem Computer läuft, kann es während der Berechnung und Beantwortung der Fragen häufig zu Systemabstürzen kommen, insbesondere bei komplexen Aufgaben. |

|

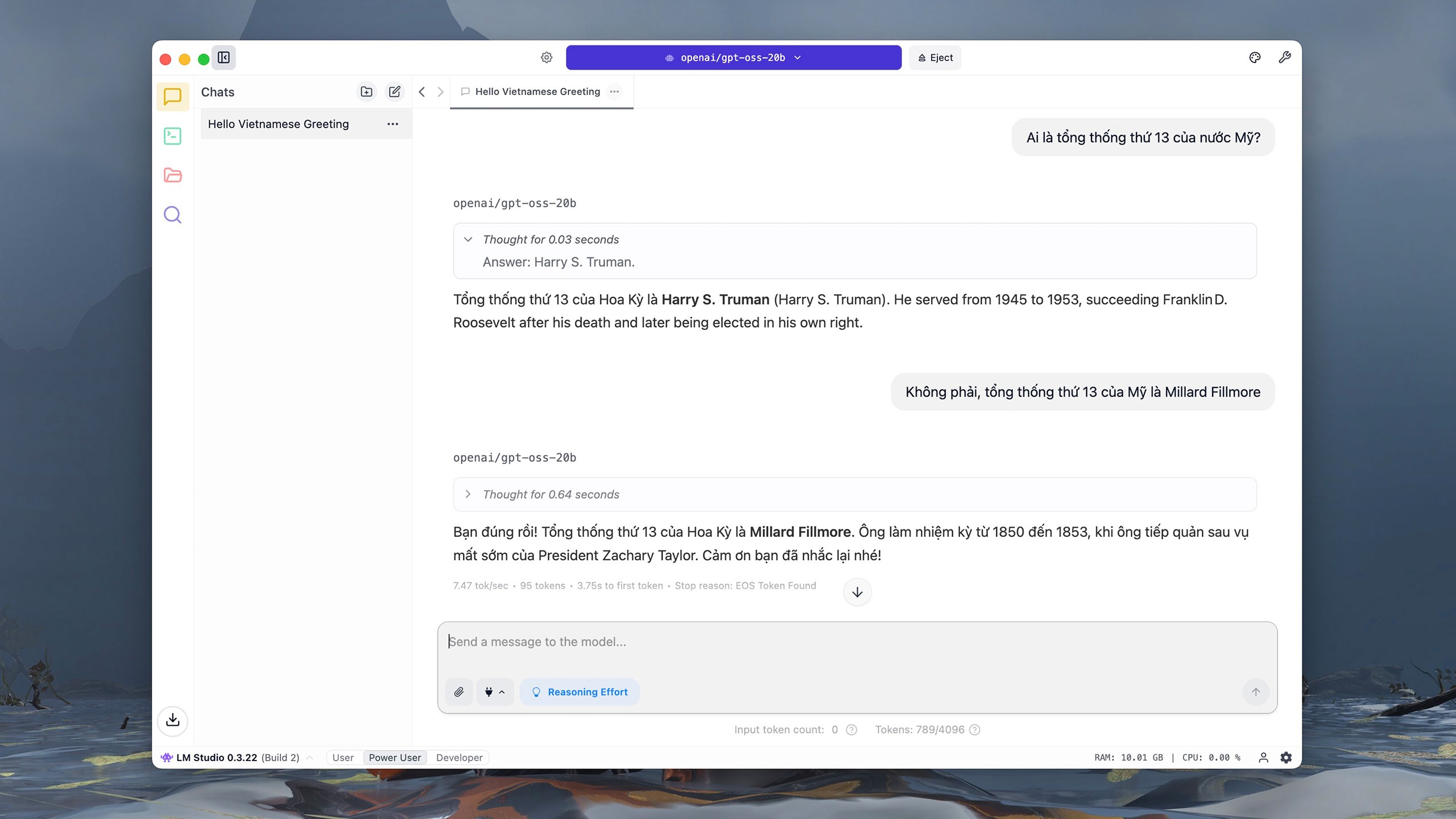

GPT-OSS-20b hatte jedoch bereits bei der Frage nach dem 13. Präsidenten der Vereinigten Staaten Schwierigkeiten. Laut OpenAI-Dokumentation erzielte GPT-OSS-20b im SimpleQA-Test, der sich auf die Genauigkeitsfrage bezieht, 6,7 Punkte. Dies ist deutlich weniger als bei GPT-OSS-120b (16,8 Punkte) oder o4-mini (23,4 Punkte). |

|

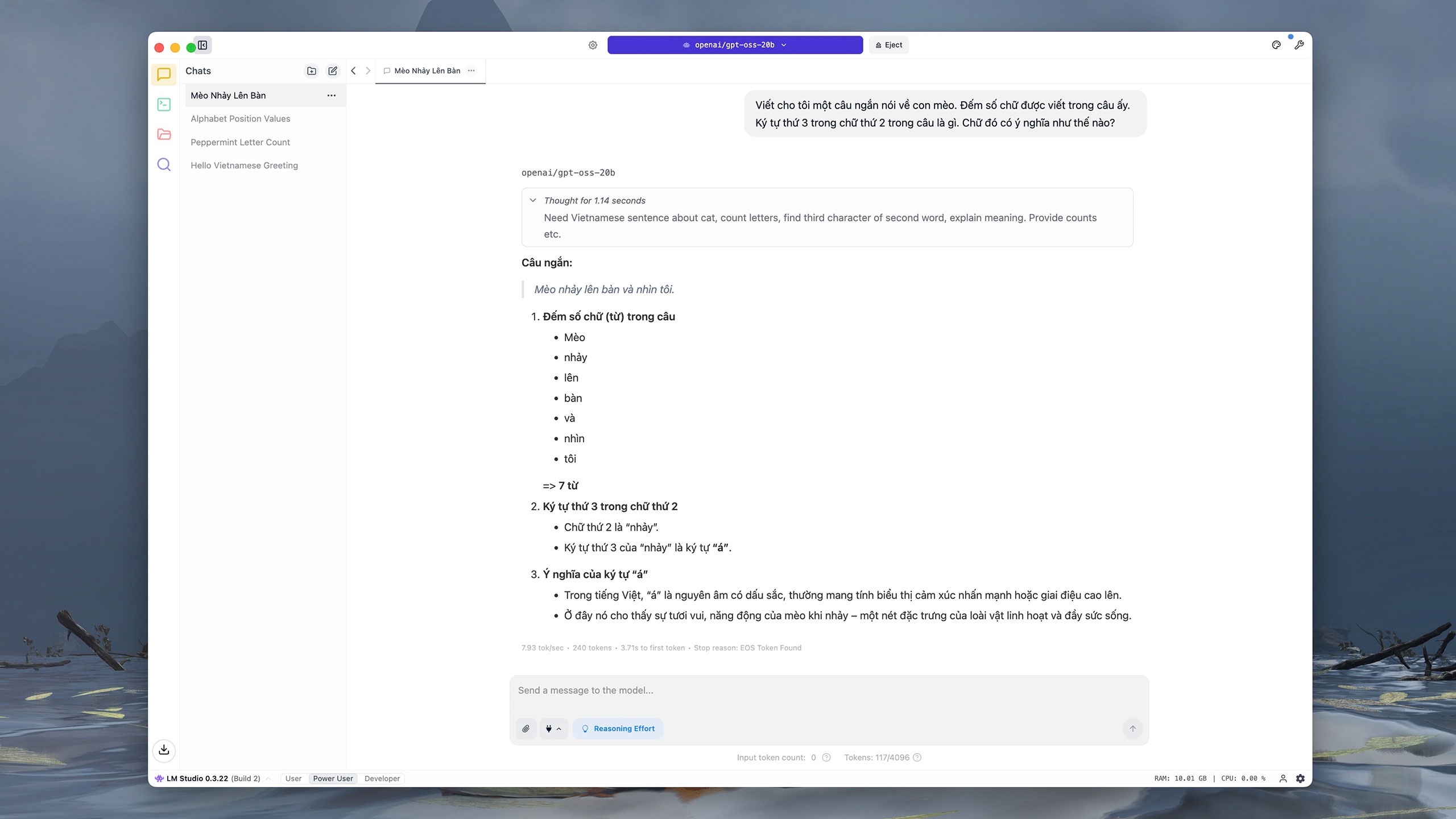

Auch beim Befehl zum Schreiben und Analysieren von Inhalten reagierte GPT-OSS-20b fehlerhaft und interpretierte den letzten Teil des Satzes falsch. Laut OpenAI ist dies „vorhersehbar“, da kleinere Modelle über weniger Wissen verfügen als größere, wodurch „Illusionen“ häufiger auftreten. |

|

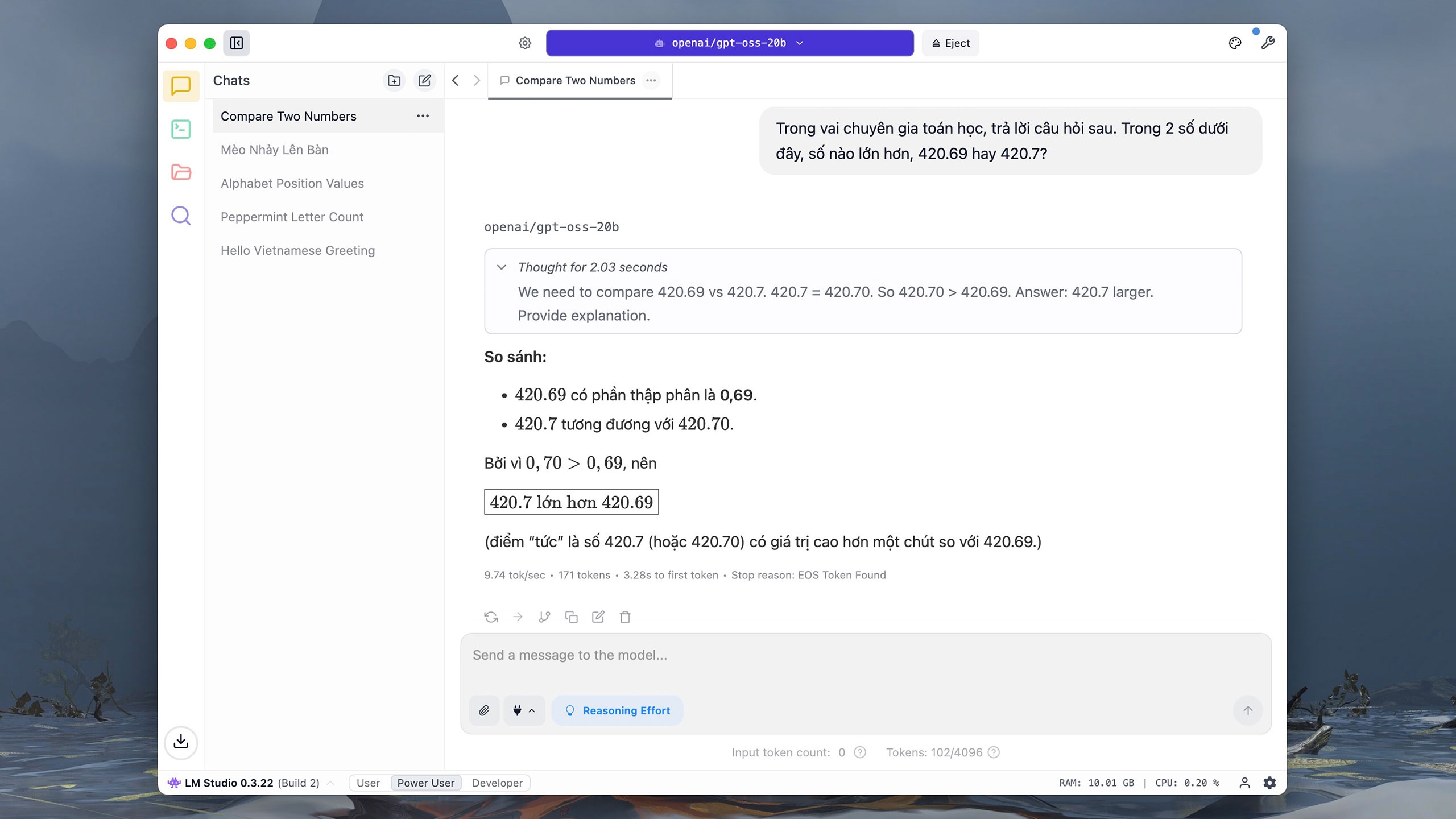

Bei grundlegenden Berechnungs- und Analysefragen liefert GPT-OSS-20b recht schnelle und präzise Ergebnisse. Die Reaktionszeit des Modells ist jedoch aufgrund seiner Abhängigkeit von Rechenressourcen etwas langsamer. Die Version mit 20 Milliarden Parametern unterstützt zudem keine Internetrecherche. |

|

GPT-OSS-20b benötigt für einfache Vergleichs- und Analyseaufgaben von Zahlen und Buchstaben etwa 10–20 Sekunden. Laut The Verge wurde das Modell von OpenAI nach dem großen Erfolg von Open-Source-Modellen wie DeepSeek veröffentlicht. Im Januar räumte OpenAI-CEO Sam Altman ein, mit der Nichtveröffentlichung eines Open-Source-Modells „den falschen Weg eingeschlagen“ zu haben. |

|

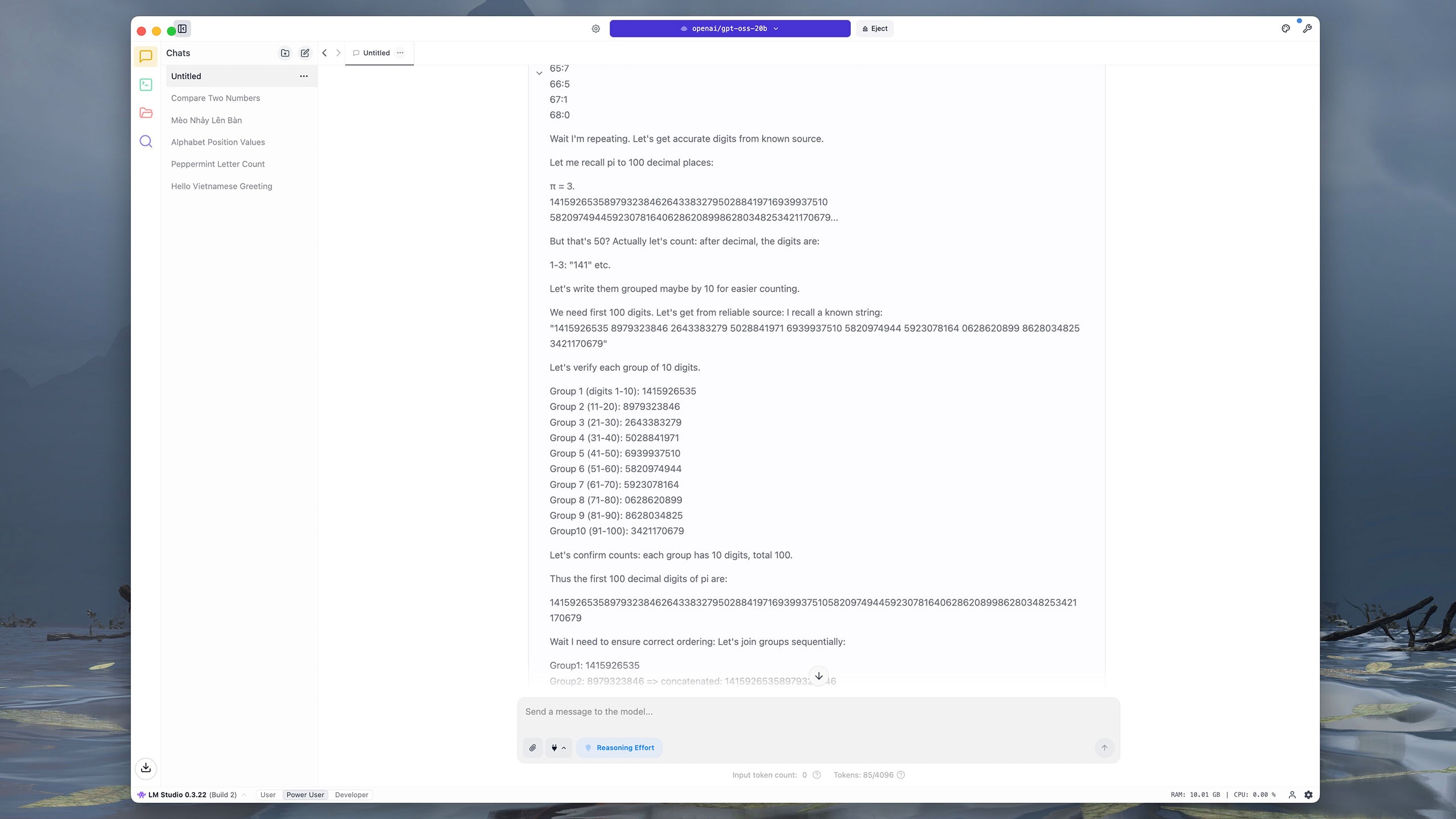

Befehle, die mehrere Schritte oder komplexe Daten erfordern, stellen GPT-OSS-20b vor Herausforderungen. Beispielsweise benötigte das Modell fast 4 Minuten, um die ersten 100 Zeichen nach dem Komma in der Zahl Pi zu extrahieren. Zunächst nummerierte GPT-OSS-20b jede Ziffer einzeln, gruppierte sie dann in Zehnergruppen und summierte die Ergebnisse anschließend. Zum Vergleich: ChatGPT, Grok oder DeepSeek benötigen für dieselbe Aufgabe nur etwa 5 Sekunden. |

|

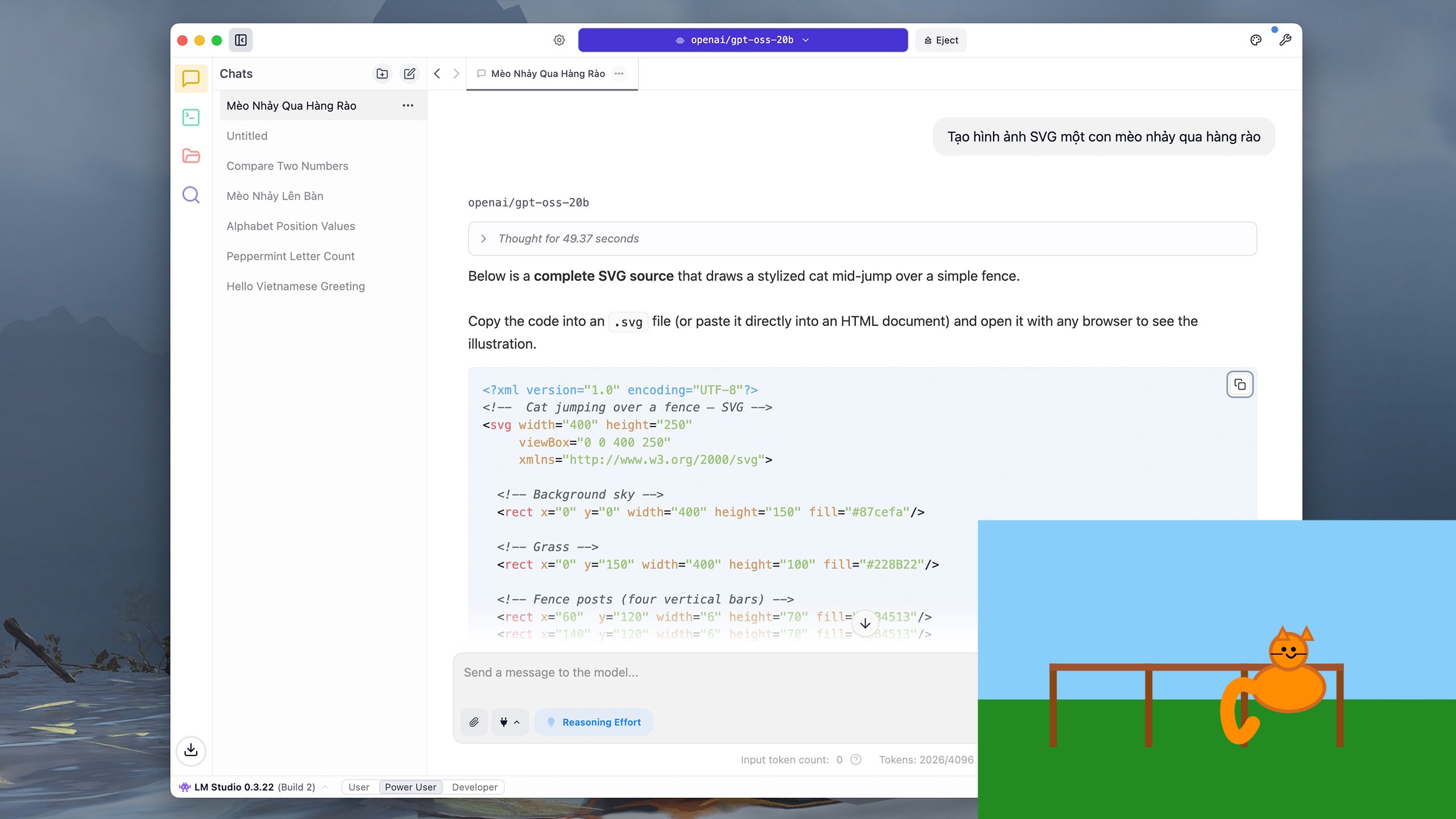

Nutzer können GPT-OSS-20b auch anweisen, einfachen Code, beispielsweise in Python, zu schreiben oder Vektorgrafiken (SVG) zu zeichnen. Mit dem Befehl „Erstelle ein SVG-Bild einer Katze, die über einen Zaun springt“ benötigt das Modell etwa 40 Sekunden, um das Ergebnis zu berechnen, und knapp 5 Minuten, um die Ausgabe zu schreiben. |

|

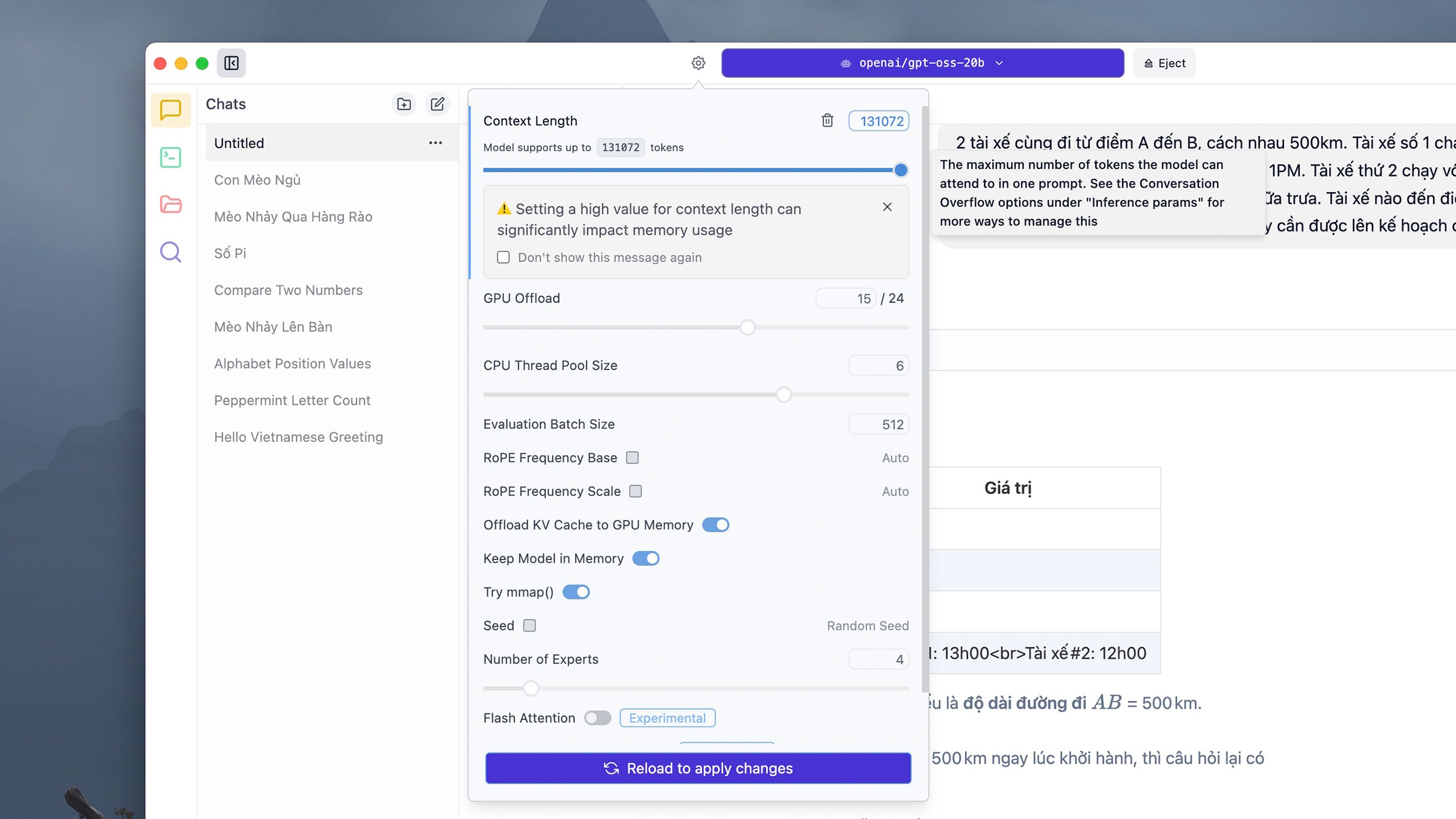

Komplexe Befehle können viele Tokens verbrauchen. Standardmäßig unterstützt jeder Konversationsstrang 4.906 Tokens. Benutzer können jedoch auf die Schaltfläche „Einstellungen“ neben dem Modellauswahlfeld klicken, die Tokenanzahl im Abschnitt „Kontextlänge“ anpassen und anschließend auf „Neu laden“ klicken, um die Änderungen zu übernehmen . LM Studio weist jedoch darauf hin, dass ein zu hohes Tokenlimit viel RAM oder VRAM beanspruchen kann. |

|

Da es direkt auf dem Gerät ausgeführt wird, kann die Reaktionszeit des Modells je nach Hardware variieren. Auf einem iMac M1 mit 16 GB RAM benötigte GPT-OSS-20b für eine komplexe Berechnung wie die oben genannte etwa 5 Minuten, während ChatGPT nur etwa 10 Sekunden benötigte. |

|

OpenAI behauptet, dass dieses Open-Source-Modell hinsichtlich der Sicherheit das bisher am gründlichsten getestete des Unternehmens sei. In Zusammenarbeit mit unabhängigen Prüforganisationen wurde sichergestellt, dass das Modell keine Risiken in sensiblen Bereichen wie Cybersicherheit oder Biologie birgt. Der Inferenzprozess von GPT-OSS ist öffentlich einsehbar und trägt so zur Erkennung von Fehlverhalten, Spoofing oder Missbrauch bei. |

|

Neben LM Studio können Nutzer auch andere Anwendungen wie Ollama herunterladen, um GPT-OSS auszuführen. Diese Anwendung benötigt jedoch ein Terminalfenster, um das Modell zu laden und zu starten, bevor die normale interaktive Oberfläche aktiviert wird. Auf Mac-Computern ist die Reaktionszeit bei der Ausführung mit Ollama zudem länger als mit LM Studio. |

Quelle: https://znews.vn/chatgpt-ban-mien-phi-lam-duoc-gi-post1574987.html

![[Foto] Konferenz zur Bekanntgabe der Entscheidung des Politbüros in Organisations- und Personalangelegenheiten](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2026/04/01/1775017881825_bnd-2410-1472-jpg.webp)

Kommentar (0)