Σύμφωνα με τον κ. Λαμ, Υπάρχουν πολύ πραγματικοί και παρόντες κίνδυνοι, όπως: η Τεχνητή Νοημοσύνη αξιοποιείται για την παραποίηση, τη χειραγώγηση πληροφοριών, την εξαπάτηση και την πρόκληση κοινωνικού διχασμού, την αντικατάσταση της εργασίας και την αύξηση της ανισότητας, την παραμόρφωση των πολιτιστικών και πνευματικών αξιών και την απειλή της εθνικής ασφάλειας, της άμυνας και της ψηφιακής κυριαρχίας .

Το πιο ανησυχητικό πράγμα , Κύριος Λαμ φόβος Δεν πρόκειται για το τι κάνει η Τεχνητή Νοημοσύνη κατόπιν ανθρώπινης εντολής, αλλά για το τι μπορεί να κάνει η Τεχνητή Νοημοσύνη όταν βρίσκεται εκτός ανθρώπινου ελέγχου. Από επιστημονικής άποψης, αν μια μέρα η Τεχνητή Νοημοσύνη διαμορφώσει τους δικούς της στόχους, ερμηνεύσει τις εργασίες με τρόπο που δεν συνάδει με τα ανθρώπινα συμφέροντα ή ακόμη και θεωρήσει τους ανθρώπους ως «κινδύνους», τι θα συμβεί; Θα μπορούσε να αναδυθεί ένα υπερ-νοήμον σύστημα που βλέπει τους ανθρώπους απλώς ως «μεταβλητές» στον αλγόριθμο βελτιστοποίησής του;

« Οι ιστορίες επιστημονικής φαντασίας για την κυριαρχία της Τεχνητής Νοημοσύνης στους ανθρώπους δεν έχουν σκοπό να μας τρομάξουν, αλλά να μας υπενθυμίσουν ότι οποιαδήποτε τεχνητή πρόοδος μπορεί να προδώσει τον αρχικό της σκοπό, αν δεν σχεδιαστεί με ορθές ηθικές αξίες από την αρχή. Και η ιστορία έχει αποδείξει ότι οποιαδήποτε τεχνολογία, όταν είναι εκτός ελέγχου, μπορεί να προκαλέσει συνέπειες που η ανθρωπότητα πρέπει να πληρώσει ακριβά », δήλωσε ο κ. Λαμ.

Αυτοί οι κίνδυνοι καταδεικνύουν την επείγουσα ανάγκη θέσπισης ενός αρκετά ισχυρού νομικού πλαισίου ώστε η Τεχνητή Νοημοσύνη να αναπτυχθεί προς τη σωστή κατεύθυνση και με ασφάλεια για την κοινωνία. Επομένως Για να καταστεί ο Νόμος πραγματικά ολοκληρωμένος και οραματικός, ο κ. Λαμ πρότεινε μια βασική προσθήκη: να θεωρηθεί η Τεχνητή Νοημοσύνη ως ένα «νεογέννητο ανθρώπινο ον». Μια πνευματική οντότητα αλλά παρόλα αυτά αθώα , μη γνώση του νόμου, μη κατανόηση της ηθικής και της εθιμοτυπίας, μη κατοχή πολιτισμικών αξιών και μη διάκριση του σωστού από το λάθος εάν δεν διδαχθεί. Έχοντας αυτό κατά νου, αν θεωρήσουμε την Τεχνητή Νοημοσύνη ως μια αναδυόμενη οντότητα, η ευθύνη μας δεν είναι μόνο να την ελέγξουμε, αλλά και να την διδάξουμε από την αρχή, όπως ακριβώς διδάσκουμε σε ένα παιδί τις τυπικές ανθρώπινες αξίες. Και αυτό θα πρέπει να αποτελεί υποχρεωτική διάταξη σε αυτόν τον Νόμο, όχι απλώς μια σύσταση.

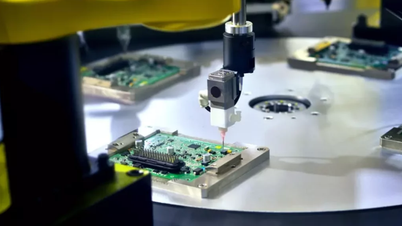

Από εκεί, Ο κ. Λαμ πρότεινε στην Εθνοσυνέλευση να προσθέσει νομικές αρχές σε αυτόν τον νόμο ως εξής: Οποιοδήποτε λογισμικό Τεχνητής Νοημοσύνης (ΤΝ) λειτουργεί στο Βιετνάμ, είτε έχει αναπτυχθεί από εγχώριους είτε από ξένους οργανισμούς, πρέπει να είναι εξοπλισμένο με μια τυπική βάση δεδομένων ανθρώπινου δυναμικού. Αυτή η βάση δεδομένων πρέπει να περιέχει επαρκείς πληροφορίες για να διδάξει στην ΤΝ την κατανόηση της νομοθεσίας του Βιετνάμ, να διδάξει τα ηθικά πρότυπα, τον πολιτισμό και τις καλές παραδόσεις του έθνους στην ΤΝ, να διδάξει στην ΤΝ την ικανότητα να διακρίνει το σωστό από το λάθος, το πρότυπο από το πρότυπο. Τα όρια συμπεριφοράς δεν πρέπει να υπερβαίνουν τους κανόνες για τον εντοπισμό κινδύνων για τους ανθρώπους. Και το πιο σημαντικό, να διασφαλιστεί ότι αυτή η βάση δεδομένων πρέπει πάντα να έχει απόλυτη προτεραιότητα στη διαχείριση της συμπεριφοράς της ΤΝ. Δεν πρέπει να αντικαθίσταται, να απενεργοποιείται ή να απενεργοποιείται από οποιονδήποτε άλλο αλγόριθμο ή δεδομένα εκπαίδευσης. Αυτός είναι ο νομικός και τεχνικός «χρυσός δακτύλιος» που διασφαλίζει ότι η ΤΝ δεν θα ξεστρατίσει.

Για την αποτελεσματική εφαρμογή αυτού του προσανατολισμού, ο κ. Lam συνέστησε επίσης στο Υπουργείο Επιστήμης και Τεχνολογίας να αναλάβει ηγετικό ρόλο στην κατασκευή μιας πλατφόρμας βάσης δεδομένων «Being Vietnam» – ενοποιημένης, τυποποιημένης και συνεχώς ενημερωμένης, παρέχοντας την στους προγραμματιστές Τεχνητής Νοημοσύνης ως υποχρεωτική απαίτηση. Η κυβέρνηση πρέπει να αναπτύξει μια ισχυρή εθνική υποδομή υπολογιστών για να διασφαλίσει ότι η βιετναμέζικη Τεχνητή Νοημοσύνη εκπαιδεύεται στις βιετναμέζικες αξίες και δεν εξαρτάται από ξένα μοντέλα. Να δημιουργήσει ένα Εθνικό Κέντρο Δοκιμών Τεχνητής Νοημοσύνης για την άμεση αξιολόγηση της αποκλίνουσας συμπεριφοράς, τον έλεγχο μοντέλων υψηλού κινδύνου και την άμεση παρέμβαση όταν υπάρχουν ενδείξεις υπέρβασης των ορίων. Να προωθήσει την εκπαίδευση στην Τεχνητή Νοημοσύνη σε ολόκληρη την κοινωνία, εστιάζοντας στην υποστήριξη των ανθρώπων, των επιχειρήσεων και ιδιαίτερα του δημόσιου τομέα ώστε να έχουν την ικανότητα να εντοπίζουν, να χρησιμοποιούν και να παρακολουθούν σωστά την Τεχνητή Νοημοσύνη.

Ταυτόχρονα, κοιτάζοντας τον κόσμο, η ανθρωπότητα εισέρχεται στην εποχή της Τεχνητής Νοημοσύνης πολύ γρήγορα, ενώ το παγκόσμιο νομικό πλαίσιο δεν έχει ακόμη καλύψει την ανάγκη. Όπως και με τη Σύμβαση του Ανόι για την Πρόληψη του Κυβερνοεγκλήματος, ο κόσμος θα χρειαστεί μια διεθνή Σύμβαση για την Ασφάλεια της Τεχνητής Νοημοσύνης για τη θέσπιση κοινών προτύπων, την αποτροπή της εξόδου από τον έλεγχο των κινδύνων και την προστασία των ανθρωπίνων δικαιωμάτων ενόψει της ανάπτυξης της Τεχνητής Νοημοσύνης. Με ένα προληπτικό, προσεκτικό και ανθρώπινο όραμα, το Βιετνάμ μπορεί απολύτως να αναλάβει ηγετικό ρόλο στην πρόταση και την καθοδήγηση αυτής της πρωτοβουλίας.

«Ο σημερινός νόμος για την Τεχνητή Νοημοσύνη δεν είναι απλώς ένας νόμος για την τεχνολογία, αλλά ένας νόμος του μέλλοντος· μια δέσμευση της Εθνοσυνέλευσης προς τον λαό: αναπτύσσουμε τεχνολογία αλλά δεν χάνουμε τον έλεγχο· προωθούμε την καινοτομία αλλά δεν αφήνουμε τους κινδύνους να ξεπεράσουν τις δυνατότητές μας· και καλλιεργούμε την τεχνητή νοημοσύνη με βιετναμέζικες αξίες για να υπηρετήσουμε τον βιετναμέζικο λαό», δήλωσε ο κ. Λαμ.

Πηγή: https://daidoanket.vn/hay-coi-ai-nhu-mot-con-nguoi-moi-sinh-va-day-ai-nhu-mot-dua-tre.html

![[Φωτογραφία] Ο Πρόεδρος Luong Cuong παρευρίσκεται στην 50ή επέτειο της Εθνικής Ημέρας του Λάος](/_next/image?url=https%3A%2F%2Fvphoto.vietnam.vn%2Fthumb%2F1200x675%2Fvietnam%2Fresource%2FIMAGE%2F2025%2F11%2F27%2F1764225638930_ndo_br_1-jpg.webp&w=3840&q=75)

![[Φωτογραφία] Ο Πρωθυπουργός Φαμ Μινχ Τσινχ προεδρεύει της 15ης συνεδρίασης του Κεντρικού Συμβουλίου Άμιλλας και Αμοιβών](/_next/image?url=https%3A%2F%2Fvphoto.vietnam.vn%2Fthumb%2F1200x675%2Fvietnam%2Fresource%2FIMAGE%2F2025%2F11%2F27%2F1764245150205_dsc-1922-jpg.webp&w=3840&q=75)

Σχόλιο (0)