Un desafío: enseñar a la IA qué está bien y qué está mal, y cómo hacer de la tecnología una herramienta de transparencia, responsabilidad y bien común.

Cuando la ética se convierte en el “segundo cerebro” de la IA

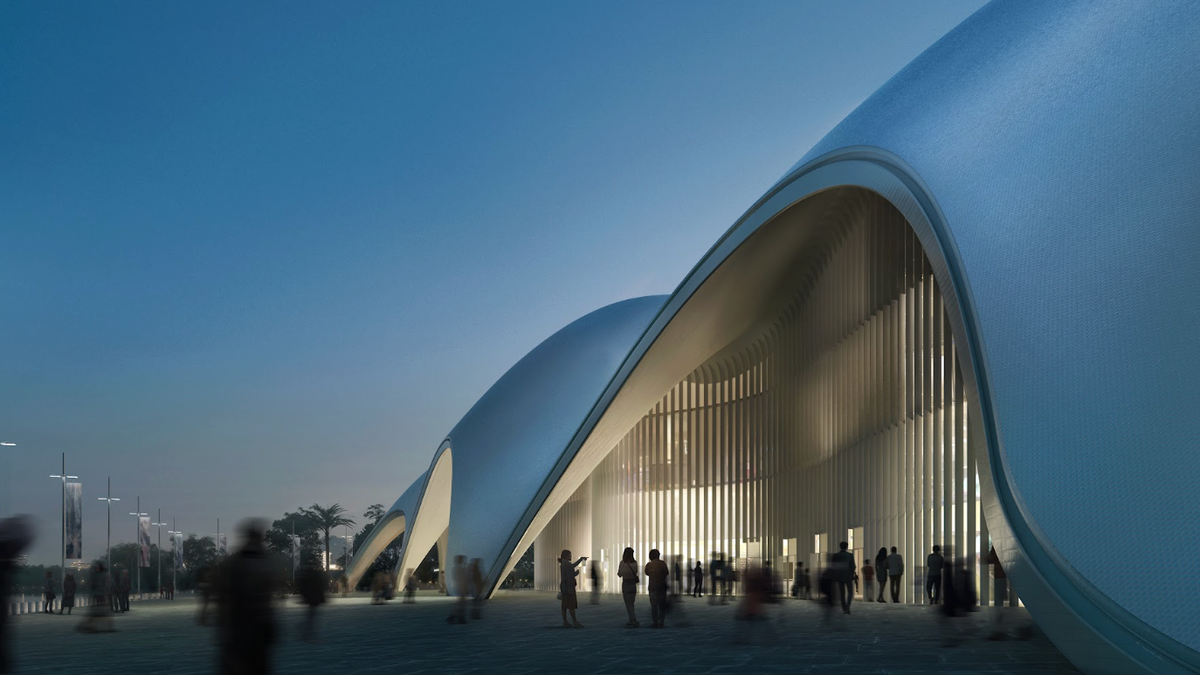

Mientras la atmósfera emocionante de AIWS Angel aún se extendía, el Comité Organizador del Concurso de IA 2025 anunció rápidamente el segundo tema: Ética de AIWS, que marca la transición de "compañero de IA" a "responsable de IA".

Si en el primer tema se animó a los concursantes a crear "ángeles tecnológicos" para ayudar a las personas a aprender, innovar y cuidar su salud, AIWS Ethics lleva el reto a un nivel superior: diseña y desarrolla herramientas para evaluar los valores éticos en el desarrollo y uso de la IA. El objetivo no es solo crear productos útiles, sino también orientar el desarrollo de la IA en la dirección correcta: transparente, responsable y en beneficio de la humanidad.

Las propuestas pueden ser ideas innovadoras y revolucionarias, o software, aplicaciones o sistemas de evaluación sencillos, accesibles, educativos y escalables. Este es un terreno fértil para la innovación humanística, donde la tecnología y la ética van de la mano.

¿Por qué se elige ahora “Ética”?

Nunca antes había sido tan necesario que la humanidad hablara de ética en la tecnología. A medida que la inteligencia artificial sale del laboratorio y se integra a la vida cotidiana, surgen grandes preguntas: ¿Puede la IA ser sesgada? ¿Puede invadir la privacidad? ¿Puede tomar decisiones erróneas o incluso perjudiciales?

Un estudio del Annenberg Media Center (EE. UU.) muestra que más del 70 % de los usuarios globales están preocupados por el mal uso de la IA o la falta de control ético. Según la UNESCO, organizaciones internacionales están trabajando para crear marcos globales de evaluación ética de la IA, como la «Evaluación del Impacto Ético (EIA)» o la «Recomendación sobre la Ética de la IA», para medir el impacto social y humano de la tecnología.

Sin embargo, la mayoría de estas herramientas aún están reservadas a grandes corporaciones o institutos de investigación. La comunidad joven, estudiantes y startups —dinámicas, creativas y cercanas a los usuarios— carecen de herramientas lo suficientemente accesibles y fáciles de usar para evaluar y difundir los estándares éticos en IA. Y ese es el vacío que AIWS Ethics quiere llenar.

De la tecnología a la conciencia: la diferencia ética de AIWS

Mientras que las temporadas anteriores del Concurso de IA se centraron en aplicaciones y avances técnicos, Ética de AIWS es una invitación a profundizar en el funcionamiento interno de la tecnología. Aquí, la pregunta ya no es "¿Qué puede hacer la IA?", sino "¿Qué debería hacer la IA y qué no debería hacer?".

Este tema requiere que los participantes no solo comprendan programación y algoritmos, sino también la capacidad de plantear cuestiones éticas, crítica social y diseño humano. Un programador puede convertirse en el guardián de la ética de la IA; un educador puede crear una herramienta para enseñar ética tecnológica; un equipo de startups puede desarrollar una aplicación para evaluar la transparencia de chatbots o generadores de imágenes.

Es en este proceso que AIWS Ethics abre un espacio creativo muy especial: donde los datos se encuentran con la filosofía y los algoritmos se encuentran con la compasión.

Siguiendo el espíritu del tema, se pueden imaginar innumerables direcciones creativas: una aplicación que ayude a los estudiantes a comprender la imparcialidad en la IA; un sitio web comunitario que permita obtener "puntajes éticos" de herramientas de IA populares; un chatbot que pueda plantear situaciones éticas hipotéticas y analizar las decisiones de los usuarios; o un software que pruebe modelos de aprendizaje automático para detectar sesgos en los datos.

Estas innovaciones no se limitan a la tecnología, sino también a la educación: concientizan a la comunidad sobre la ética de la IA. Cada producto es un pequeño ladrillo que construye una cultura de IA responsable.

El viaje de “sembrar semillas de conciencia” para la inteligencia artificial

Ese dicho es también el alma del tema de este año: la IA no sólo necesita grandes datos, sino también un gran corazón.

Con Ética AIWS, el Comité Organizador del Concurso de IA 2025 espera impulsar una ola de innovación responsable, donde los jóvenes no solo quieran fortalecer la IA, sino también mejorarla. Este tema no se limita a los productos tecnológicos, sino que también abarca la construcción de una cultura: una cultura ética en la era del aprendizaje automático.

El concurso invita no sólo a programadores, sino también a educadores, artistas, investigadores sociales: cualquier persona interesada en cómo la tecnología da forma al mundo humano.

Una invitación del futuro

El Concurso de IA 2025 abre un nuevo capítulo: cada idea se juzga no solo por su rendimiento, sino también por su responsabilidad. El tema, Ética de AIWS, nos recuerda que si la inteligencia artificial puede aprender a pensar, los humanos debemos enseñarle a vivir con bondad.

Y quién sabe, tal vez a partir de esta competencia, un grupo de estudiantes vietnamitas cree la primera herramienta de evaluación ética de inteligencia artificial para la comunidad global: un producto "Hecho en Vietnam" que sea a la vez inteligente y concienzudo.

(Fuente: VLAB Innovation)

Fuente: https://vietnamnet.vn/ai-contest-2025-aiws-ethics-hanh-trinh-gioi-hat-luong-tam-cho-ai-2449711.html

Kommentar (0)